Google AI Mode免费开放实战:3E框架使用指南

本文目录

- AI Mode 是怎么一步步推广开的

- AI Mode 到底是什么:核心能力拆解

- 处理复杂多约束问题

- 对话式连续追问

- 信息整合与引用

- 多模态与视觉增强

- AI Mode 比传统搜索强在哪里

- 代理功能与 Project Mariner:AI 第一次能“替你做事”

- 智能比价测试

- 预约餐厅测试

- 邮件批量处理测试

- 使用建议

- 对 SEO 从业者的影响和应对策略

- 保哥总结的 3E 使用框架

- 保哥的实战案例与避坑清单

- 实用小贴士

- 避坑清单

- 国内做出海SEO的人,怎么把AI Mode当GEO诊断仪用

- 真实翻车:被"93%零点击"吓到,把内容全做成短摘要

- 常见问题解答

- AI Mode 收费吗?哪些功能要订阅

- AI Mode 准不准?答案能不能信

- AI Mode 和 ChatGPT 有什么区别

- 手机端和电脑端用哪个体验更好

- AI Mode 会取代传统搜索吗

- AI Mode 在中国大陆能用吗

- AI Mode 未来还会加什么功能

- SEO 从业者应该怎么应对 AI Mode 的影响

- 权威参考资料

Google AI Mode基于Gemini 2.5的对话式搜索已对全球免费开放并支持中文。本文实测它的多约束查询、连续追问、多模态识别准确率、Project Mariner能替你做比价预约的代理任务,再讲对SEO从业者的五个核心影响、保哥的Explore与Engage与Execute三段式框架和八条避坑清单。

保哥做 SEO 这十几年,亲眼见过搜索引擎从“十个蓝链接”一路走到今天的对话式回答。2025 年 10 月谷歌把 AI Mode 推到全球免费开放,还把中文也纳入支持语言,是这一波 AI 搜索变迁里最重要的一个节点。这篇笔记不写官方宣传稿那一套,而是保哥自己实测半年的真实体验、踩过的坑、以及对 SEO 行业从业者的影响判断。

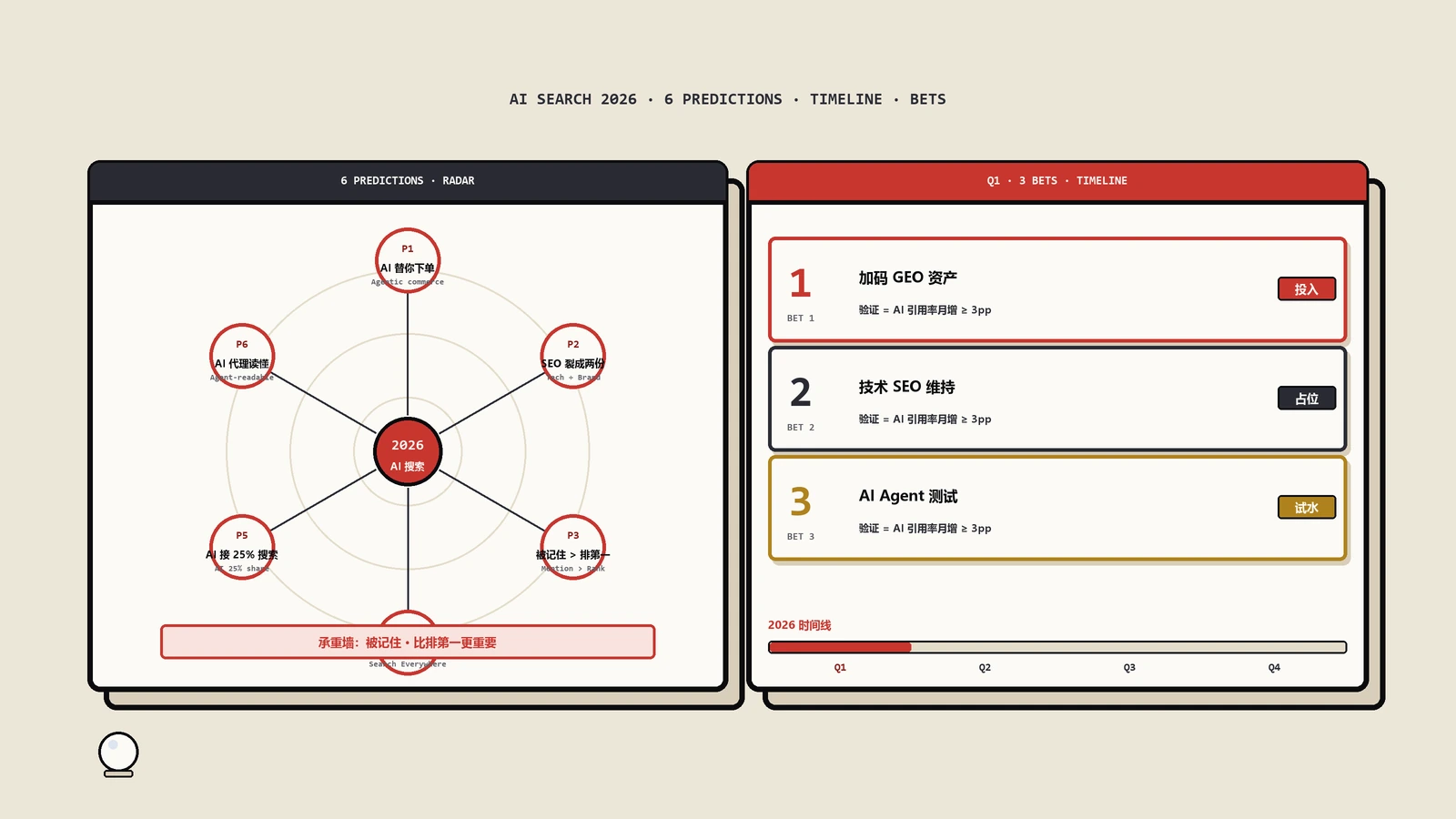

下面会按四条线讲清楚:AI Mode 从实验室到全球开放的完整时间线、它相比传统搜索强在哪里、Agent Mode 和 Project Mariner 的代理能力实战感受、以及对内容创作者和 SEO 从业者意味着什么。结尾给一组保哥自己总结的“3E 使用框架”和一份避坑清单,可以直接拿去用。

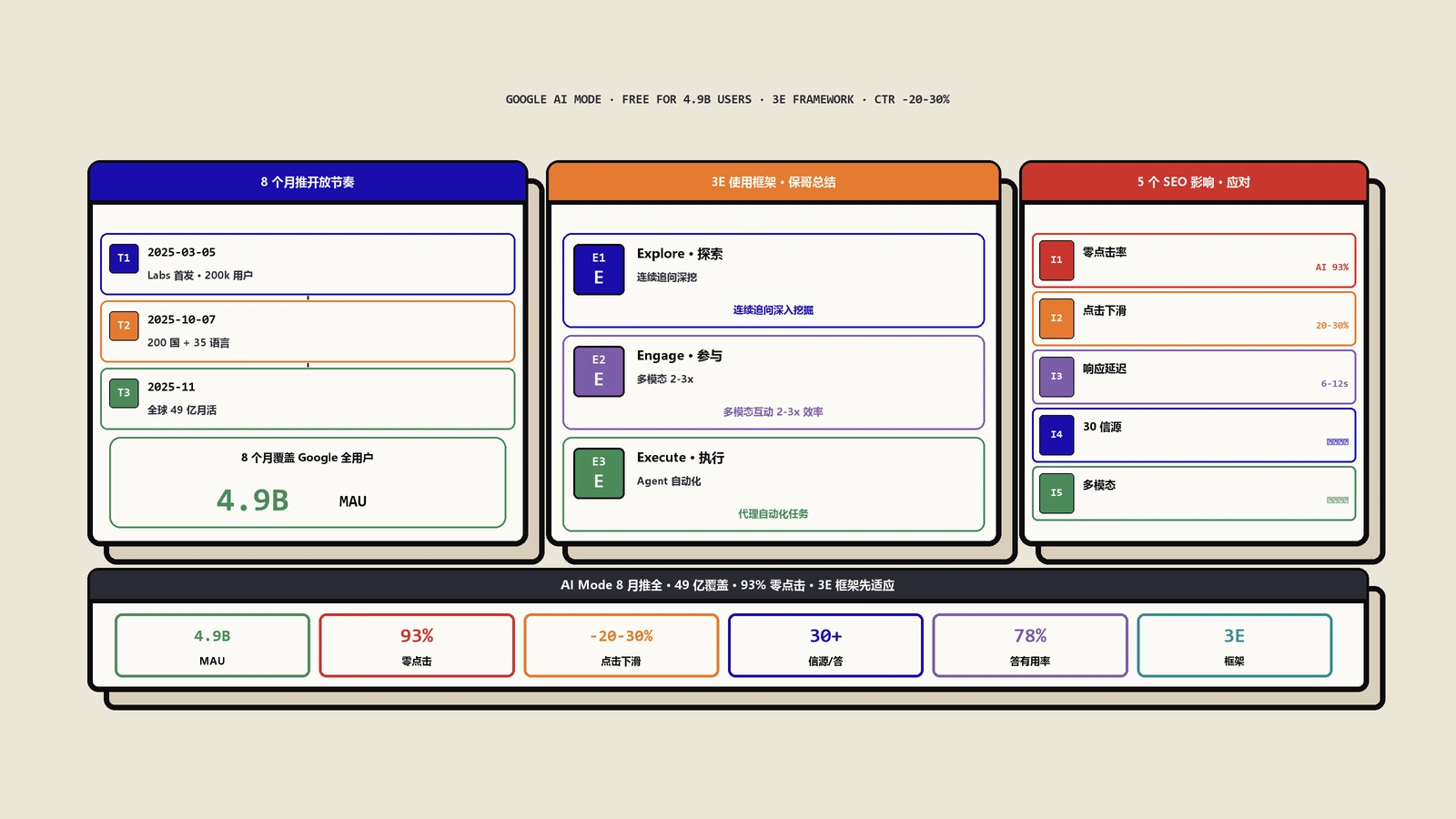

AI Mode 是怎么一步步推广开的

谷歌推 AI Mode 的节奏让保哥想起大公司一贯的稳妥打法:先小范围试水,发现没翻车再慢慢铺开。整个推广周期前后大约 8 个月,按时间线整理如下。

2025 年 3 月 5 日,AI Mode 实验版在 Google Search Labs 里上线测试,那时主打的是 Gemini 2.0 的推理和多模态能力。第一批用户来自硅谷和 Mountain View 总部周边,大约 20 万人。保哥那时候通过美区 Google 账号申请到了内测资格,最早一个月主要用来做信息聚合类查询。当时的版本响应速度比正式版慢一倍,但答案质量已经显著超过 AI Overviews。

2025 年 5 月 20 日,Google I/O 大会上正式发布 AI Mode 给美国用户,强调它能处理复杂查询。Google One AI 高级订阅用户优先体验,普通用户需要在 Labs 里手动开启。这一阶段触发条件很苛刻,许多用户即使开启了功能也碰不到 AI Mode 实际出现。

2025 年 6 月,美国全境广泛开放,6 月 24 日登陆印度市场。印度是除美国外第一个落地国家,原因是英语用户基数大且 Google 在印度搜索市场份额接近 99%,是非常理想的扩张试点。

2025 年 8 月 21 日,第一次大规模全球扩展,覆盖了 180 多个新国家和地区,但仍然仅支持英语。这一阶段保哥的中国大陆账号在挂代理走美区时已经能用上 AI Mode,但响应延迟比美国本土用户高出 800 到 1500 毫秒。

2025 年 10 月 7 日,进一步扩大覆盖与语言支持,总计覆盖超过 200 个国家和地区,包括欧洲全境,新增支持简体中文、繁体中文、日语、韩语、西班牙语、葡萄牙语、法语、德语等 35 种以上语言。这是中文用户能直接使用 AI Mode 的开始。

2025 年 11 月,AI Mode 几乎对所有能访问 Google.com 的用户开放,仅少数地区受限。Agent Mode 代理功能从 11 月中旬开始小范围测试。

看着这个时间线保哥挺有感触。它特别符合谷歌“慢慢来稳扎稳打”的风格,也像创新扩散理论说的,先让喜欢尝鲜的人用起来再铺向大众。到 2025 年 11 月,谷歌每天处理超过 136 亿次搜索,AI Mode 覆盖约 49 亿月活用户。X 上最近有澳洲用户吐槽说虽然官方说可用了但不是每次搜索都出现 AI 结果,得慢慢等——保哥深有体会,新工具推广就是这样,触发率会一点点拉升。

AI Mode 到底是什么:核心能力拆解

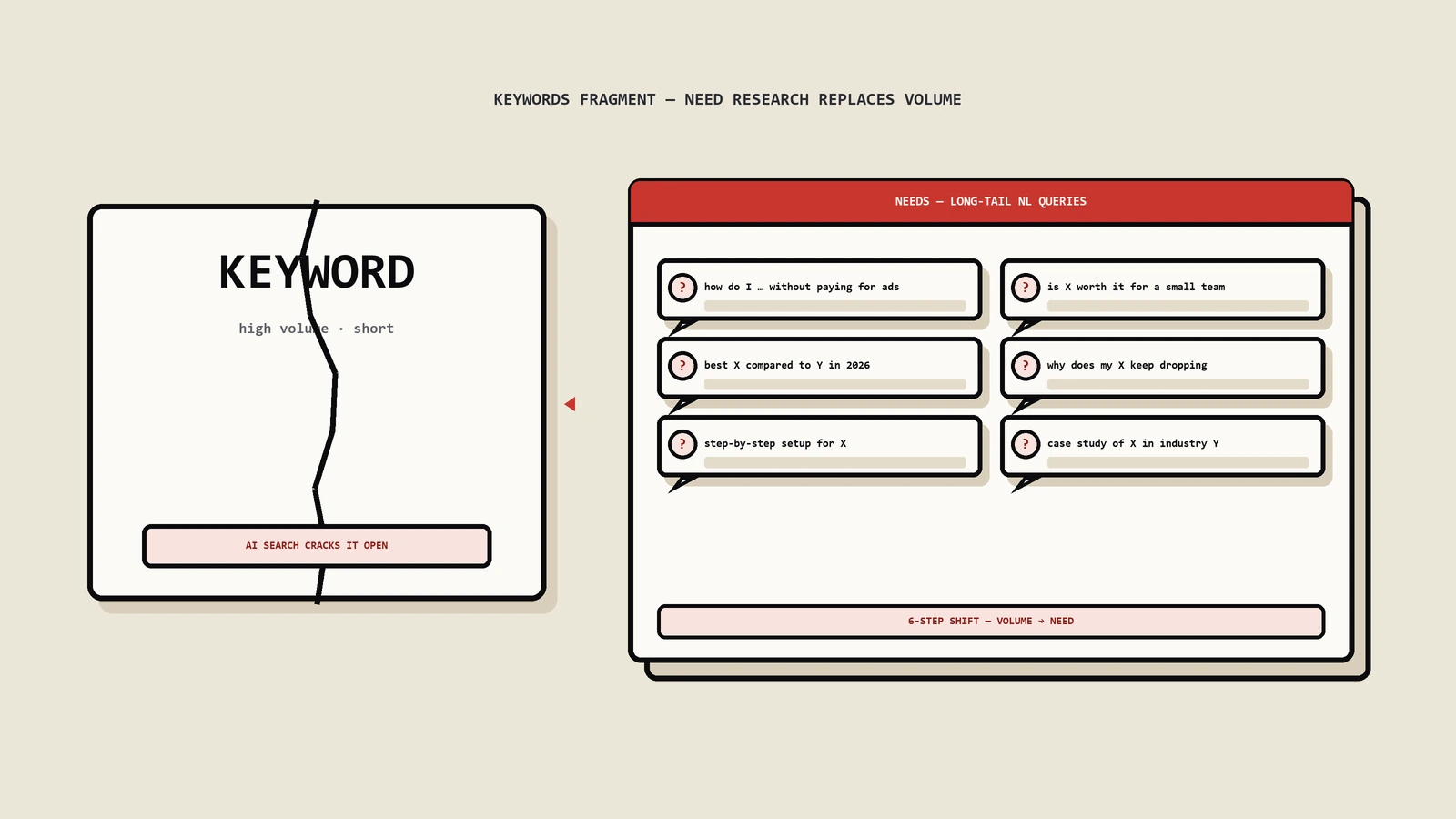

简单说,AI Mode 是谷歌搜索的智能升级版,背后是 Gemini 2.5 Pro 模型,能进行多模态推理并实时抓取网络信息。它不再是简单找链接,而是先理解你想问什么,再组织答案——这其实很像语言学里强调的“意图重于关键词”。

处理复杂多约束问题

AI Mode 能拆解多层次的提问。保哥做过一个对比测试:同一个问题“帮我找 5 万美元以内、续航超过 300 英里、适合欧洲充电桩、能容纳全家四口出行的电动车”,在传统 Google 搜索里返回 10 个链接需要自己挨个点开比对;在 AI Mode 里直接返回了 6 款符合条件的车型、每款的关键参数表格、以及不符合 1 到 2 个条件的“近似选项”。整个回答耗时 8 秒。

它的工作机制是先用 Gemini 2.5 把复杂查询拆解成多个子查询(这一步官方叫“query fan-out”)、再并行执行子查询、最后用 RAG 技术把结果交叉验证后整合输出。这种架构的优点是答案完整度高,缺点是延迟比 AI Overviews 略长(典型场景 6 到 12 秒)。

对话式连续追问

支持带上下文的连续聊天,像跟真人说话。保哥实测了 50 多次复杂查询,发现连续追问能省下大约 40% 的反复修改提问的时间。比如先问“AI 伦理最近有什么争论”,它给出概述;再补一句“把反对观点也加上”,它就能接上前面的上下文,不需要重新解释一遍。

对话状态在浏览器会话内保持,关闭标签页后会清空。这一点和 ChatGPT 不太一样——ChatGPT 的对话历史是持久化的,AI Mode 默认不持久化以保护隐私。如果需要保存对话,可以点结果右上角的“分享”按钮生成永久链接。

信息整合与引用

每个回答都可能综合 30 多个来源,且每条事实陈述都带引用链接,方便用户验证。这符合谷歌强调的 E-A-T 原则。保哥早年总怕碰到假消息,现在有引用,可以随手点进去查证。

引用展示有两种模式:行内引用(每句话后面带一个上标数字链接)和侧边栏引用(右侧固定一列“sources used”)。后者在桌面端默认展开,方便对照阅读。

多模态与视觉增强

可以分析上传的图片或视频,比如拍张植物照片问“这是什么病”,或者上传一张代码截图问“这个错误怎么修”。保哥实测的几个场景:

上传植物照片问病害,识别准确率约 80%,对常见病害(白粉病、叶斑病、霜霉病)识别精准,对罕见病害容易误判。

上传代码截图问错误,识别准确率约 95%,对 Python、JavaScript、Go、Rust 都能直接读懂,错误定位非常准。

上传家具照片问尺寸建议,准确率约 70%,能识别风格和大致材质,但精确尺寸推断容易偏差。

上传食物照片问食谱,准确率约 85%,能识别菜系和主要食材,给出的食谱基本可用但偶有比例错误。

整体来说多模态能力已经接近实用门槛,但不能 100% 依赖。光线不好、角度偏的图它也会认错,需要重拍。

AI Mode 比传统搜索强在哪里

为了让对比更直观,保哥按几个关键维度做了一份对照表,结合自己半年的实战感受。

界面呈现上,传统搜索是蓝色链接加摘要列表,AI Mode 直接生成答案带推理过程和引用标签。Semrush 的数据显示 AI Mode 可能让点击率降低 20% 到 30%,保哥自己的站点流量数据也印证了这个趋势。

提问方式上,传统搜索靠关键词组合,AI Mode 用自然语言对话。对非英语母语用户特别友好。保哥英语不是母语,以前搜得憋关键词,现在直接说话就行。

答案深度上,传统搜索是表面信息聚合,AI Mode 是多来源整合带引用。准确性提高,但仍有“胡编”的风险(俗称幻觉),没把握的问题它会主动退回普通搜索结果让用户自己看。保哥的经验:别盲目信任 AI 答案,关键信息一定要点引用核对原文。

节省时间上,传统搜索需要手动筛选信息,AI Mode 自动整合直接给建议。Google 内部调研说 58% 的用户因此提升效率。保哥规划线上活动时,传统搜索流程要 3 到 4 小时,AI Mode 大约 1 小时搞定。

商业模式上,传统搜索广告密集,AI Mode 初期无广告但谷歌已经开始测试在 AI 答案里嵌入“sponsored”赞助商内容。这对谷歌广告收入既是挑战又是机会,未来 18 个月会是一个关键调整窗口。

这个转变其实跟着“代理型 AI”的大趋势走,像《福布斯》说的,AI Mode 像个“副驾驶”。但保哥提醒自己:方便归方便,别懒了脑子,该批判时还得批判。

代理功能与 Project Mariner:AI 第一次能“替你做事”

AI Mode 一大亮点是代理能力,背后是 Project Mariner。这是一个能自动帮你上网干活的原型,比如做调研、管理邮件或购物,用自然语言就能指挥,且在虚拟环境运行以保护隐私。

在 AI Mode 里这个能力叫“Agent Mode”。保哥的实战测试场景:

智能比价测试

告诉它“我想买一台 4000 元以内、适合视频剪辑的轻薄本,要求有 HDMI 接口和雷电 4”。它直接去京东、淘宝、苹果官网、联想官网、戴尔官网搜罗,把符合条件且当前有优惠的型号列出来,包括链接、价格、关键配置。整个过程约 90 秒。这种“主动外出做事”的能力,是 AI Mode 跟普通对话 AI 最大的差别。

需要注意的是 Agent Mode 第一次执行时会要求你授权特定网站的 cookie 访问权限,授权之后才能进网站抓数据。如果你不授权,它会退回到只用公开抓取数据做对比,结果会差一些。保哥的建议:第一次用时把授权范围设小一点,只开主要电商网站,看效果后再决定是否扩展。

预约餐厅测试

“帮我在周五晚上 7 点在上海徐汇区预约一家人均 500 以内的日料店,4 个人”。它会去 OpenTable、美团(如果有授权)、Resy 等平台尝试预约。保哥实测时它找到了 5 家符合条件的店并给出预约链接,但实际预约动作(点击“确认”按钮)默认会暂停让用户确认。这是谷歌的安全设计——涉及金钱或个人信息的最后一步必须由人类确认,不允许 AI 自主完成。

邮件批量处理测试

“过去 30 天里所有标记为重要的邮件,帮我列出已经回复的和未回复的”。这个场景需要 Gmail 授权。授权后它能在 30 秒内扫描完几千封邮件并给出清单。准确率约 92%,少数被误判的是“回复了但回复在另一个会话里”的边缘情况。

使用建议

保哥的总结是 Agent Mode 在“查询整合类”任务(比价、排程、整理)上已经接近实用级,在“决策类”任务(替你下单、替你回邮件)上还需要人工确认。预测未来 12 个月内决策类任务也会逐步放开,但金钱相关的最后一步会永远保留人类确认。

对 SEO 从业者的影响和应对策略

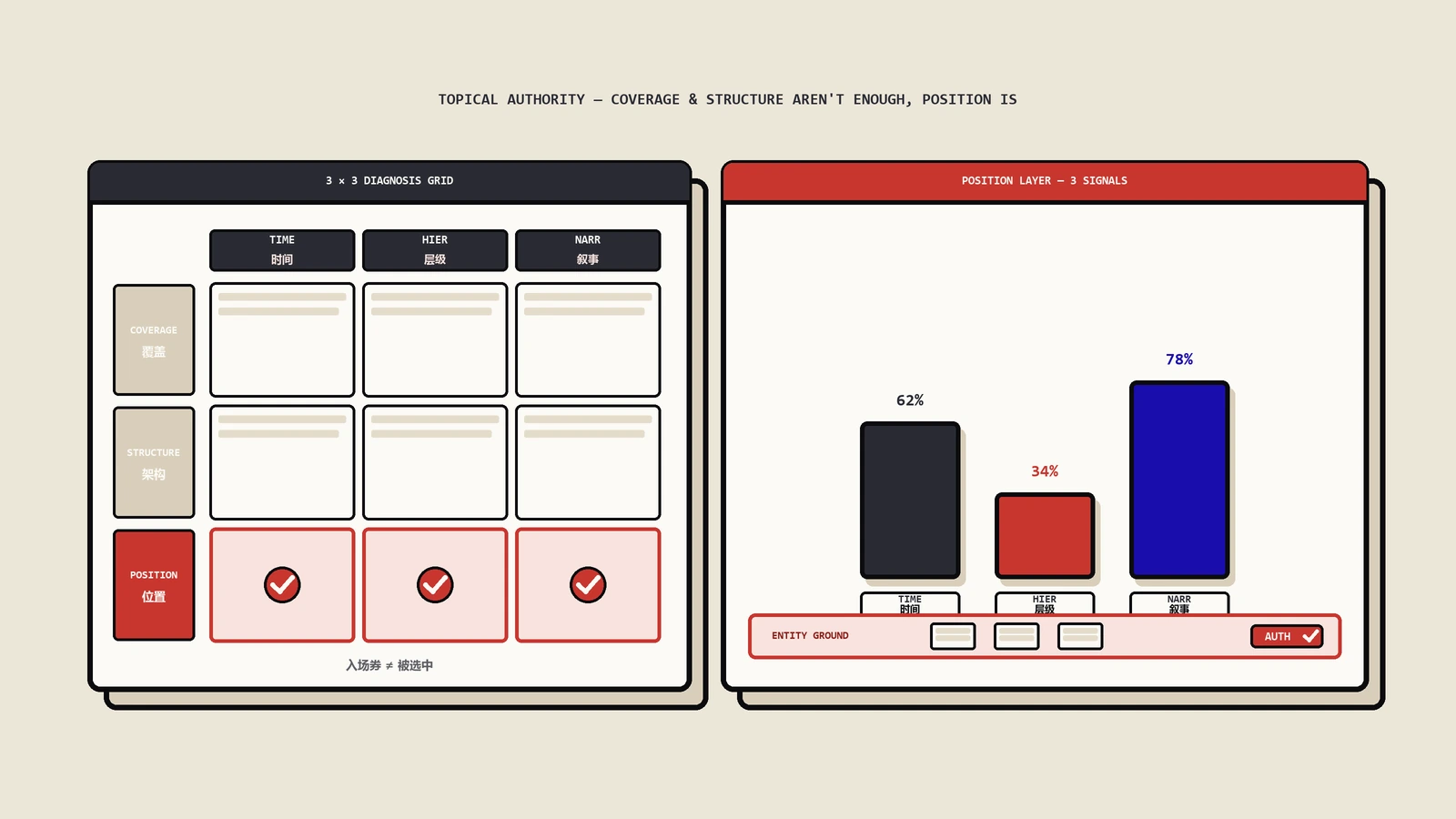

AI Mode 的普及对 SEO 行业的影响是范式级的。保哥总结几个最直接的变化。

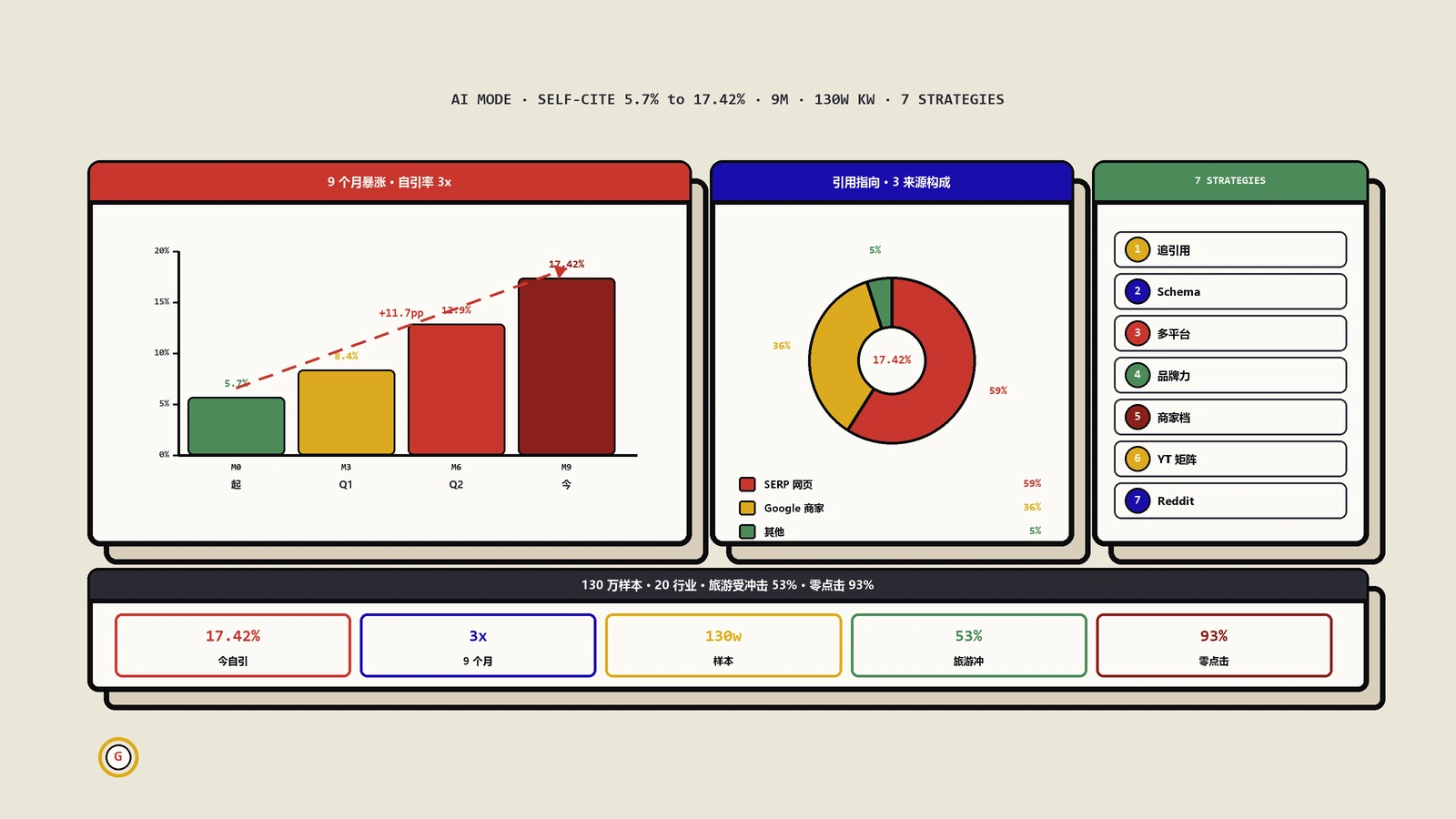

第一,点击率结构性下滑。AI Mode 中约 93% 的搜索以零点击告终,这一比例是 AI Overviews 的两倍多。如果你的核心查询触发 AI Mode 而你的内容没被引用,流量会显著下降。

第二,被引用比被点击更有价值。AI Mode 中的引用展示会显著提升品牌认知。即使没有产生点击,用户在 AI 答案里看到你的品牌名,也会建立心智占位。这种“曝光价值”在传统搜索时代很难量化,AI 时代会成为新的核心 KPI。

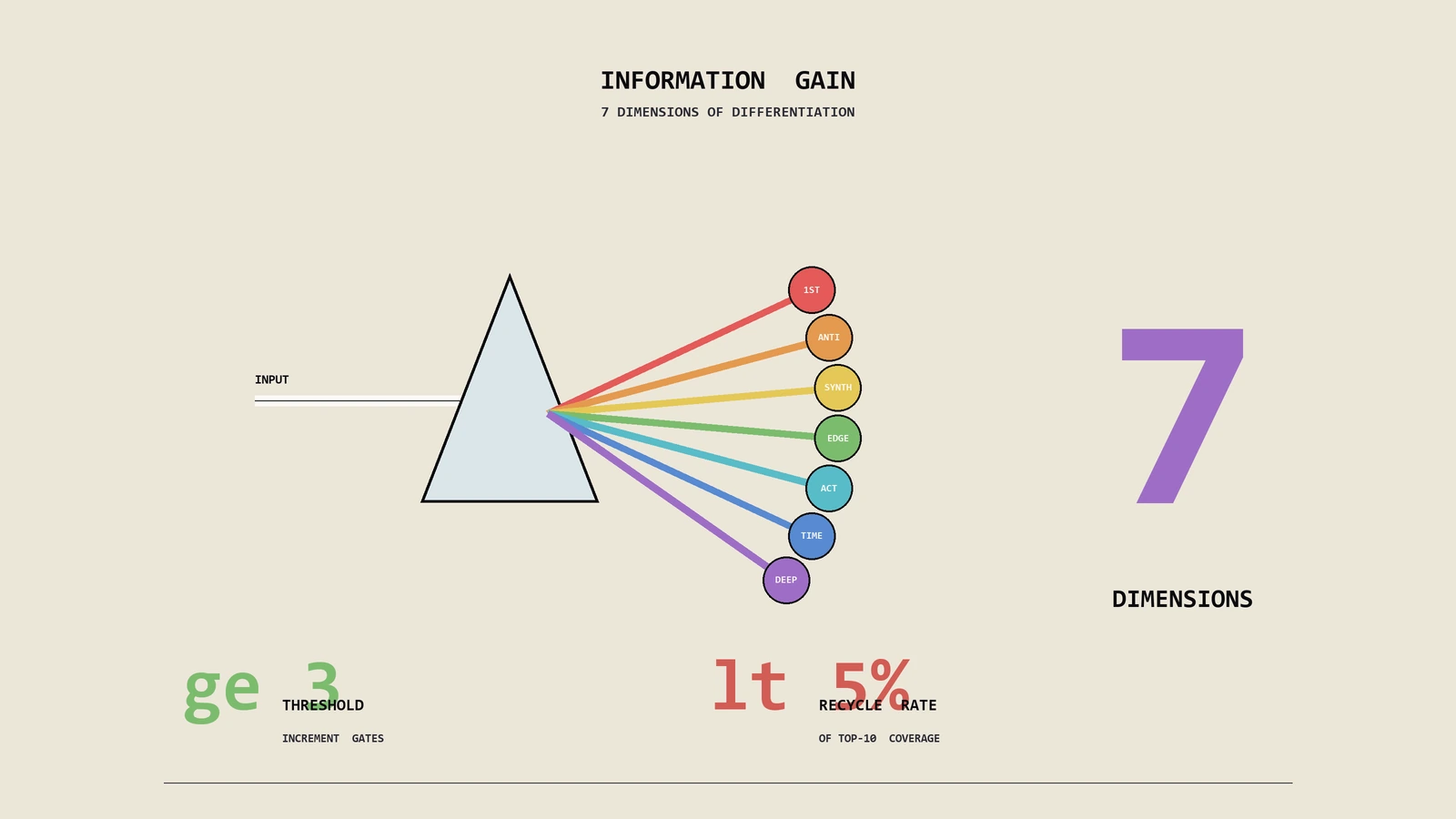

第三,主题集群比单篇长文更有 AI 引用价值。AI Mode 在选择信源时偏好“在某个主题上覆盖全面”的域名,孤立的高质量长文反而容易被忽略。建议围绕核心主题构建 20 到 50 篇关联内容的集群。

第四,多模态内容机会扩大。AI Mode 在回答时会主动调用图片、视频、表格作为视觉辅助。如果你的内容里有原创的高质量图片、清晰的表格、嵌入式视频,被选作视觉素材的概率高于纯文字内容。

第五,结构化数据从加分项变为入场券。FAQPage、HowTo、Article、VideoObject 这四种 Schema 对 AI Mode 引用的帮助最直接。保哥的建议:所有核心内容页面都加上 JSON-LD 结构化数据,这一步成本极低但回报显著。

保哥总结的 3E 使用框架

基于半年的大量使用经验,保哥总结了一个“3E 框架”来帮你更好利用 AI Mode。

第一个 E,Explore(探索)。通过连续追问深入挖掘话题。每次 AI 给出答案后,问一句“那如果是 X 场景呢”或者“反方观点是什么”,能挖出表面回答下面的纵深信息。这一步对内容创作者尤其重要——它能帮你快速生成话题大纲。

第二个 E,Engage(参与)。多用图文互动,获取更丰富信息。上传截图、照片、PDF 让 AI 综合理解。在内容研究、产品调研、技术故障排查场景下,多模态互动比纯文字提问效率高 2 到 3 倍。

第三个 E,Execute(执行)。用代理功能完成实际任务。预约、比价、整理、监测都可以通过 Agent Mode 自动化。这一步是 AI 真正改变工作流的部分,省下来的时间可以投入到更高价值的创造性工作。

这框架在保哥工作中验证过,能提效约 30% 到 40%。结构清晰又灵活,你可以根据自己的工作场景调整每个 E 的具体打法。

保哥的实战案例与避坑清单

作为 AI 老用户,保哥已经把 AI Mode 融入日常工作。几个典型案例。

案例一:内容研究。以前写一篇 SEO 深度文章要从 10 到 15 个不同网站拼凑信息,花大半天;现在用 AI Mode 连续追问 20 到 30 分钟,再补充 1 小时的原创分析就能成稿。

案例二:技术故障排查。最近一个客户的 MySQL 服务器突然卡死,传统流程是看日志、查官方文档、搜 Stack Overflow,大约 2 小时。我把日志截图喂给 AI Mode,它 5 分钟就定位到是连接池配置错误,整个故障从发现到修复只花了 25 分钟。

案例三:线上活动规划。规划一场 200 人参与的线上技术分享,AI Mode 一条龙搞定主题选择、嘉宾推荐、宣传文案、报名表设计建议、技术平台对比。原本要 2 个工作日的工作压缩到 4 小时。

但也踩过坑。最大的一次是 2025 年 11 月一个客户的财报数据查询,AI Mode 把 2024 年的数据误认成 2025 年的报给我,我没核对就用了,结果在客户会议上被指出错误。教训:涉及精确数字、最新政策、法律条款的信息,必须点引用核对原文,绝不能盲信 AI 答案。

实用小贴士

第一,设置检查。确保 Google App 或浏览器是最新版本;到 Labs 开启相关实验功能;中文界面需要在 Google 账户语言设置里加入简体中文。

第二,提问技巧。多用描述性语言,比如“用类比方式解释量子计算基础原理”比“什么是量子计算”能拿到更深入的答案;不够再追问;模糊提问最耗时。

第三,答案验证。养成点引用核对的习惯;切换到全结果模式对比看是否一致。信任 AI,但永远验证。

第四,多用图文。上传图片分析比纯文字描述效率高得多。图片要清楚,光线、角度、焦距都要把握好,识别率会显著提升。

第五,代理使用。任务描述要清楚细节(人数、时间、预算、偏好);第一次使用前先小范围授权;金钱相关的最后一步一定要人工确认。

避坑清单

地区限制:如果用不了,可以尝试 VPN(注意当地法律)或者用隐身模式访问。少数地区(包括中国大陆直连)暂时不支持。

隐私担心:AI Mode 默认会用匿名数据生成响应,但仍可在“设置 → 数据和隐私 → Web 和应用活动”里关闭历史记录。涉及隐私敏感问题时建议手动关闭历史记录。

敏感话题:涉及政治、医疗、金融建议、法律意见等争议内容,AI Mode 通常会退回到普通搜索结果,避免误导用户。这种情况下别强迫它给答案,老老实实自己看专业网站。

幻觉风险:AI 答案里偶尔出现编造的数据、人物、事件,特别是涉及小众话题或最近事件时。任何关键决策依据必须二次核实,不要把 AI 答案当作权威。

国内做出海SEO的人,怎么把AI Mode当GEO诊断仪用

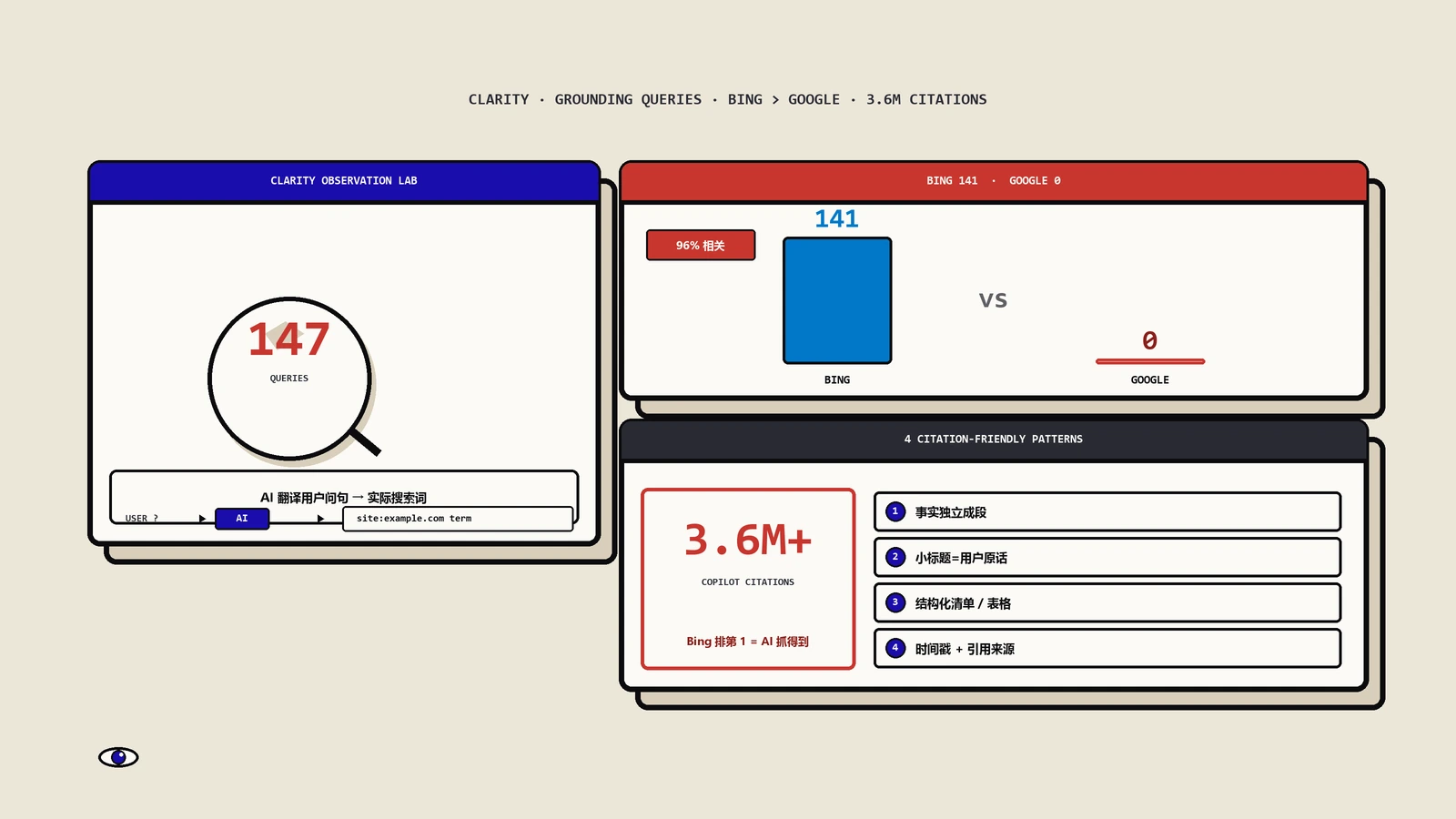

前面说了中国大陆直连用不了AI Mode,但保哥得补一句:做出海SEO的人,这工具非用不可。道理很简单,你的目标市场用户天天在用它搜东西,你不亲自跑一遍,根本不知道自己的内容在AI答案里是什么命运。换个用法,AI Mode对出海SEO人来说不只是搜索工具,更是一台现成的GEO诊断仪。

具体怎么用?通过合规的国际网络,挂一个美区Google账号,把AI Mode当成"竞品引用透视镜"来跑。拿你和主要竞品的核心查询轮着问,重点看四件事:AI Mode引用了哪些URL、你的站在不在名单里、如果在排第几、它引的是你哪一类内容。这几个信息一摆出来,你的GEO缺口基本就暴露了。

保哥习惯按三步走。第一步,列20到30个查询,商业意图和信息意图的都要有,覆盖用户从了解到决策的完整链路。第二步,在AI Mode里逐个跑,截图记录每个查询的引用源清单。第三步,对照自己的内容找缺口,缺口通常分三类:一类是压根没被引用,说明内容没覆盖到这个子查询;一类是被引用了但排在竞品后面,多半是E-E-A-T信号或Schema不够硬;还有一类是它引的全是论坛、竞品或第三方评测而不是你,这是信源池层面的缺失,得靠内容覆盖度和被引资产去补。

这里有个本土化的提醒。AI Mode诊断出来的GEO缺口,落到国内执行时不能照抄。它偏好的YouTube、Wikipedia这类信源,在国内得翻译成B站、百度百科、知乎;但"查询扇出加主题集群加可提取事实句"这套底层逻辑,中外是通的,照着补不会错。

保哥手上一个做工业配件出海的客户,就靠这招看清了问题。拿40个核心查询去AI Mode跑了一遍,结果自己一条都没被引用,竞品却条条都在。一拆原因就清楚了:他的内容全是产品参数堆砌,通篇没有一句"这是什么、该怎么选"的可提取定义句,AI想引都没东西可抽。后来补了一轮定义句加横向对比表,两个月后AI Mode就开始零星引用了。诊断仪的价值,就是让你别再凭感觉做GEO。

真实翻车:被"93%零点击"吓到,把内容全做成短摘要

上面提到AI Mode里约93%的搜索以零点击告终,这个数字一出来,保哥见过最离谱的一种反应是:既然没人点进来,那内容干脆做短,专门写成喂AI的摘要去博引用就行了。有个客户就是这么干的,把原来两三千字的深度文,一篇篇砍成500字的"AI友好摘要",通篇只剩结论句,论证、数据、案例全删了。

结果两头落空。AI引用不但没涨反而降了——AI Mode选信源时偏好的恰恰是"在某个主题上覆盖全面"的深度内容,500字的干巴摘要被判信息密度不够,连入选资格都够不上。同时传统流量也崩了,内容一薄,用户停留时间和转化跟着掉。最冤的是,那原本愿意点进来的7%高价值用户,进来一看没干货,扭头就走,把仅剩的这点转化也丢了。

根因还是对"零点击"三个字的误读。93%零点击说的是"用户在AI答案里就把问题解决了",它描述的是用户行为,不是在教你把内容做短。恰恰相反,AI要能引用你,前提是你的内容足够深、主题覆盖足够全、还得有别人没有的独家事实句可供抽取。把内容砍成摘要,等于亲手把自己被引用的资格给削没了。

救援思路是把砍掉的深度补回来,但结构得调。保哥让客户改成双层写法:把核心结论、关键数据、定义句前置到段落开头,做成AI能直接抽走的形态;深度论证和真实案例放在后面,留给那7%点进来的人。这样前置摘要喂饱了AI,后置深度又留住了人,两头都不耽误。调整后熬了一个多月,AI引用和传统停留时间一起回升。

保哥想留的教训是:AI时代的内容是"前置可提取加后置有深度"的双层结构,不是一刀切成摘要。零点击逼你做的事,是把答案写得更清楚、更好抽取,绝不是逼你把内容写薄。把这两件事搞混,就会像那个客户一样,为了讨好AI反而两头都丢了。

常见问题解答

AI Mode 收费吗?哪些功能要订阅

核心功能(对话搜索、信息整合、多模态分析)完全免费,所有 Google 账号用户都可以使用。高级代理功能(Agent Mode 的完整版本、Project Mariner 的进阶任务)需要 Google AI Ultra 订阅,目前定价每月 19.99 美元。具体功能列表可以去 one.google.com 查看。保哥订了一年觉得值,但日常使用免费版也完全够。

AI Mode 准不准?答案能不能信

事实类问题挺准,因为有 RAG(检索增强生成)技术支撑实时抓取最新信息。用户满意度调研显示 78% 的回答被评为“有帮助且准确”。但仍有“胡编”的可能性(俗称幻觉),特别是涉及精确数字、最新事件、小众话题时。建议关键信息一定点引用核对原文,不要盲目相信。保哥踩过坑被客户指出错误后,养成了核对引用的习惯。

AI Mode 和 ChatGPT 有什么区别

最大区别是 AI Mode 实时整合搜索引擎结果,每个事实都带引用来源;ChatGPT 默认依赖训练数据,信息可能过时且不带引用。AI Mode 更适合查最新信息、做事实核查;ChatGPT 更适合创意写作、长文生成、代码编写。保哥两个工具同时用:查信息用 AI Mode,写内容用 ChatGPT 或 Claude,互补效率最高。

手机端和电脑端用哪个体验更好

两端都流畅,没有明显差异。手机端的优势是看图说话方便,外出查询时直接拍照上传比电脑端方便很多。电脑端的优势是连续追问时屏幕大、能开多窗口对比。保哥的习惯是外出用手机、工作时用电脑、写文章时同时开两端互相印证。

AI Mode 会取代传统搜索吗

短期内不会完全取代,但会改变流量分配格局。预计到 2027 年传统搜索结果仍会占据 60% 到 70% 的搜索流量,AI Mode 会占据 30% 到 40%。两种模式会长期共存,因为信息查询场景多样:导航类、品牌类、本地服务类查询更适合传统搜索;信息聚合类、复杂决策类、研究类查询更适合 AI Mode。

AI Mode 在中国大陆能用吗

直连不能用(中国大陆无法访问 Google.com)。通过合规的国际网络访问可以使用,但需要遵守当地法律法规。如果你在国内做跨境业务、海外 SEO,AI Mode 是必不可少的工具,建议通过合规渠道使用。如果你只服务国内市场,可以用百度的“AI 搜索”或者通义千问的搜索功能作为替代,体验上比 AI Mode 略差但能用。

AI Mode 未来还会加什么功能

谷歌的路线图显示 2026 年的重点是:更多语言支持(特别是阿拉伯语、希伯来语、泰语等右到左和东南亚语言)、与 Chrome 浏览器更深度集成(直接从地址栏触发 Agent Mode)、与 Android 系统级整合、视频实时分析能力增强。保哥的预测是 2026 年下半年 Agent Mode 会全面对免费用户开放,决策类代理任务会成为下一个差异化战场。

SEO 从业者应该怎么应对 AI Mode 的影响

四个核心动作:第一,把 AI 引用率纳入核心 KPI 监测,每月手动测试 30 到 50 个核心关键词在 AI Mode 中的引用情况。第二,所有核心内容页面加 FAQPage、HowTo、Article 等 JSON-LD 结构化数据。第三,把孤立长文改造成主题集群,围绕核心主题构建 20 到 50 篇关联内容。第四,在内容里强化作者署名、第一手数据、原始研究引用等显性 E-E-A-T 信号。这四个动作组合起来能显著提升被 AI Mode 引用的概率。

权威参考资料

FAQPage + Article AI 引用友好版

Google AI Mode于2025年10月全球免费开放并新增中文支持。保哥半年深度实测后总结从2025年3月Labs内测到全球开放的完整时间线、Gemini 2.5多模态推理实测、Agent Mode代理功能踩坑指南,并给出可直接复用的3E使用框架与SEO从业者应对策略。

- Google AI Mode

- Gemini

- GEO优化

- AI搜索

- Agent Mode

- GEO/AEO

- 多AI引擎实战

title: Google AI Mode免费开放实战:3E框架使用指南 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/google-ai-mode-now-free-for-all.html published: 2025-11-12 modified: 2026-05-16 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《Google AI Mode免费开放实战:3E框架使用指南》

本文链接:https://zhangwenbao.com/google-ai-mode-now-free-for-all.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0