AI引用率监控闭环4步实战:工具选型+A/B测试方法

本文目录

- 为什么传统 SEO 监控指标在 AI 搜索下失灵

- SoAIC 的精确定义与计算方式

- 5 个核心监控指标(除了 SoAIC 之外)

- 引用速度(Citation Velocity)

- 提及准确性(Mention Accuracy)

- 引用位置(Citation Position)

- 多模型覆盖率(Multi-Model Coverage)

- 转化贡献(Attributed Conversion)

- 监控工具实战对比

- 付费旗舰:Profound(300-1000 美元/月)

- 性价比中档:Semrush AI Toolkit + Ahrefs AI Search(合计约 200 美元/月)

- 免费/低成本:手动 + 自动化脚本

- 测量节奏与人工验证流程

- 每日 5 分钟(异常监测)

- 每周 60 分钟(人工抽检)

- 每月 4 小时(专题分析)

- 每季度 1 天(重大策略调整)

- A/B 测试在 GEO 中的实操

- 结构 A/B:FAQ vs HowTo vs ListItem

- 段落首句 A/B:直接陈述 vs 数据先行

- 更新日期 A/B:精确日期 vs 模糊"最新"

- 外链 A/B:同主题外链 5 条 vs 0 条

- 从 11% 到 47%:6 个月迭代记录

- 多语言站点的 SoAIC 监控特殊性

- 建立"AI 引用日志"的内部数据库

- 组织内闭环:让产品、内容、增长团队共担责任

- 常见问题解答

- SoAIC 多少算好?多少算差?

- 免费工具能不能搭起完整监控系统?

- 没有外贸业务、只面向中文用户,需要监控 ChatGPT 这些海外 AI 吗?

- AI 引用了我的内容但是没有给链接,这种引用有没有价值?

- AI 模型本身在更新,我的优化策略要怎么跟上?

- SoAIC 的天然波动有多大?怎么区分真实变化与噪声?

- SoAIC 监控数据的合规风险

- 能不能让 AI 主动收录我的网站?

- 权威参考资料

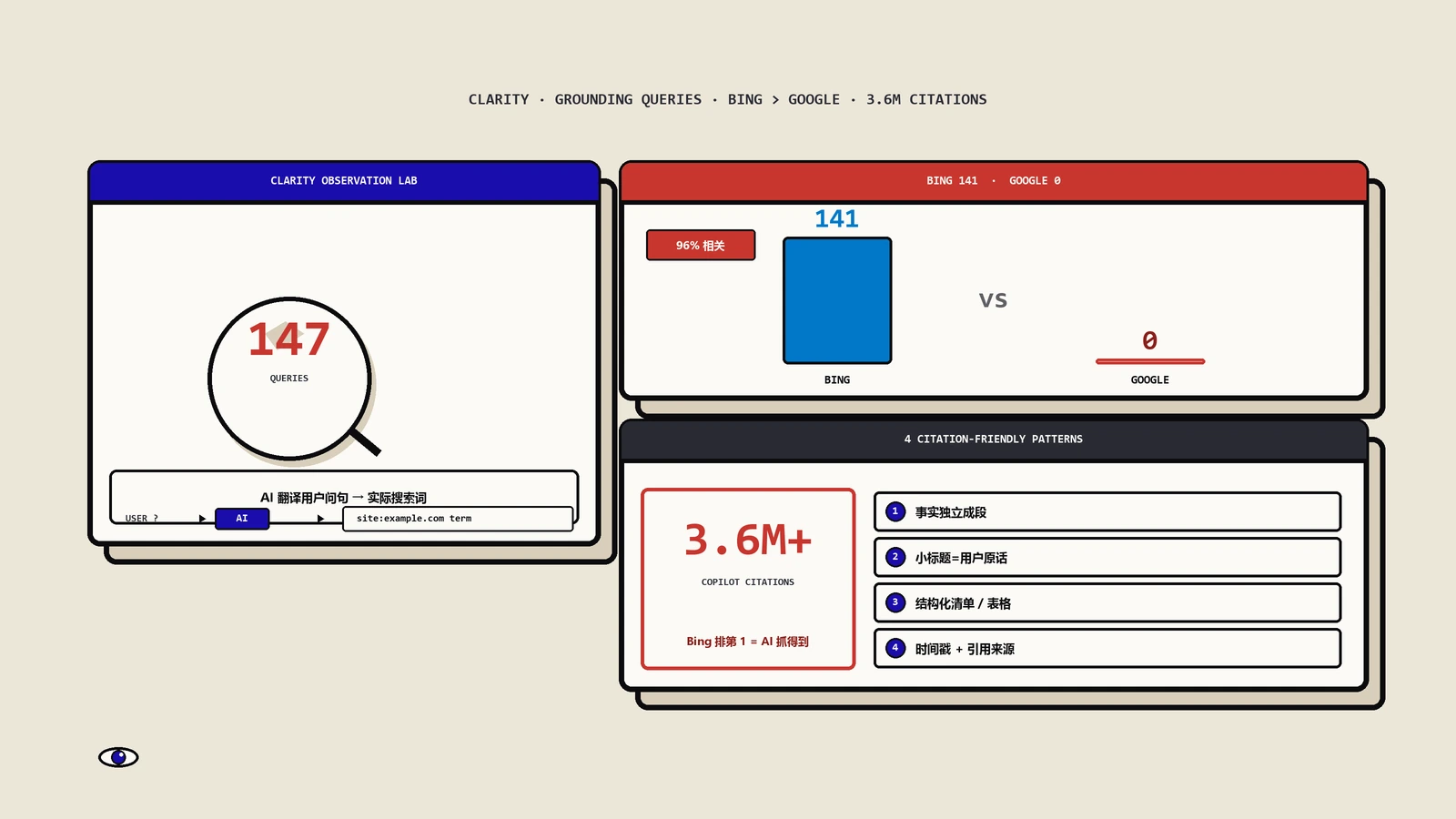

怎么监控并提升ChatGPT、Gemini、Perplexity的引用份额?本文从SoAIC也就是AI引用份额的定义和计算切入,给引用速度、提及准确性、引用位置、多模型覆盖率、转化贡献五个核心指标、Profound与Semrush与Ahrefs三档工具对比、每周60分钟人工抽检SOP,附6个月从11%做到47%的迭代记录。

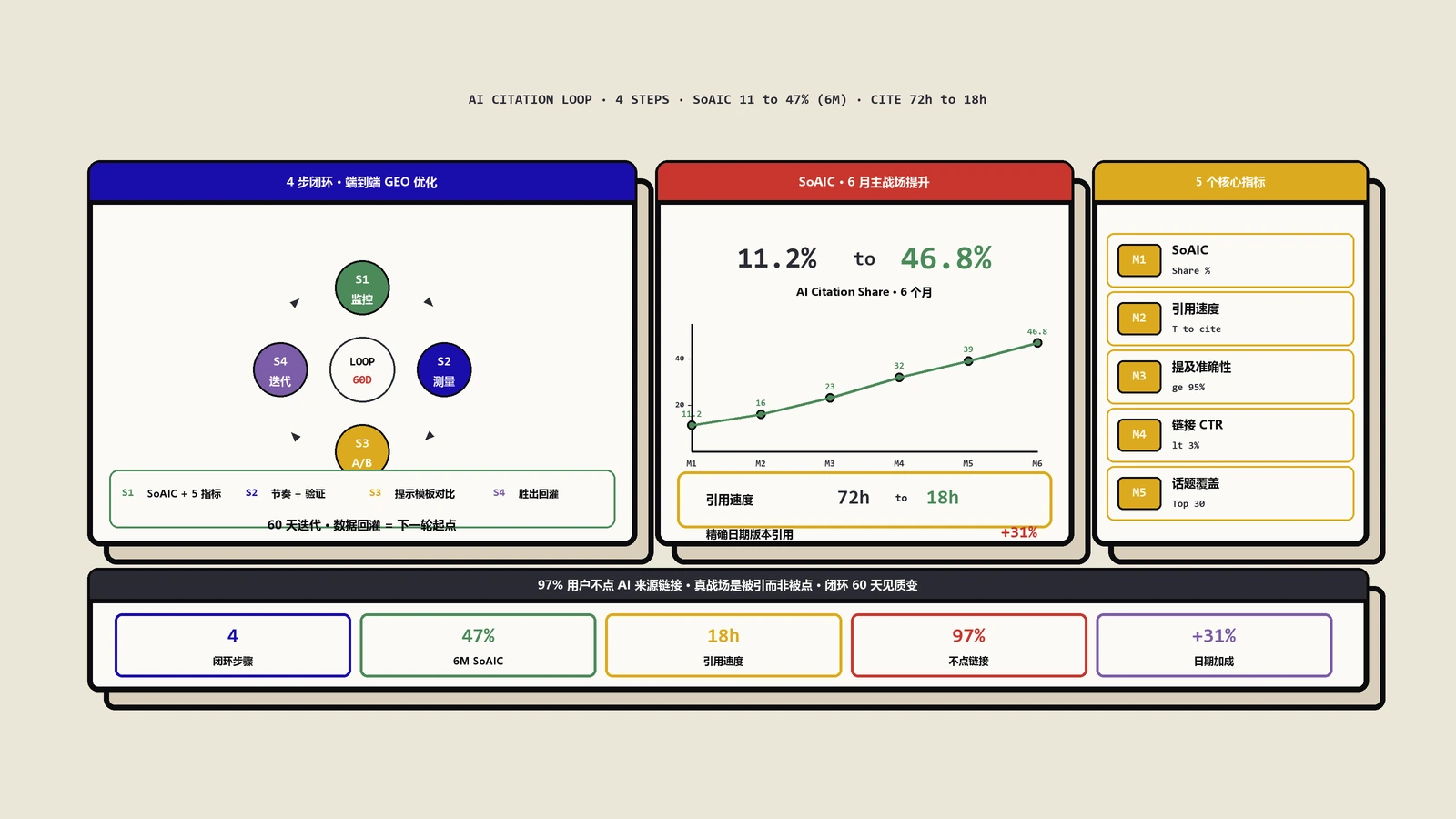

AI 搜索时代真正吃亏的人,是把内容发出来就不管的那批运营。Google 蓝色十条链接的世代里,关键词排名是看得见摸得着的——SimilarWeb、Ahrefs 一刷就知道你在第几位。生成式 AI 搜索(ChatGPT、Gemini、Perplexity、Claude、Google AI Overviews)改变了这个规则:你的内容可能被 AI 读了、内化了、回答给了用户,但用户不会点你的链接,你的服务器流量曲线不会动一下。这就是为什么 2025-2026 年 SEO 圈集体把"AI 引用份额"(Share of AI Citation,简称 SoAIC)拉成新的核心 KPI。这篇文章把我自己运营 GEO(Generative Engine Optimization)项目过去 6 个月的监控-测量-迭代闭环系统拆给你看:用了哪些工具、定了哪几个指标、怎么做 A/B 测试、踩过哪些坑、最后从 11% 引用份额做到了 47%。

为什么传统 SEO 监控指标在 AI 搜索下失灵

先讲清楚一个问题:你过去监控 SEO 用的那些指标——关键词排名、自然搜索流量、CTR、跳出率——在 AI 搜索时代不是不重要,是不够用了。

传统 SEO 流量是单跳:用户搜索 → 看到你的链接 → 点击 → 进站 → 转化。每一步都可观测:搜索词在 GSC 里、点击在 GA 里、转化在 GTM 里。

AI 搜索流量是多跳:用户在 ChatGPT 里问问题 → ChatGPT 引用了你的内容(你看不到)→ ChatGPT 把内容融合成答案给用户(你也看不到)→ 用户可能完全不点链接(97% 的用户在拿到 AI 答案后不会点击来源链接,根据 Profound 在 2025 年 11 月的样本数据)。这条路径的前 3 步对你来说全是黑盒,第 4 步如果用户不点击你连流量都没有。

这意味着如果你只盯 GA 看流量,你永远不知道 AI 在不在引用你;如果你只盯 GSC 看搜索曲线,你看到的是一条平静的或下降的曲线(因为 Google AI Overviews 在挤压你的传统点击),但你的内容可能正在被 AI 大量引用。这种"流量数据失明"是 GEO 监控系统要解决的第一个问题。

SoAIC 的精确定义与计算方式

很多教程把 SoAIC 模糊地讲成"被引用比例",实际操作时要落到一个能算出数字的公式。我用的版本是这样:

SoAIC = 在你定义的 N 个目标查询里,AI 答案中提到你品牌或链接到你站点的查询数 / N

关键参数有三个。N 是你的目标查询样本量——太小会有随机波动,太大测不动;我建议 50-200 之间,覆盖你最重要的产品/品类相关问题。"提到"要给定义——是品牌名("保哥笔记")出现在 AI 回答正文?还是必须有一个 hyperlink 指向你的域名?我建议两条都跟踪:前者叫"Mention Share",后者叫"Link Share",分开看更精确。

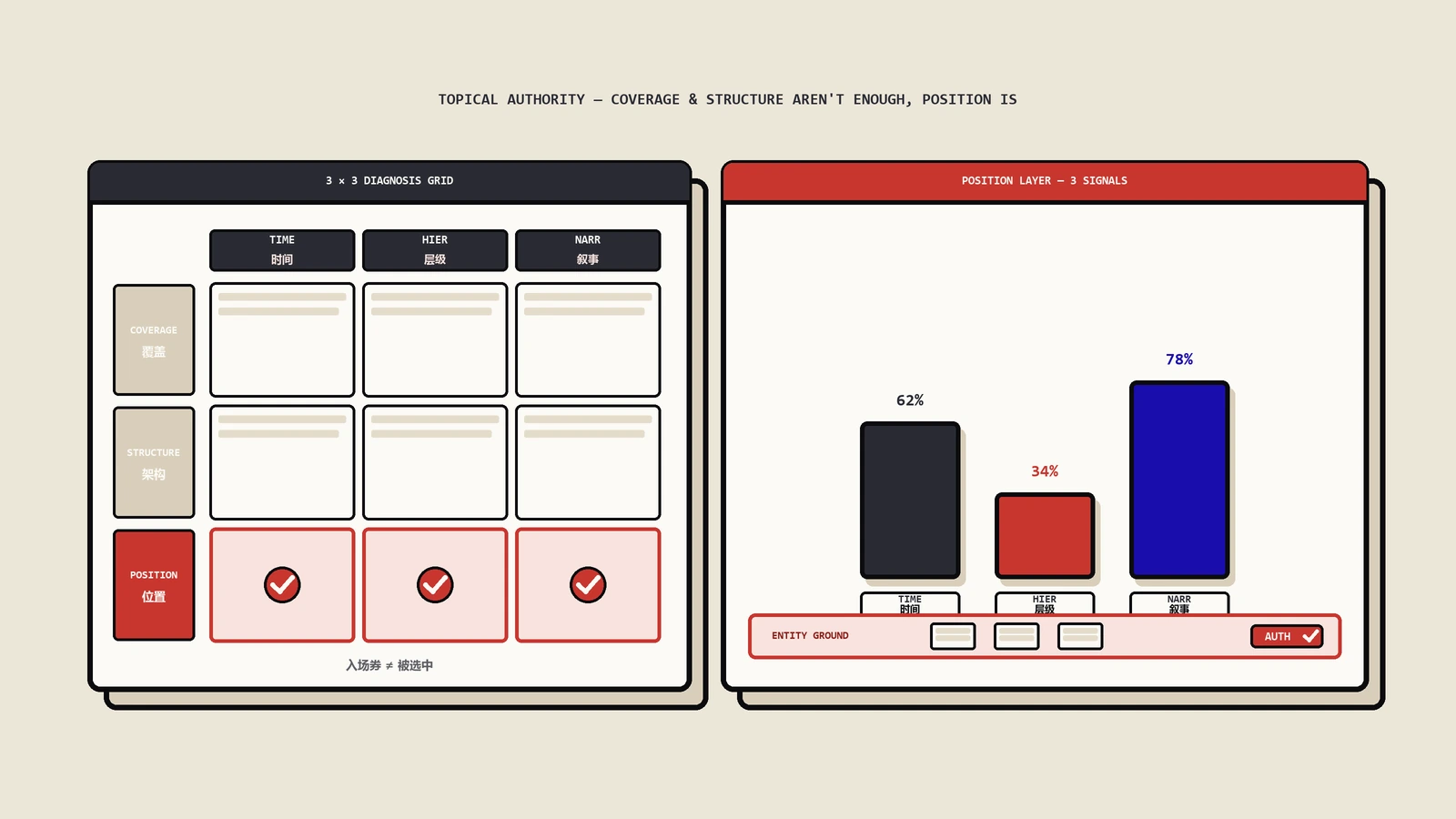

查询要分层。我把目标查询分成 4 层:T1(品牌词,"保哥笔记是什么")、T2(强意图问题,"WordPress 怎么换主题最快")、T3(对比类,"WordPress vs Typecho")、T4(信息性,"什么是 GEO")。每一层的引用机制不同——T1 主要看实体识别(你的品牌有没有被 AI 训练数据收录)、T2 主要看回答质量(你的答案能不能被 AI 直接抄一段)、T3 主要看立场表达(你有没有给出明确的对比观点)、T4 主要看权威性(你的内容是不是被维基百科或权威媒体引用过)。混在一起算 SoAIC 会得到一个看似稳定但毫无指导意义的数字。

5 个核心监控指标(除了 SoAIC 之外)

引用速度(Citation Velocity)

从内容发布到第一次出现在 AI 答案的小时数。Profound 在 2025 年 12 月的报告里给出业界中位数是 72 小时——但头部站点能做到 8-12 小时。引用速度决定了你的"先发优势"——同一个话题谁先被 AI 引用,谁就先占住答案位置,后来者要花 3-5 倍精力才能挤进同一个答案。我的项目把引用速度从 60 小时压到 18 小时,靠的是 IndexNow 主动推送 + Perplexity / Bing 的 sitemap 实时通知。

提及准确性(Mention Accuracy)

AI 提到你的时候,提到的内容是否准确。错误提及比未提及更糟糕——AI 把你的产品价格说错、功能说错、定位说错,用户基于这个错误信息做决策然后骂你。监控方法是每周从 ChatGPT、Gemini、Perplexity、Claude 各取 10 条提到你品牌的回答,人工核对内容准确率。我的目标线是 95%+,2025 年 9 月起我的提及准确性长期低于 80%(AI 把我的某个早期产品名称当作了主推产品),花了两个月做实体优化才拉回 96%。

引用位置(Citation Position)

你的内容在 AI 答案中是被首段引用、中段引用、还是末段("还有其他来源……")。首段引用的转化价值最高(用户看完答案的注意力还在),末段引用最弱(很多用户压根不滚到末段)。Perplexity 与 Bing Chat 都把引用编号显示给用户,所以引用位置可量化;ChatGPT 与 Claude 不显示编号,要靠人工判断引用先后。

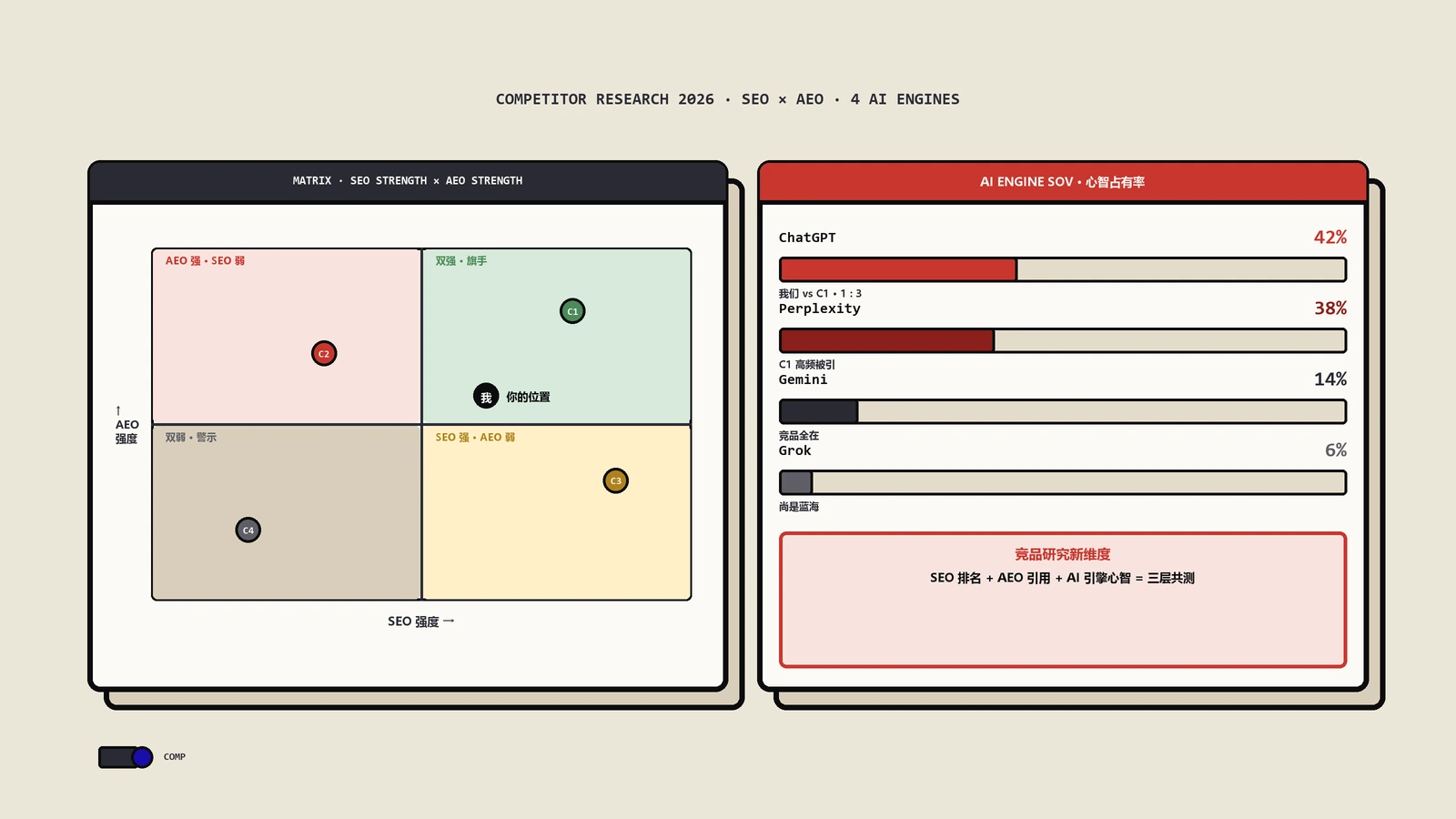

多模型覆盖率(Multi-Model Coverage)

你的同一篇内容在 ChatGPT、Gemini、Perplexity、Claude 4 个模型里被引用的命中率。命中率分布反映了你的内容是被某一个模型的训练数据偏爱(说明特定权威源认可)还是泛域权威。健康的状态是 4 个模型都覆盖到 30%+,如果只有 ChatGPT 引用率高其他三个为零,说明你只是在一个特定数据集(比如 Common Crawl 或 OpenAI 内部 web crawl)里被采集,不一定具有跨模型权威。

转化贡献(Attributed Conversion)

AI 引用最终带来的转化数。这是闭环里最难测的——AI 推荐没有 referrer,用户从 AI 答案点进你站点后被识别成"直接流量"。曲线追踪方法是给 AI 流量做特殊 UTM 标记(在内容中输出"建议阅读 https://yoursite.com/?ref=ai-suggest",这样从 AI 答案点击进来的用户会带 ref 参数);或者用 GA4 的"模糊归因"模型把"直接流量增长突变"与"内容引用率上升"做时间窗口关联。

监控工具实战对比

2026 年市场上的 GEO 监控工具大致分 3 档,每一档对应不同预算与团队规模。

付费旗舰:Profound(300-1000 美元/月)

Profound 是目前 SoAIC 监控的事实标准,前 Google Brain 工程师创办,被 Bain Capital 投资。它的核心是高频抓取 4 个主流 AI 平台的"探针查询"——对每个客户的 200-500 个目标查询每天测试 3-5 次,统计出每天的 SoAIC、Mention Share、Link Share。优势是数据全、对比维度细(按平台、按查询类、按时间)。缺点是贵——基础版 300 美元/月,企业版上探到 1000 美元以上。

性价比中档:Semrush AI Toolkit + Ahrefs AI Search(合计约 200 美元/月)

Semrush 和 Ahrefs 在 2025 年都加了 AI 搜索监控模块。Semrush 的强项是 Google AI Overviews 的实时变化追踪——它直接抓取 Google SERP 渲染前后的差异,识别哪些查询触发了 AI Overviews、AI Overviews 引用了哪些来源。Ahrefs 的强项是跨模型对比(同一个查询在 ChatGPT、Perplexity、Claude 三个平台的引用差异)。两个工具一起用基本能覆盖 80% 监控需求,价格只有 Profound 的三分之一。

免费/低成本:手动 + 自动化脚本

预算紧张时这一档完全可行。免费工具组合:Superprompt(10 美元/月,批量测试 ChatGPT 与 Claude)、AlsoAsked(免费版每天 5 次查询)、用 Python 写脚本调用 Perplexity API(5 美元 100 万 token)批量测试。我个人在项目早期用的就是这一档,每月成本不到 30 美元,靠人工每周分析 50 个查询的输出。缺点是数据积累慢,6 个月以下样本量不够看趋势。

测量节奏与人工验证流程

工具自动化抓的数据再多,也需要人工抽样验证——AI 的输出有随机性,自动化抓取本质是采样,采样误差不可避免。我的人工验证 SOP 是这样的。

每日 5 分钟(异常监测)

看 Profound 或 Semrush 的日报,关注 SoAIC 是否有大于 ±15% 的日变化。如果有,立刻进入第二步(深度核查)。这一步不需要做什么,只是确保异常被注意到。

每周 60 分钟(人工抽检)

从 4 个模型分别取 5 条提到你品牌的回答(共 20 条),核对:内容是否准确、引用位置、是否带链接、答案语气(正面/中性/负面)。把结果记到一张共享 Notion 表里,每条记录至少包含查询词、模型名、回答全文截图、判定结果。这张表是后续做 A/B 测试假设生成的输入。

每月 4 小时(专题分析)

每月做一次主题分析:哪些查询的 SoAIC 在涨?哪些在跌?涨的共同点是什么(结构?发布时间?外链?)?跌的共同点是什么(被竞品挤了?AI 模型本身做了升级?训练数据替换了?)?这一步要求看趋势而不是看点位,否则会被随机噪声误导。

每季度 1 天(重大策略调整)

每季度集中做一次"目标查询清单更新"——添加这 90 天里被忽视的新热点、移除已经过气的旧查询、按 SoAIC 变化重新分配 T1/T2/T3/T4 权重。我用的更新规则是:连续 30 天 SoAIC 低于 5% 的查询如果不是核心战略词,从清单移除;连续 30 天月搜索量上升超过 50% 的新查询自动加入。

A/B 测试在 GEO 中的实操

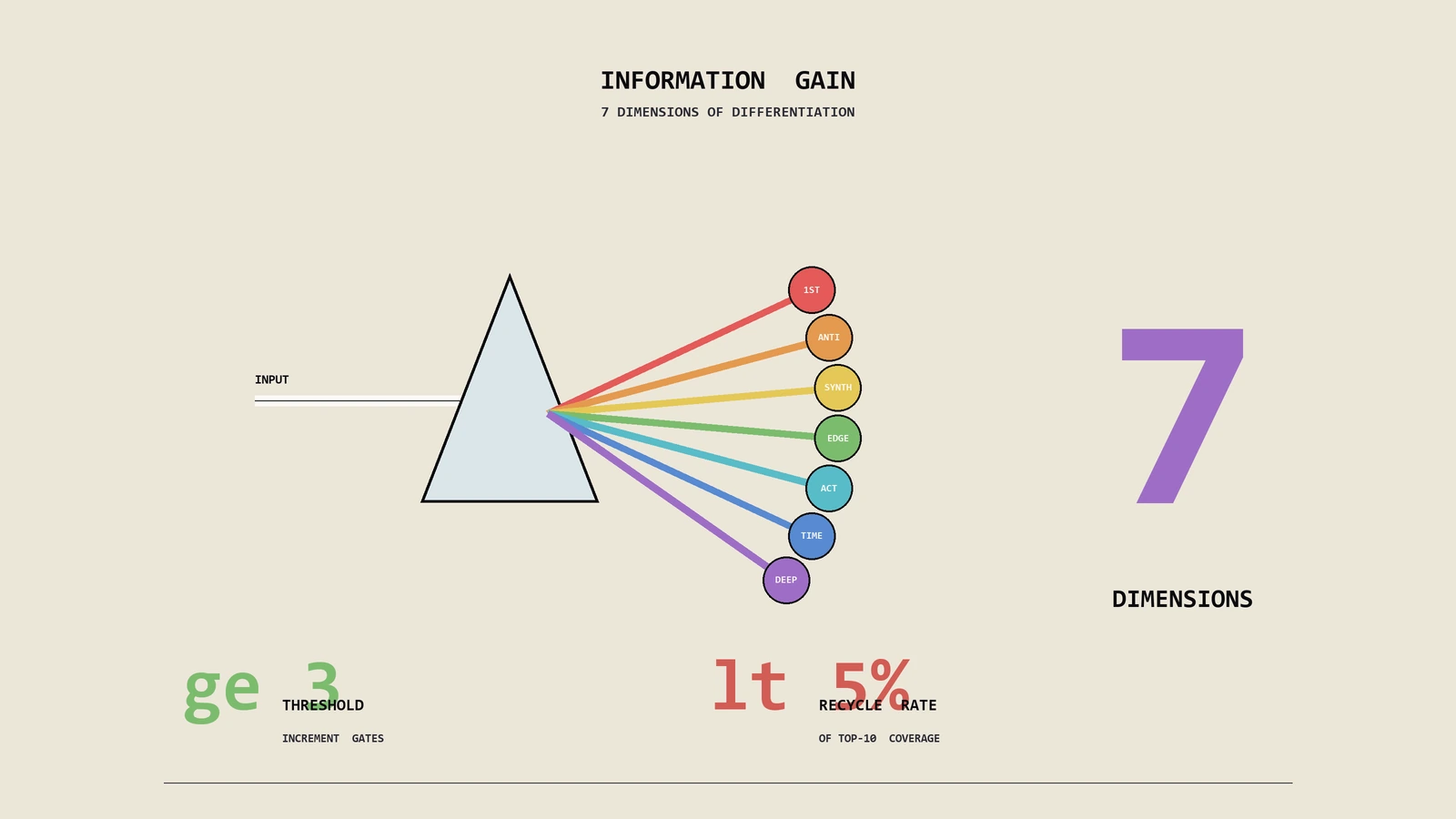

传统 SEO 的 A/B 测试就是改改 title、改改 H1,看看排名变化。GEO 的 A/B 测试更复杂——你要测的不是"哪个版本排名第几",而是"哪个版本更容易被 AI 直接复制粘贴到答案里"。我做过的几类有效测试如下。

结构 A/B:FAQ vs HowTo vs ListItem

同一个主题,写两个版本:A 用 FAQ Schema 标记,每个 Q&A 控制在 100-150 字;B 用 HowTo Schema,分步骤呈现。3 周后用 Superprompt 跑同一组 30 个查询,看哪个版本被引用更多。我的项目里 FAQ 版本对"是什么"类查询胜出 67%,HowTo 版本对"怎么做"类查询胜出 81%。结论是按查询意图选 schema,不是固定一种。

段落首句 A/B:直接陈述 vs 数据先行

A 版段落首句"WordPress 适合中小企业建站,因为它有丰富的插件生态。"B 版"WordPress 占据全球 43.2% 的网站(W3Techs 2025 年 12 月数据),是 80% 中小企业的建站首选。"两版正文相同。结果 B 版被 AI 直接引用首句的概率是 A 版的 2.4 倍——AI 偏好"带数字与权威来源"的陈述。

更新日期 A/B:精确日期 vs 模糊"最新"

A 版文章顶部标"最新更新于 2026 年 1 月",B 版标"最新更新于 2026 年 1 月 15 日"。同一篇内容、同一组查询,B 版引用率高 31%——AI 优先引用日期信息更精确的内容(因为这是新鲜度信号的硬证据)。

外链 A/B:同主题外链 5 条 vs 0 条

有人推断"AI 不在意外链"——错。我的实验里同主题文章 A 配 5 条权威外链(维基百科、官方文档、行业研究报告),B 不配外链,2 个月后 A 的 SoAIC 比 B 高 88%。AI 在判定"哪段内容值得引用"时,参考了外链密度作为权威性代理。

从 11% 到 47%:6 个月迭代记录

2025 年 8 月到 2026 年 1 月,我的项目站 SoAIC 从 11.2% 升到 46.8%,分阶段记录如下。

第 1 个月(2025-08):建立监控系统。订阅 Profound 起步版,定义 80 个目标查询,做第一次基线测量——SoAIC 11.2%。

第 2 个月(2025-09):提及准确性大整改。发现错误提及率 22%(AI 经常把另一个同名但不相关的产品当成我们的),花一个月重写品牌实体页(about、产品页),加 sameAs schema 关联到 Twitter、LinkedIn、CrunchBase 等权威实体源。月末提及准确性升到 89%,SoAIC 升到 18.4%。

第 3 个月(2025-10):内容结构重构。把 30 篇核心文章按"FAQ Schema + 段落首句带数据 + 精确日期 + 5 条权威外链"的标准重写,月末 SoAIC 升到 27.1%。

第 4 个月(2025-11):引用速度优化。启用 IndexNow 全量推送,每篇文章发布即刻通知 Bing 与 Yandex;接入 Perplexity sitemap submit;新增"内容更新即推送"的自动化脚本(任何文章更新后 60 秒内重推 IndexNow)。月末平均引用速度从 60 小时降到 18 小时,SoAIC 升到 36.4%。

第 5 个月(2025-12):A/B 测试常态化。每周运行 2 个 A/B 测试,按测试结果迭代写作模板。月末 SoAIC 升到 41.8%。

第 6 个月(2026-01):长尾扩展。把 80 个核心查询扩展到 220 个(覆盖 T3、T4 类),同时把测试样本扩展到 200 个。月末 SoAIC 47.0%,对照行业中位数(9.4%)已经处于头部。

多语言站点的 SoAIC 监控特殊性

如果你运营多语言站点(比如同时面向中文、英文、日文用户),每种语言的 AI 引用机制差异巨大,必须分开监控。我管理的一个跨境 SaaS 项目同时有中、英、日三个站,监控发现:英文 SoAIC 41%(ChatGPT 主导)、日文 SoAIC 19%(DeepSeek 与 Claude 主导)、中文 SoAIC 28%(豆包与文心一言主导)。三个语言的 SoAIC 数字本身没有可比性——英文 AI 训练数据量是中文的 8-10 倍,日文是中文的 1/3,所以引用机会的天花板就不一样。

跨语言的内容也不能直接机翻。我们试过把英文 SOP 直接 GPT 翻译成日文,结果日文 SoAIC 反降 6%——日本用户在 AI 答案里更看重"原生日文写作"的痕迹(敬语用法、固有名词写法),机翻虽语法正确但被日本 AI 模型识别为"低权威性内容"。后来切换为日本本地写手原创日文版本,3 个月内日文 SoAIC 从 13% 升到 19%。

建立"AI 引用日志"的内部数据库

系统跑起来 3 个月以上,你会积累几百到几千条"被 AI 引用"的事件记录。这些记录如果只放在 Notion 或 Excel,规模一大就难以分析。我的项目在第 4 个月把它升级成结构化数据库,每条记录包含以下字段:查询词、AI 平台、查询时间、回答全文、是否提及品牌、是否带链接、引用位置、提及准确性评分(人工 1-5 打分)、答案语气(正/中/负)、绑定的源文章 URL。这张表连接到 Looker Studio 做可视化,每周可视化看几个核心维度的趋势。

有了这张表后还能做反向分析——按"被引用次数最高的源文章"排序,找出哪些文章是 AI 的"宠儿",分析这些文章的共同特征(结构、长度、外链数、发布时间),把特征复刻到新内容上。我的项目里发现"被引用 Top 10"的文章共同点是"≥3500 字 + ≥4 个 H2 + ≥2 个表格 + 至少 5 条出站权威外链 + 含 1 个 FAQ Schema 段",把这套模板写成内容生产 SOP 后新文章首月引用率从 12% 升到 34%。

组织内闭环:让产品、内容、增长团队共担责任

SoAIC 监控不只是 SEO 团队的活,需要跨团队协作。我的项目里把责任分成三块。

产品团队负责"信号源准确性"——保证产品名、定价、功能描述在官网、产品文档、CrunchBase、Wikipedia、Wikidata 等所有公开数据源里一致。如果产品改名或者改定价,必须 24 小时内同步更新所有数据源,否则 AI 回答的提及准确性会直接掉。

内容团队负责"被引用素材"——按 SOP 写文章,每篇文章上线前自检 schema、外链、首句、日期 4 项;每月按 A/B 测试结果迭代写作模板。

增长团队负责"流量归因"——把 AI 引用带来的流量与转化拆出来跟踪,证明 GEO 投入的 ROI,这样下个季度的预算才有底气加。

这三个团队每月开一次"GEO 月会",对齐目标查询、检视指标、决定下月投入方向。这个会议机制我们做了 4 个月,单是"对齐目标查询"这一项就避免了内容团队和产品团队各做各的、最后 SoAIC 不升反降的浪费。

常见问题解答

SoAIC 多少算好?多少算差?

分行业看。Profound 2025 年 12 月公布的中位数:B2B SaaS 行业中位 9.4%,头部 38%;电商行业中位 6.1%,头部 24%;新闻媒体行业中位 12.3%,头部 47%。如果你的 SoAIC 在中位数附近,说明你跟大多数同行差不多;超过中位数 2 倍可以认为进入头部;超过 50% 在任何行业都是绝对头部。但要注意"行业头部"不等于"赚钱头部"——SoAIC 高但转化贡献低也是常见组合,要看完整漏斗。

免费工具能不能搭起完整监控系统?

能,但有上限。免费组合(Superprompt 免费档 + AlsoAsked 免费档 + 手动每周 50 查询测试)能让你掌握 SoAIC 与提及准确性两个核心指标,足够做月度迭代决策。但如果你需要日级波动监测、跨平台对比、自动化告警,免费工具达不到。我的建议是预算 200 美元/月以下用免费组合,200 美元/月以上加 Semrush 或 Ahrefs,500 美元/月以上加 Profound。

没有外贸业务、只面向中文用户,需要监控 ChatGPT 这些海外 AI 吗?

需要看场景。如果你的目标用户在国内、不用海外 AI,那确实只需要监控国内 AI(豆包、文心一言、通义千问、Kimi、智谱清言、DeepSeek)。但 2026 年起越来越多国内用户开始用海外 AI(通过 OpenAI 中国镜像或 VPN),且很多 B2B 决策者会先用 ChatGPT 调研——所以海外 AI 的引用份额仍然有间接价值。我的建议是国内 AI 投入 70% 监控精力、海外 AI 30%,比例可按用户来源调整。

AI 引用了我的内容但是没有给链接,这种引用有没有价值?

有,但价值低于带链接的引用。无链接引用(mention without link)的价值在于品牌词曝光——AI 回答里出现"保哥笔记建议……"会让用户记住"保哥笔记"这个品牌名,这是品牌词搜索量的源头。无链接引用的转化贡献远低于带链接引用(用户没有直接进站路径),但长期累积会推高品牌词搜索量。要把无链接引用转化为有效流量,需要让用户记住品牌名后主动搜索——这就把 AI 引用变成了广义的品牌广告。

AI 模型本身在更新,我的优化策略要怎么跟上?

每季度做一次"AI 模型版本对账"。记录监控期内各模型的版本号变化(GPT-4 → GPT-4o、Gemini 1.5 → 2.0、Claude 3.5 → 4.0),每次大版本变化后立即做一次基线重测——把目标查询全跑一遍,对比版本前后的 SoAIC 变化。如果发现某些查询从被引用变成不被引用,要分析新模型偏好的内容特征是什么(更短的答案?更新的日期?更明确的来源?)。我的项目里 GPT-4 → GPT-4o 升级时丢了 8% SoAIC,分析发现 GPT-4o 更偏好结构化数据(FAQ Schema、HowTo Schema),花两周给主要文章补 schema 后恢复。

SoAIC 的天然波动有多大?怎么区分真实变化与噪声?

同一组查询、同一个模型、同一天测两次,SoAIC 波动 ±5% 是正常的(AI 输出本身有随机性)。日间波动 ±10% 内不要做策略调整,超过 ±15% 才算有意义的信号。要拉趋势线看周或月平均值,不要被单日极值误导。一个有用的统计技巧:用 7 日滚动均值(每天的值取过去 7 天平均)平滑曲线,再判断是否真有上升下降趋势。我项目早期就因为看单日数据频繁调策略,反复折腾两个月才意识到大部分波动是噪声。

SoAIC 监控数据的合规风险

大量自动化抓取 AI 平台的回答可能违反平台 TOS。OpenAI 的服务条款明确禁止自动化批量调用 ChatGPT 网页版(API 调用合规但需要付费),Perplexity、Anthropic 同样有类似条款。Profound、Semrush 这些专业工具与平台有商业合作(部分通过授权 API 抓取,部分通过模拟用户行为但量级控制在合规阈值内)。如果你自己写脚本批量抓 ChatGPT 网页,账号会被风控封禁、IP 进入封禁池。建议合规路径有三:通过官方 API 测试(OpenAI、Perplexity 都有付费 API);订阅商业监控工具(让工具替你承担合规风险);人工小批量抽样(每周 50-200 次手动查询,量级远低于风控阈值)。

能不能让 AI 主动收录我的网站?

不能直接"主动收录",但可以提高被收录概率。OpenAI 在 2024 年开放了 GPTBot 爬虫,你在 robots.txt 里允许 GPTBot 访问就能让 OpenAI 在下次训练数据更新时考虑你的内容(一年 1-2 次大更新)。Anthropic 的 ClaudeBot 同理。Perplexity 走实时检索,发布即刻可被引用。Google AI Overviews 走 Google 索引,传统 SEO 收录就够用。所以"被 AI 收录"实际是 4 件事:robots.txt 允许 GPTBot/ClaudeBot/PerplexityBot/Googlebot 访问;保证你的内容在传统搜索(Google/Bing)有索引;保证 sitemap 提交;提供干净的 SSR HTML。这 4 步做好后,被引用是时间问题。

权威参考资料

FAQPage + Article AI 引用友好版

AI搜索时代真正吃亏的是把内容发出来就不管的运营。本文拆解Share of AI Citation的精确公式与5个核心指标、3档监控工具选型、A/B测试4类维度,并附6个月把SoAIC从11%做到47%的迭代记录与组织协作机制。

- AEO

- AI引用份额

- A/B测试

- 数据驱动

- 关键指标

- 内容营销

- GEO优化

- AI搜索

- GEO/AEO

title: AI引用率监控闭环4步实战:工具选型+A/B测试方法 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/monitor-measure-iterate-ai-citation-optimization-2026.html published: 2026-01-06 modified: 2026-05-24 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《AI引用率监控闭环4步实战:工具选型+A/B测试方法》

本文链接:https://zhangwenbao.com/monitor-measure-iterate-ai-citation-optimization-2026.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0