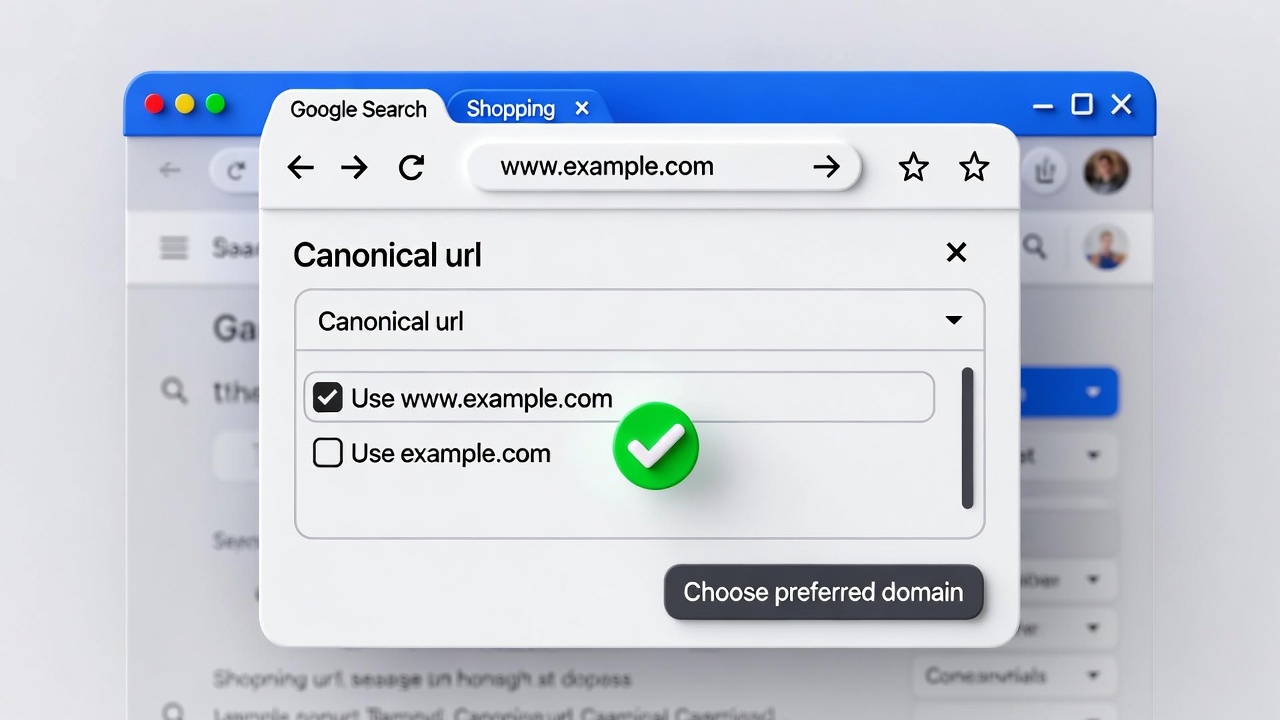

Google选择Canonical URL的9大决策逻辑与排查实操指南

深度解析Google选择Canonical URL的9大核心逻辑,包括精确重复、部分匹配、URL参数推断、移动端版本、渲染失败等场景,附带系统化排查流程与实操修复策略,帮你彻底解决canonical被选错导致的收录和排名问题。

标签

最近保哥的VIP学员问了我一个老话题:Google Search Console报了一堆404错误,怎么办?要不要全部修复?要不要换成410?会不会浪费抓取预算?这些焦虑保哥完全理解。但今天要告...

深度解析Google选择Canonical URL的9大核心逻辑,包括精确重复、部分匹配、URL参数推断、移动端版本、渲染失败等场景,附带系统化排查流程与实操修复策略,帮你彻底解决canonical被选错导致的收录和排名问题。

深度解析机器优先架构的技术原理与落地策略,从Schema结构化数据、AI代理适配到结账协议化,帮你的网站在AI代理时代抢占先机。

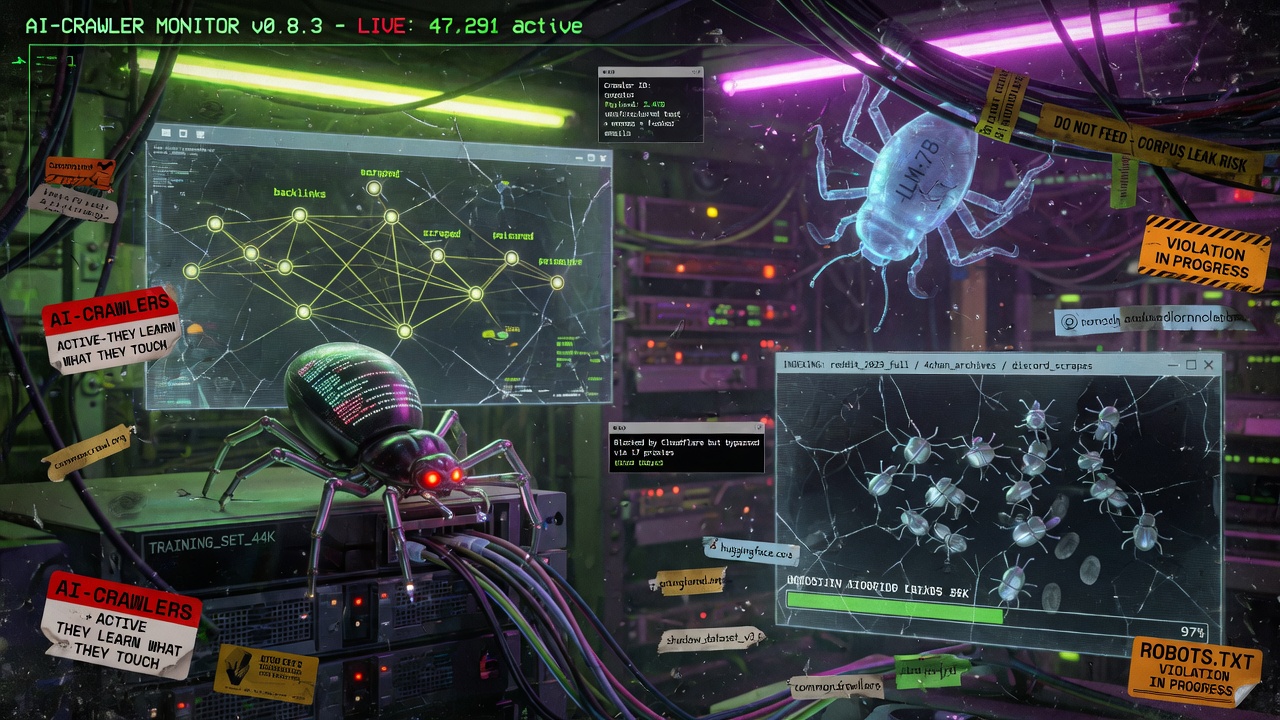

2400万次请求数据揭示,ChatGPT爬虫抓取量已达Googlebot的3.6倍。本文深度解析AI爬虫生态格局,提供robots.txt配置、抓取预算优化、AI搜索可见性提升等实操策略。

深度解析Google官方对网页体积与SEO关系的最新表态,拆解页面大小的定义陷阱、压缩机制、内容与标记比率,提供8个可落地的页面瘦身与性能优化策略。

Google确认Search Console自2025年5月起因日志错误导致展示量数据虚高,修复后展示量将下降。本文深度解析Bug原因、影响范围及SEO从业者的完整应对方案。

做SEO的人都知道内链的重要性,但你听说过用结构化数据来"标注"内链吗?保哥做技术SEO这些年,看过太多网站把内链策略做得很到位——锚文本合理、链接层级清晰、权重传递顺畅——但从来没有想过用Schema标记把这些信息"翻译"成搜索引擎更容易消化的机器语言。今天要聊的,就是Schema.org里两个专门为内部链接设计的属性:significantLink 和 relatedLink。估计很多“资深”SEO人员也都闻所未闻,而这并不是什么黑…

2026年3月20日,Google悄悄在其官方爬虫文档中新增了一个名为"Google-Agent"的用户代理(User Agent)。这不是一次普通的文档更新——它标志着Google正式把AI智能体(AI Agent)的网页访问行为从"实验室阶段"推向了"生产环境"。保哥第一时间注意到了这个变化。说实话,虽然AI Agent的概念已经炒了好几年,但当Google真正把它写进爬虫文档、分配独立的User Agent字符串、公布IP地址范围…

2026年3月底,Google悄悄更新了两份重要的结构化数据文档——Discussion Forum(论坛讨论)和Q&A Page(问答页面),新增了多个支持属性。其中最值得关注的,是一个名为 digitalSourceType 的新属性,它让论坛和问答网站第一次有了用结构化数据向Google声明「这条内容是AI生成的」的标准化方式。这看上去是一个小更新,但保哥认为它释放的信号远比字面意思更深:Google正在构建一套区分人类内容和机器…

保哥做技术SEO审计这些年,见过太多网站团队把精力全砸在关键词、内容和外链上,却对服务器日志文件视而不见。这就好比一个医生只看病人描述的症状,从不做血液化验——你永远无法获得最底层的真相。Google Search Console的数据是采样的,Screaming Frog模拟的是"理论上的爬取",而Google Analytics压根就过滤掉了机器人流量。只有日志文件,才是记录你网站上每一次真实交互的"黑匣子"。今天这篇文章,保哥会把…

最近保哥的VIP学员问了我一个老话题:Google Search Console报了一堆404错误,怎么办?要不要全部修复?要不要换成410?会不会浪费抓取预算?这些焦虑保哥完全理解。但今天要告诉你一个可能颠覆你认知的结论——Google持续抓取你的404页面,某种程度上是一个积极信号。这不是保哥瞎编的,这是Google的John Mueller在2026年3月亲口说的。这篇文章将从HTTP状态码的底层标准讲起,结合Google官方最新…