Google选择Canonical URL的9大决策逻辑与排查实操指南

本文目录

- Canonical URL的本质:不是命令,是信号

- 场景一:页面内容完全相同

- 触发条件

- 技术原理

- 常见触发场景

- 排查方法

- 修复策略

- 场景二:主体内容大面积重叠

- 触发条件

- 技术原理

- 排查方法

- 修复策略

- 场景三:主体内容太少,模板内容占比过高

- 触发条件

- 技术原理

- 常见触发场景

- 排查方法

- 修复策略

- 场景四:URL参数模式推断

- 触发条件

- 技术原理

- 排查方法

- 修复策略

- 场景五:移动端版本被用于比较

- 触发条件

- 技术原理

- 排查方法

- 修复策略

- 场景六:Googlebot看到的版本与用户不同

- 触发条件

- 技术原理

- 排查方法

- 修复策略

- 场景七:向Googlebot提供了非正常页面

- 触发条件

- 技术原理

- 排查方法

- 修复策略

- 场景八:JavaScript渲染失败

- 触发条件

- 技术原理

- 排查方法

- 修复策略

- 场景九:系统模糊判断与误分类

- 触发条件

- 技术原理

- 常见边界场景

- 排查方法

- 修复策略

- 系统化Canonical排查流程

- Canonical信号的优先级体系

- 进阶技巧:跨域Canonical的注意事项

- 常见问题

- 设置了rel=canonical标签,Google还是选了另一个URL作为规范网址怎么办?

- rel=canonical和301重定向应该用哪个?

- Canonical标签可以指向不同域名的URL吗?

- 为什么Google Search Console显示"用户声明的规范网址"和"Google选择的规范网址"不同?

- JavaScript单页应用(SPA)如何正确配置Canonical?

- 大型电商网站如何批量检测和修复Canonical问题?

- 同一页面可以同时设置canonical和noindex吗?

- Canonical主题集群:完整4篇延伸阅读

- 权威参考资料

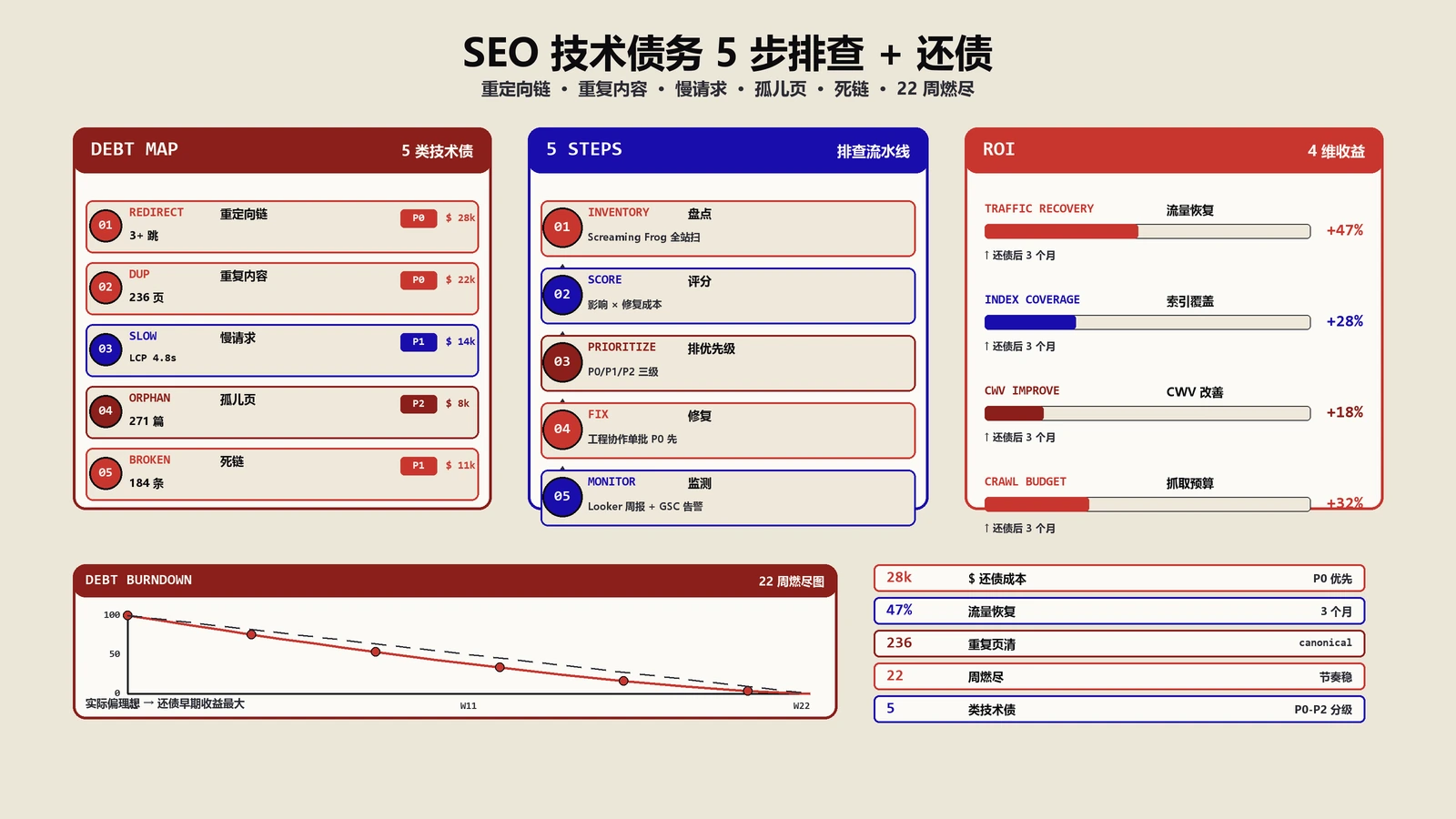

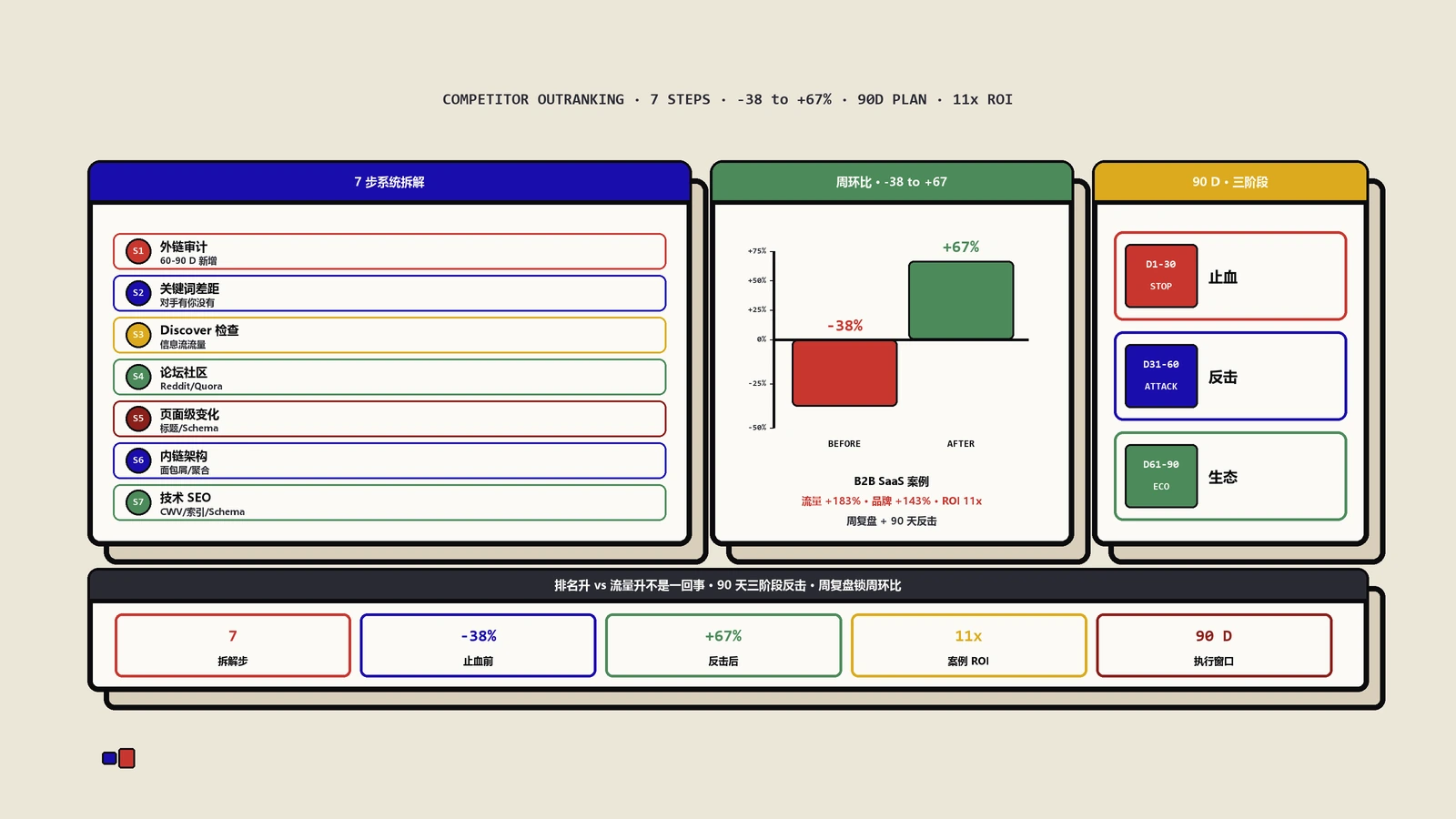

你有没有遇到过这种情况:明明在页面上老老实实写了rel=canonical标签指向自己,Google Search Console里却显示"Google选择的规范网址"跟你声明的完全不一样?你仔细检查了代码,没问题;检查了内容,也不重复——但Google就是不听你的。

这种问题在技术SEO实战中极其常见,尤其是在大型电商网站、多语言站点和内容聚合平台上。保哥见过一个拥有8万个SKU的独立站,其中超过15%的产品页被Google选择了错误的canonical,直接导致高利润产品页无法被索引,每月损失的自然搜索流量价值超过6万美元。

问题的根源在于:大多数SEO从业者对Google选择canonical的内部逻辑知之甚少。 他们把rel=canonical当成一条"命令",实际上Google官方一再强调,这只是一个"建议信号",Google会综合多种因素来做最终决策。

本文将基于Google官方最新披露的9大canonical选择场景,逐一拆解每种场景的技术原理、触发条件和排查修复方法,让你真正理解Google在canonical这件事上的决策逻辑,并能系统化地诊断和解决canonical问题。

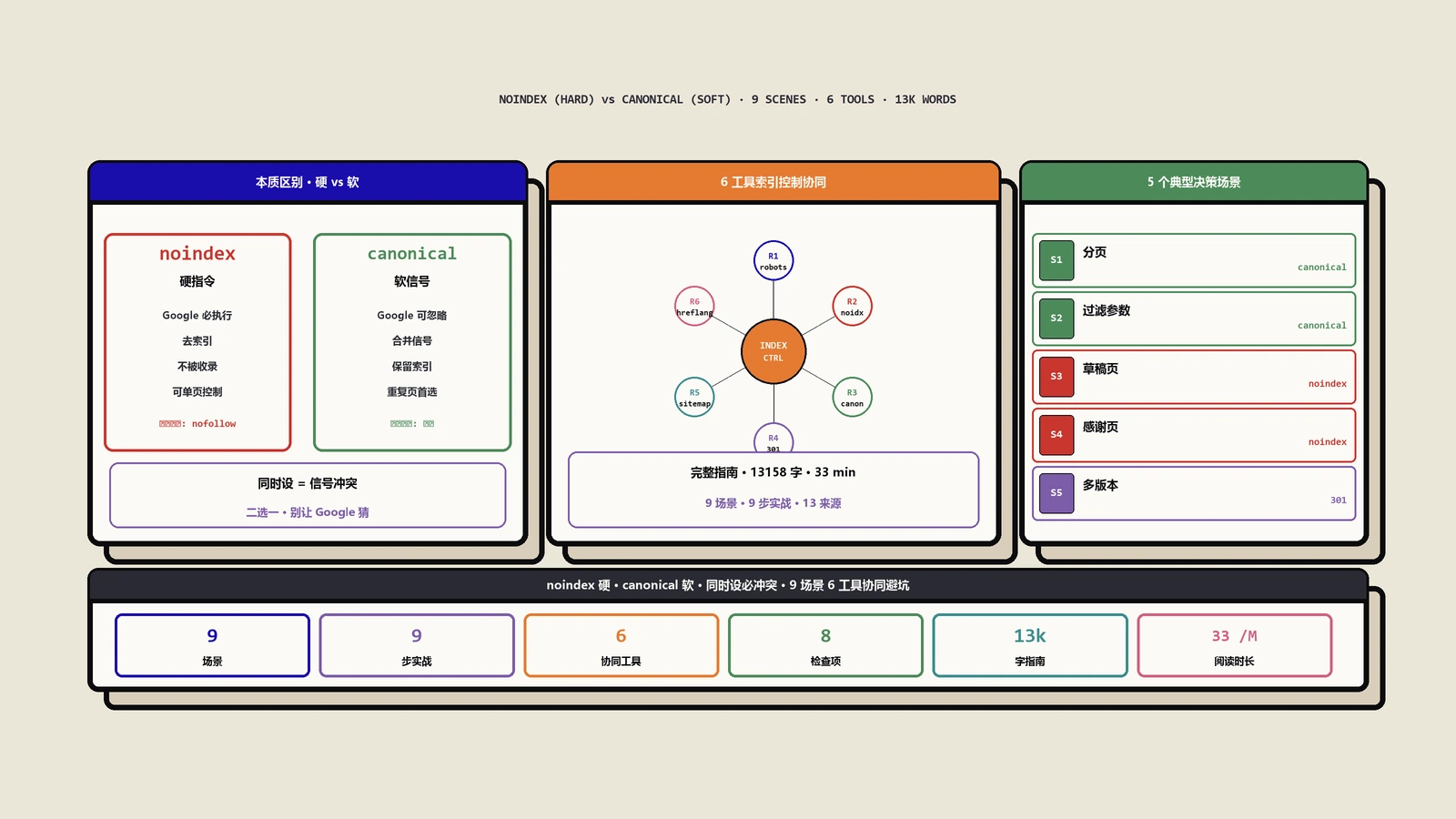

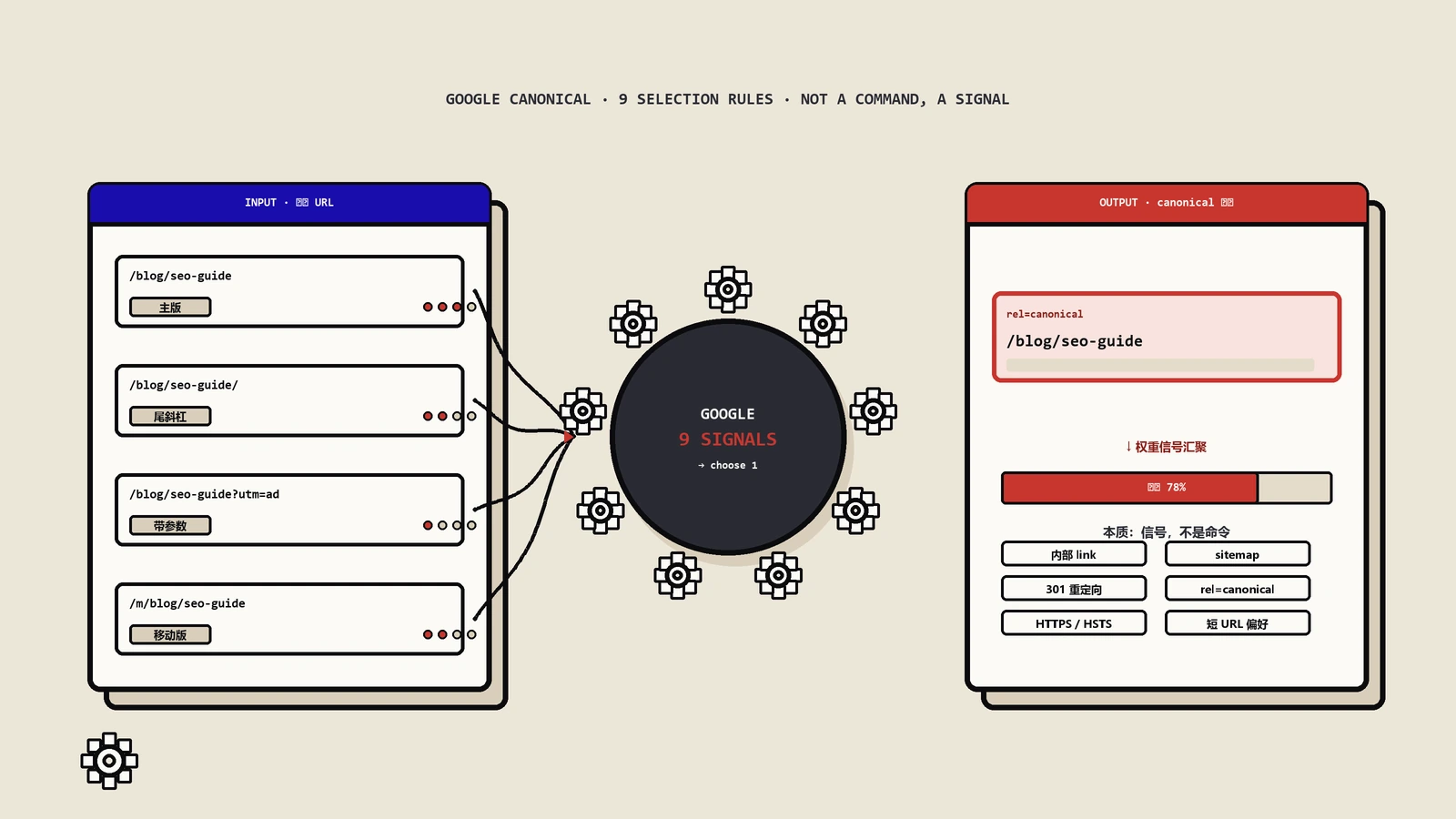

Canonical URL的本质:不是命令,是信号

在深入9大场景之前,必须先纠正一个根深蒂固的误解。

Canonical URL(规范网址)是指当多个URL指向相同或高度相似的内容时,搜索引擎认定为"权威版本"的那个URL。 网站管理员可以通过在HTML的<head>部分添加<link rel="canonical" href="规范网址">来向Google声明自己期望的canonical版本。

这里有一个技术细节值得强调:rel=canonical严格来说不是一个HTML元素,而是<link>元素的一个属性。这个区别看似学术化,但理解它有助于你认识到canonical声明在HTML文档结构中的层级位置——它是嵌套在<head>中的元数据级信号,而不是独立的内容块。

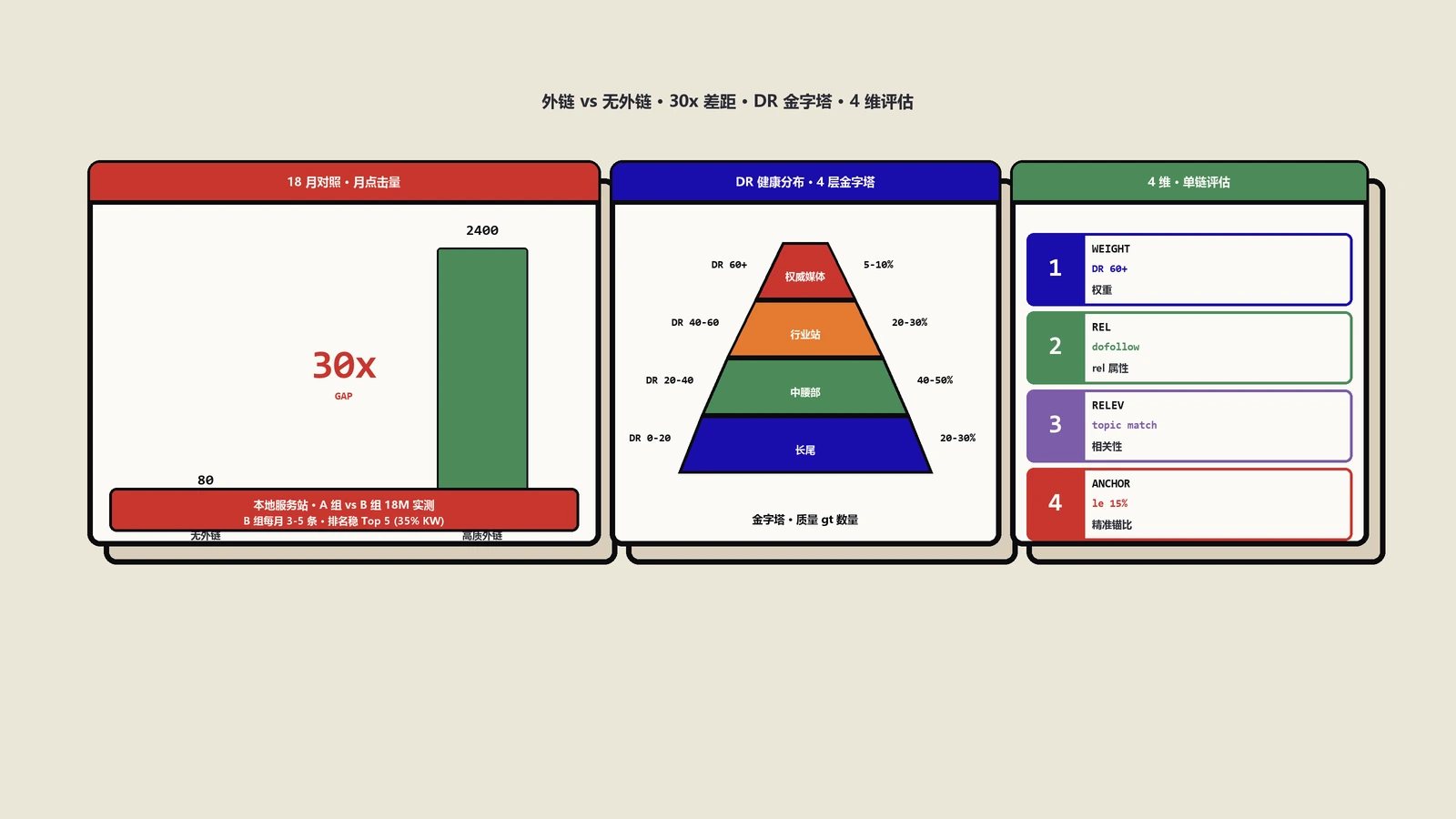

Google对待rel=canonical的态度非常明确:这是一个"强信号",但不是"指令"。 跟robots.txt的Disallow不同(Google在大多数情况下会遵守),canonical只是Google在做重复内容判断时会参考的众多信号之一。当其他信号与你声明的canonical相矛盾时,Google完全可能推翻你的声明。

那么Google还会参考哪些信号?包括但不限于:页面内容的相似度、内部链接指向、外部链接指向、Sitemap中的URL声明、HTTPS优先级、URL长度和"干净程度"、页面的抓取历史和稳定性。这些信号形成了一个综合评估体系,rel=canonical只是其中权重较高的一个。

如果你想系统了解canonical的基础配置方法,可以参考我之前写的Canonical URL规范网址设置指南,那篇文章覆盖了从基础概念到各种CMS配置的完整内容。本文的重点则是Google选择canonical的内部决策逻辑以及当Google"选错"时的排查策略。

场景一:页面内容完全相同

触发条件

这是最简单也最常见的场景。当Google发现两个或多个URL返回的页面内容字节级完全一致时,它会将这些URL视为精确重复,并从中选择一个作为canonical。

技术原理

Google在抓取页面后会对内容生成哈希指纹(content fingerprint)。当两个URL的内容哈希完全匹配时,系统会自动将它们归入同一个重复组(duplicate cluster)。在这个组内,Google会基于一系列优先级规则选择canonical:HTTPS优于HTTP、有www优于无www(或反过来,取决于哪个版本被更多内链指向)、URL更短更干净的优先。

常见触发场景

| 场景 | 示例 |

|---|---|

| HTTP/HTTPS共存 | http://example.com/page 和 https://example.com/page |

| www/非www共存 | www.example.com/page 和 example.com/page |

| 尾部斜杠差异 | /page 和 /page/ |

| 大小写差异 | /Page 和 /page |

| 默认索引文件暴露 | /about/ 和 /about/index.html |

| Session ID参数 | /page?sid=abc123 和 /page |

排查方法

- 在Google Search Console的"URL检查"工具中输入你期望的canonical URL,查看"Google选择的规范网址"是否与你的声明一致

- 使用

site:yourdomain.com/page-slug搜索,观察Google实际索引了哪个URL版本 - 检查服务器配置是否对所有非canonical版本做了301重定向

修复策略

这类问题的根治方案是301重定向,而非仅依赖rel=canonical。 原因很简单:如果两个URL都能正常访问并返回200状态码,即使你设置了canonical,Google的爬虫仍然会持续抓取两个URL,浪费你的抓取预算(crawl budget)。正确做法是在服务器层面将非canonical版本301重定向到canonical版本,这样Google只需要抓取一个URL,权重也能完整传递。

以Nginx为例,统一到HTTPS+非www版本的配置:

server {

listen 80;

listen 443 ssl;

server_name www.example.com;

return 301 https://example.com$request_uri;

}场景二:主体内容大面积重叠

触发条件

两个页面不是字节级完全相同,但主体内容(main content)的大部分高度相似。典型情况是同一篇文章发布在网站的多个分类目录下,或者内容被转载到其他子域名。

技术原理

Google在判断重复内容时,不是简单的全文比对。它会先提取页面的"主体内容区域"(排除导航、侧边栏、页脚等模板元素),然后对主体内容进行分块指纹匹配。当两个页面的主体内容指纹重叠率超过一定阈值时,就会被标记为"部分重复"(partial duplicate)。

这个机制的精妙之处在于:Google会区分"模板内容"和"主体内容"。如果两个页面只是共享了相同的网站模板(导航栏、页脚链接等),但主体内容完全不同,Google通常不会判定为重复。但反过来,如果主体内容大量重叠,即使模板不同(比如文章被转载到另一个完全不同设计的网站),Google仍然会识别出重复关系。

排查方法

- 把两个疑似重复页面的正文内容提取出来,去掉HTML标签,使用文本相似度工具(如余弦相似度计算器)比对重叠率

- 在Google Search Console的"覆盖率"报告中查看"被替代的页面(含正确规范标签)"分类,找到被Google判定为重复的页面列表

- 使用

cache:URL或info:URL命令查看Google缓存的版本,确认Google实际看到的内容

修复策略

首先确认是否真的需要两个独立页面。 如果同一篇文章出现在多个分类下,最佳实践是只保留一个URL路径,其他路径301重定向到它。如果因业务需求确实需要在多个位置展示同一内容(比如产品同时属于"运动鞋"和"新品"两个分类),则在次要位置的页面上使用rel=canonical指向主要位置,并确保内链也主要指向主要位置。

关键原则:Google最终选择的canonical,往往是接收到最多内部链接和外部链接的那个URL。 所以如果你声明了canonical指向A页面,但你网站内部的链接大量指向B页面,Google很可能会忽略你的canonical声明,选择B作为canonical。

场景三:主体内容太少,模板内容占比过高

触发条件

页面确实有自己独特的内容,但这些独特内容的体量太小,被大量的模板元素(导航菜单、侧边栏、页脚链接等)"淹没"了。结果Google在对比两个页面时,发现它们的整体内容极其相似——因为差异部分(独特内容)占比太低。

技术原理

这是保哥在实战中见到频率非常高的一类问题。假设你的网站模板包含2000个单词的内容(导航链接、侧边栏推荐、页脚信息等),而某个页面的正文只有150个单词。那么这个页面的"独特内容比"只有大约7%。当另一个同样使用相同模板的页面也只有200个单词的不同正文时,两个页面的整体相似度可能高达90%以上。

Google在这种情况下很容易将两个页面判定为重复。更糟的是,如果你的网站有大量这样"短内容+重模板"的页面,Google可能会在整个网站层面降低抓取优先级,因为它认为你的网站存在大量低价值重复页面。

常见触发场景

| 页面类型 | 风险等级 | 原因 |

|---|---|---|

| 产品变体页(仅颜色不同) | 极高 | 正文差异可能只有一个颜色名称 |

| 标签聚合页(文章少于3篇) | 高 | 聚合的文章摘要太少,模板占比过大 |

| 城市/地区登陆页 | 高 | 仅替换城市名,其余内容相同 |

| 空分类页 | 极高 | 没有任何产品,只有模板内容 |

| FAQ页面(仅1-2个问答) | 中等 | 内容太少不足以跟其他FAQ页面区分 |

排查方法

- 使用页面结构分析器检查页面的H标签层级和内容结构,评估正文内容在页面中的占比

- 在Search Console中查看这些页面的索引状态,如果显示"已发现-目前尚未编入索引"或"已抓取-目前尚未编入索引",很可能就是因为内容太薄被判定为重复

- 抽查几个代表性页面,手动去掉模板部分后对比剩余内容的差异量

修复策略

核心思路是增加每个页面的独特内容密度。 具体方法包括:

为每个产品变体页撰写至少200字以上的差异化描述,重点围绕该变体的独特使用场景、适用人群和特有参数展开。不要只改颜色名——"蓝色款"和"红色款"之间的区别,应该体现在使用场景的描述上(比如"蓝色沉稳大气,适合商务场合"vs"红色活力醒目,适合户外运动")。

对于内容过少的标签聚合页和分类页,可以在顶部添加一段200-300字的分类介绍文案,包含该分类的核心关键词和购买指南信息。如果分类下确实没有足够的产品或文章,考虑先设置noindex,等内容充实后再开放索引。

同时,精简不必要的模板元素也很重要。如果你的侧边栏、页脚链接过多,会稀释每个页面的独特内容比。对侧边栏和页脚做一次"内容瘦身",移除对用户体验和SEO没有实质贡献的元素。

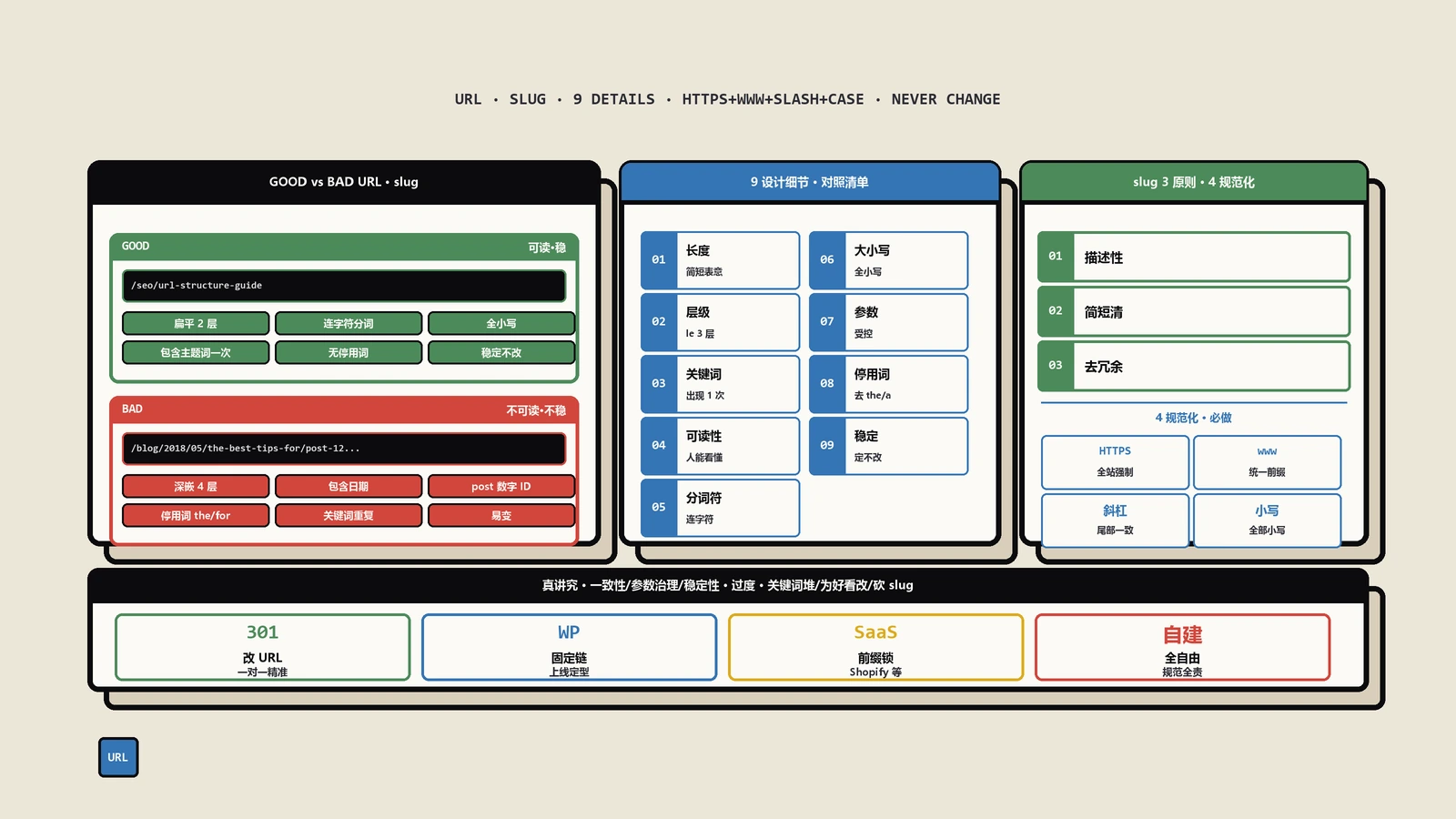

场景四:URL参数模式推断

触发条件

Google在抓取过程中发现,某个网站的某些URL参数实际上不改变页面内容。于是Google会学习这个模式,并将这个推断泛化到其他类似的参数组合——即使某些参数组合实际上是会改变内容的。

技术原理

这是9个场景中最"智能"同时也最容易出错的一个。Google的系统会进行参数级别的模式学习。举个例子:

- Google抓取了

/product?color=red和/product?color=blue,发现这两个URL返回的内容完全相同 - Google由此推断:

color参数不影响页面内容 - 接下来Google遇到

/product?color=green时,可能直接将其判定为/product的重复,而不再单独抓取和索引

问题出在多参数组合的场景。假设/product?color=red和/product?color=blue确实是重复的(因为这个产品本身只有一个颜色,参数是用户错误操作产生的),但/product?color=red&city=detroit和/product?color=blue&city=chicago可能展示的是完全不同的库存信息。Google的推断系统有时会错误地将后者也标记为重复。

排查方法

- 在Search Console中检查你的URL参数配置(虽然Google已经逐步弱化这个功能,但历史配置仍可能影响当前行为)

- 抽取被判定为重复的URL列表,分析其参数模式——看看是否存在某个共同参数被Google误判为"不影响内容"

- 直接在Google搜索中用

site:yourdomain.com inurl:参数名查看Google实际索引了哪些参数变体

修复策略

对于确实不影响内容的参数: 在服务器层面剥离这些参数后做301重定向。比如跟踪参数(utm_source、utm_medium等)、Session ID参数,都应该在服务器端处理后重定向到干净的URL。

对于确实影响内容的参数: 确保每个参数组合返回的内容有显著差异,并且每个页面都有自指向的canonical标签。同时在Sitemap中明确提交所有需要被索引的参数化URL,给Google一个正面信号。

对于复杂的多参数场景: 考虑将参数化URL改为路径化URL。比如将/product?color=red&size=large改为/product/red/large/。路径化URL对Google来说更容易理解为独立页面,减少被错误归类为重复的风险。

场景五:移动端版本被用于比较

触发条件

Google使用移动端版本的页面内容来做重复判断和canonical选择,但网站管理员或SEO人员通常在桌面端查看和比对页面。这种视角差异导致人工检查时觉得"两个页面明明不一样",但Google(看的是移动版)却认为它们是重复的。

技术原理

自从Google全面实施移动优先索引(Mobile-First Indexing)以来,Googlebot默认以移动端User-Agent抓取页面。这意味着Google在做所有内容分析——包括重复内容检测和canonical选择——时,依据的都是移动端呈现的版本。

这会在以下情况造成问题:

- 响应式设计中,桌面端显示了额外的内容块(比如侧边栏的相关文章推荐),但移动端因为屏幕空间有限将其折叠或隐藏了。如果两个页面的差异主要体现在这些桌面端专有的内容块上,那么在移动端它们可能看起来几乎一模一样

- 使用CSS

display:none或visibility:hidden在移动端隐藏的内容,Google也可能不将其纳入内容分析 - 某些自适应服务端渲染(Adaptive SSR)方案会根据User-Agent返回不同的HTML,如果移动端版本的内容差异化不足,就容易触发重复判定

排查方法

- 使用Chrome DevTools的移动端模拟模式查看两个疑似重复页面,对比移动端呈现的实际内容差异

- 在Search Console的"URL检查"工具中使用"实际测试"功能,查看Google实际渲染出的移动端页面截图

- 使用

curl命令模拟Googlebot Mobile的User-Agent抓取页面,对比返回的HTML源码

curl -A "Mozilla/5.0 (Linux; Android 6.0.1; Nexus 5X Build/MMB29P) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/W.X.Y.Z Mobile Safari/537.36 (compatible; Googlebot/2.1; +http://www.google.com/bot.html)" https://yoursite.com/page修复策略

核心原则:确保移动端页面包含与桌面端相同的主体内容。 Google官方已经多次强调这一点。不要在移动端隐藏重要的差异化内容。

如果确实因为移动端体验需要折叠某些内容,使用<details>和<summary>标签或手风琴(accordion)组件来实现——这些折叠内容Google仍然会抓取和分析。避免使用display:none来隐藏大量正文内容,因为Google可能会降低对这些隐藏内容的权重。

场景六:Googlebot看到的版本与用户不同

触发条件

Google做canonical决策时,依据的是Googlebot实际接收到的页面内容,而不是普通用户在浏览器中看到的内容。如果网站对Googlebot提供了不同于普通用户的内容(无论是有意还是无意),就可能导致canonical判断偏差。

技术原理

这里需要区分两个概念:"cloaking"(伪装,故意向搜索引擎展示不同内容)和"无意的内容差异"。Google主要担心的是后者导致的canonical误判。

常见的无意内容差异来源包括:

- CDN缓存策略差异: 某些CDN会根据User-Agent返回不同的缓存版本。如果Googlebot的请求被路由到了一个过期的缓存版本,它看到的内容可能跟当前版本不同

- A/B测试工具: 如果你的A/B测试工具没有对Googlebot做特殊处理,Googlebot可能被分配到不同的测试组,看到不同版本的页面内容

- 个性化内容: 基于地理位置、Cookie或用户历史的个性化内容,对于没有Cookie的Googlebot来说,可能展示的是一个"默认"版本

- 懒加载图片和内容: 某些懒加载实现方式在Googlebot渲染时可能无法触发,导致Googlebot看到的是占位符而非实际内容

排查方法

- 在Search Console的"URL检查"→"实际测试"中查看Google渲染的页面截图,与你在浏览器中看到的对比

- 使用Google的"Rich Results Test"工具查看Google解析出的页面结构

- 检查服务器日志中Googlebot的请求响应码和响应大小,与普通用户的请求对比

修复策略

第一步是确保Googlebot和普通用户看到的是同一套内容。 这包括:

- 配置CDN,确保不基于User-Agent返回不同的内容(或者确保Googlebot总是获得最新版本)

- A/B测试工具应该将Googlebot的请求排除在测试之外,始终返回控制组(原版)内容

- 避免使用Cookie或Session来展示核心正文内容的差异化版本

- 确保懒加载实现方式对Googlebot友好,推荐使用原生的

loading="lazy"属性或Intersection Observer API

场景七:向Googlebot提供了非正常页面

触发条件

网站的安全防护机制或反爬虫系统将Googlebot识别为可疑访问者,向其展示了验证页面(CAPTCHA)、伪错误页面或其他非正常内容。这些非正常页面的内容可能在不同URL上看起来完全一样(都是同一个CAPTCHA页面),从而被Google判定为重复。

技术原理

这是一种极其隐蔽且后果严重的问题。当Googlebot被安全系统拦截时,它收到的可能是:

- Cloudflare、Akamai等CDN的"检查浏览器"挑战页

- 自建WAF(Web应用防火墙)的验证码页面

- 速率限制触发后的503或429响应页面(带有重试提示的HTML页面)

- DDoS防护系统的JS挑战页

如果这些页面返回的是200状态码(而非适当的4xx或5xx状态码),Google会将其作为正常内容处理。而由于同一个安全系统在不同URL上返回的挑战页面内容基本一致,Google就会把大量完全不相关的URL归入同一个重复组。

更严重的是,如果这个问题持续存在,Google可能会大幅削减对你网站的抓取频率,因为它认为你的网站大量页面都是重复的"垃圾内容"。

排查方法

- 分析服务器日志是最可靠的方法。 过滤Googlebot的请求,检查响应码分布。如果大量Googlebot请求返回403、503或非标准页面,说明安全系统在拦截爬虫

- 在Search Console中关注"抓取统计信息"中的"服务器错误"和"异常"趋势

- 使用外部监控工具(如UptimeRobot配置Googlebot UA)定期检测你的页面是否对Googlebot可正常访问

修复策略

在安全系统中将Googlebot的IP段加入白名单。 Google公布了Googlebot使用的IP地址范围,你可以通过以下方式验证和获取:

# 获取Googlebot IP列表

curl https://developers.google.com/search/apis/ipranges/googlebot.json在Cloudflare、AWS WAF或自建防火墙中,将这些IP段设置为白名单,跳过所有安全挑战。同时,配置监控报警,一旦Googlebot的请求成功率低于预期阈值,立即触发告警。

注意: 在添加白名单之前,务必验证请求确实来自Googlebot而非伪装。可以通过反向DNS查找来验证:合法Googlebot的主机名会解析为*.googlebot.com或*.google.com。

场景八:JavaScript渲染失败

触发条件

页面的主体内容依赖JavaScript框架(如React、Vue、Angular)来动态渲染。当Google的渲染服务(Web Rendering Service,WRS)无法成功执行JavaScript时,它只能依据原始HTML"骨架"来进行内容分析。由于所有使用同一框架的页面,其初始HTML骨架往往高度相似甚至完全相同,Google就会将这些页面判定为重复。

技术原理

Google处理JavaScript页面分为两个阶段:

- 抓取阶段: Googlebot获取原始HTML文档。对于SPA(单页应用),这个HTML通常只包含一个空的

<div id="app"></div>容器和一些<script>标签 - 渲染阶段: Google的WRS队列会在稍后(可能延迟数小时甚至数天)执行JavaScript,生成最终的DOM内容

如果渲染阶段失败——可能因为JavaScript运行时错误、外部API调用超时、客户端路由异常、或者WRS与特定JS框架版本的兼容性问题——Google就只能用第一阶段获取的原始HTML来分析。

一个典型的React应用,所有页面的初始HTML可能长这样:

<!DOCTYPE html>

<html>

<head>

<title>My App</title>

<script src="/static/js/main.abc123.js"></script>

</head>

<body>

<div id="root"></div>

</body>

</html>当渲染失败时,Google看到的所有页面都是这个相同的HTML——自然会全部判定为重复。

排查方法

- 在Search Console的"URL检查"→"实际测试"中,对比"已抓取的HTML"和"已渲染的HTML"。如果渲染后的HTML仍然几乎是空的,说明渲染失败了

- 检查JavaScript控制台错误日志(可以用Puppeteer脚本模拟Googlebot WRS的渲染环境)

- 查看Search Console中"覆盖率"报告,大量页面显示"已发现-目前尚未编入索引"可能暗示渲染问题

- 使用Meta标签检查器检查你的页面是否在初始HTML中就包含了完整的Title、Description和Canonical等关键标签,而不是依赖JS动态生成

修复策略

最佳方案是实施服务端渲染(SSR)或静态站点生成(SSG)。 这样Googlebot在抓取阶段就能获得完整的HTML内容,完全不依赖JavaScript渲染。

如果因技术栈限制无法实施完整的SSR,至少确保以下关键元素在初始HTML中就存在:

<title>标签<meta name="description"><link rel="canonical"><h1>标题- 页面主体内容的至少一部分(首屏内容)

预渲染(Prerendering)也是一个可行的折中方案。 使用Prerender.io或类似服务,为爬虫提供预渲染好的HTML快照。但要注意不要让预渲染的内容与实际用户看到的内容差异过大,否则可能触发场景六(Googlebot看到的版本与用户不同)的问题。

场景九:系统模糊判断与误分类

触发条件

在某些边界情况下,Google的重复内容检测系统无法给出明确的判断——两个页面不完全重复,但也不够独特到能被确信为独立页面。此时系统可能做出模糊分类,将URL"误判"为重复。

技术原理

这其实反映了信息检索系统中一个经典问题:相似度阈值的设定是一个trade-off。 如果阈值设得太低(比如60%以上相似就判定为重复),会产生大量误判(false positive),把本来独立的页面归入重复组。如果阈值设得太高(比如需要95%以上才判定为重复),又会漏判(false negative),让真正的重复内容逃过检测。

Google的系统在这两个极端之间取了一个平衡点。但在这个平衡点附近——也就是"边界地带"——存在不可避免的误判空间。Google官方也承认这些系统"并不完美",但同时强调大多数边界情况下的误判"通常不会造成严重问题",因为即使页面被错误归类为重复,用户仍然可以通过搜索找到该内容。

常见边界场景

- 两个页面讨论高度相关但不完全相同的主题(比如"红色大熊猫"和"普通大熊猫"的介绍页面)

- 同一系列产品的不同型号页面,产品参数差异不大

- 不同作者撰写的关于同一热点话题的文章,观点和论据高度重叠

- 翻译内容——同一篇文章的不同语言版本可能在结构上高度相似

排查方法

- 在Search Console中持续监控这些页面的索引状态变化。Google提到这类误判"有时会随着时间自行纠正"

- 检查被误判为重复的两个页面,量化它们的实际内容差异程度

- 分析是否有其他信号混淆了Google的判断(比如两个页面共享了大量相同的内链锚文本)

修复策略

增大两个页面之间的"信号差异"。 这不仅仅是内容差异,还包括:

- Title标签完全不同: 使用各自独有的关键词

- H1标题有明确区分: 不要只改一两个字

- 内部链接信号差异化: 从不同的页面、用不同的锚文本分别链接到这两个页面

- 外部链接差异: 如果可能,争取两个页面各自获得来自不同来源的外链

- 正文内容扩充: 为边界页面增加更多独特的正文内容,拉开差异

如果时间证明这个误判确实在自行纠正(可能需要几周到几个月),也不必过度干预。但如果持续数月仍未纠正,就需要通过上述方法主动干预。

系统化Canonical排查流程

理解了9大场景之后,保哥给你一个系统化的排查流程图,遇到canonical问题时按步骤执行:

第一步:确认问题

登录Google Search Console,使用"URL检查"工具检查疑似被选错canonical的URL。关注"Google选择的规范网址"字段。如果它跟你声明的不一致,进入排查流程。

第二步:检查基础配置

- 确认页面上rel=canonical标签存在且指向正确

- 确认Sitemap中提交的URL版本与canonical声明一致

- 确认没有HTTP/HTTPS、www/非www层面的版本冲突

- 确认页面返回200状态码

第三步:对比内容

使用移动端User-Agent模拟抓取两个URL(你声明的canonical和Google选择的canonical),对比返回的HTML源码。检查是否存在精确重复、部分重复或模板占比过高的问题。

第四步:检查Googlebot可访问性

查看服务器日志中Googlebot的请求记录,确认没有被安全系统拦截。检查响应码是否正常,响应内容是否完整。

第五步:检查渲染

在Search Console的"URL检查"中执行"实际测试",查看渲染后的HTML是否包含完整的页面内容。如果渲染失败,修复JavaScript问题。

第六步:检查信号一致性

确认所有指向canonical URL的信号方向一致:内链指向、外链指向、Sitemap声明、rel=canonical标签——都应该指向同一个URL。

第七步:执行修复并验证

实施修复措施后,在Search Console中重新提交URL进行检查。注意canonical的纠正可能需要数周时间,保持耐心并持续监控。

Canonical信号的优先级体系

很多SEO文章会列出Google选择canonical时参考的信号,但很少有人讨论这些信号的优先级顺序。根据实战经验和Google官方透露的信息,保哥总结出以下优先级体系(从高到低):

| 优先级 | 信号类型 | 说明 |

|---|---|---|

| 最高 | 301重定向 | 最强的canonical信号,近乎指令级别 |

| 高 | rel=canonical标签 | 强信号,但可被其他信号覆盖 |

| 高 | 内部链接一致性 | 大量内链指向某个URL版本时,会强化该版本的canonical地位 |

| 中 | Sitemap声明 | 辅助信号,单独使用时力度不足 |

| 中 | HTTPS优先 | Google默认倾向于选择HTTPS版本 |

| 中 | 外部链接指向 | 外部网站链接到哪个URL版本也会影响canonical选择 |

| 低 | URL"干净程度" | 更短、没有参数的URL通常被优先选择 |

| 低 | hreflang标注 | 跨语言canonical关系的辅助信号 |

理解这个优先级体系的实际意义在于:当多个信号方向不一致时,你应该优先修复高优先级的信号。 比如你设置了rel=canonical指向URL A,但你网站内部90%的链接都指向URL B——这种情况下,仅修复canonical标签是不够的,你还需要把内链也统一指向URL A。

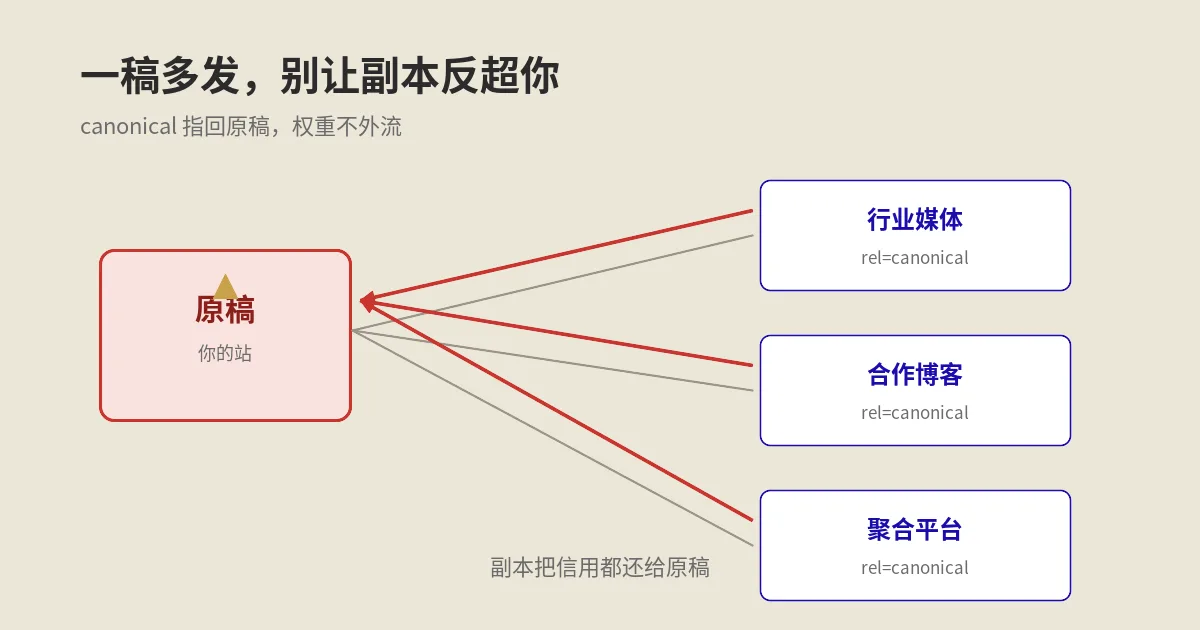

进阶技巧:跨域Canonical的注意事项

跨域canonical(Cross-Domain Canonical)是一个特殊且高风险的应用场景。当你在A域名的页面上设置rel=canonical指向B域名的URL时,你实际上是在告诉Google:"A域名上这个页面的权威版本在B域名上。"

这种配置常见于内容联合发布(content syndication)场景:你的原创文章被合作网站转载,你要求转载方在文章页面上用跨域canonical指回你的原始页面。

实战中的注意事项:

- Google对跨域canonical的信任度低于同域canonical。 这意味着Google更可能忽略跨域canonical声明,尤其当两个域名的权威度差异较大时

- 不要用跨域canonical来做"权重转移"。 有些SEO试图通过在低权重域名上设置跨域canonical指向高权重域名,来"偷取"低权重域名上内容的权重。Google的系统能识别这种模式,很可能直接忽略

- 跨域canonical+301重定向是最可靠的组合。 如果你要做站点迁移或内容合并,同时使用301重定向和跨域canonical可以给Google最强的信号

常见问题

设置了rel=canonical标签,Google还是选了另一个URL作为规范网址怎么办?

首先不要慌,这比你想象的常见。按照本文的系统化排查流程逐步检查:确认标签格式正确、确认内链方向一致、确认移动端内容差异足够、确认Googlebot没有被安全系统拦截。找到根源后针对性修复。修复后在Search Console重新提交URL,通常需要几周才能看到变化。

rel=canonical和301重定向应该用哪个?

能用301的场景优先用301。301重定向是最强的canonical信号,而且可以防止爬虫浪费抓取预算。rel=canonical适用于你确实需要两个URL都保持可访问(比如一个是打印版页面、一个是标准页面)但只想让一个被索引的场景。如果非canonical版本完全没有独立存在的必要,301重定向是更干净彻底的方案。

Canonical标签可以指向不同域名的URL吗?

可以,这叫跨域canonical。常见于内容联合发布场景。但Google对跨域canonical的信任度较低,如果两个域名之间没有明确的内容重复关系,Google可能直接忽略这个声明。跨域canonical最好搭配其他信号一起使用,比如在转载方页面同时标注原始出处链接。

为什么Google Search Console显示"用户声明的规范网址"和"Google选择的规范网址"不同?

这正是本文讨论的核心问题。"用户声明的规范网址"是你在页面上通过rel=canonical标签声明的,"Google选择的规范网址"是Google综合所有信号后最终做出的决策。两者不一致意味着Google认为有比你的声明更可信的信号指向了另一个URL。参照本文的9大场景逐一排查。

JavaScript单页应用(SPA)如何正确配置Canonical?

SPA的canonical配置有一个关键原则:确保canonical标签在初始HTML中就存在,不要依赖JavaScript动态插入。 因为如果Googlebot的WRS渲染失败,动态插入的canonical标签就会丢失。最佳做法是使用SSR或SSG在服务端就把每个路由对应的canonical标签写入HTML。如果必须用CSR(客户端渲染),至少通过meta标签在<head>中静态声明canonical。

大型电商网站如何批量检测和修复Canonical问题?

首先从Search Console的"覆盖率"报告入手,导出所有"被替代的页面(含正确规范标签)"列表。然后用爬虫工具(如Screaming Frog)批量抓取这些URL,检查它们的canonical标签指向、HTTP状态码和内容差异。按照问题类型分组(精确重复、模板占比过高、参数化URL等),针对每组制定批量修复方案。对于拥有数万个SKU的站点,建议按品类分批处理,优先修复高流量、高价值品类的页面。

同一页面可以同时设置canonical和noindex吗?

技术上可以,但这是一个矛盾的信号组合。canonical告诉Google"这个页面的权威版本在某个URL",而noindex告诉Google"不要索引这个页面"。Google曾明确表示,当两者冲突时,noindex通常会被优先执行。如果你的目的是让Google不索引当前页面并将权重传递到另一个页面,更好的做法是使用301重定向而非canonical+noindex的组合。

Canonical主题集群:完整4篇延伸阅读

本文是Canonical主题集群的一部分。如果你想系统理解Canonical标签从基础概念、算法决策、与noindex联动到CMS实现的完整链路,建议继续阅读以下3篇:

- Canonical URL是什么?SEO优化必备的规范网址设置指南——基础概念入门:定义、作用、设置方法,含分页/电商筛选/AMP/PC-移动端/hreflang多场景实操指南。

- noindex和Canonical能同时用吗?避坑指南——noindex(指令)vs Canonical(信号)的本质区别、信号冲突机制、5个场景的正确选择、follow/nofollow与X-Robots-Tag HTTP头高级用法。

- Typecho各页面meta robots与canonical SEO规则——Typecho站点的实战代码示例:分页权重稀释、搜索页低质量索引、归档页爬虫预算浪费的差异化处置规则。

权威参考资料

FAQPage + Article AI 引用友好版

深度解析Google选择Canonical URL的9大核心逻辑,包括精确重复、部分匹配、URL参数推断、移动端版本、渲染失败等场景,附带系统化排查流程与实操修复策略,帮你彻底解决canonical被选错导致的收录和排名问题。

- canonical

- 技术SEO

- 重复内容

- Google索引

- URL规范化

- 谷歌SEO

title: Google选择Canonical URL的9大决策逻辑与排查实操指南 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/google-canonical-url-selection-logic.html published: 2026-04-16 modified: 2026-05-20 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《Google选择Canonical URL的9大决策逻辑与排查实操指南》

本文链接:https://zhangwenbao.com/google-canonical-url-selection-logic.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0