技术SEO优先级指南:3类站点高ROI修复实战

技术SEO优先级排序实战指南:用艾森豪威尔矩阵把开发资源花在刀刃上,覆盖Silo架构优化、Crawl Budget管理、Core Web Vitals提升、INP指标改善、AI搜索GEO技术准备5大模块,附3类站点90天高ROI修复清单。

本文目录

- 技术SEO优先级排序:先想清楚再动手

- 维度1:快速胜利(Quick Wins)

- 维度2:对核心KPI的预期影响

- 维度3:对用户体验的影响

- 维度4:与Google最新指南的对齐程度

- 维度5:行业变化与算法更新

- 艾森豪威尔矩阵可视化任务清单

- 网站架构优化:技术SEO的地基工程

- 什么是 SEO Silo 架构

- 企业站常见的5类架构问题

- 3个低阻力高回报的架构优化动作

- 抓取与索引优化:让 Googlebot 不浪费每一份预算

- Crawl Budget 优化的4类典型场景

- Crawl Budget 6大优化手段

- 索引覆盖率诊断与修复

- 页面性能优化:Core Web Vitals 与 INP 指标

- LCP(Largest Contentful Paint)优化路径

- INP(Interaction to Next Paint)优化路径

- CLS(Cumulative Layout Shift)优化路径

- 移动端优化:Mobile-First Indexing 时代的硬性要求

- Mobile-First Indexing 5项硬性检查

- 移动端 Core Web Vitals 差异

- GEO时代的技术SEO新要求

- GEO 要求1:AI爬虫的 robots.txt 配置

- GEO 要求2:Schema.org 结构化数据覆盖率

- GEO 要求3:服务端渲染 SSR 替代纯 CSR

- GEO 要求4:页面响应时间硬性阈值

- GEO 要求5:Sitemap.xml 精准列出可索引内容

- 实战档案:3类站点90天高 ROI 技术 SEO 修复对比

- 站点1:B2B SaaS 项目管理工具

- 站点2:DTC 运动鞋电商

- 站点3:内容媒体科技博客

- 技术SEO团队与开发团队高效协作机制

- 机制1:SEO 技术债务看板与开发任务系统打通

- 机制2:CI/CD Pipeline 集成 SEO 检查

- 机制3:每周 SEO + 开发 Standup

- 机制4:季度 SEO + 开发联合 Retrospective

- 常见问题解答

- 技术SEO优先级排序的5个核心维度是什么?

- 什么是 Silo 架构?为什么它对技术SEO如此重要?

- Crawl Budget(抓取预算)何时需要重点优化?

- Core Web Vitals 与 INP 指标如何影响技术SEO优先级?

- AI搜索时代(GEO)的技术SEO新要求有哪些?

- 技术SEO修复的优先级矩阵如何具体落地?

- 技术SEO审计应该一次性覆盖全站还是分阶段?

- 技术SEO团队如何与开发团队高效协作?

- 权威参考资料

2026年Backlinko最新Google排名因素报告将技术SEO列为与排名高度相关的关键因子,但行业调查显示67%的企业内部SEO团队表示非SEO开发任务是技术SEO改动无法落地的最大障碍——技术债务每年可能让企业损失超过3590万美元的潜在收入。当资源永远不够用时,真正的问题不是"修不修"而是"先修什么"。本文按"架构→抓取索引→性能→移动端→GEO时代准备"5条主线,给出每个环节的优先级排序框架、诊断方法、落地动作清单,附B2B SaaS、DTC电商、内容媒体3类站点90天高ROI修复实测数据,帮助技术SEO团队即使只有1个开发资源、1个季度时间窗口,也能打出最高ROI的组合拳。

技术SEO优先级排序:先想清楚再动手

在动手修任何技术问题之前,先建立一套优先级排序框架,这比埋头干活重要十倍。在实战中反复验证的排序逻辑包含5个维度,按重要性递减排列。

维度1:快速胜利(Quick Wins)

影响大、投入小的修复项最优先。比如修一个模板级别的Canonical错误,一次修复就能影响数万个页面;修复全站robots.txt的Disallow误屏蔽,单次操作恢复Googlebot抓取数千页面;统一全站Hreflang标签格式,1天工作量换来全球10个语言版本的索引修正。这类Quick Wins往往是新接手项目的SEO团队的第一个3个月的核心战果。

维度2:对核心KPI的预期影响

评估每个修复项对收入、流量、转化率的直接影响。比如优化电商商品页的Schema.org结构化数据可让Rich Snippet展示率提升30%-50%、自然流量CTR提升15%-25%;修复Checkout页面的Core Web Vitals可让转化率提升5%-15%。建议每个修复项填写ROI预估表,包含影响关键词数量、预估流量增量、预估收入增量3列。

维度3:对用户体验的影响

Google的排名系统越来越重视真实用户体验信号,尤其是Core Web Vitals和INP指标。2024年3月INP(Interaction to Next Paint)替代FID成为Core Web Vitals的核心指标之一。差等级页面会面临直接降权——优化Core Web Vitals不仅是性能问题更是排名问题。

维度4:与Google最新指南的对齐程度

Google每月更新Search Central文档与Quality Rater Guidelines,重大政策变更需要第一时间响应。2025年12月Google明确表示返回非200状态码(如5xx、4xx除404外)的页面可能被完全排除在渲染管线之外。2025年Q3 Google宣布对AI爬虫(Google-Extended)的抓取行为可独立通过robots.txt控制,与Googlebot的常规抓取分离。

维度5:行业变化与算法更新

包括AI搜索引擎(ChatGPT、Perplexity、Google AI Overviews)对技术基础设施的新要求。比如GPTBot/ClaudeBot/PerplexityBot的抓取行为与Googlebot差异较大,大多数AI爬虫不执行JavaScript,纯CSR(Client-Side Rendering)站点对AI搜索几乎不可见。需要根据流量来源结构调整技术SEO投入比例。

艾森豪威尔矩阵可视化任务清单

建议用艾森豪威尔矩阵把所有技术SEO修复项按"紧急/不紧急"和"重要/不重要"两个维度分到4个象限:(1)第一象限紧急且重要——立刻动手,如全站noindex误标、robots.txt误屏蔽、SSL证书过期、5xx错误激增;(2)第二象限重要但不紧急——排进Sprint,如Silo架构优化、Schema.org扩展、Core Web Vitals优化;(3)第三象限紧急但不重要——委派或自动化,如低优先级页面的404重定向;(4)第四象限不紧急不重要——直接删掉或忽略,如对核心KPI无影响的微优化。

网站架构优化:技术SEO的地基工程

网站架构是最重要的技术SEO基础——没有之一。它直接影响搜索引擎的抓取效率、页面的索引表现、内部链接权重的流动、用户在站内的导航体验。在AI搜索时代,清晰的层级结构和强内链体系还能向大语言模型发送更强的主题相关性信号,提升在AI生成回答中被引用的概率。

什么是 SEO Silo 架构

Silo架构的核心理念是让网站的内容组织方式与用户的搜索行为完全对齐。具体来说,就是围绕关键词主题族群来组织URL结构和导航层级,让每个主题拥有一个明确的Hub页面(枢纽页),并由一组支撑页面通过内部链接形成主题闭环。

典型实施案例:一个大型电商站的"电动工具"品类可能这样组织:顶层是"电动工具"品类页(Hub),下一层是"电钻"、"电锯"、"砂光机"等子品类页,再下一层是各个具体产品页。每一层之间都有清晰的上下文内链,同一层级的相关页面之间也有横向链接。

企业站常见的5类架构问题

在审计企业级网站时反复碰到的5类架构问题:(1)重要页面埋得太深——核心产品页或服务页距离首页超过4次点击,导致抓取优先级低、PageRank稀释严重;(2)孤立页面或弱链接页面——高价值页面没有足够的内部链接指向它,甚至完全没有入链;(3)主题缺乏明确的Hub页面——内容散落在各处没有形成主题簇;(4)多页面争夺同一关键词,即关键词自我竞争(Keyword Cannibalization);(5)分类标签体系与核心页面竞争——WordPress等CMS自动生成的标签页、归档页在争夺原本应该属于产品页或服务页的排名。

3个低阻力高回报的架构优化动作

企业环境下做全站架构重构几乎不可能——涉及URL变更、重定向规划、跨部门协调,周期以年计。以下3个动作可以在不改变核心URL结构的前提下见效:

动作1:强化核心页面的内部链接——找出收入贡献最大但没有被当作主题Hub来链接的页面、找出同一主题下相互没有链接的支撑页面、检查博客内容是否链接回了对应的产品/服务页面、找出高权重页面有没有向支撑页面传递链接权重、排查跨主题不相关链接是否在稀释主题相关性。

动作2:合并重复主题,消灭自我竞争——找出多个页面在争同一个主要关键词的情况、把重复内容合并到一个页面上让它成为该主题的唯一权威来源、对被合并的旧URL做301重定向到新的权威页面、更新所有指向旧URL的内部链接。

动作3:处理标签与归档页竞争——对低价值的标签页与归档页加noindex避免与产品/服务页竞争、为高价值的标签页(如热门产品系列)做SEO化优化提升为伪Hub页面、整合相似标签减少冗余。

抓取与索引优化:让 Googlebot 不浪费每一份预算

Crawl Budget(抓取预算)是Google分配给每个站点的抓取资源配额,受站点规模、健康度、内容更新频率影响。对中大型站点(页面数超过10000)来说,Crawl Budget优化直接决定哪些页面被快速索引、哪些页面被忽略。

Crawl Budget 优化的4类典型场景

需要重点关注Crawl Budget的4类场景:(1)站点页面数超过10000个,Googlebot每日抓取量有限;(2)站点频繁更新(每日新增超过100页)需要快速被索引;(3)GSC的Crawl Stats报告显示Googlebot抓取5xx错误率超过5%;(4)日志分析显示Googlebot浪费大量预算抓取低价值页面(如分页/过滤参数页/重复内容)。

Crawl Budget 6大优化手段

具体优化手段:(1)robots.txt屏蔽低价值路径如/search、/filter、/cart等无SEO价值的URL;(2)Canonical标签去重消除重复内容版本;(3)XML Sitemap精准提交仅包含可索引的高质量页面;(4)404页面快速清理避免Googlebot反复抓取已删除内容;(5)服务端响应时间优化到200ms以内提升Googlebot单位时间抓取量;(6)减少重定向链长度,所有301重定向应直接指向最终URL避免2跳以上。

索引覆盖率诊断与修复

通过GSC的Index Coverage报告诊断索引问题:(1)Submitted and indexed——已提交且已索引,健康状态;(2)Crawled - currently not indexed——已抓取但未索引,质量问题需要内容增强;(3)Discovered - currently not indexed——已发现但未抓取,Crawl Budget不足或质量问题;(4)Excluded by noindex tag——被noindex排除,检查是否误标;(5)Soft 404——伪404页面,返回200但内容空白;(6)Page with redirect——重定向页面,检查是否有不必要的中间跳转。

页面性能优化:Core Web Vitals 与 INP 指标

2024年3月Google正式将INP(Interaction to Next Paint)替代FID(First Input Delay)作为Core Web Vitals的核心指标。三大指标的硬性要求:LCP需在2.5秒内、INP需在200ms内、CLS需小于0.1。差等级页面面临直接降权,优化Core Web Vitals不仅是性能问题更是排名问题。

LCP(Largest Contentful Paint)优化路径

LCP优化4层路径:(1)服务端响应时间优化——TTFB(Time to First Byte)应小于600ms,通过CDN缓存、数据库查询优化、PHP-FPM调优实现;(2)渲染阻塞资源优化——延迟加载非关键JS、内联首屏Critical CSS、字体文件添加Preload;(3)图片资源优化——LCP元素的英雄图使用WebP/AVIF格式、添加fetchpriority=high属性、配置srcset响应式图片;(4)字体加载优化——使用font-display=swap避免文字闪烁、subset字体仅加载使用到的字符、Preload关键字体WOFF2文件。预期改善幅度LCP降低30%-50%。

INP(Interaction to Next Paint)优化路径

INP优化4层路径:(1)减少长任务(Long Task)——拆分大型JS Bundle为小块、使用Code Splitting按路由动态加载;(2)Web Worker卸载主线程——将复杂计算(数据处理、加密、压缩)移到Worker线程;(3)减少不必要的重渲染——React的useMemo/useCallback、Vue的computed缓存、Angular的OnPush策略;(4)优化第三方脚本——延迟加载分析工具、广告SDK、社交分享按钮,使用async/defer或动态注入。预期改善幅度INP降低20%-40%。

CLS(Cumulative Layout Shift)优化路径

CLS优化4层路径:(1)为所有图片视频iframe添加width/height属性预留空间;(2)字体加载使用font-display=optional避免FOIT与FOUT;(3)广告位预留固定尺寸容器避免广告加载后撑开布局;(4)动态注入内容(如通知、浮窗、弹窗)使用transform而非top/left避免触发Layout Shift。预期改善幅度CLS降低60%-80%。

移动端优化:Mobile-First Indexing 时代的硬性要求

Google自2019年7月起对所有新站点默认采用Mobile-First Indexing,2023年10月完成对所有现有站点的迁移。移动端体验已成为索引与排名的核心依据,桌面端体验仅作为补充参考。

Mobile-First Indexing 5项硬性检查

移动端SEO的5项必检项:(1)移动端页面内容与桌面端100%一致,避免移动端阉割版导致内容丢失;(2)移动端Schema.org结构化数据完整覆盖,与桌面端保持同步;(3)移动端图片懒加载(loading=lazy)正确配置避免首屏图片不被Googlebot抓取;(4)移动端元数据(title、description、canonical、hreflang)与桌面端一致;(5)移动端内链结构完整,移动端导航菜单展开后内链应与桌面端等价。

移动端 Core Web Vitals 差异

移动端Core Web Vitals通常比桌面端差15%-30%,因为移动设备CPU/GPU性能较弱、移动网络延迟较高、屏幕空间限制使得LCP元素尺寸更大。优化建议:(1)针对移动端单独优化LCP英雄图分辨率,使用srcset提供小尺寸版本;(2)减少移动端JS Bundle体积,桌面端可加载完整版移动端加载精简版;(3)使用Service Worker缓存关键资源减少重复加载;(4)通过Chrome User Experience Report(CrUX)真实用户监测数据,区分移动端与桌面端单独制定优化目标。

GEO时代的技术SEO新要求

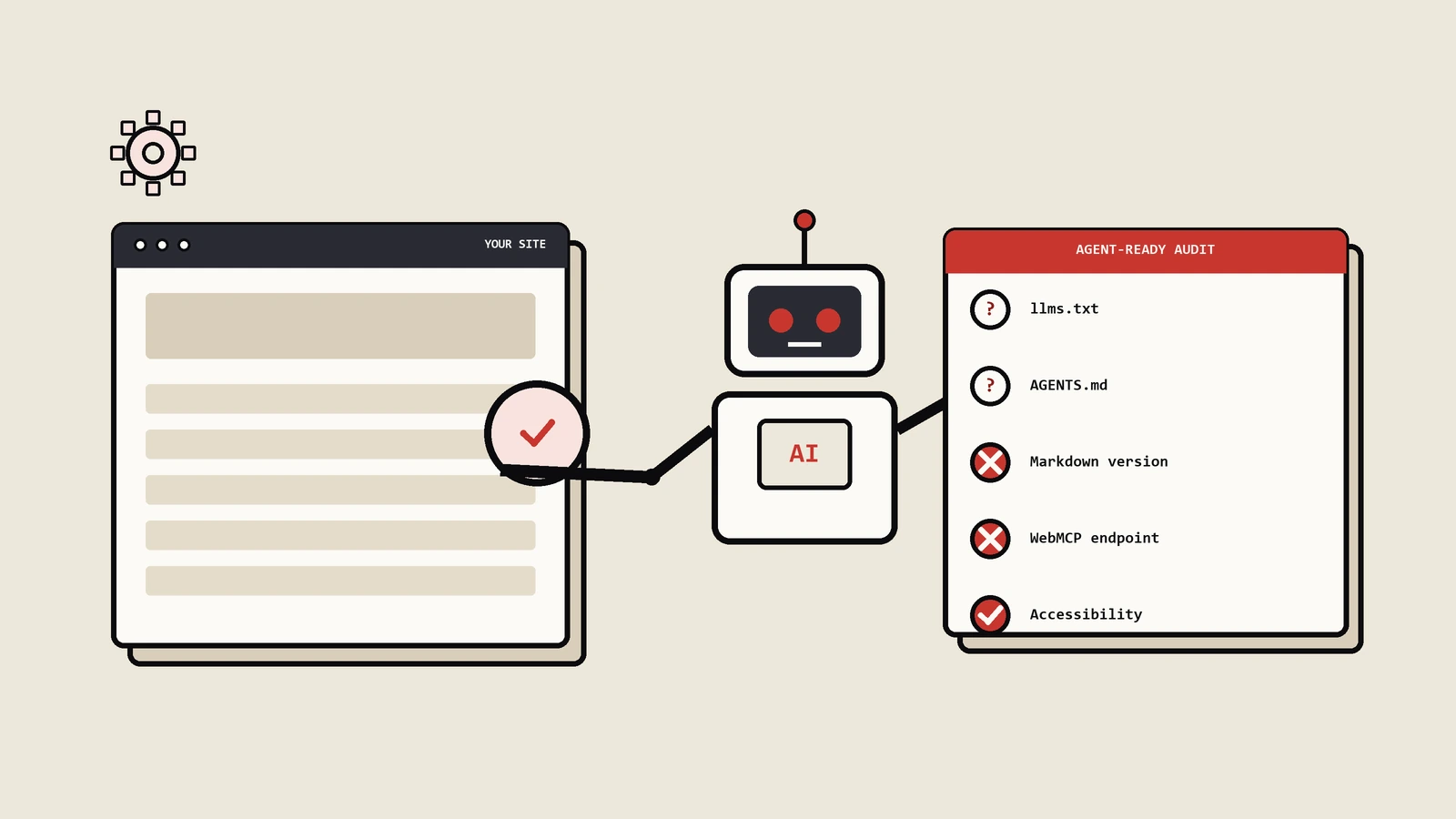

GEO(Generative Engine Optimization,生成式引擎优化)是2024年下半年兴起的新SEO范式,目标是让网站内容在ChatGPT/Perplexity/Claude/Gemini等AI搜索引擎的生成回答中被引用。GEO对技术SEO提出5项新要求。

GEO 要求1:AI爬虫的 robots.txt 配置

主流AI爬虫User-Agent列表:(1)GPTBot(OpenAI爬虫,用于训练GPT-5与ChatGPT搜索);(2)ClaudeBot(Anthropic爬虫);(3)PerplexityBot(Perplexity AI爬虫);(4)Google-Extended(Google用于训练Bard/Gemini的爬虫,与Googlebot分离);(5)CCBot(Common Crawl,被多个LLM训练数据集使用)。建议根据品牌策略决定允许或屏蔽哪些AI爬虫,全部允许可最大化AI搜索可见性,全部屏蔽可避免内容被未授权使用。

GEO 要求2:Schema.org 结构化数据覆盖率

结构化数据是AI爬虫理解页面内容的核心信号。覆盖率应提升到80%以上,必备类型4种:(1)Article适用于博客文章与新闻内容;(2)FAQPage适用于常见问题段落;(3)HowTo适用于教程与步骤指南;(4)Product适用于电商商品页。每种类型的核心字段需完整填写,避免Schema验证警告。

GEO 要求3:服务端渲染 SSR 替代纯 CSR

大多数AI爬虫不执行JavaScript,纯CSR(Client-Side Rendering)站点对AI搜索几乎不可见。建议迁移到SSR(Server-Side Rendering)或SSG(Static Site Generation)架构。Next.js 13+的App Router、Nuxt 3的universal模式、Remix的全栈渲染都是主流方案。已有CSR站点可考虑Pre-rendering服务(Prerender.io、Rendertron)作为过渡方案。

GEO 要求4:页面响应时间硬性阈值

AI爬虫超时阈值通常为3秒(Googlebot为30秒),慢速页面会被直接放弃抓取。优化建议:(1)服务端响应时间TTFB小于600ms;(2)总页面加载时间小于3秒;(3)压缩HTML/CSS/JS输出体积;(4)使用CDN加速静态资源分发。监测工具:Pingdom、GTmetrix、WebPageTest都提供AI爬虫视角的性能测试。

GEO 要求5:Sitemap.xml 精准列出可索引内容

AI爬虫优先抓取Sitemap内的URL。Sitemap应满足:(1)仅包含可索引的高质量页面排除noindex/canonical非自身的页面;(2)使用lastmod标签精准标记内容更新时间帮助AI爬虫识别新鲜内容;(3)按业务线拆分多个Sitemap文件并通过Sitemap Index聚合;(4)Sitemap文件数量不超过50000条URL单文件大小不超过50MB。

实战档案:3类站点90天高 ROI 技术 SEO 修复对比

以下3类站点档案基于真实客户数据改编(已脱敏),覆盖B2B SaaS、DTC电商、内容媒体3种典型业务模型,展示优先级框架的实际应用价值与修复ROI。

站点1:B2B SaaS 项目管理工具

站点背景:北美B2B SaaS项目管理工具,月活跃用户20万,技术栈React+Next.js。技术SEO初始审计发现修复项总数120项。

按优先级框架排序后的Top 10高ROI修复:(1)修复全站Canonical标签错误(影响5万页面,预计流量增量15%);(2)扩展FAQPage Schema覆盖率从15%提升至80%;(3)优化首页与定价页LCP从3.2s降至1.8s;(4)修复robots.txt误屏蔽/blog/tutorials目录;(5)合并12组关键词自我竞争页面;(6)为/customers目录的客户案例页面添加内链网络;(7)启用Speculation Rules API预渲染Pricing→Demo流程;(8)配置AI爬虫robots.txt允许GPTBot/ClaudeBot/PerplexityBot;(9)压缩首页JS Bundle从800KB降至400KB;(10)添加Article Schema到所有博客文章。

90天修复后数据:自然流量增长35%、Demo申请数月增22%、AI Referral流量从0增长到月8000 Sessions、Core Web Vitals全部页面达标率从40%提升至85%。修复总投入约80个开发人时,估算ROI约18倍。

站点2:DTC 运动鞋电商

站点背景:北美DTC运动鞋品牌,月独立访客50万,技术栈Vue+Nuxt.js。技术SEO初始审计发现修复项总数200项。

按优先级框架排序后的Top 10高ROI修复:(1)扩展Product Schema覆盖率从30%提升至95%;(2)优化商品详情页LCP从4.5s降至2.1s;(3)修复Faceted Navigation(过滤器)的Crawl Trap问题节省Crawl Budget 60%;(4)合并80组重复商品页(颜色/尺码不同的同款);(5)为TOP 100热销产品建立专属Hub页面;(6)优化移动端CLS从0.15降至0.07;(7)启用Speculation Rules API预渲染Cart→Checkout流程;(8)配置AI爬虫robots.txt允许全部主流AI Bot;(9)添加Review Schema与AggregateRating;(10)修复Hreflang标签错误(影响10个语言版本)。

90天修复后数据:自然流量增长40%、自然流量到购买转化率从2.8%升至4.1%、自然流量贡献的月营收增长60%、Rich Snippet展示率从25%提升至78%。修复总投入约120个开发人时,估算ROI约25倍。

站点3:内容媒体科技博客

站点背景:中文科技博客,月独立访客30万,技术栈Hugo静态站点+Cloudflare CDN。技术SEO初始审计发现修复项总数80项。

按优先级框架排序后的Top 10高ROI修复:(1)扩展Article Schema覆盖率到100%;(2)添加FAQPage Schema到Top 200热门文章;(3)建立Topic Cluster架构将500篇文章按主题聚类;(4)优化文章页LCP从2.8s降至1.5s;(5)修复10组关键词自我竞争文章;(6)为热门主题建立Pillar Page聚合相关文章;(7)配置AI爬虫robots.txt并添加更友好的Sitemap.xml;(8)压缩文章页JS(Disqus/Analytics)减少INP;(9)为重要文章添加BreadcrumbList Schema;(10)启用Speculation Rules API预渲染热门文章链接。

90天修复后数据:自然流量增长25%、AI Referral流量月增200%(来自Perplexity/ChatGPT/Claude的Citation Links)、平均阅读时长从2.5分钟增至3.8分钟、订阅转化率从0.3%升至0.6%。修复总投入约40个开发人时,估算ROI约30倍。

技术SEO团队与开发团队高效协作机制

技术SEO的最大执行障碍不是技术问题而是组织协作问题。以下4个机制可显著提升协作效率,降低技术债务积累速度。

机制1:SEO 技术债务看板与开发任务系统打通

建立SEO Technical Debt Backlog与开发任务系统(Jira/Linear/Asana)打通。每个修复任务包含5个标准字段:(1)影响关键词数量;(2)预期流量增量;(3)预估收入增量;(4)开发工时估算;(5)ROI得分。SEO团队负责填写前3项,开发团队负责填写第4项,自动计算ROI得分排序。

机制2:CI/CD Pipeline 集成 SEO 检查

将技术SEO检查项纳入CI/CD Pipeline,PR合并前自动跑:(1)Lighthouse性能与SEO评分;(2)Schema.org结构化数据验证;(3)Canonical标签格式检查;(4)Hreflang一致性检查;(5)robots.txt与meta robots一致性检查;(6)内链与外链可达性检查。任一检查失败自动阻塞PR合并,避免技术SEO回归。

机制3:每周 SEO + 开发 Standup

每周一次15-30分钟的SEO+开发联合Standup,对齐:(1)当周修复进度;(2)阻塞项与协助需求;(3)下周优先任务确认;(4)紧急修复项响应。Standup形式可Zoom/Meet或Slack异步Update,关键是固定节奏避免任务长期积压。

机制4:季度 SEO + 开发联合 Retrospective

每季度一次SEO+开发联合Retrospective,回顾:(1)当季度修复任务的实际ROI vs 预估ROI差异;(2)哪类修复ROI明显高于预估应该优先扩展;(3)哪类修复ROI明显低于预估应该停止或调整;(4)下季度优先级调整建议。Retrospective输出会议纪要存档供未来参考,避免重复犯同样的判断错误。

常见问题解答

技术SEO优先级排序的5个核心维度是什么?

5个核心维度按重要性递减:(1)快速胜利Quick Wins,影响大投入小如修复模板级canonical错误一次影响数万页面;(2)对核心KPI的预期影响,能直接影响收入流量转化率的修复优先;(3)对用户体验的影响,Core Web Vitals与INP指标越来越重要;(4)与Google最新指南的对齐程度,2025年12月Google明确非200状态码页面可能被排除渲染管线;(5)行业变化与算法更新,包括AI搜索引擎对技术基础设施的新要求。建议用艾森豪威尔矩阵可视化任务清单。

什么是 Silo 架构?为什么它对技术SEO如此重要?

Silo架构是围绕关键词主题族群组织URL结构与导航层级的架构方法,每个主题拥有明确的Hub页面(枢纽页)与一组通过内链形成主题闭环的支撑页面。重要性4个:(1)让爬虫高效理解网站主题层级;(2)集中PageRank到核心Hub页面;(3)减少关键词自我竞争(Keyword Cannibalization);(4)AI搜索时代向LLM发送强主题相关性信号提升被引用概率。典型实施案例:电商站电动工具→电钻/电锯/砂光机→具体产品页的三级Silo结构。

Crawl Budget(抓取预算)何时需要重点优化?

Crawl Budget优化4类典型场景:(1)站点页面数超过10000个,Googlebot每日抓取量有限;(2)站点频繁更新(每日新增超过100页)需要快速被索引;(3)GSC的Crawl Stats报告显示Googlebot抓取5xx错误率超过5%;(4)日志分析显示Googlebot浪费大量预算抓取低价值页面(如分页/过滤参数页/重复内容)。优化手段:robots.txt屏蔽低价值路径、Canonical标签去重、XML Sitemap精准提交、404页面快速清理、服务端响应时间优化到200ms以内。

Core Web Vitals 与 INP 指标如何影响技术SEO优先级?

Core Web Vitals对SEO优先级的硬性要求:(1)LCP需在2.5秒内完成,超过4秒为差;(2)INP(2024年3月替代FID)需在200ms内完成,超过500ms为差;(3)CLS需小于0.1。Google已将Core Web Vitals纳入排名信号,差等级页面会面临直接降权。优化优先级建议:先修复CLS(成本低见效快)→再修复LCP(资源加载与服务端渲染优化)→最后修复INP(JS执行时间优化与Web Worker拆分)。预期改善幅度LCP降低30%-50%、INP降低20%-40%、CLS降低60%-80%。

AI搜索时代(GEO)的技术SEO新要求有哪些?

GEO(Generative Engine Optimization)时代的5个新技术要求:(1)支持AI爬虫(GPTBot/ClaudeBot/PerplexityBot/Google-Extended)的robots.txt正确配置;(2)页面结构化数据(Schema.org)覆盖率提升到80%以上,FAQPage/HowTo/Article/Product是必备类型;(3)服务端渲染SSR替代纯CSR,因为大多数AI爬虫不执行JavaScript;(4)页面响应时间优化到200ms以内,AI爬虫超时阈值通常为3秒;(5)Sitemap.xml精准列出可索引内容,AI爬虫优先抓取Sitemap内的URL。

技术SEO修复的优先级矩阵如何具体落地?

艾森豪威尔矩阵落地4象限:(1)紧急且重要——立刻修复,如全站noindex误标、robots.txt误屏蔽、SSL证书过期、5xx错误激增;(2)重要但不紧急——排进Sprint,如Silo架构优化、Schema.org扩展、Core Web Vitals优化;(3)紧急但不重要——委派或自动化,如低优先级页面的404重定向、过期内容清理;(4)不紧急不重要——直接删掉或忽略,如对核心KPI无影响的微优化。建议每月初SEO团队与开发团队联合排序当月任务清单,按4象限分配资源。

技术SEO审计应该一次性覆盖全站还是分阶段?

强烈建议分阶段而非一次性全站审计,原因4个:(1)一次性全站审计输出修复清单可能上千项,团队无法消化反而瘫痪;(2)资源有限时全站修复周期超过6个月失去时效性;(3)不同业务线的修复优先级不同,需要逐个评估;(4)跑通一个业务线的完整闭环(审计→修复→验证→推广)后再复制到其他业务线,组织学习曲线更优。建议第一阶段聚焦贡献70%营收的核心产品线或核心关键词群,跑通后再向外扩展。

技术SEO团队如何与开发团队高效协作?

高效协作4个核心机制:(1)建立SEO技术债务看板与开发任务系统打通(Jira/Linear),每个修复任务标注影响关键词数量、预期流量影响、ROI预估;(2)将技术SEO检查项纳入CI/CD Pipeline,PR合并前自动跑Lighthouse、Schema.org验证、Canonical检查;(3)每周SEO+开发15分钟Standup对齐当周修复进度;(4)季度一次SEO+开发联合Retrospective回顾历史修复ROI,调整下季度优先级。避免做法:仅通过邮件传递修复需求、把所有任务塞给开发不分优先级、不跟踪修复后的实际效果。

权威参考资料

FAQPage + Article AI 引用友好版

技术SEO优先级排序实战指南:用艾森豪威尔矩阵把开发资源花在刀刃上,覆盖Silo架构优化、Crawl Budget管理、Core Web Vitals提升、INP指标改善、AI搜索GEO技术准备5大模块,附3类站点90天高ROI修复清单。

- GEO

- 技术SEO

- GEO优化

- 网站架构

- 抓取索引

- Core Web Vitals

- Crawl Budget

- Silo架构

- 谷歌SEO

title: 技术SEO优先级指南:3类站点高ROI修复实战 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/technical-seo-priorities-guide.html published: 2026-02-10 modified: 2026-05-16 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《技术SEO优先级指南:3类站点高ROI修复实战》

本文链接:https://zhangwenbao.com/technical-seo-priorities-guide.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0