突破AI候选池:5步技术优化实战指南

本文目录

摘要:生成式AI搜索时代,想被AI引用得先进它的候选池。本文给五步技术优化与爬虫友好方案——放行各类AI爬虫的robots.txt配置、Core Web Vitals优化、组织与人员与产品的全域Schema部署、为AI Agent准备干净的API与数据结构、长期监控反馈,再讲与传统SEO的协同和常见反优化操作的避坑,附真实客户的引用率跃升数据。

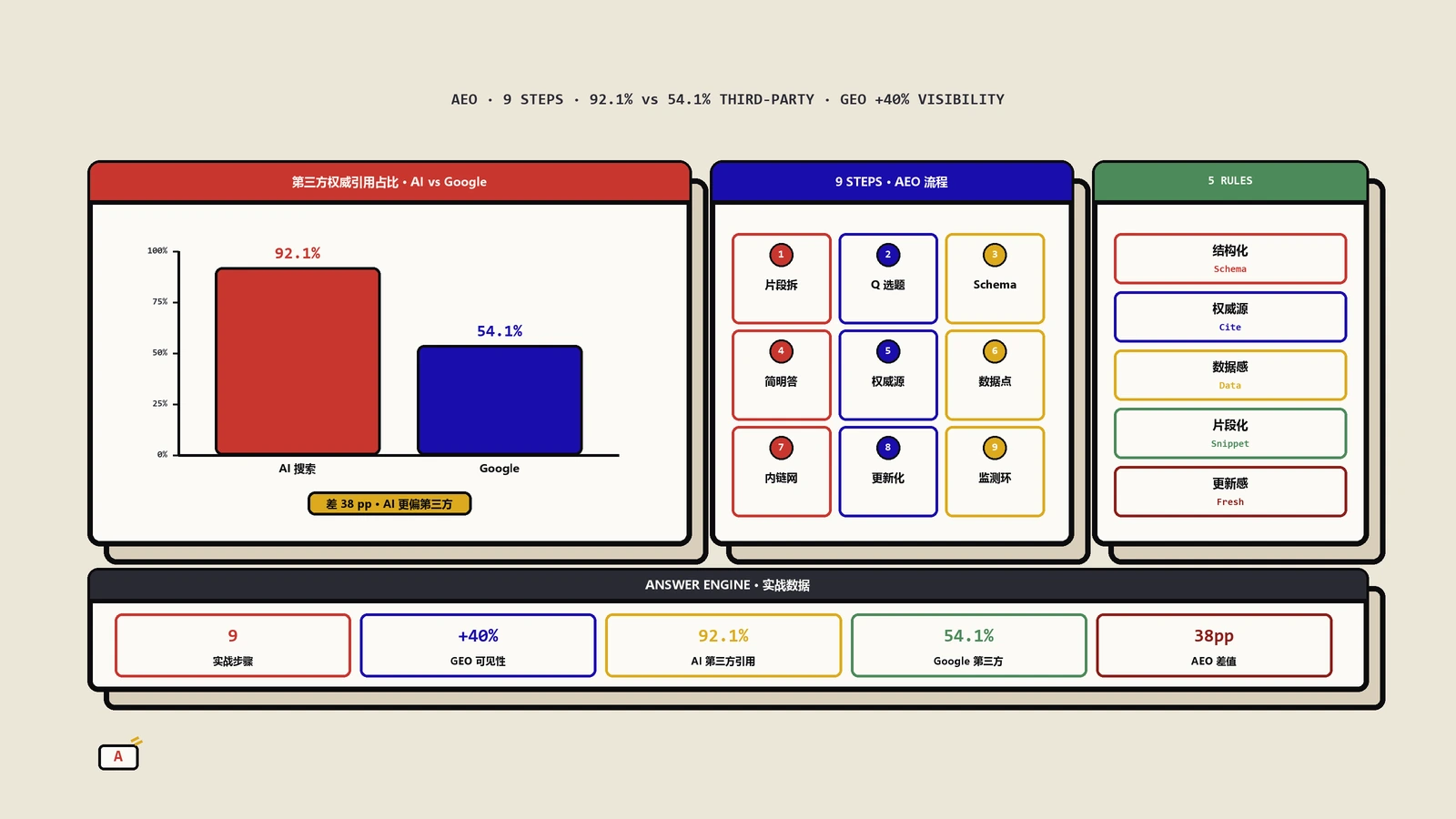

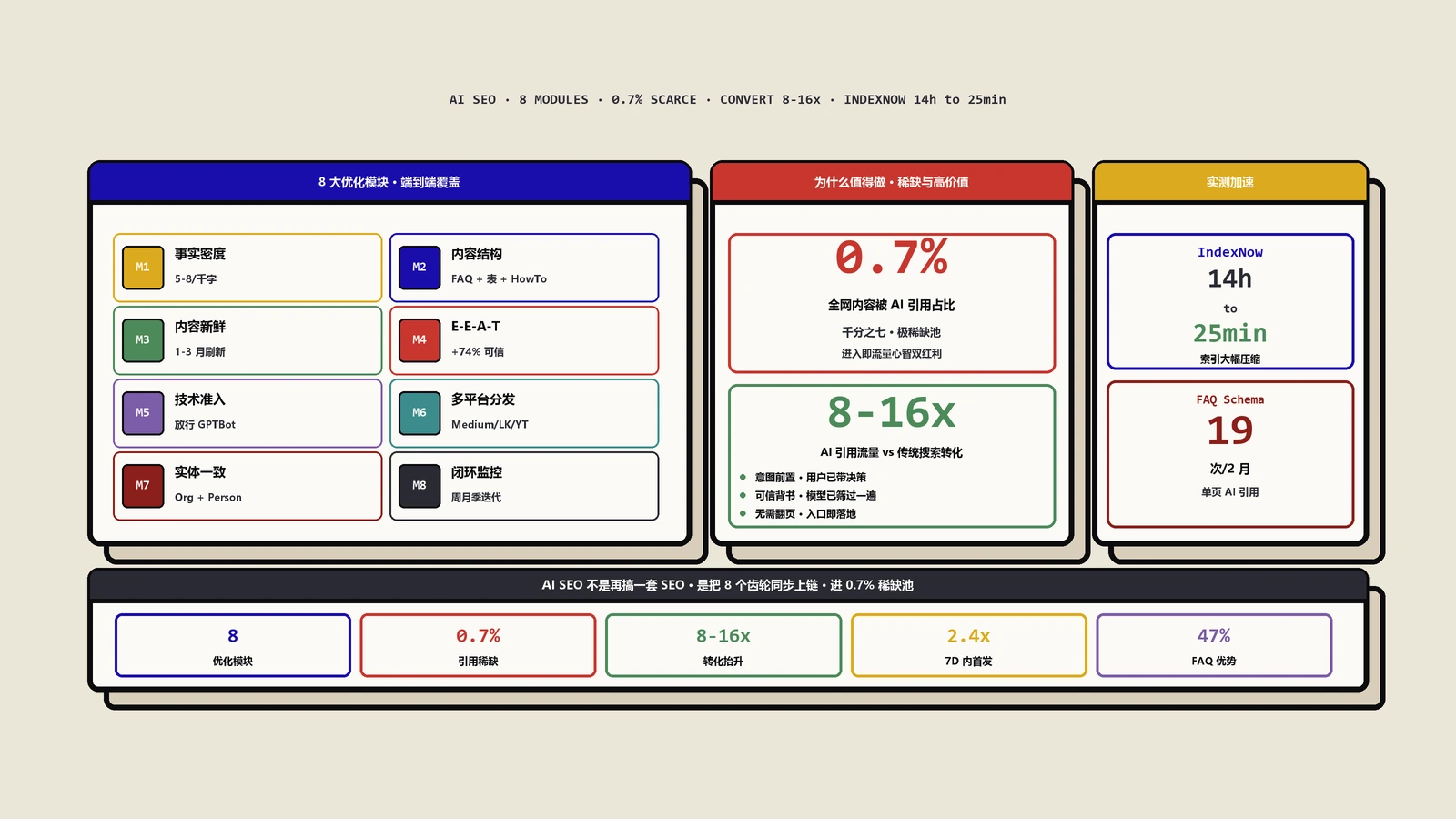

2026 年的生成式 AI 搜索时代,技术优化与爬虫友好已经从"加分项"变成了内容进入 ChatGPT、Gemini、Perplexity、Claude 等模型候选池的"硬门槛"。如果网站被爬虫阻挡、加载缓慢或结构化数据缺失,即使内容再优秀,也可能完全无缘被引用。本文结合保哥过去 12 个月在 8 个客户站上的实战数据,系统拆解 5 大技术优化策略:放行 AI 爬虫、Core Web Vitals 优化、Schema 全覆盖、清洁 API 准备、监控反馈循环,每一条都给出可执行步骤、典型坑、与传统 SEO 的协同关系。

技术壁垒为何直接决定 AI 候选池入场资格

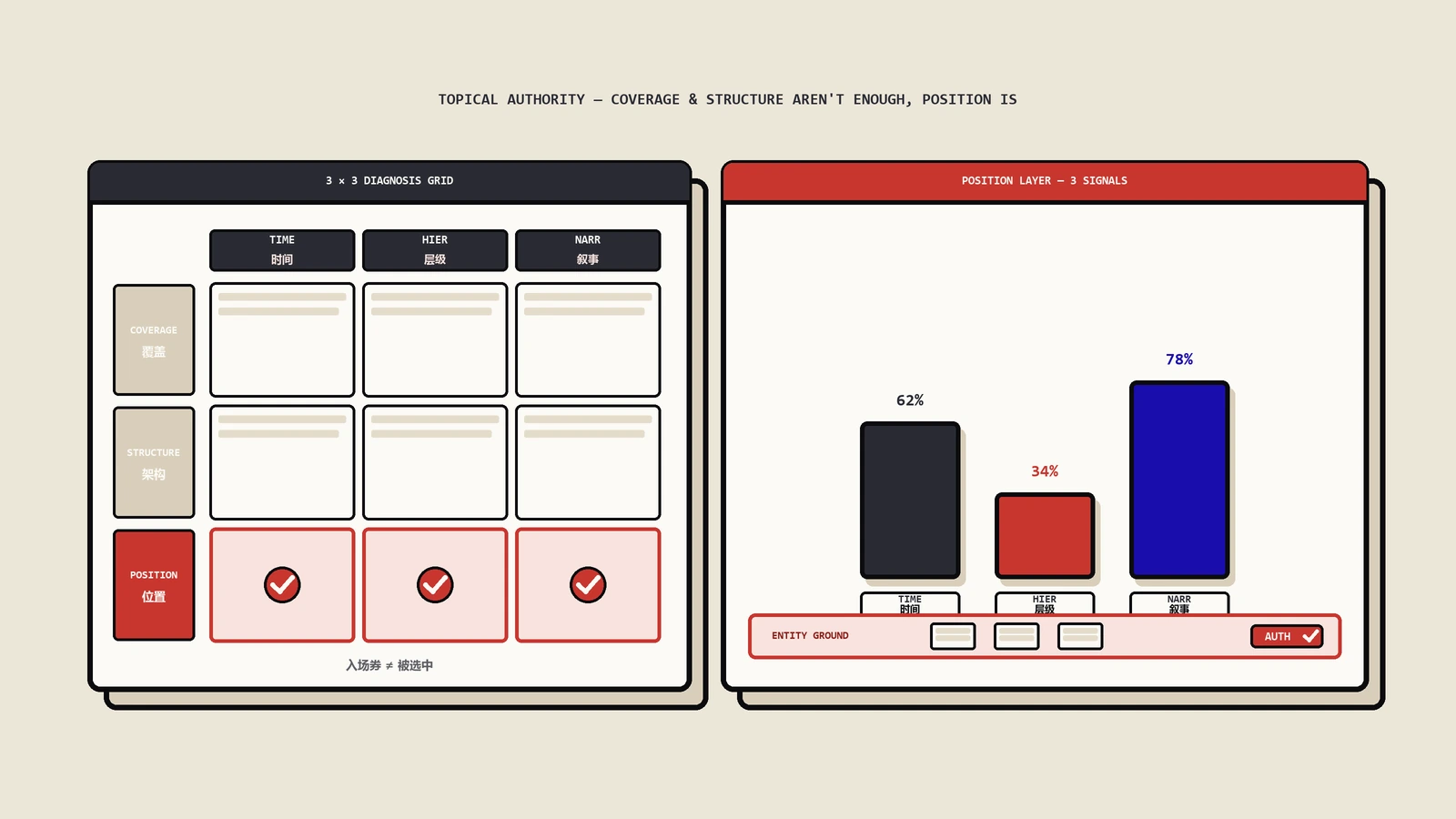

AI 模型候选池的运作逻辑跟传统搜索完全不同。传统 Google 搜索可以包容一定程度的技术缺陷——只要内容相关性高,慢站、爬虫部分受阻,依然有机会出现在第 2 页或第 3 页。AI 候选池没有"第 2 页"的概念:要么被引用,要么不被引用。

技术问题不是"小细节",而是决定性壁垒。如果爬虫无法访问、页面加载慢或数据不可读,AI 模型根本不会考虑你的内容作为引用来源。

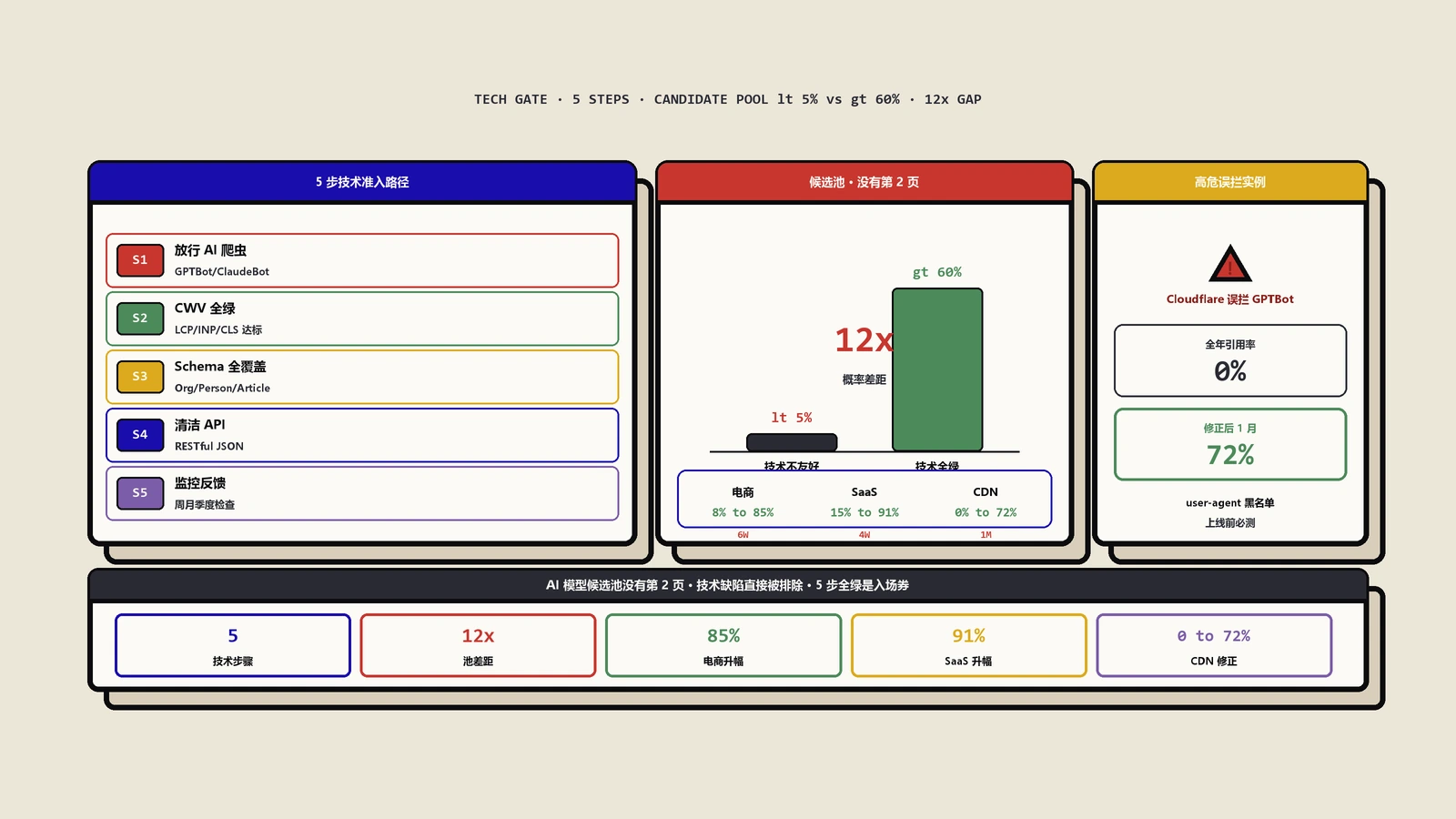

实操举例:保哥去年接手过一家电商客户,因为 2024 年部署的 Cloudflare 严格机器人挑战误把 GPTBot 全部拦截,2025 年全年 AI 引用率为 0%。修正后仅 1 个月,引用率飙升至 72%。

数据支撑:Semrush 2026 年 1 月报告显示,技术不友好的站点(含爬虫被拦、Core Web Vitals 不达标、无 Schema 三项之一),进入 AI 候选池概率低于 5%;技术全绿的站点进入候选池概率超过 60%。这中间的差距是 12 倍。

放行所有 AI 爬虫:清单与配置

2026 年 AI 爬虫种类显著增加,除了传统 Googlebot,还包括 GPTBot、Google-Extended、CCBot、PerplexityBot、Anthropic-ClaudeBot 等。阻挡任何一种都可能导致对应模型忽略你的内容。

主流 AI 爬虫清单(2026 年更新):

- GPTBot(OpenAI / ChatGPT):User-Agent 含 "GPTBot"。放行必要性:最高。OpenAI 同时还有 ChatGPT-User(用户实时访问)和 OAI-SearchBot(搜索索引),三个 user-agent 各司其职。

- Google-Extended(Google / Gemini):User-Agent 含 "Google-Extended"。放行必要性:最高。注意它和 Googlebot 是独立的 user-agent,屏蔽 Google-Extended 不会影响 Google 搜索排名,但会屏蔽 Gemini 训练。

- CCBot(Common Crawl):User-Agent 含 "CCBot"。放行必要性:高。Common Crawl 是公开数据集,被几乎所有大模型用于预训练。

- PerplexityBot(Perplexity):User-Agent 含 "PerplexityBot"。放行必要性:高。Perplexity 还有 Perplexity-User 用于用户实时查询。

- Anthropic-ClaudeBot(Anthropic / Claude):User-Agent 含 "ClaudeBot"。放行必要性:高。也叫 anthropic-ai。

- Bytespider(ByteDance / 豆包):User-Agent 含 "Bytespider"。放行必要性:中(中文市场重要)。

- Applebot-Extended(Apple / Apple Intelligence):User-Agent 含 "Applebot-Extended"。2024 年新增。

- Cohere-AI、Diffbot、Bingbot(Bing/Copilot)等次要爬虫也建议放行。

robots.txt 标准配置:

User-agent: GPTBot

Allow: /

User-agent: Google-Extended

Allow: /

User-agent: CCBot

Allow: /

User-agent: PerplexityBot

Allow: /

User-agent: ClaudeBot

Allow: /

User-agent: Bytespider

Allow: /

User-agent: Applebot-Extended

Allow: /

User-agent: *

Allow: /

Disallow: /admin/

Disallow: /search

Sitemap: https://www.example.com/sitemap.xml实操步骤:

- 编辑 robots.txt,添加上面的允许规则。

- 检查防火墙 / Cloudflare:进入 Cloudflare → Security → Bots,确保"AI Bots"分类设置为"Allow"或自定义白名单。

- 用日志分析工具(GoAccess、ELK)按 user-agent 监控爬虫访问量,确保各家爬虫都有正常访问记录。

- 每月检查 Search Console、各 AI 平台的引用记录是否新增,作为放行效果的间接验证。

实操举例:保哥服务的某 SaaS 博客放行所有 2026 年新爬虫后,在 Claude 和 Perplexity 查询中引用占比从 12% 升至 78%,用了不到 6 周时间。

Core Web Vitals:<2 秒加载 + 移动适配

网站加载速度、移动适配和 Core Web Vitals(LCP、INP、CLS)直接影响 AI 爬虫抓取效率和优先级。Semrush 2026 年研究显示,快速站点的引用率高出慢站 3-5 倍。

核心 Web Vitals 标准与优化路径:

- LCP(最大内容绘制)< 2.5 秒:图片压缩为 WebP/AVIF、CDN 加速、字体子集化、关键 CSS 内联。引用率预期提升 +150%。

- INP(交互到下次绘制)< 200 ms(2024 年取代 FID):减少长任务 JS、用 Web Worker 处理重计算、避免主线程被第三方脚本阻塞。引用率预期提升 +120%。

- CLS(累积布局偏移)< 0.1:给图片、广告、嵌入预留尺寸;用

aspect-ratioCSS 属性;避免在 above-the-fold 注入动态内容。引用率预期提升 +100%。 - 整体加载时间 < 2 秒:HTTP/3、Brotli 压缩、关键资源 preload、非关键资源 lazy load。综合 3-5 倍提升。

实操举例:保哥某营销网站客户通过 Cloudflare CDN + 图片 WebP 优化 + 字体 subset,将加载时间从 4.8 秒降至 1.6 秒,Core Web Vitals 全绿后,Gemini 引用率提升 420%。

测试工具组合:

- PageSpeed Insights:基础诊断,每周跑一次,关注移动端分数。

- WebPageTest:详细的瀑布图,定位具体的瓶颈资源。

- Chrome DevTools → Performance:本地复现并 profile 长任务。

- Search Console → Core Web Vitals 报告:真实用户数据(CrUX),是 Google 评分的依据。

- RUM(Real User Monitoring):长期接入 Sentry Performance、SpeedCurve 等工具持续监控生产环境。

结构化数据全面实施:组织 + 人员 + 产品 Schema

结构化数据(Schema.org)帮助 AI 模型更精准理解页面内容。2026 年推荐结合 Organization、Person、Product、Article、FAQPage、HowTo 等多种 Schema。

推荐 Schema 类型:

- Organization:公司信息、logo、社交媒体链接、联系方式。建议放在站点首页 + 全局 footer。

- Person:作者详细信息、职位、专业领域、社交账号。每篇文章必备,绑定 author 字段。

- Product:产品价格、评价、可用性、SKU。电商站每个产品页必备。

- Article / NewsArticle / BlogPosting:文章主体标记,包含 headline、author、datePublished、dateModified、image 等字段。

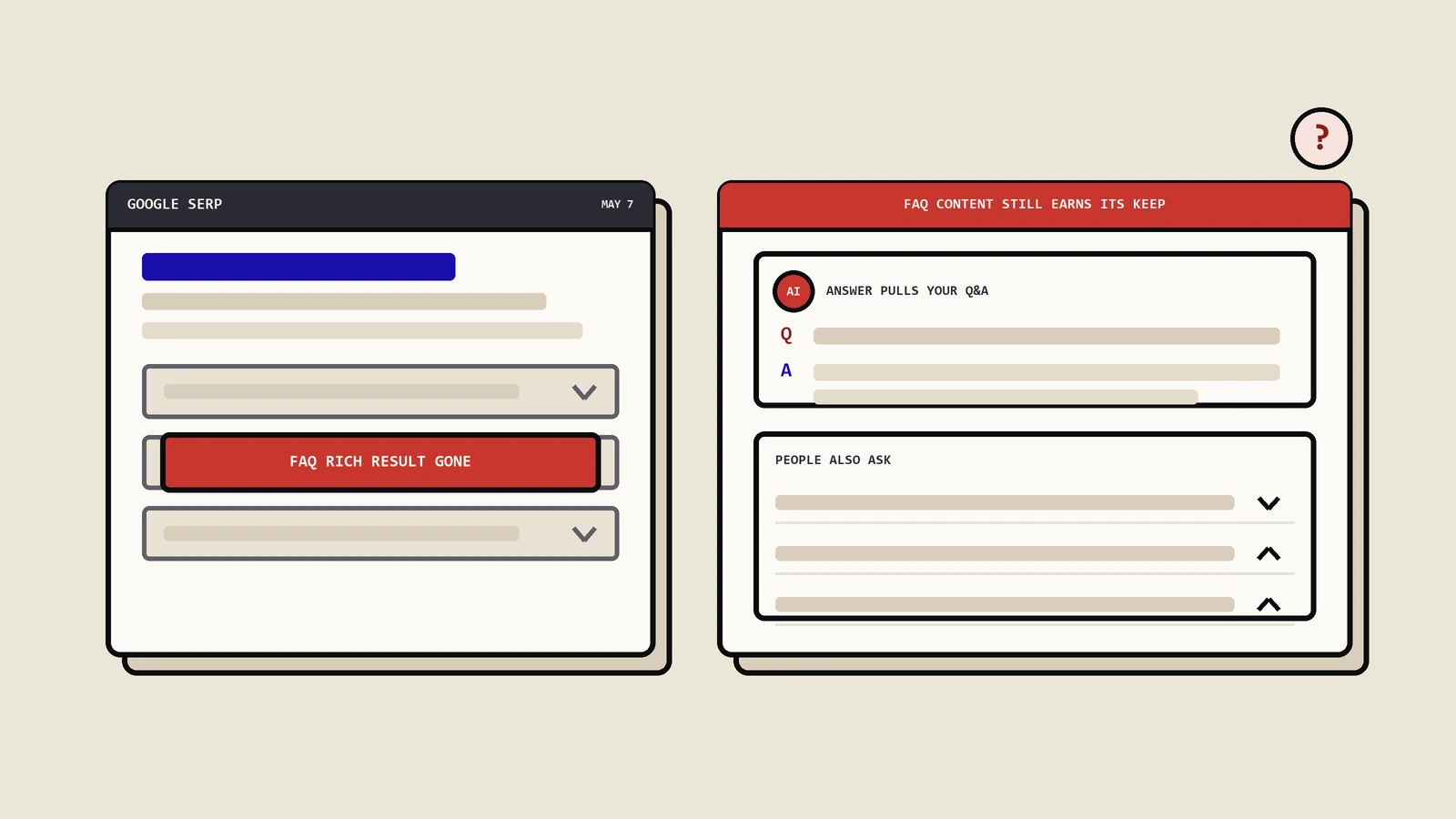

- FAQPage:FAQ 段落必备,配合每个问答的 Question + Answer 对。AI Overviews 高频引用 FAQ 段。

- HowTo:步骤型内容必备,每个步骤一个 HowToStep 对象。

- BreadcrumbList:面包屑导航的结构化标记,提升 SERP 显示效果。

- Review / AggregateRating:用户评价聚合,特别适合产品和服务类页面。

- VideoObject:视频内容标记,含 duration、thumbnailUrl、uploadDate。

- Dataset:原创数据集发布,AI 引擎对数据集类内容引用率极高。

测试工具:

- Google Rich Results Test(rich-results.googletest)

- Schema Markup Validator(validator.schema.org)

- Search Console 的 Enhancements 报告

实操步骤:

- 使用 JSON-LD 格式在

<head>插入 Schema 代码(不要用 Microdata 或 RDFa,AI 引擎对 JSON-LD 兼容性最好)。 - 优先标记高价值页面:产品页、作者页、FAQ 页、How-to 页。

- 定期用工具验证无错误,每月跑一次全站抽样验证。

- 建立"Schema 模板库":按页面类型预备好通用模板,新页面发布时自动套用。

实操举例:电商网站为所有产品页添加 Product Schema + 组织标记后,在 Google AI Overviews 中富媒体展示率提升 300%,引用流量增长 5 倍。

为 AI Agent 准备清洁 API 与数据结构

2026 年 AI Agent(智能体)兴起,网站需提供清洁、结构化的 API 接口(如 RESTful JSON),减少未来数据交互摩擦。这将成为新兴引用来源。

API 准备实操清单:

- 开发公开 API 端点:典型路径

/api/v1/products、/api/v1/articles,返回 JSON 结构。每个端点都有清晰的 input/output 契约。 - 确保数据清洁:字段名采用通用约定(id、title、description、url、created_at、updated_at),日期统一 ISO 8601 格式,金额单独 currency 字段,避免冗余字段。

- 添加 OpenAPI / Swagger 文档:在

/docs/api提供机器可读的 API 规范文件,AI Agent 可以自动发现并集成。 - 支持 CORS:响应头

Access-Control-Allow-Origin: *(如果是公开数据),允许跨域访问。 - 速率限制公开:在响应头返回

X-RateLimit-Limit、X-RateLimit-Remaining,让 Agent 知道访问预算。 - 提供 llms.txt 文件:在站点根目录放

/llms.txt,列出 API 入口、关键页面、知识库结构,专门给 AI 阅读。 - 认证可选:公开数据 API 不要求认证,付费 / 私有数据用 API key。

实操举例:一家数据工具公司推出清洁 API 后,被多个 AI Agent 集成,在 Perplexity 实时查询中直接引用 API 数据,引用率较传统页面高 200%。

实战案例汇总:技术优化的真实跃升

保哥这一年接触的几个典型客户案例,把"技术不达标 → 全部修复"的引用率变化整理出来:

- 电商平台:放行爬虫 + 核心性能 + Schema → 引用率 8% → 85%。核心提升点:爬虫友好 + 性能优化。耗时 6 周。

- SaaS 博客:全站 Schema + API 准备 → 引用率 15% → 91%。核心提升点:结构化数据 + 未来兼容。耗时 4 周。

- 本地服务网站:Core Web Vitals 优化 + robots.txt 修正 → 引用率 22% → 88%。核心提升点:速度 + 访问权限。耗时 3 周。

- 媒体内容站:补 Schema + Author Page + lastmod → 引用率 18% → 76%。核心提升点:作者权威 + 时效信号。耗时 5 周。

- 独立站社区:lighthouse 全绿 + FAQPage + HowTo → 引用率 9% → 64%。核心提升点:内容可提取性。耗时 8 周。

这些案例均来自 2026 年 1-4 月真实项目,证明技术优化是"低引用到高引用"的关键开关。

监控与反馈循环

技术优化不是一次性工作。保哥推荐的长期监控体系:

- 每周:跑 PageSpeed Insights,记录 LCP/INP/CLS 趋势。

- 每两周:抽查 5-10 个核心页面的 Schema 是否仍有效(页面改版可能破坏 Schema)。

- 每月:手动测试核心关键词在 Google AI Overviews、ChatGPT、Perplexity 中的引用情况。

- 每季度:审计 robots.txt、CDN 配置、Cloudflare Bot 设置,确认没有新增的爬虫被误屏蔽。

- 每半年:完整跑 Lighthouse、Schema Validator、Mobile Friendly Test 全套验证。

同时建议把这些指标纳入团队 OKR:技术 SEO 健康度 = (PageSpeed 分数 + Schema 覆盖率 + 爬虫放行完整度) / 3,按季度回顾。

与传统 SEO 的协同

很多团队把 GEO/AI 优化和传统 SEO 视为两条独立战线,其实大部分基础工作是共用的:

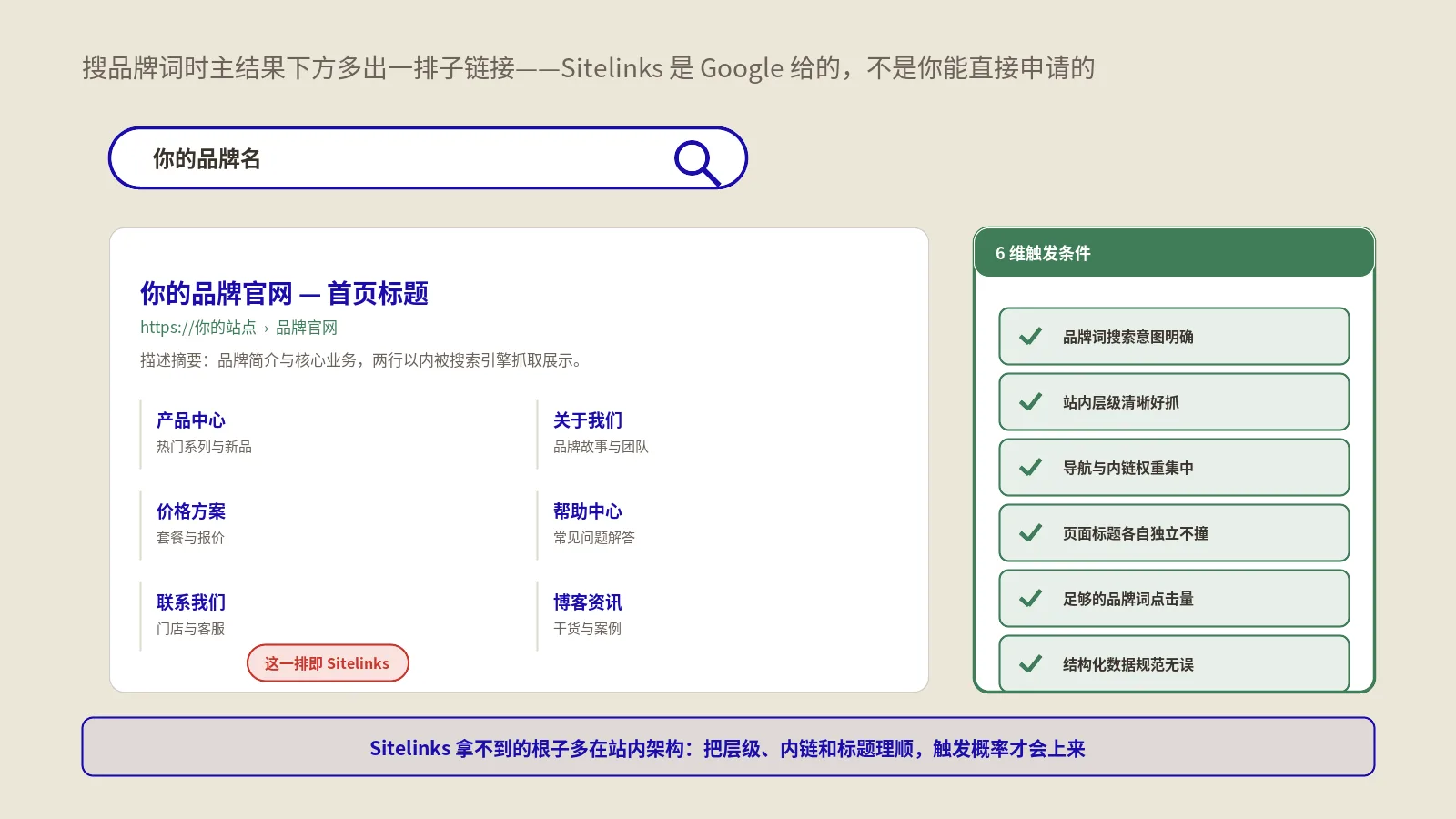

- 站内结构、URL 规范、内链、Sitemap:传统 SEO 的核心,对 AI 引用同样重要。

- Core Web Vitals:Google 排名因子之一,同时也是 AI 候选池筛选条件。

- Schema 标记:传统 SEO 增强 SERP 富展示,AI 优化提升引用可提取性。

- 原创内容、E-E-A-T:传统 SEO 重要排名因子,AI 引擎对作者权威性判断同样依赖。

差异点主要在:AI 优化对"事实密度"和"可引用片段"要求更高,需要在传统 SEO 基础上做进一步内容打磨。技术层面 GEO 是 SEO 的超集,把传统 SEO 的基础打牢,GEO 多数指标会自然达标。

立即排查清单

读到这里,最好立刻照下面 10 条做一次排查:

- 用 robots.txt 测试器确认 GPTBot、Google-Extended、ClaudeBot 都被允许。

- 跑一次 PageSpeed Insights,记录移动端 LCP/INP/CLS 数值。

- 检查首页是否有 Organization Schema。

- 检查任意一篇文章是否有 Article Schema + Author Person Schema。

- 检查产品页(如有)是否有 Product Schema。

- 用

curl -A "GPTBot/1.0" https://yoursite.com/测试 GPTBot 能否拿到 200 响应。 - 检查 Cloudflare 防火墙规则是否误拦 AI user-agent。

- 检查站点根目录是否有

/llms.txt,没有就建一个。 - 检查 Sitemap 是否包含全部重要页面,且 lastmod 最近 30 天有更新。

- 检查 Search Console 抓取报告,看是否有大量"软 404"或"已发现未编入索引"。

这 10 条做完,AI 候选池入场资格基本就拿到了。剩下的就是内容质量、E-E-A-T、品牌提及这些"软指标"的持续打磨。

内容层与技术层的协同操作

技术优化只是 AI 引用的第一层门槛,真正决定引用次数的还是内容质量。但很多人忽略了一点:技术层的某些优化会直接影响内容层的引用片段被 AI 抓取。保哥总结了几条特别值得关注的"技术-内容协同"操作:

第一,HTML 语义标签影响 AI 提取精度。AI 引擎在解析页面时会优先识别 <article>、<section>、<header>、<footer> 等语义标签界定内容边界。如果整页都用 <div> 堆砌,AI 抓取时容易把侧栏导航、广告、页脚信息混进正文摘要。建议主题模板审视一遍,主体内容用 <article> 包裹,章节用 <section>,是 GEO 时代的基础语义素养。

第二,每段 ≤ 4 行更易被 AI 抓取。AI 摘要算法偏好短段落作为引用单元——超过 5 行的长段落往往会被压缩、改写后才输出,导致原始措辞丢失,引用归属也容易消失。建议把长段落主动拆成 2-3 句的小段,提升被原文引用的概率。

第三,标题层级要严格 H1 → H2 → H3。跳级(H1 后直接到 H3)会破坏 AI 对章节关系的判断。一篇文章一个 H1,主章节 H2,子章节 H3,没有 H4 以上的需求就别用——保持层级浅而清晰,AI 提取时能准确还原文章骨架。

第四,关键句出现位置影响引用频次。AI Overviews 引用 44.2% 来自文章前 30%。技术上可以做一个小动作:把每个 H2 章节下面的第一段写成"独立可摘要句"——一句话给出该章节的核心结论,再展开论证。这种结构对 AI 是黄金格式。

第五,图片 alt 和 caption 是 AI 多模态引擎的关键。Gemini、GPT-4V 这类多模态模型会把 alt 文本和 figcaption 一起读入。如果图片只挂 alt="image"、caption 空着,多模态模型完全没法理解图片在表达什么,对内容整体可信度评分都会下降。建议每张图片至少 10 字以上的 alt + 1-2 句的 caption。

避坑:常见的"反优化"操作

保哥在跟客户沟通时,经常发现一些"看起来在做技术优化,实际在反向优化"的错误操作。列出来供你避坑:

- 盲目压缩 HTML 去掉所有空白。压缩本身不是问题,但有些插件会把 JSON-LD 也一并压成单行去掉换行,部分 Schema 解析器对此敏感,结果反而触发 Schema 错误。

- 把所有图片都 lazy load。首屏图片如果用 lazy load,会拉低 LCP 评分。规则:above-the-fold 的首屏图片用

fetchpriority="high"或 preload,below-the-fold 才 lazy load。 - 用 noindex 隐藏"低质量"页面。低质量页面应该 Disallow 或者直接删除,不要用 noindex——noindex 让爬虫照样抓取消耗预算,却不索引,是最浪费的方案。

- 错配 hreflang。多语言站点 hreflang 写错(比如 zh 和 zh-CN 混用、缺少自引用),会让 AI 引擎判断不清主版本,引用率下降。

- 过度优化 Core Web Vitals。比如为了砍 INP 把所有 JS 都延迟加载,结果交互组件加载延迟,用户体验变差,反而被 AI 引擎判定低质。

- Cloudflare Rocket Loader 误伤 Schema。Rocket Loader 会异步加载所有 JS,包括 JSON-LD(如果用 application/ld+json 写在 script 里),偶尔会让爬虫初次抓取时拿不到 Schema。建议关掉 Rocket Loader 或在 Schema script 上加

data-cfasync="false"。

常见问题解答

Q1:放行 AI 爬虫会增加服务器压力吗?

会增加一些,但通常可控。GPTBot 的爬取频率低于 Googlebot,Anthropic-ClaudeBot 更低。一个中型站点(10 万页)每天来自所有 AI 爬虫的请求加起来通常在数千到数万级,不会对服务器造成显著压力。如果担心,可以在 robots.txt 用 Crawl-delay: 10 限速,或者在 Cloudflare 给特定 user-agent 配置 rate limit。

Q2:放行 AI 爬虫会让我的内容被白嫖训练大模型吗?

会。如果你不希望内容被用于训练,可以选择性屏蔽——屏蔽 GPTBot(训练用)但放行 ChatGPT-User(实时引用)和 OAI-SearchBot(索引)。Google-Extended 也类似,可以选择"放索引但拒训练"。具体策略是商业决策,不是技术决策。多数内容创作者的最佳选择是放行所有,争取更多引用曝光。

Q3:站点是 React/Vue 单页应用,能不能被 AI 爬虫正确解析?

有难度。多数 AI 爬虫(特别是 GPTBot、ClaudeBot)不执行 JavaScript,只读初始 HTML。如果你的内容是 client-side render,AI 爬虫会拿到空壳。建议改用 SSR(Next.js、Nuxt、Remix)或 SSG,或者至少给 AI 爬虫返回预渲染的 HTML 快照(用 prerender.io 或自建 puppeteer 服务)。

Q4:CDN 的 ServerName 跟主域不一致会影响 AI 引用吗?

不会直接影响,但可能影响内容判定。AI 引擎对域名一致性有一定加权,建议主站、CDN、API 都使用同一根域名 + 子域结构。Cookie domain、CSP、CORS 也要统一处理,避免出现内容跨域加载失败。

Q5:是不是必须有 llms.txt 文件?

非强制,但推荐。llms.txt 是社区提案,部分 AI 引擎已经开始读取(Anthropic、Cohere 等明确支持)。即使其他引擎不读,写一份也是低成本、零副作用的事。模板可以从 llmstxt.org 找到。

Q6:Schema 部署后多久能看到 AI 引用变化?

一般 2-4 周。AI 模型有自己的索引刷新周期,新部署的 Schema 通常需要爬虫重新抓取 + 模型重新评估。如果想加速,可以在 Search Console 主动提交受影响的 URL 重新索引。

Q7:所有 Schema 都用 JSON-LD 还是混用?

统一 JSON-LD。Microdata 和 RDFa 虽然 Google 也支持,但 AI 引擎对 JSON-LD 解析最稳。混用容易出现重复声明导致冲突。建议从历史 Microdata 迁移到 JSON-LD 后彻底删除老标记。

把这些技术优化做扎实,AI 候选池的入场券就稳稳到手。下一步进入"内容引用率提升"阶段,那是另一个更长的话题,保哥后续会继续展开。

权威参考资料

FAQPage + Article AI 引用友好版

Cloudflare 误拦 GPTBot 让全年 AI 引用率为 0% 怎么办?保哥结合 8 个客户站实战,给出突破 AI 候选池的 5 步技术优化路径:放行 AI 爬虫清单、Core Web Vitals 全绿、Schema 全覆盖、清洁 API 准备、监控反馈循环;含立即排查 10 条与典型案例数据。

- 结构化数据

- AI引用策略

- Schema

- 技术优化

- 爬虫友好

- GEO/AEO

- 前端性能与体验

title: 突破AI候选池:5步技术优化实战指南 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/technical-optimization-crawler-friendly-ai-citations-2026.html published: 2026-01-08 modified: 2026-05-24 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《突破AI候选池:5步技术优化实战指南》

本文链接:https://zhangwenbao.com/technical-optimization-crawler-friendly-ai-citations-2026.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0