关键词难度KD怎么算?为何各家工具差大?1000站10步实测

本文目录

- 一个被当成红绿灯用的分数,到底在量什么?

- 各家工具的KD是怎么算出来的?

- Moz:第一个把“难度”做成分数的

- Ahrefs:几乎只盯着引用域数量的那条回归线

- Semrush和其他:混合信号的黑箱

- “对数尺度”和“标定样本”到底在干嘛?

- 为什么同一个关键词,各家给的KD能差一倍?

- 它们抓的SERP根本不是同一张快照

- 链接数据库的大小天差地别

- 公式里塞的东西本来就不一样

- 个性化、本地化和时间滞后:你和工具看到的从来不是同一个页面

- KD高就不能做、KD低就好做吗?这是最大的误用

- KD看不见搜索意图,而意图决定你压根能不能挤进去

- KD看不见SERP里的那几个软肋

- KD看不见你自己的相对实力

- 那KD还有什么用?保哥怎么把它用对

- 分桶的阈值,该怎么定才不拍脑袋?

- 把KD、搜索量、点击空间一起看会更准吗?

- 不看KD,怎么真正判断一个词能不能打?

- 读懂首页十条,比任何分数都准

- 一个反直觉的真实案例

- KD在AI搜索时代还算数吗?

- 常见问题解答

- 关键词难度多少分以上就不该做了?

- 为什么同一个词Ahrefs和Semrush的KD差那么多?

- KD和搜索意图是一回事吗?

- 新站选词应该只挑KD低的词吗?

- 国内站长工具给的关键词难度能信吗?

- AI搜索普及后还需要看KD吗?

- 同一个工具里KD可以直接拿来排序选词吗?

摘要:同一个词Ahrefs给38、Semrush给61、站长工具给89,没人错——它们各用手里不完整的链接数据回归出近似分,量的不是同一个东西,比绝对值本身就是误用。KD看不见搜索意图、看不见SERP里可超越的软肋页、更看不见你站的相对实力。正确用法是同一工具内相对分桶粗筛,再回到读SERP判断真实机会。

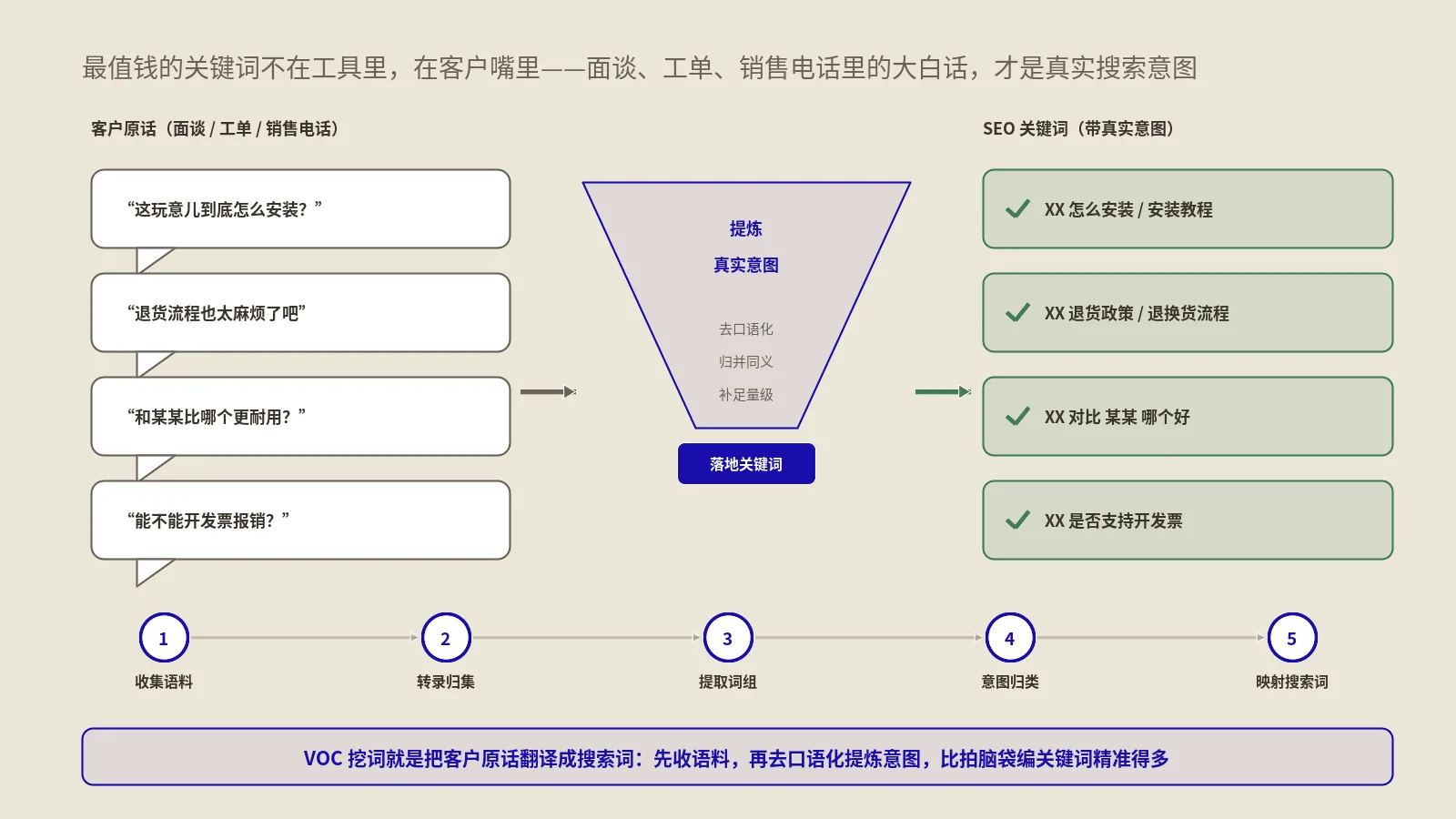

有个做家居出海独立站的客户,选品会上拿着一张Excel冲我发火:同一批二十个长尾词,他让运营分别用三个工具拉了关键词难度,排序完全对不上——一个工具里最该做的词,在另一个工具里排到了最难做的那一档。他问的问题很直接:“这分数到底信谁的?是不是有一家在骗我?”

没有谁骗他。这正是关键词难度(Keyword Difficulty,业内简称KD)这个指标最容易被误解的地方:它从来不是一个客观真值,而是每家工具用自己手里那套不完整的链接数据,各算各的一个近似分。把三家的分数放在一起比绝对值,本身就是用错了它。要把这个工具用对,先得知道这个数字是怎么被造出来的。

一个被当成红绿灯用的分数,到底在量什么?

大多数人对KD的理解停在一句话:“分数越高越难排上去。”这句话不算错,但它把一个统计近似当成了物理定律。KD真正想回答的问题其实很窄:如果我现在要在这个词的搜索结果首页占一席,我大概需要多少、多强的外部链接支撑?注意,它回答的是“链接门槛”,不是“这个词好不好做”。这两件事经常不是一回事。

为什么所有主流工具都把KD做成一个跟链接强相关的分?因为在工具能拿到的所有数据里,指向页面的引用域(referring domains)数量和质量,是和排名相关性最稳定、最容易规模化测量的一个变量。内容质量、意图匹配、用户行为、品牌权威这些东西,工具要么测不到,要么测得很糙。于是KD本质上变成了“首页那十个页面的链接画像有多猛”的一个浓缩。理解这一点,你就理解了它后面所有的脾气:它对链接敏感,对其他一切迟钝。搜索引擎到底怎么决定谁排前面,我在搜索引擎抓取索引排名三步全拆解里讲过——排名因子是一整套系统,而KD只压缩了其中最容易量化的那一维。

各家工具的KD是怎么算出来的?

“算出来的”这三个字才是关键。KD不是Google给的,Google从来没有、也不会公开任何“难度”数值。每一个你看到的KD都是某家工具的私有公式产物。它们的公式不同,喂进去的数据库不同,标定的样本不同,所以结果天生就不会一致。下面拆开几家主流做法,你会发现它们差异之大,远超普通人想象。

Moz:第一个把“难度”做成分数的

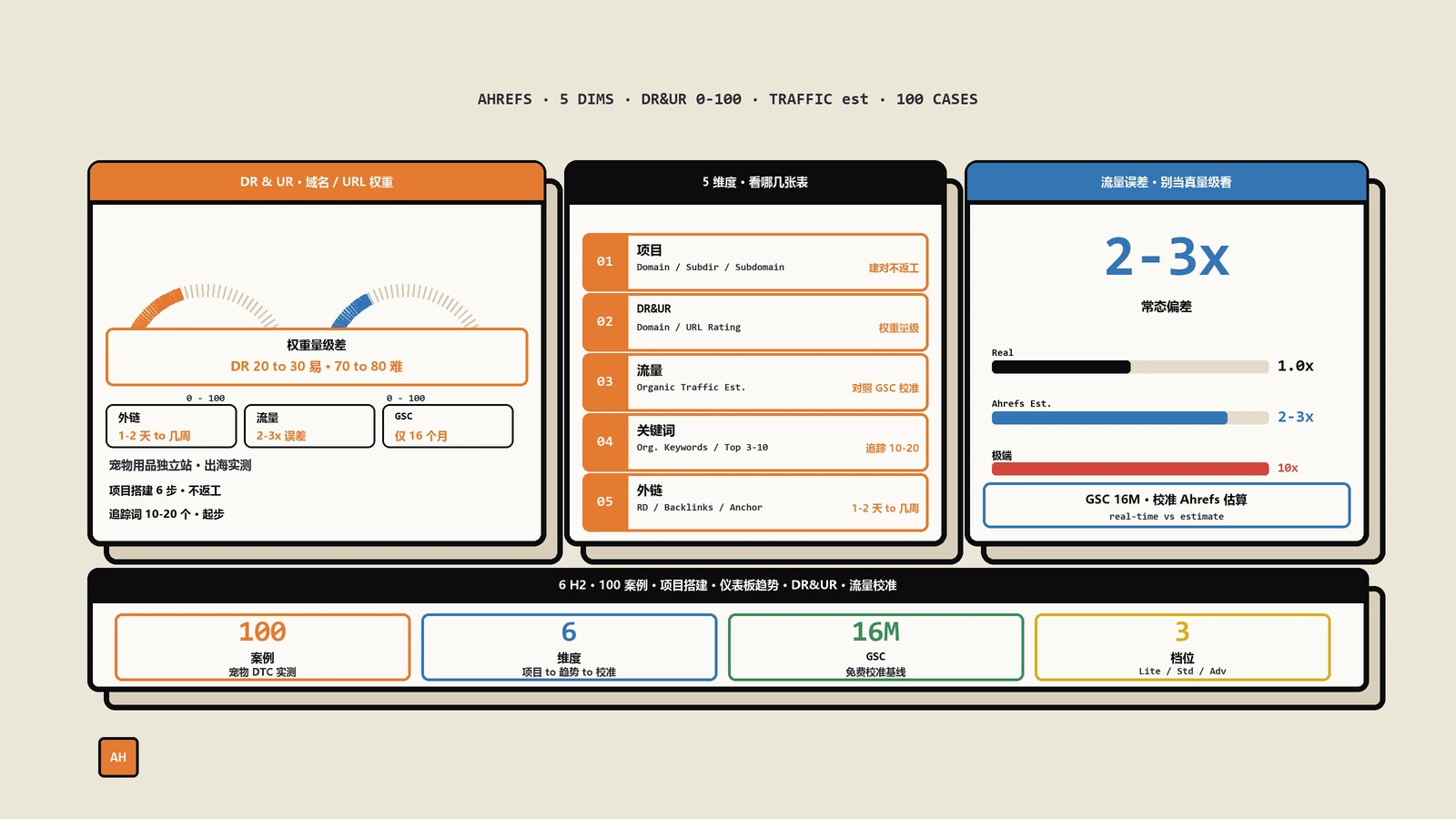

把关键词难度产品化、变成一个0到100的分给大众用,最早成规模的是Moz,大约在2012年前后。Moz早期的逻辑很朴素:抓首页排名页面,取它们的页面权威(Page Authority)和域权威(Domain Authority),做加权,再映射到0–100。它的优点是直觉清晰、和它自家的DA/PA体系自洽;缺点也明显——DA/PA本身就是Moz基于自家链接索引回归出来的近似分,KD等于在一个近似分上面再叠一层近似,误差是会累积的。所以早年大家就发现:Moz的KD在头部大词上还算靠谱,到了中长尾就经常“一刀切”地给出一片相近的中等分,区分度不够。

Ahrefs:几乎只盯着引用域数量的那条回归线

Ahrefs的KD是市场上被引用最多的,也是机制最透明的一个,值得讲细一点。Ahrefs官方多次说明过:它的KD主要由当前排在首页的页面的引用域数量决定,具体做法接近——取首页前十页面各自的引用域数,做一个对数尺度的处理,再回归映射到0–100。换句话说,Ahrefs的KD约等于一句话:“想进这个词的首页,你大概需要追平首页页面那个量级的引用域数。”

这条设计有个非常重要、却很少被人讲清的后果:Ahrefs的KD几乎不看内容、不看意图、不看你自己的站。它甚至基本不看引用域的质量,主要看数量。这就解释了一个让很多人困惑的现象:有些一眼看上去竞争惨烈的词,Ahrefs给的KD反而不高——因为首页那几个页面虽然来自大站,但具体到那个页面本身,获得的独立引用域并不多;反过来,有些看着冷门的词KD奇高,只因为首页恰好被几个本身链接极厚的页面占据。把Ahrefs的KD当“这个词好不好做”,会在这两种情况上同时翻车。

Semrush和其他:混合信号的黑箱

Semrush的KD%是另一种思路:它不只看链接,还往公式里塞了域权威、引用域、SERP特征(是否有精选摘要、视频、购物结果等抢占点击的元素)、甚至关键词本身的一些属性,做成一个综合百分比。好处是它试图把“链接”以外的竞争因素也纳进来,理论上更全面;代价是它更黑箱——你拿到一个61%,很难反推出这61%里到底是链接重还是SERP特征重,排错就难。还有一类工具(KWFinder、Ubersuggest这类)走的是又一条路:它们更看重首页页面的链接概况叠加一个简化的域强度,胜在轻量直觉、适合快速过词,弱在区分度和稳定性都不如前面几家。最后是国内站长工具、以及一些以竞价数据为主的平台:它们的“难度”里经常混入了搜索竞价激烈程度(出价、广告主数量)。竞价激烈≠自然排名难,这两件事在很多商业词上甚至是背离的——有些词广告位挤破头,自然结果却是一片薄弱内容;有些词没人投广告,自然首页却被权威大站铁桶一样占死。用混了竞价的难度做自然SEO选词,方向会从一开始就歪。

“对数尺度”和“标定样本”到底在干嘛?

很多人看到“对数回归”就跳过了,但这恰恰是理解KD为什么那样跳动的钥匙,值得用大白话讲清。为什么要对数尺度?因为引用域数量和排名难度的关系根本不是线性的:一个页面从10个引用域涨到20个,排名推力是质变;但从1000个涨到1010个,几乎没区别。如果直接用原始数字线性映射,前十名里只要混进一个引用域上万的巨头,整个词的KD就会被这一个极端值拉爆,中小竞争的真实差异全被压平。取对数,本质是把“从0到100”这段的边际收益放大、把“从1000到10000”这段压扁,让分数更贴近真实的边际竞争感受。这就解释了一个常见困惑:为什么有些词你辛辛苦苦把引用域翻了一倍,KD却只降了几分——因为你正处在对数曲线已经很平的那一段。

“标定样本”则是另一个被忽略的关键。每家工具的0–100不是凭空定的,而是拿一批它认为“已知难/已知易”的词去回归、去校准出来的。这批校准样本以什么语种、什么行业、什么时期为主,直接决定了这把尺子在你这个细分领域准不准。一把主要用英文大众词标定出来的KD尺子,拿去量中文小众B2B词,刻度本身就是歪的。这也是为什么同一个工具,在不同语言、不同垂直领域,KD的“手感”会明显不一样——不是它坏了,是这把尺子原本就不是为你这段量程标的。

| 工具 | KD主要在量什么 | 对什么敏感 | 典型盲区 |

|---|---|---|---|

| Moz | 首页页面的DA/PA加权 | 域级权威 | 中长尾区分度低,叠加近似误差 |

| Ahrefs | 首页页面引用域数量(对数回归) | 链接数量 | 无视意图/内容/链接质量/你自己的站 |

| Semrush | 链接+域权威+SERP特征综合 | 多信号混合 | 黑箱,难反推哪一项主导 |

| 国内竞价系工具 | 常混入广告竞价激烈度 | 商业出价 | 把广告竞争误当自然排名难度 |

为什么同一个关键词,各家给的KD能差一倍?

看完上面的表,客户那张对不上的Excel就不神秘了。差异不是偶然噪声,而是结构性的,主要来自三个层面,而且这三层会叠加放大。

它们抓的SERP根本不是同一张快照

KD的计算前提是“首页那十个页面”,但“首页”是个会动的东西。各家工具抓取SERP的时间不同、频率不同、用的地理位置和语言不同、是否模拟登录态不同。一个词在你看的这一刻、在北京、未登录状态下的首页,和工具三天前在弗吉尼亚机房抓到的首页,可能换了好几个页面。基于不同首页算出来的链接门槛,自然不同。商业意图强、SERP波动大的词,这种差异尤其夸张——我见过同一个跨境词,两家工具差出近三十分,根源就是它们抓到的首页构成压根不一样。

链接数据库的大小天差地别

KD的核心输入是“页面有多少引用域”。但没有任何一家工具拥有完整的全网链接图——它们各自爬、各自建索引,索引规模和更新速度差异极大。同一个页面,A工具看到800个引用域,B工具只看到500个,因为B的爬虫还没覆盖到那批新增链接,或者按它的标准过滤掉了一部分。输入差三成,输出的难度分自然差一截。这也是为什么跨工具比KD绝对值毫无意义:你不是在比难度,你是在比两家公司的爬虫覆盖率。

公式里塞的东西本来就不一样

就算SERP和链接数据都一样,前面已经讲过,Ahrefs主要回归引用域数量,Semrush混了一堆信号,Moz走DA/PA路线。同样的原料,三套不同配方,出三个不同的菜,这太正常了。真正错的不是工具,是把它们的产出当成可以直接比大小的同一种东西。正确的用法是:在同一个工具内部横向比,绝不跨工具比绝对值。

个性化、本地化和时间滞后:你和工具看到的从来不是同一个页面

还有一层差异最隐蔽,也最容易让人冤枉工具“算错了”:你在浏览器里看到的SERP,是带着你的搜索历史、登录状态、精确地理位置、设备类型被个性化过的;而工具是用一个中性的、机房所在地的、未登录的爬虫去抓。这两个首页可能差好几个位置。你觉得“这词首页全是大站,KD才40不可能”,很可能是你看到了被个性化偏置过的版本,而工具看到的是另一副样子。再叠加时间滞后——链接图谱的更新是有延迟的,一个页面上周新拿到的两百个引用域,工具的索引这周可能还没完全消化,算出来的门槛自然偏低。所以不是只有“跨工具不能比”,连“工具的数字和你眼前的SERP”都不该直接对线,中间隔着个性化和时间两层错位。

把前面几层叠起来看一个具体的数:假设某词首页十个页面引用域数从高到低是 [4200, 980, 760, 420, 310, 240, 190, 120, 90, 40]。Ahrefs取对数后回归,4200那个极端值被对数压扁,真正影响分数的是中段那批两三百量级的页面,于是给出一个中等偏上的KD;而另一家工具的爬虫还没收录到那个4200页面新增的一批链接,它看到的是 [2600, 980, ...],中段也少抓了一截,回归出来就低了十几分。同一个词,没人算错,差值却真实存在——你拿这两个数比大小,比的从来不是难度,是两家爬虫这一周的进度条。

KD高就不能做、KD低就好做吗?这是最大的误用

这是我在客户那里见到的头号错误,没有之一:把KD当成一个“低于多少就上、高于多少就放弃”的阈值开关。这个用法之所以危险,是因为KD结构上缺失了三样决定胜负的东西,而这三样恰恰是经验型SEO真正在判断的。

KD看不见搜索意图,而意图决定你压根能不能挤进去

一个KD只有20的词,如果它的搜索意图是“用户想直接买/想要官方工具/想看视频”,而你是一篇资讯文章,那么哪怕难度分再低,你也进不了首页——因为Google判定这个词要的不是文章。反过来,一个KD看着60的词,如果首页十条里有六条是答非所问的老旧资讯,意图明显错配,一篇真正对题的好内容反而能后发制人。难度分对这一切一无所知。意图错配这件事怎么从SERP反推、怎么诊断,我专门写过用SERP反推页面该改成什么样,选词阶段就该把意图这一维拎出来单独看,而不是埋在一个难度分里假装它不存在。

KD看不见SERP里的那几个软肋

真实的SERP从来不是十个势均力敌的强者。它经常是:三个真正的强页面 + 四个意图错配的大站旧页 + 两个内容单薄但靠域名权重硬撑的页面 + 一个论坛帖。你要击败的不是这个词的“平均难度”,而是首页那个最弱的、你有把握替换掉的位置。KD把十个页面糊成一个平均分,恰好抹掉了你唯一需要的那条信息——哪个位置是软肋。读SERP的人能一眼看见的破绽,看KD分的人完全看不到。

KD看不见你自己的相对实力

同一个KD45的词,对一个建站三个月、引用域个位数的新站,和一个深耕五年、主题权威已经立住的老站,难度根本是两回事。KD是个“绝对”分,它默认所有人站在同一起跑线,这在现实里从不成立。这也是为什么我反复跟客户强调:难度永远是相对于“你这个站、在这个主题下、当前的相对实力”而言的。脱离自身站况谈KD高低,等于脱离体重谈一个杠铃重不重。

那KD还有什么用?保哥怎么把它用对

讲了这么多它的毛病,是不是该把KD删了?恰恰相反。用对了,它是个效率极高的工具——前提是你清楚它只能干一件事:在海量候选词里做粗筛降噪,而不是做最终决策。

我自己带团队选词的实际用法是这样的:先用挖词工具把一个主题的候选词扩到几百上千个(扩词的渠道和方法,可以参考长尾关键词扩展完整指南),这时候没人有精力一个个去读SERP。这一步,KD的价值就出来了:在同一个工具内部,用KD配合搜索量、配合每词的SERP特征,把这上千个词快速分成三档——明显够不着的先搁置、明显能打的进快车道、模糊地带的进人工核查队列。注意,这里KD的作用是“分桶降噪”,不是“判生死”。真正决定做不做的,是后面的人工核查。这套低竞争词的系统化打法,我在低竞争关键词挖掘实战里有完整的策略框架,KD在那套框架里始终是第一道粗筛,不是裁判。

一条用了很多年的经验法则:KD只在同源、同时间、同地区的批量横比中可信;它的绝对值不可信,它和别家工具的差值更不可信。把它当筛子,别当尺子。

分桶的阈值,该怎么定才不拍脑袋?

既然要拿KD分桶,阈值就不能凭感觉填个数。我的做法是用你自己站当尺子,不用通用数字:先挑五到十个你已经排进首页、你心里有数的现有词,看看它们在你常用的那个工具里KD落在什么区间,这个区间就是“以你站当前实力打得动”的真实参照。把这个参照当分桶中线——明显低于它的进快做桶,明显高于它的进搁置桶,贴着它上下浮动的进人工核查桶。这样定出来的阈值是长在你这个站身上的,会随着站点变强自动水涨船高,而不是抄一个对谁都不准的“KD30以下才做”。这一步花不了十分钟,却让后面上千词的粗筛第一次有了真正的地基,也彻底避开了“用别人的难度标准量自己的站”这个最常见的暗坑。

| 场景 | KD该怎么用 | 千万别这么用 |

|---|---|---|

| 上千候选词初筛 | 同工具内分三档降噪 | 设一个全局阈值一刀切 |

| 判断单个词做不做 | 只作参考,以人工读SERP为准 | KD低于X就上、高于X就弃 |

| 跨工具核对 | 看排序趋势是否一致 | 比较两家的绝对分数大小 |

| 评估自身能否打进 | 结合自身DR/主题权威再判断 | 把KD当成对所有站统一的难度 |

把KD、搜索量、点击空间一起看会更准吗?

很多人意识到单看KD不靠谱后,会升级成“KD×搜索量”的二维矩阵:低难度高搜索量优先做。方向是对的,但这里藏着第二个陷阱——搜索量本身也是个估算值,而且越来越不等于真实点击。

先说搜索量为什么也不能尽信。它和KD一样是工具的近似产物:来源于点击流采样、关键词规划师的区间数据、再加模型平滑,误差在中长尾词上动辄好几倍。两个都带着不确定性的估算值相乘,误差是放大的,不是抵消的。更要命的是第二件事:就算搜索量准,这个量里有多少能变成点击,取决于SERP长什么样。一个月搜一万次的词,如果首页顶着一个AI概览、一块精选摘要、一排购物卡片、一个视频轮播,真正流向自然蓝链的点击可能只剩两三成;另一个月搜两千次的纯信息词,十条干干净净的蓝链,可得点击反而更多。所以正确的不是二维矩阵,是三维:难度、量级、以及这个量里还剩多少真实点击空间。第三维KD和搜索量都不显示,只能人工去看SERP构成。

我带团队做选词优先级时,真正排序的从来不是“KD÷搜索量”,而是一个粗糙但管用的问句链:这个词意图能不能对上我的内容类型?对得上的话,首页有没有可替换的软肋?有软肋的话,这词的SERP还给自然结果留了多少点击?三个都过了,才轮到看搜索量去排先后。KD在这条链里连第一个问题都回答不了,它只配在更前面那一步的“上千词降噪”里出现一次,然后就该让位。把它放回它该在的位置,你会发现选词决策一下子清楚了很多。

不看KD,怎么真正判断一个词能不能打?

进入人工核查队列之后,KD就该退场了。真正决定一个词做不做、怎么做的,是下面这套读SERP的动作。它慢,但它准,而且做多了会变快。

读懂首页十条,比任何分数都准

打开这个词未登录、目标地区的真实SERP,逐条问四个问题:这十条的内容类型是不是一致(全是长文?全是产品页?混排?)——这告诉你意图;这十条里有几条是真正对题且新鲜的,有几条是答非所问或明显过期的——错配越多,你的机会越大;占住位置的页面,看的是它这一个页面的引用域质量(谁在链它、相关不相关),而不是整站的域名光环;最后问自己一句:我能不能产出一个在深度、时效、意图贴合度上明显压过当前最弱那两三条的页面?这四个问题答完,你对“能不能打”的判断,比任何KD分都扎实。

为了让这套判断不靠玄学,我把它压成一张简单的核查记分表,人工过每个待定词时按它打一遍,比盯着KD分快也准:

| 核查项 | 看什么 | 对你有利的信号 |

|---|---|---|

| 意图匹配 | 首页主流内容类型与你能产出的类型是否一致 | 一致,且无需改变内容形态 |

| SERP软肋 | 前八位有几条意图错配/内容单薄/明显过期 | 有两条及以上可替换的弱位 |

| 页面级链接 | 占位页面“这一个页面”的引用域质量与相关性 | 多为不相关或自引,而非强相关权威链 |

| 点击空间 | SERP被AI概览/精选摘要/购物卡/视频侵蚀程度 | 自然蓝链仍占据视觉主区 |

| 自身相对实力 | 本站在该主题的内容深度与权威能否压过最弱位 | 能在深度或时效上明显胜出 |

五项里只要意图匹配、有软肋、还有点击空间这三项同时成立,这个词通常就值得做,KD分多少都不影响这个结论;反过来,意图错配或点击空间被吃光,KD再低也别碰。这张表的价值在于,它把“难度”重新拆回了它本该是的样子——不是一个数字,是一组可核查的判断。

一个反直觉的真实案例

那个家居客户的Excel里,有个词三家工具的KD分别是34、52、77,他本来按最低那个34判定“轻松能做”。我让他先别碰公式,直接看SERP:首页前五里有三条是大型综合电商的分类页,内容和这个具体长尾问题几乎不沾边,纯粹靠站点权重霸位;另有一条是2017年的老博客,信息已经过时;只有第六到第八位才是真正对题的内容页,而且都不算深。结论和三个KD分全都相反:这个词不是“轻松能做”,也不是“很难”,而是意图严重错配、首页有大片软肋、特别适合用一篇真正对题的深度内容去后发制人。三个月后这个词进了前三,带来的转化是那批词里最高的。如果当初按KD分排序,它要么因为77被直接毙掉,要么因为34被当成“随便写写就行”敷衍掉——两种结局都会错过它。这件事我后来在好几个项目里反复验证:KD和真实机会的相关性,远没有大家以为的那么强。

反过来的坑也一样真实。另一个做B2B SaaS的客户,Ahrefs给一批术语词的KD普遍只有十几二十,团队按“低难度”全速铺内容,半年几乎颗粒无收。问题出在哪?这些词KD低,是因为没人专门为它们建过强链,所以引用域门槛确实低;但它们的SERP首页清一色被该领域两三个权威平台的文档和深度长文占着,这些页面虽然单页引用域不多,却是主题权威极强、内容深到一篇资讯文章根本够不着的那种强。KD只量了链接门槛,完全没量出“主题权威”和“内容深度”这堵墙。低KD在这里是个彻头彻尾的陷阱:它低,不代表你能进,只代表“没人靠堆链接进过”——而这恰恰因为这道关靠的根本不是链接。这两个方向相反的案例放一起,结论就一句话:KD只是一面之词,真相永远在那十条SERP里。

KD在AI搜索时代还算数吗?

这两年绕不开的一个问题:AI Overviews、AI搜索把传统SERP搅了个天翻地覆,关键词越来越碎、越来越长、越来越像自然语句,KD这套建立在“首页十个蓝链”前提上的指标,还算数吗?

我的判断是:KD的具体数字越来越不重要,但它背后那个“竞争强度”的判断永远不会过时,只是载体变了。过去你要击败的是首页十个页面;现在你还要额外考虑:这个查询会不会触发AI直接作答、从而吃掉大部分点击;AI在生成答案时倾向引用什么样的来源。一个KD很低、但已经被AI Overview完整覆盖的信息型查询,实际可得流量可能趋近于零——这个风险,任何工具的KD分都不会告诉你。所以AI时代的选词,我反而更不依赖那个分数,更依赖人工去看:这个查询当前长什么样、AI介入到什么程度、还剩多少真实点击空间。

还有一个更底层的变化,把KD这套体系的地基都松动了:查询正在前所未有地碎片化。人对着AI和语音用一整句自然语言提问,带来的是海量、低频、几乎从没被任何关键词工具收录过的长尾查询。KD是建立在“这个关键词有一个稳定的首页可供抓取分析”这个前提上的——可一个这辈子只被搜过几次的句子,根本没有稳定SERP,也就没有可算的KD,工具直接给你一片空白或一个无意义的默认值。这意味着流量结构里越来越大的那一块,是KD这个指标在定义上就触及不到的。应对方式不是去给这些词逐个估难度(根本没法估),而是把选题颗粒度从“单个关键词”上移到“一个能覆盖整族提问的主题与实体”,用内容的全面和权威去接住整片长尾,而不是去算其中某一根的难度。难度从来不是一个分数,它是你对整个结果页生态的判断力。这一点,在传统SERP时代成立,在AI搜索时代只会更成立。

常见问题解答

关键词难度多少分以上就不该做了?

没有这样的通用阈值,设阈值本身就是误用。KD只在同一工具内做相对粗筛,真正决定做不做要看SERP意图匹配、首页有没有软肋、以及你自己站的相对实力,这三样KD都量不到。

为什么同一个词Ahrefs和Semrush的KD差那么多?

因为两家算法不同:Ahrefs主要回归首页页面的引用域数量,Semrush混合了链接、域权威和SERP特征。加上各自抓的SERP快照和链接数据库规模不同,差出一截是结构性的,不是谁出错。

KD和搜索意图是一回事吗?

完全不是。KD近似的是“链接门槛”,和这个词要的是文章、产品页还是视频毫无关系。一个低KD的词如果意图和你内容类型错配,照样进不了首页,意图必须单独判断。

新站选词应该只挑KD低的词吗?

方向对但方法粗。新站确实该避开链接门槛过高的词,但低KD里大量是意图错配或没有真实点击的词。正确做法是用KD粗筛后人工读SERP,挑那些首页有明显软肋、意图能对上的低竞争词。

国内站长工具给的关键词难度能信吗?

要看它的难度是怎么定义的。不少国内工具的难度里混入了竞价激烈程度,而广告竞争激烈不等于自然排名难。做自然SEO选词,优先用以自然SERP和链接数据为基础的工具,并始终以人工核查为准。

AI搜索普及后还需要看KD吗?

具体分数的参考价值在下降,但“竞争强度”的判断更重要了。现在除了原有的链接门槛,还要评估这个查询会不会被AI直接作答吃掉点击,这部分任何KD分都不显示,只能人工判断。

同一个工具里KD可以直接拿来排序选词吗?

可以用来做初筛降噪,把上千候选词分成“搁置/快做/待人工核查”三档,效率很高。但不能用排序结果直接拍板,排序靠前不等于值得做,最终仍需人工核查SERP和意图。

说到底,关键词难度是个被严重高估的数字,也是个被严重浪费的工具。高估它的人拿它当裁判,结果被一个连意图都看不见的近似分牵着走;真正会用的人拿它当筛子,在它最擅长的“批量降噪”上榨干价值,然后在它够不着的地方,老老实实去读那十条SERP。工具没有错,错的是把一个近似当成了真理。这件事想明白了,你看候选词列表的眼神,会和过去完全不一样。

本文标题:《关键词难度KD怎么算?为何各家工具差大?1000站10步实测》

本文链接:https://zhangwenbao.com/keyword-difficulty-metric-cross-tool-truth.html

版权声明:本文原创,转载与引用请注明作者与原文链接。许可协议: CC BY 4.0