llms.txt之后:AI内容架构的4层怎么搭

本文目录

- 写在前面:你的网站对AI来说是一团迷雾

- 从robots.txt到4层架构的AI内容演进时间线

- llms.txt的价值与局限

- llms.txt到底解决了什么问题

- llms.txt的3个致命短板

- 4层机器可读内容架构详解

- 第一层:JSON-LD结构化事实层

- 第二层:实体关系映射

- 第三层:内容API端点

- 第四层:验证与溯源元数据

- 4层架构的优先级与投入产出对比

- 一个完整的落地案例

- 改造前的痛点

- 4层架构改造后的变化

- 6个月后的效果

- 5个不同行业的实施策略

- 行业一:SaaS B2B(最受益)

- 行业二:电商独立站

- 行业三:内容媒体

- 行业四:本地服务(律所、医院、餐厅)

- 行业五:教育培训

- 本季度就能交付的最小可行方案

- JSON-LD审计与升级

- 核心API端点

- 溯源元数据

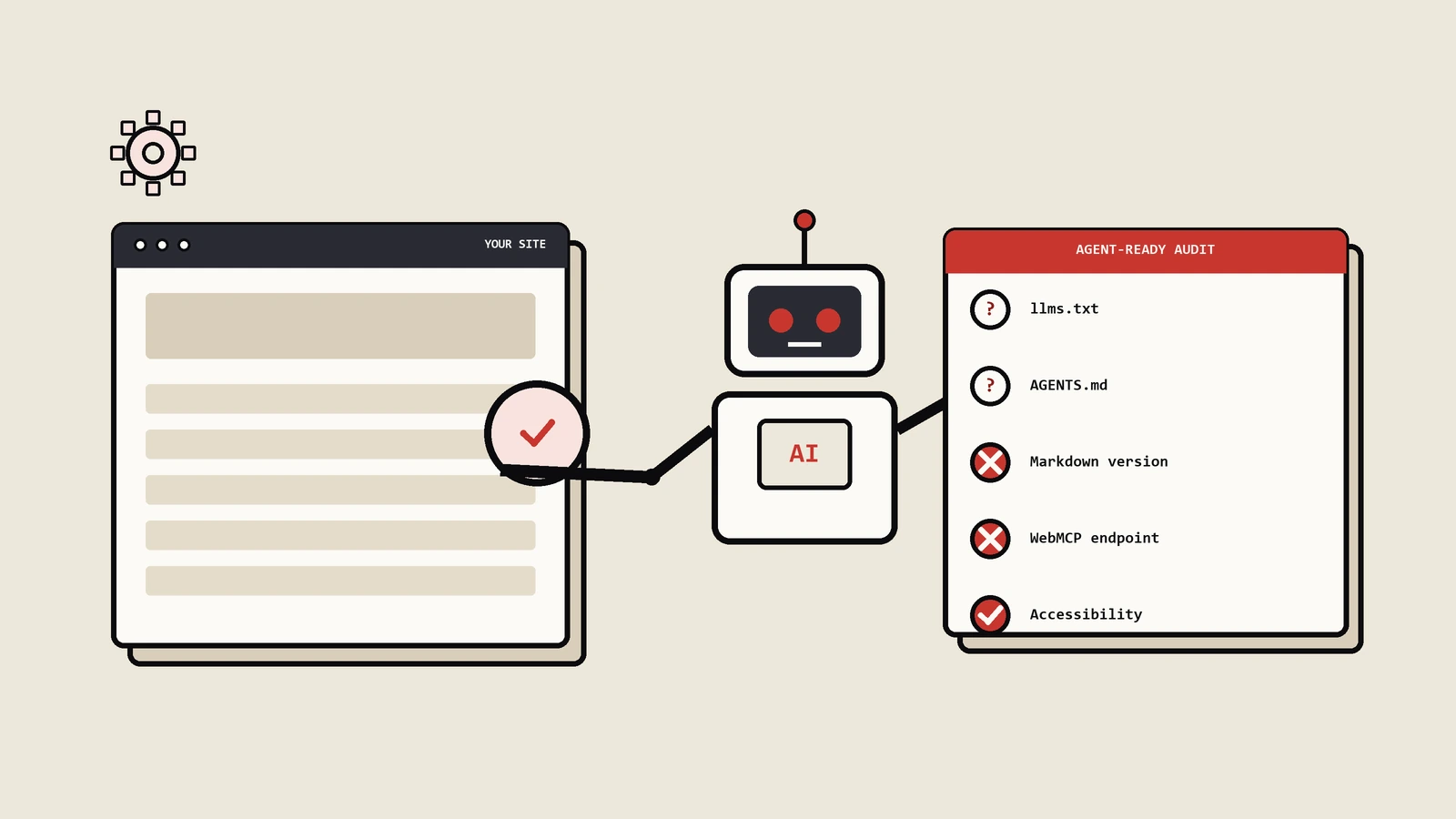

- 验证AI正确读取的5种方法

- 别等标准定了再动手

- 这4层架构搬到国产AI引擎面前,先得知道它们到底读不读

- 出海SaaS照搬这套4层,保哥团队踩过的3个"标记很漂亮但AI根本读不到"的坑

- 常见问题解答

- llms.txt和四层AI内容架构是什么关系?

- 中小企业没有技术团队能否实施这个架构?

- 实施四层架构后多久能看到效果?

- MCP协议现在值得投入吗?

- 如何验证我的结构化数据被AI系统正确读取了?

- JSON-LD和Microdata微数据格式应该选哪个?

- 如何确保结构化数据与页面前端始终同步?

- 4层架构会增加多少服务器负载和带宽?

- 写在最后

- 权威参考资料

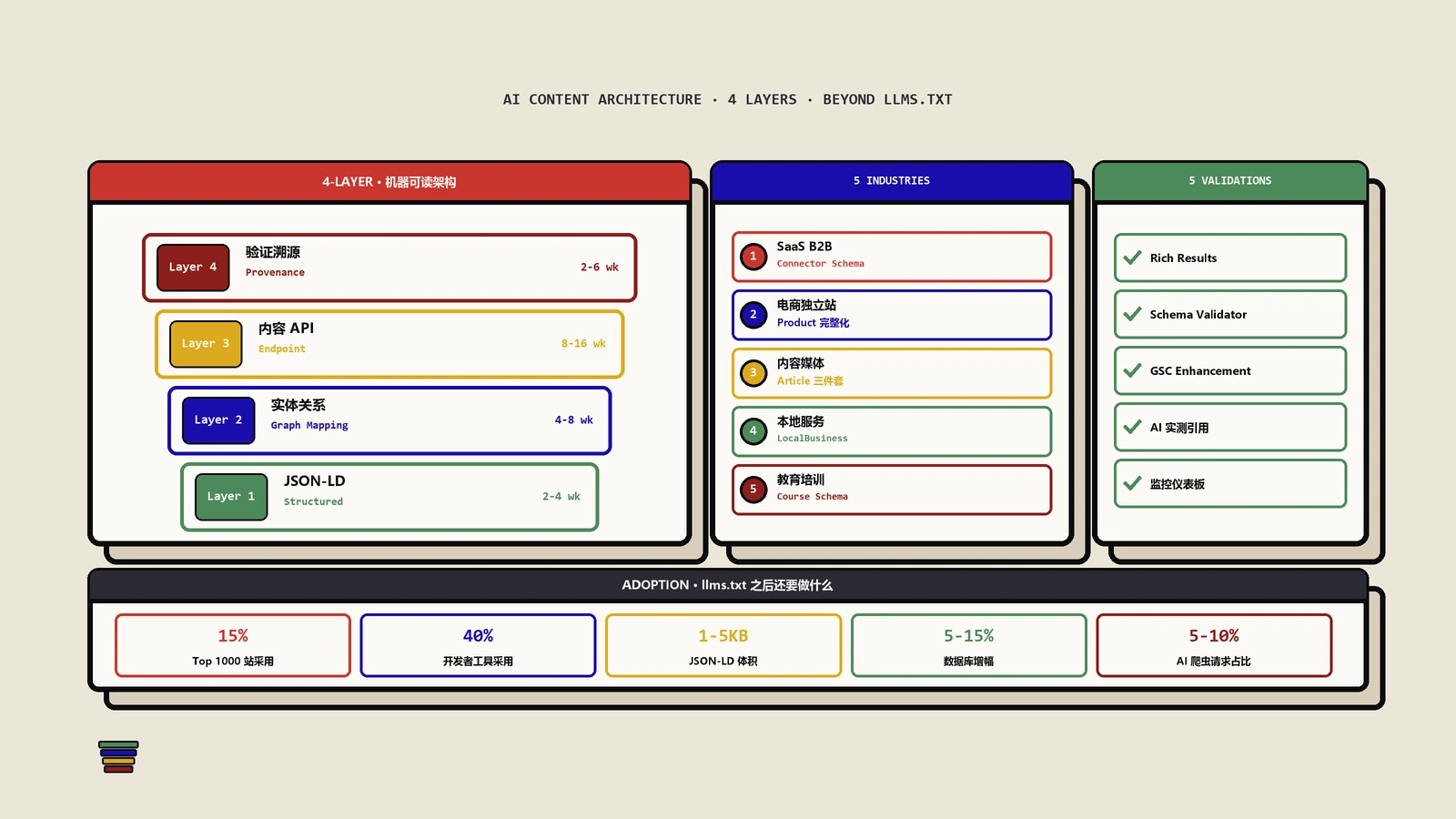

摘要:llms.txt只是个开始,你的网站对AI来说可能还是一团迷雾。本文给四层机器可读内容架构——JSON-LD结构化事实层、实体关系映射、内容API端点、溯源元数据,配各层的优先级与投入产出对比、一个SaaS落地案例、五个行业的实施策略、本季度就能交付的MVP和五种验证方法。

写在前面:你的网站对AI来说是一团迷雾

假设你是一家SaaS公司的市场总监。你精心打磨了产品页面、写了详尽的功能对比表、做了一堆客户案例。但当潜在客户在ChatGPT里问"哪个项目管理工具适合中型企业"时,AI给出的回答里你的产品定价是错的、企业版功能描述是缺失的、关键集成能力压根没被提到。

这不是个别现象。2026年,越来越多的采购决策在AI辅助研究阶段就已经完成,人类销售代表介入时大局已定。如果AI读不懂你的品牌信息,你连上场竞争的机会都没有。

llms.txt的出现试图解决这个问题——用一个Markdown文件给AI提供一份"内容目录"。方向是对的,但远远不够。保哥今天要聊的,是llms.txt之后真正需要构建的内容架构。

从robots.txt到4层架构的AI内容演进时间线

| 时期 | 主导技术 | 解决的问题 | 当前是否仍然有效 |

|---|---|---|---|

| 1994到2010 | robots.txt | 告诉爬虫去哪不去哪 | 仍然必要 |

| 2005到2015 | XML sitemap | 提供完整URL清单 | 仍然必要 |

| 2011到2018 | Schema.org JSON-LD | 结构化页面数据 | 已成熟标配 |

| 2019到2023 | 实体SEO + 知识图谱 | 表达实体关系 | 新兴最佳实践 |

| 2024到2025 | llms.txt | AI友好的内容清单 | 过渡方案 |

| 2025到2027 | MCP + 内容API | 实时可验证数据接口 | 未来标准 |

| 2026+(本文核心) | 4层AI内容架构 | JSON-LD + 实体 + API + 溯源 | 当下应该开始构建 |

llms.txt的价值与局限

llms.txt到底解决了什么问题

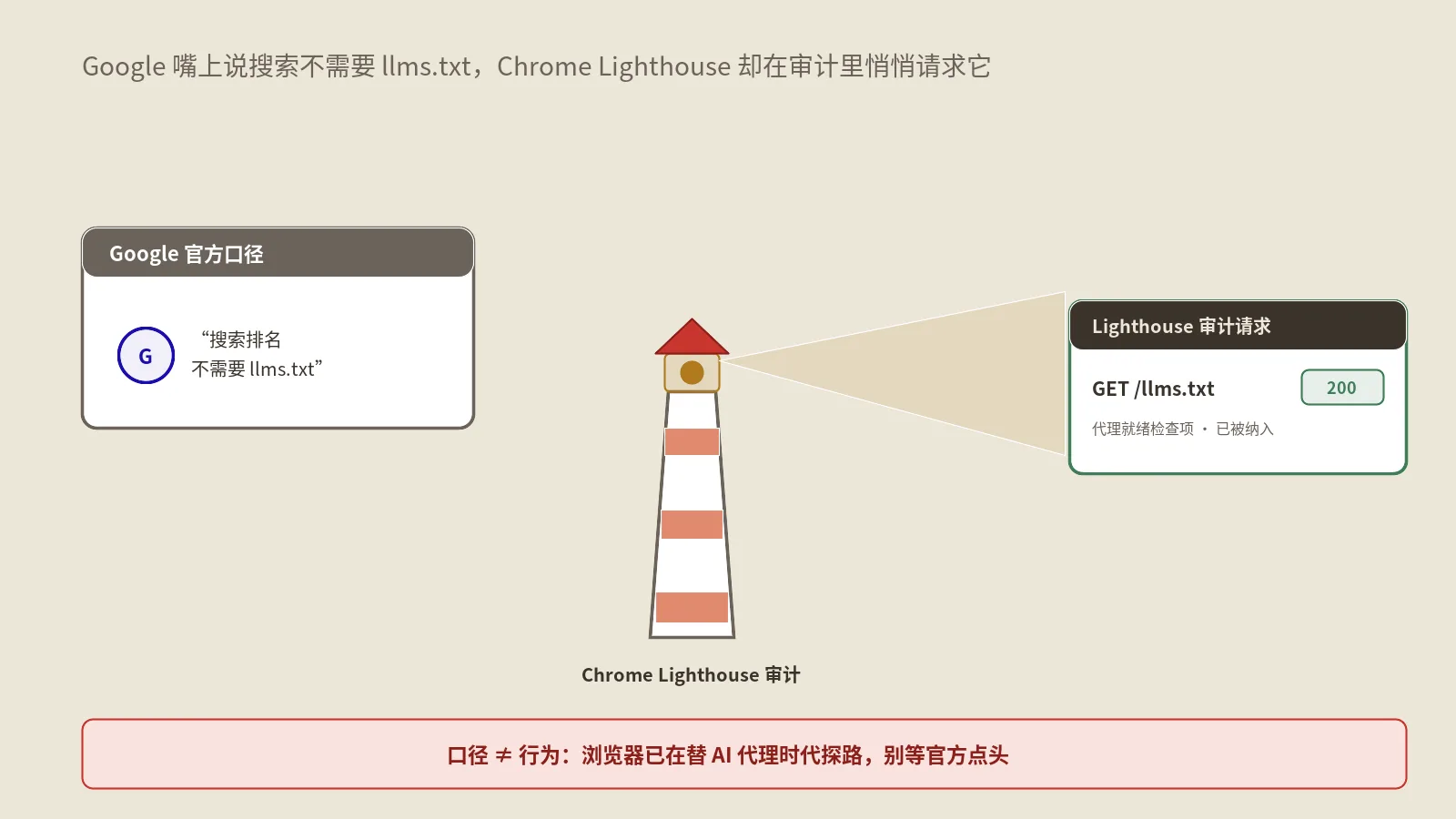

llms.txt是一种放置在网站根目录的Markdown格式文件,本质上是一份精选的内容清单,告诉AI模型你网站上哪些页面最值得关注。它的核心价值在于"可读性"——把重要内容从复杂的HTML中剥离出来,以低噪声的方式呈现给AI代理。

对于开发者文档、API参考手册、技术博客这类本身结构化程度较高的内容,llms.txt确实有实际用途。AI模型不需要去解析广告、弹窗和JavaScript渲染的动态内容,可以直接获取干净的文本。截至2026年Q1,已有大约15%的Top 1000网站部署了llms.txt,其中开发者工具类站点采用率最高(约40%)。

llms.txt的3个致命短板

短板一:没有关系模型

llms.txt本质是一个扁平列表,它能告诉AI"我们发布了这些内容",但无法表达产品A属于产品线B、功能X在3.2版本被弃用并由功能Y替代、某人是某话题的权威发言人这类关系。当AI做对比查询时,一个没有关系图谱的扁平列表,恰恰是制造"听起来自信但实际不准确"回答的温床。

短板二:维护成本高

每次价格调整、新案例发布、产品功能更新,你都需要同时更新网站和llms.txt文件。对于一个只有几十个页面的开发者工具站来说还好,但对于拥有数百个产品页面和分布式内容团队的企业来说,这就是运维噩梦。保哥见过的真实案例:某SaaS公司llms.txt和官网价格不同步导致AI报错价的事故,每年发生3到5次。

短板三:缺乏溯源信息

llms.txt文件中的内容没有时间戳、没有作者归属、没有版本号。当AI的RAG系统需要在多个相互矛盾的信息源之间做取舍时,没有溯源元数据的内容天然处于劣势。RAG系统的排序算法被训练为优先选择带有可信元数据的源。

4层机器可读内容架构详解

把接下来要介绍的架构理解为llms.txt的"下一阶段"——就像XML站点地图和结构化数据是robots.txt之后的演进一样。这四层不需要一次性全部构建,但你需要理解每一层的作用和优先级。

第一层:JSON-LD结构化事实层

这是整个架构的地基。当AI代理为了供应商对比而评估你的品牌时,它会读取Organization、Product、Service和Review等Schema标记。2026年,AI对这些标记的解析精度已经远超2019年Google的水平。

研究数据表明,部署了有效结构化数据的页面出现在Google AI Overviews中的概率显著高于没有标记的等效页面。普林斯顿大学的GEO研究也发现,具有清晰结构化信号的内容在AI生成的回答中可见度提升明显。

这里的关键转变是:不要再把JSON-LD当作获取富媒体摘要的手段,而是把它视为面向机器的事实层。这意味着你需要比目前大多数实现更精确地描述产品属性、定价状态、功能可用性和组织关系。

JSON-LD第一层的5个核心实施要点

- 对核心商业页面进行JSON-LD审计和升级,重点覆盖Organization、Product、Service和FAQPage类型

- 使用@id图谱模式将不同Schema标记互联互通,而不是让它们各自孤立

- 所有JSON-LD从CMS数据源程序化生成,确保与页面前端始终同步

- 对动态字段(如价格、库存)使用ItemAvailability等子schema精确表达状态

- 用Google Rich Results Test和Schema Markup Validator双重验证,确保字段无误

第二层:实体关系映射

这一层要表达的是"图谱",而不仅仅是"节点"。你的产品和品类之间有什么关系?品类如何映射到行业解决方案?解决方案又连接着哪些使用场景?所有这些关系最终都要追溯到权威来源。

实体关系映射可以通过JSON-LD图谱扩展来实现,也可以在无头CMS中以专用端点的形式提供。核心目标是让AI系统能够像一个人类分析师审阅一份组织良好的产品目录那样遍历你的内容架构——每一步都保留关系上下文。

实体关系层的典型应用场景

举个例子:如果一家项目管理平台有150个集成连接器,AI代理在回答"哪个工具支持Slack加Jira加GitHub三方联动"这种复合能力问题时,不应该被迫去解析150个独立的集成页面。通过实体关系映射,你可以定义这些集成如何归类到解决方案品类中,AI代理就能直接定位到正确答案。

实体关系的JSON-LD表达示例

{

"@context": "https://schema.org",

"@graph": [

{

"@type": "Organization",

"@id": "#org",

"name": "Example Corp"

},

{

"@type": "Product",

"@id": "#product-pm",

"manufacturer": { "@id": "#org" },

"name": "ProjectFlow"

},

{

"@type": "Service",

"@id": "#integration-slack",

"serviceType": "Integration",

"provider": { "@id": "#org" },

"isRelatedTo": { "@id": "#product-pm" }

}

]

}第三层:内容API端点

这一层标志着架构从被动标记转向主动基础设施。一个位于/api/brand/faqs?topic=pricing&format=json的端点,返回结构化的、带时间戳和归属信息的响应——这对AI代理来说是完全不同层级的信号。它不再是一个"可能反映也可能不反映当前定价"的Markdown文件,而是一个可验证的实时数据源。

Anthropic在2024年底推出的MCP(Model Context Protocol)以及随后被OpenAI、Google DeepMind和Linux基金会采纳的事实,清楚地表明了AI与品牌数据交换的发展方向——标准化的、可认证的、实时的接口。你现在不需要立即实现MCP,但你的架构设计应该朝着这个方向演进。

最小可行的内容API设计

对于大多数品牌来说,最小可行的内容API是一个程序化生成的、结构化的对比端点,涵盖你最常被比较的信息——通常是定价和核心功能。这个端点从你的CMS同一数据源生成,确保与网站前端始终保持同步,省去手动维护第二套内容的麻烦。

API响应的标准结构

{

"version": "2026.05.01",

"last_updated": "2026-05-12T14:30:00Z",

"source": "https://example.com/pricing",

"data": {

"plans": [

{"name": "Starter", "price_usd": 29, "billing": "month"},

{"name": "Pro", "price_usd": 99, "billing": "month"},

{"name": "Enterprise", "price_usd": "custom", "billing": "contact"}

]

},

"signature": "sha256:..."

}第四层:验证与溯源元数据

最后一层是把你的内容从"AI在某处读到的东西"转变为"AI可以验证并自信引用的东西"。具体来说,就是在你暴露的每一条事实上附加时间戳、作者归属、更新历史和来源链。

当RAG系统需要在多条相互矛盾的事实中选择展示哪一条时,溯源元数据就是决胜因素。一条带有明确更新时间戳、署名作者和可追溯来源链的事实,会百分之百地胜过一条无日期、无归属的主张——因为检索系统被训练为倾向于选择前者。

溯源元数据的3个必备字段

- 时间戳:用ISO 8601格式记录最后更新时间,精确到秒(如

2026-05-12T14:30:00Z) - 负责人/团队:明确该事实由谁负责维护,方便AI判断权威性

- 版本号:用语义化版本(如

v2.1.3)或日期版本(如2026.05.01)追踪变更

溯源元数据的实现并不复杂:在每条公开事实上标注最后更新时间、负责人或团队、版本号。这三个字段就足以让你的内容在AI引用竞赛中占据优势位置。

4层架构的优先级与投入产出对比

| 层级 | 实施难度 | 预期周期 | ROI排序 | 必须先行条件 |

|---|---|---|---|---|

| 第一层 JSON-LD | 低 | 2到4周 | 1(最高) | CMS可注入HTML头部 |

| 第二层 实体关系 | 中 | 4到8周 | 2 | 第一层完成 |

| 第三层 内容API | 高 | 8到16周 | 3 | 开发资源、CMS API |

| 第四层 溯源元数据 | 中低 | 2到6周 | 2(与第二层并列) | 内部CMS流程改造 |

一个完整的落地案例

假设你运营一家年收入约5000万美元的项目管理SaaS平台,服务中小企业和大型企业客户,有三个定价档位和一个包含150个连接器的集成市场。

改造前的痛点

你的网站对人类买家来说可能做得很好,但对AI代理来说几乎是不透明的。定价页面是JavaScript动态渲染的,功能对比表藏在一个AI无法可靠解析的PDF里,客户案例是长篇HTML且没有结构化归属。当AI代理在采购对比中评估你时,它只能从爬取到的文本中推断信息——这意味着定价很可能是错的,企业版功能可用性很可能是缺失的,潜在客户需要的那个特定集成几乎不可能被准确呈现。

4层架构改造后的变化

- 事实层:发布JSON-LD Organization和Product Schema,准确描述每个定价档的功能集和目标用户,且这些数据从驱动定价页面的同一数据源程序化生成

- 实体关系层:定义集成如何归类到解决方案品类,AI代理无需解析150个独立页面就能准确回答复合能力问题

- 内容API层:暴露一个结构化的、版本化的对比端点,AI代理可以直接查询定价和功能数据

- 溯源层:每条事实都携带时间戳、数据负责人和版本号,AI在引用时更有信心

6个月后的效果

AI不会虚构你的定价,能正确呈现企业版功能,并且因为实体图谱把集成连接到了正确的解决方案品类,所以能准确呈现客户需要的集成。六个月后市场总监看竞争分析报告时,不会再看到"AI引用了错误定价"作为丢单原因。

5个不同行业的实施策略

行业一:SaaS B2B(最受益)

核心动作:JSON-LD描述Pricing、Feature、Integration三类实体。重点是把"功能矩阵"用机器可读方式表达,让AI能直接回答"X工具是否支持Y功能"这类问题。投入预算:2到3人月。

行业二:电商独立站

核心动作:Product Schema完整化,含价格、库存、评分、变体。配合GTIN/SKU等唯一标识让AI准确识别商品。Shopify、WooCommerce都有现成插件可以加速实施。投入预算:1到2人月。

行业三:内容媒体

核心动作:Article Schema + Author Schema + Publisher Schema三件套。重点是把每篇文章的作者权威性、发布时间、修订历史用结构化数据表达。这是E-E-A-T的技术实现。投入预算:1.5人月。

行业四:本地服务(律所、医院、餐厅)

核心动作:LocalBusiness Schema + Service Schema + Review Schema。重点是地理位置、营业时间、服务范围的精确描述。配合Google Business Profile形成双重权威源。投入预算:0.5到1人月。

行业五:教育培训

核心动作:Course Schema + EducationalOccupationalProgram Schema。明确课程的目标受众、前置条件、学习成果,让AI能精准推荐给合适用户。投入预算:1人月。

本季度就能交付的最小可行方案

保哥理解大多数团队不可能一次性构建全部四层,所以这里给出一个可以在本季度交付的最小可行实现。

JSON-LD审计与升级

对核心商业页面做JSON-LD审计和升级。覆盖Organization、Product、Service和FAQPage Schema,使用@id图谱模式做好互联。这是投入产出比最高的动作,因为JSON-LD是成熟标准,不存在押错宝的风险。

核心API端点

为你最常被比较的信息创建一个结构化内容端点。对大多数品牌来说就是定价和核心功能,从CMS程序化生成,保持自动同步。简单一个JSON输出端点,2到3天即可完成。

溯源元数据

在每条你关心的公开事实上添加溯源元数据——时间戳、归属作者或团队、版本引用。这三个字段看似简单,但在AI引用竞赛中是关键的差异化因素。

这不是一个llms.txt,也不是网站的Markdown副本。这是持久性基础设施,无论最终哪个协议标准胜出,它都能服务于当前和未来的AI检索系统。

验证AI正确读取的5种方法

- Google Rich Results Test:验证JSON-LD语法和字段的正确性,对Google系AI影响最直接

- Schema Markup Validator:Schema.org官方工具,更严格的字段类型验证

- GSC Enhancement报告:Google Search Console里看实际识别情况

- AI搜索引擎实测:用固定的品牌查询词在ChatGPT、Gemini、Perplexity、Claude里测试

- 定期监控仪表板:用Looker Studio或自建脚本跟踪关键查询的AI回答准确度

别等标准定了再动手

历史给我们的教训很明确:2012年Schema.org刚发布时,没人确定Google会多大范围地使用结构化数据。但那些率先实施的品牌,定义了接下来十年Google消费结构化数据的模式。他们没有等待保证,而是基于原则去构建,让标准围绕他们的实践成形。

同样的逻辑今天依然适用。MCP在2026年已经拥有每月9700万次SDK下载量,并得到了OpenAI、Google和Microsoft的采纳,但企业内容API标准仍在形成中。JSON-LD已经成熟,但品牌层面的实体关系映射还没有正式规范。

具体的协议不是重点,重点是底层原则:内容必须为机器理解而结构化,同时对人类保持价值。这个原则不会因为某个协议的胜负而改变。

这4层架构搬到国产AI引擎面前,先得知道它们到底读不读

本文的JSON-LD、实体关系、内容API、MCP这一整套,主要是按Google AI Overviews和ChatGPT、Perplexity、Claude这些海外引擎的消费能力设计的。国内站要落地前,得先搞清楚一件事:豆包、文心、Kimi、元宝、DeepSeek这些国产引擎,对这4层的"消化能力"和海外引擎不在一个水平线上。

保哥团队的观察(不是官方结论,是拿固定品牌词在各引擎实测扒出来的):第一层JSON-LD,国产引擎普遍能读,但解析精度和优先级都低于Google,尤其是复杂的@graph实体关系,国产引擎经常只取到最表层的name和price,关系链基本读不出来;第三层内容API和MCP,国产引擎现阶段几乎不会主动去调你自定义的/api端点,它们的引用源更偏自家生态(豆包偏抖音系、文心偏百家号、元宝偏公众号搜一搜),你暴露再标准的API它也不一定来抓。

所以纯内贸站的投入产出排序要重排:第一层JSON-LD和第四层溯源元数据(时间戳、作者、版本)值得做,因为对百度结构化数据和国产引擎的基础识别都有用;第三层内容API和MCP对国内市场现阶段ROI很低,别急着投开发资源去建MCP server,先等国产引擎跟进再说。只有出海站才按本文原排序full stack地全做。

还有个绕不开的合规点:第三层内容API,本质是把你的结构化数据主动暴露给外部AI爬取。如果你是中国主体的站,API里一旦涉及用户数据、价格策略这类内容,就要绷紧个人信息保护法和数据出境这根弦——别把含敏感字段的端点裸暴露给境外Agent。定价对比这类公开事实没问题,涉及用户、订单的,得先做脱敏和合规评估再开放。

出海SaaS照搬这套4层,保哥团队踩过的3个"标记很漂亮但AI根本读不到"的坑

文中那个SaaS落地案例是理想态。真做出海项目时,最常见的翻车不是Schema写得不对,而是"标记得很完整,AI却根本抓不到"。保哥团队帮一个出海SaaS落地这4层时踩的3个坑,比补字段更值得记。

坑一:内容API端点挂国内源站,被自家高防WAF把AI爬虫当攻击拦了。我们按第三层建了/api/brand/pricing端点,本地curl一切正常,但ChatGPT和Perplexity实测就是读不到最新价。排查发现是国内高防和WAF把GPTBot、ClaudeBot、PerplexityBot这些不太常见的UA当成异常爬虫,直接返回了人机验证challenge页——AI拿到的是验证页,不是JSON。解法是在WAF和源站对这几个官方AI爬虫的UA加官方IP段单独放行,端点最好也挪到海外边缘节点。这跟第一层JSON-LD同理:你JSON-LD写得再标准,AI爬虫被WAF挡在门外,等于没写。

坑二:价格API用USD标准价,没反映分市场定价,AI报错价丢询盘。第三层那个pricing端点最初只吐一套USD价,但这家SaaS对不同区域做了阶梯定价。AI在面向东南亚客户的对话里直接报了美国标准价,客户一看太贵就走了。后来在API的data里按region拆价格数组,用priceSpecification表达区域差异,AI才会按用户所在地给对的价。出海的"事实层"不是一套数,是带区域维度的一组数——这点和定价页前端要做的事一样,但API端点特别容易只吐一套就完事,没人复查。

坑三:结构化对比端点一暴露,第二天就被竞品脚本全量抓走做监控。第三层鼓励你建"最常被比较的定价加核心功能"对比端点,方便AI直接查。但端点上线没几天,访问日志里就冒出固定IP每小时整点拉全量的请求——是竞品在抓我们的定价和功能矩阵做竞品监控。对策不是关掉端点(关了AI也读不到),而是给端点加合理的频率限制和UA白名单:放行已知AI爬虫,对高频整点拉全量的可疑来源限速。既喂得到AI,又不至于把定价策略全盘端给对手。

常见问题解答

llms.txt和四层AI内容架构是什么关系?

llms.txt是AI内容可访问性的起点,它提供了一份指向关键Markdown文件的内容清单。四层架构是llms.txt的自然演进,在llms.txt的基础上增加了JSON-LD结构化事实层、实体关系图谱、内容API端点和溯源元数据,使AI系统不仅能找到你的内容,还能理解、验证并准确引用你的内容。两者不是替代关系,而是递进关系。建议同时部署,llms.txt作为基础入口,4层架构作为深度数据源。

中小企业没有技术团队能否实施这个架构?

完全可以分阶段实施。第一层JSON-LD结构化数据是最容易落地的——大多数主流CMS和电商平台都有现成的插件或模板支持。中小企业可以先从这一层开始,使用Schema生成工具创建Organization、Product等基础标记,然后逐步向后面的层级推进。第三层内容API可能需要一定的开发资源,但第一、二、四层都可以由内容团队配合SEO工具来完成。预算紧张的话,先做第一层和第四层投入产出比最高。

实施四层架构后多久能看到效果?

JSON-LD结构化数据的效果通常在数周到数月内显现,具体表现为Google AI Overviews中的出现频率提升和AI搜索引擎引用准确度的改善。完整四层架构的效果是累积性的——每增加一层,AI系统对你品牌信息的信任度和引用准确度都会阶梯式提升。建议使用固定的查询集定期跟踪AI搜索结果中的品牌引用情况。保哥实测客户案例:第一层完成后2到4周可以看到Google AI Overviews引用率上升20%到40%。

MCP协议现在值得投入吗?

MCP(Model Context Protocol)在2026年已经展现出强劲的发展势头,被多个主流AI平台采纳。但对于大多数品牌来说,现阶段不需要直接实现MCP。更务实的做法是把架构设计得MCP-ready——即数据以结构化、版本化、可认证的方式组织,等MCP或其他协议成熟后可以快速接入。先做好JSON-LD和溯源元数据就是最好的准备。如果你是Top 100品牌或服务大型企业客户,可以提前研究MCP实现。

如何验证我的结构化数据被AI系统正确读取了?

可以从三个维度验证。第一使用Google Rich Results Test验证JSON-LD语法和字段的正确性。第二在Google Search Console的增强报告中查看结构化数据的识别和错误情况。第三用固定的品牌相关查询词在ChatGPT、Gemini、Perplexity等AI搜索引擎中测试,观察AI生成的回答是否准确反映了你的结构化数据中的信息,尤其关注定价、功能和产品关系这类关键事实。建议每月做一次系统测试,建立基准数据后跟踪变化。

JSON-LD和Microdata微数据格式应该选哪个?

2026年首选JSON-LD,原因有三:第一Google官方推荐JSON-LD是首选格式;第二JSON-LD与HTML分离方便维护和动态更新;第三大多数CMS和插件默认输出JSON-LD。Microdata是过渡格式,已部署的不必立刻迁移,但新建的页面建议直接用JSON-LD。如果同时部署两种格式,AI可能因为冲突信号而困惑,所以坚持一种格式更稳。

如何确保结构化数据与页面前端始终同步?

核心原则是从同一数据源程序化生成。具体做法:第一在CMS或后端API层提供数据,前端模板和JSON-LD都从这个数据源读取;第二建立CI流程,每次构建时同时验证页面内容和JSON-LD字段的一致性;第三定期用爬虫脚本抽样对比两者数据。如果你用Shopify、WordPress等成熟CMS,可以用结构化数据插件配合数据库字段自动同步。

4层架构会增加多少服务器负载和带宽?

JSON-LD体积通常每页1到5KB,对带宽影响微乎其微。内容API端点的负载取决于查询频率,AI爬虫的请求量通常是搜索引擎爬虫的5到10%,可以忽略。真正需要注意的是溯源元数据的存储——如果给每条事实都加3个元字段,数据库大小可能增加5到15%。整体上4层架构的运维成本增加不超过原网站基础设施的5%。

写在最后

历史给我们的教训很明确:那些率先实施JSON-LD的品牌,定义了接下来十年Google消费结构化数据的模式。今天构建4层AI内容架构的品牌,也将定义未来5到10年AI引用你品牌的方式。

如果你还在犹豫要不要开始构建llms.txt,不妨直接生成一份基础文件,然后把精力集中在本文介绍的4层架构上。那些还在问"要不要做"的品牌,已经落后于那些在问"怎么扩展"的品牌了。保哥的最后建议:本季度先做第一层JSON-LD审计加溯源元数据,下个季度做实体关系映射,半年内完成内容API的最小可行版本。一年内你的品牌在AI生态中的存在感会发生质变。

权威参考资料

FAQPage + Article AI 引用友好版

llms.txt只是起点。AI准确引用品牌信息需要JSON-LD事实层、实体关系图谱、内容API端点和溯源元数据4层完整架构。保哥给出本季度可交付的最小可行方案与5个行业实施策略。

- 结构化数据

- 实体SEO

- GEO优化

- llms.txt

- AI内容架构

- GEO/AEO

title: llms.txt之后:AI内容架构的4层怎么搭 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/llms-txt-ai-content-architecture.html published: 2026-04-03 modified: 2026-06-01 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《llms.txt之后:AI内容架构的4层怎么搭》

本文链接:https://zhangwenbao.com/llms-txt-ai-content-architecture.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0