AI批量内容都撞上质量墙:5层工具栈与过墙的7个改写动作

本文目录

- 15年的轮回每一代规模化内容都死在同一面墙上

- 第一代伪原创时代2008到2011

- 第二代程序化SEO时代2015到2022

- 第三代AI批量内容时代2023至今

- 质量墙为什么不可逾越

- 更糟的是低质量内容会主动伤害你

- Google的站点级质量评估

- Google已经说得不能再明白了

- 但是我们的内容排名挺好的呀

- 经济账根本算不过来

- 同一个错误更好的工具

- 那AI到底应该怎么用保哥的实操框架

- 发布前必须过的唯一检验

- AI作为增强器而非替代器

- 质量优先的内容规模化公式

- 建立内容质量的防火墙

- AI辅助内容创作的5层工具栈推荐

- 3个真实站点的对照案例

- 中文场景的质量墙:百度和豆包、DeepSeek怎么判AI批量内容

- 百度这道关:原创和站点信号一个都不能少

- 中文AI这道关:机器味中文几乎不被引用

- AI初稿过质量墙的7个改写动作

- 常见问题解答

- 用AI辅助写作发布的内容Google能识别出来吗

- 每月只发15篇深度文章不会比对手500篇内容覆盖关键词少吗

- 如果我已经发了几百篇AI低质内容现在怎么补救

- 程序化SEO是不是完全不能做了

- 怎么判断我的内容是否处在质量墙之上

- AI写的初稿被人工大量改写还算AI内容吗

- 谷歌的E-E-A-T信号怎么主动建立

- 未来3到5年AI对SEO行业的影响会是什么

- 权威参考资料

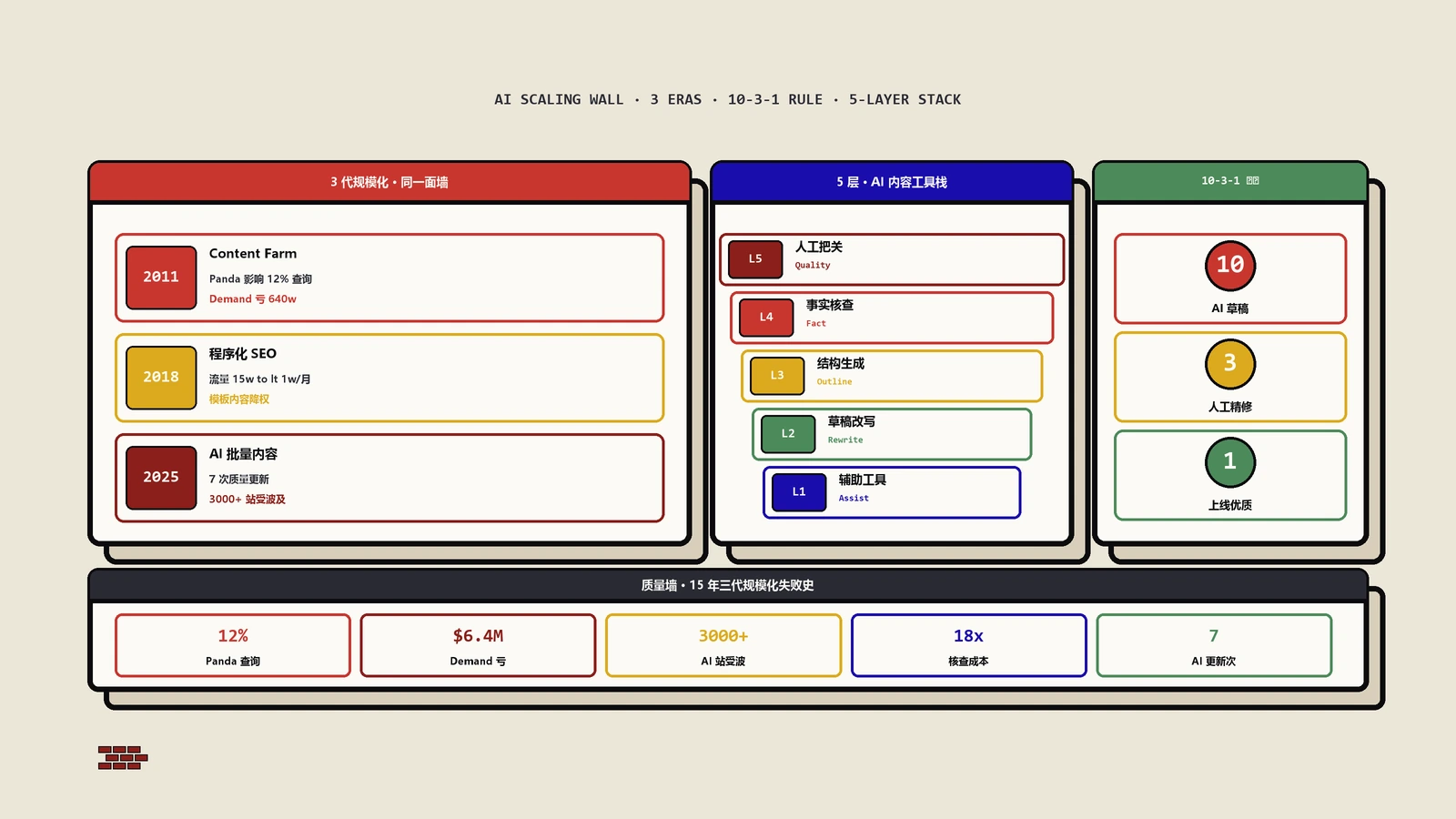

摘要:AI批量生产内容为什么注定撞墙?本文回顾从2008年伪原创、2015年程序化SEO到2026年AI内容工厂的15年失败史,剖析Google站点级质量评估机制和规模化滥用的人工惩罚,给出10-3-1法则、AI辅助的五层工具栈和质量防火墙的完整方法论,附三个真实站点的对照案例。

保哥最近在海外SEO圈子看到一句话,扎心程度堪比315晚会:You are not scaling content, you are scaling disappointment——你不是在规模化内容,你是在规模化失望。这句话精准地击中了当下内容行业最大的集体幻觉:用AI一个月批量生产500篇文章,以为数量可以碾压一切。结果呢?你碾压的不是竞争对手,而是你自己网站的质量信号、爬虫预算和品牌信誉。今天保哥要把这个话题从头到尾讲透,不是为了唱衰AI——保哥自己每天都在用AI工具——而是为了让你看清楚内容规模化这面墙到底在哪里,以及如何真正有效地用AI做内容。

15年的轮回每一代规模化内容都死在同一面墙上

保哥入行这些年,亲眼看过这面墙把多少人撞得头破血流。最荒诞的是,每隔几年行业都会集体失忆,用更精美的工具重复完全相同的错误。

第一代伪原创时代2008到2011

那时候的玩法简单粗暴:拿一篇文章,用同义词替换软件自动洗出50篇原创文章。这些文章读起来像是有人把一本字典扔进了搅拌机。但即使产出的内容足够通顺,这个前提本身就是错的——独特性从来不是稀缺品。一只猴子在键盘上乱按也能产出独特的内容,那串字符确实从未存在过,但那又怎样?真正困难的从来不是制造独特性,而是制造有价值的独特性。Google容忍了一阵子,因为它的系统还没追上来。然后2011年2月Panda算法上线,影响了将近12%的搜索查询,内容农场的流量一夜蒸发。当时的内容农场代表Demand Media在第二年报告了640万美元的亏损,公司股价从25美元一路下跌到3美元,最终被收购拆分。这场内容工厂崩盘成为SEO行业第一次系统性教训,但显然不是最后一次。

第二代程序化SEO时代2015到2022

玩法升级了。不再是洗文章了,而是搭建模板,用结构化数据填充内容。最好的某产品在某城市页面,动辄生成上千个,每一个都是数据库查询外面套了一层薄薄的模板皮。有些确实提供了价值——如果底层数据足够好、模板确实满足了用户真实需求。但大多数不是。大多数只是穿了一身体面衣服的桥页(doorway pages)。Google花了好几年磨练识别和降权这类内容的能力。2022年的Helpful Content Update第一次明确点名站点级低质内容打击,无数程序化站点流量腰斩。保哥跟踪过一个跨境电商客户的案例:靠程序化生成的3万个产品对比页一度带来每月15万的自然流量,HCU之后掉到不到1万,恢复至今依然没回到原峰值的30%。这就是程序化SEO的典型死法——快速攀升然后断崖下跌再也回不来。

第三代AI批量内容时代2023至今

现在我们又来了。同样的套路,更闪亮的工具。我们一个月能产出500篇文章!非常好。但你能产出500篇值得阅读的文章吗?500篇包含读者从现有搜索结果中得不到的信息的文章?500篇展现任何形式的专业知识、实际经验或原创思考的文章?如果不能,你不是在规模化内容,你是在规模化对爬虫预算的浪费。

保哥最近观察到一个特别讽刺的案例:一款主打AI可见度优化的工具,自己网站上批量生成了数百个页面,全部遵循best SEO agencies in 某城市名的模板。任何经历过程序化SEO时代的人一眼就能认出来——这是2017年的剧本,只不过文案现在由大语言模型来写了。模板获得了语法升级和一个这是AEO的标签,但策略本身没有任何进步。

海外知名SEO专家Lily Ray也标记了一个类似案例:一个简历网站生成了500多个程序化页面,标题全是resume examples for 某职业,每个标题遵循完全相同的公式,页面模板近乎一致,AggregateRating schema被滥用,到处都是AI生成的内容。她的总结只有三个词:Worked until it didn't——有效,直到它不再有效。这句话应该被纹在每一个内容规模化方案的封面上。它总是暂时有效的。然后突然就不行了。

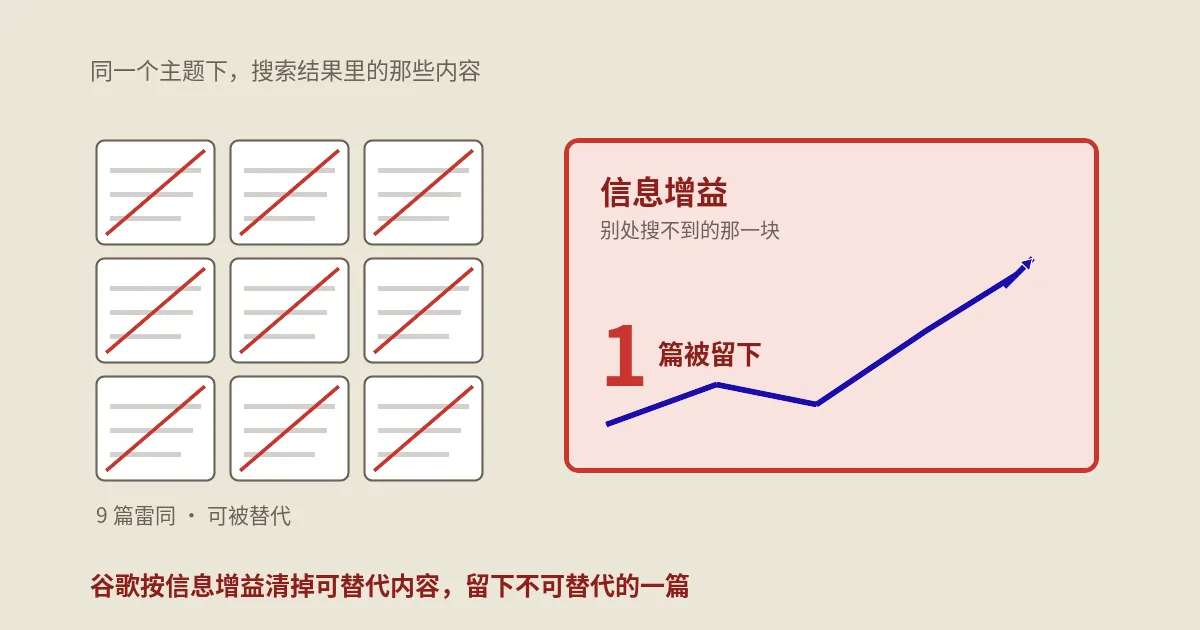

质量墙为什么不可逾越

保哥把每一代内容规模化策略都撞上的那面墙叫做质量墙(The Qualitative Wall)。它的本质是这样的:Google不是孤立评估你的内容。它是把你的内容跟索引库中同一主题的所有其他内容进行相对评估。

发布500篇AI生成的房贷利率文章不会让你成为房贷利率的权威。它只是让你变成了用略微不同的词说着同样东西的第500个信息源。Google已经有499个这样的了,它不需要你的。质量墙的定义是:存在一个真正价值的最低阈值——原创洞察、亲身经验、特定专业知识、读者在别处得不到的东西——低于这个阈值,再多的数量都帮不了你。你可以在阈值以下发布一百万个页面,对真正重要的关键词你什么都排不上。

更糟的是低质量内容会主动伤害你

对于那些专门为了在AI驱动的搜索系统中获取可见度而规模化生产AI内容的人来说,这个策略不仅仅是失败——它会主动反噬。一项2025年关于LLM时代检索评估的研究论文引入了一个指标,同时衡量检索中的有用段落和干扰段落。关键发现是:低价值内容不会安静地躺在索引中等着被忽略,它会把检索模型带偏,降低系统生成答案的质量。

换句话说,你那500篇薄弱的文章不仅仅是不可见的,它们是噪音。而如果你的网站还有一些真正有用的页面被淹没在这些噪音中,恭喜——你给自己构建了一个干扰模式。你以为能帮助被发现的数量,正在积极淹没那些本来可能获得排名的页面。这个内部稀释效应是大多数AI内容工厂运营者意识不到的隐性成本——他们以为多发一些内容只是浪费爬虫预算,实际上还在系统性损害真正好内容的可发现性。

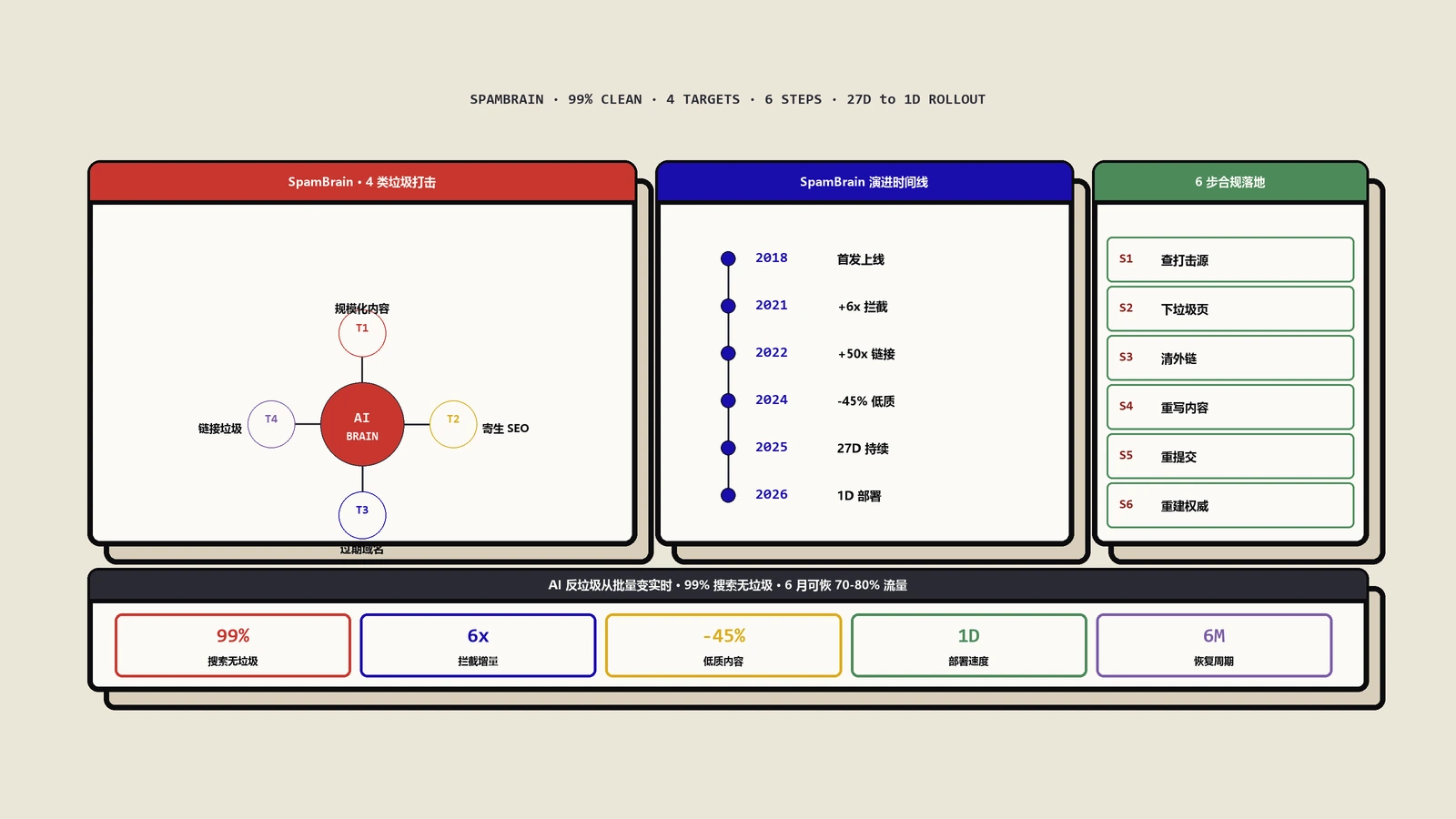

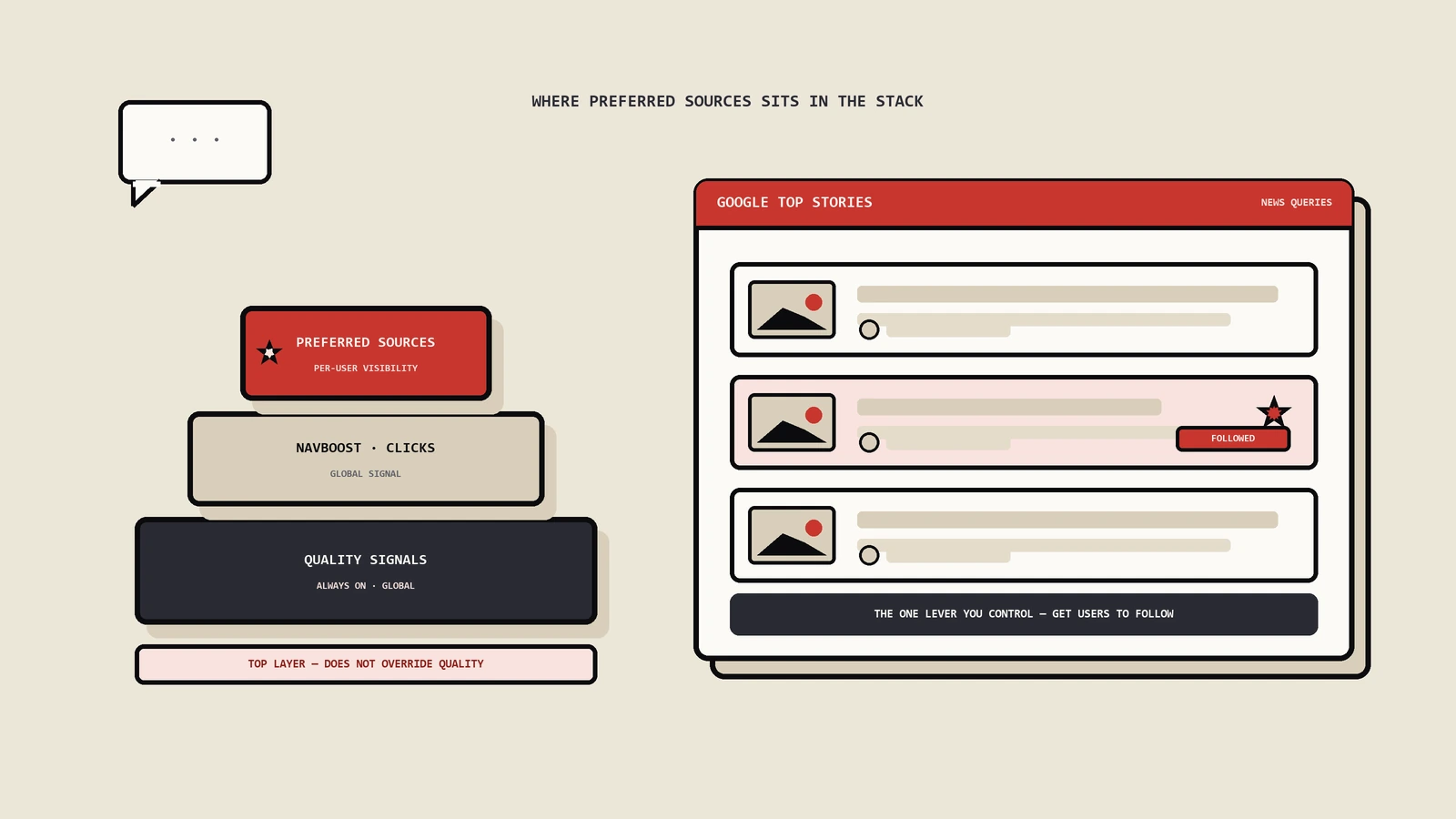

Google的站点级质量评估

这一点非常关键,保哥必须重点强调:Google是在站点级别聚合质量信号的,不仅仅是页面级别。你可以有个别页面表现还行,但与此同时你网站的整体质量信号在持续退化。而当算法执行追上来的时候——无论是算法更新还是人工惩罚——它不会逐页逐页地打击你,而是一锅端。这就是内容伪原创时代的谬误在不断重复:现在在排名,所以一定是好策略。Demand Media的内容也在排名。直到它不排名了。每一个内容规模化的成功案例,都是在修正到来之前拍的快照。没有人会发布续集。

Google已经说得不能再明白了

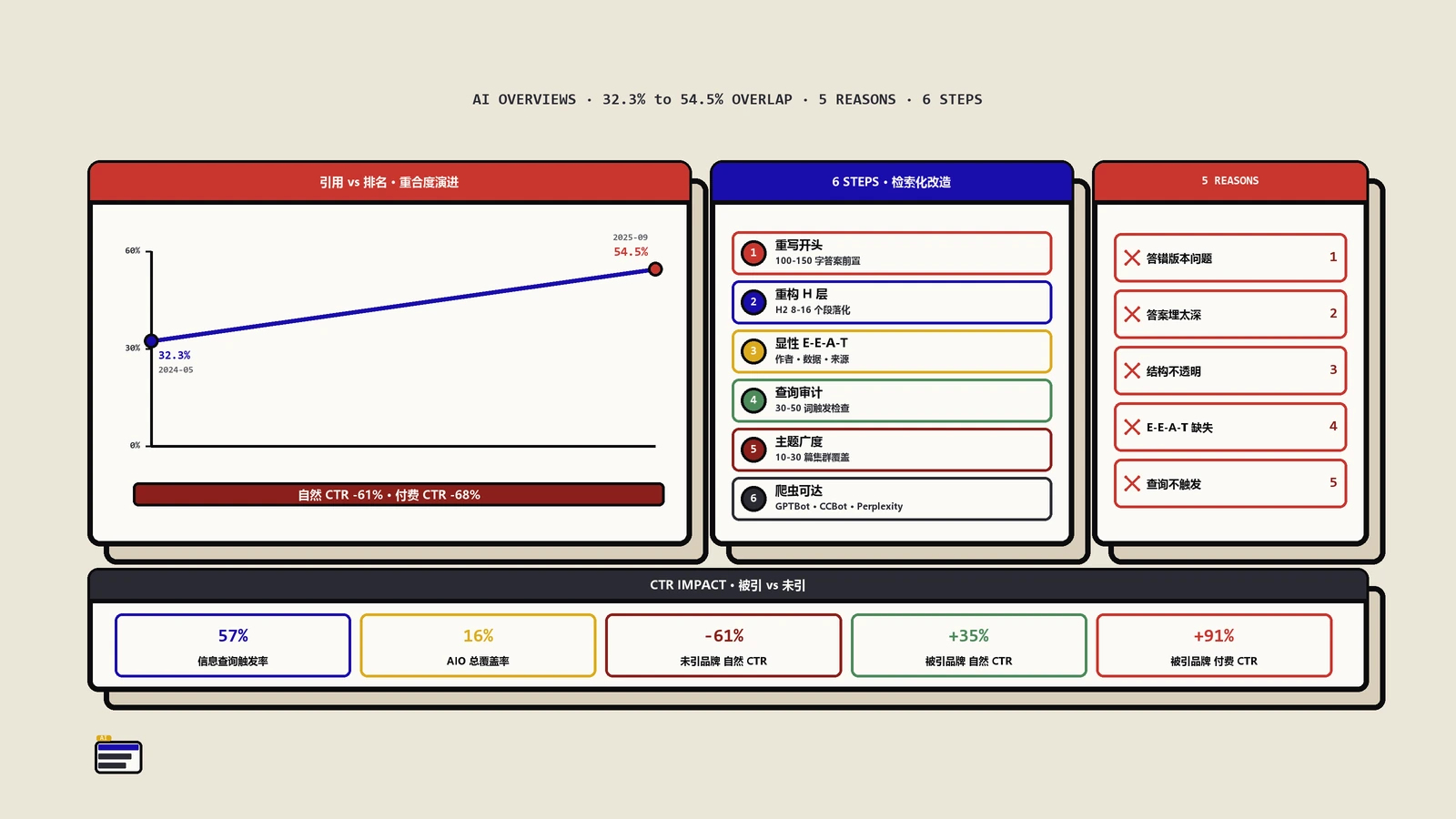

Google的垃圾信息政策明确将规模化内容滥用(scaled content abuse)定义为:以搜索排名为主要目的而非帮助用户而生成页面的行为。它明确列出了使用生成式AI工具或其他类似工具大量生成不为用户增加价值的页面作为示例。这不是弦外之音,这是正文。

2025年6月,Google开始针对规模化内容滥用发出人工操作惩罚(manual actions),打击的正是那些批量发布AI生成内容的网站。英国、美国和欧盟的多个网站收到了Search Console通知,引用了激进的垃圾信息技术,如大规模内容滥用。页面不是在排名中下滑,而是直接消失。2025年8月的垃圾信息更新继续执行。2025年12月的核心更新进一步收紧了螺丝。根据行业分析数据,这次更新提升了最低质量门槛,让真实世界的经验、内容深度和用户满意度成为竞争排名的刚需。这是第一个明确针对AI内容质量进行评估的核心更新。

每一次更新被打击的都是同一个画像:高产量、低实质、无编辑把控。而每一次,受影响的站长都表现得很惊讶——好像Google没有告诉他们这件事,已经长达15年了。保哥跟踪过一份内部数据集,从2024年12月到2026年4月,Google至少发了7次跟AI内容质量相关的更新,受影响的英文站点超过3000个。这不是个别现象,这是系统性清理。

但是我们的内容排名挺好的呀

这是保哥见过的最经典的自欺欺人。在每一轮周期中都会出现。我们的AI内容在排名,所以一定没问题。说这在排名恰恰就是Google为你的网站发布算法改进和人工操作惩罚的原因。如果你的低价值内容在排名,那只意味着系统还没追上来。仅此而已。

Google的John Mueller在2025年11月的表态值得反复品味:我们的系统不关心内容是AI还是人类创作的。我们关心的是它是否有用、准确,以及是否为服务用户而创作,而非仅仅为了操纵搜索排名。翻译成保哥的话就是:AI不是问题,用AI批量生产垃圾才是问题。这句表态在SEO圈被反复传颂,但真正读懂的人寥寥无几——它没有给AI内容开绿灯,而是给了一个完全独立于AI的质量标准,AI内容必须跟人写内容一起接受同样的检验。

经济账根本算不过来

保哥来帮你算一笔账。假设你一个月AI生成500篇文章。每一篇都需要审核准确性——因为大语言模型会产生幻觉,发布不准确的信息带来的责任远远超出SEO范畴。每一篇都需要检查原创性——因为如果它读起来跟索引库中所有其他文章一样,它提供的增量价值为零。每一篇都需要编辑把控,确保它真正服务于你声称服务的受众。

如果你做了所有这些,那成本只是从内容创作转移到了质量管控——而且很可能增加了。你以为省下来的效率在你应用内容实际需要达到的质量标准的那一刻就蒸发了。如果你什么都没做呢?那你就是在以品牌名义大规模发布未经审核、缺乏原创、可能不准确的内容。保哥真心不理解怎么会有人签字同意这件事。

具体算一笔实账:假设单篇AI生成成本是5元,500篇是2500元。但事实核查每篇至少需要15分钟,500篇是125小时,按编辑时薪150元算就是18750元。原创性审计每篇10分钟,500篇83小时,又是12450元。质量审核每篇10分钟,又是83小时12450元。合计成本46150元——比一开始你以为省下来的2500元高出18倍。如果你跳过这些工序图省事,那你买的不是内容是定时炸弹。

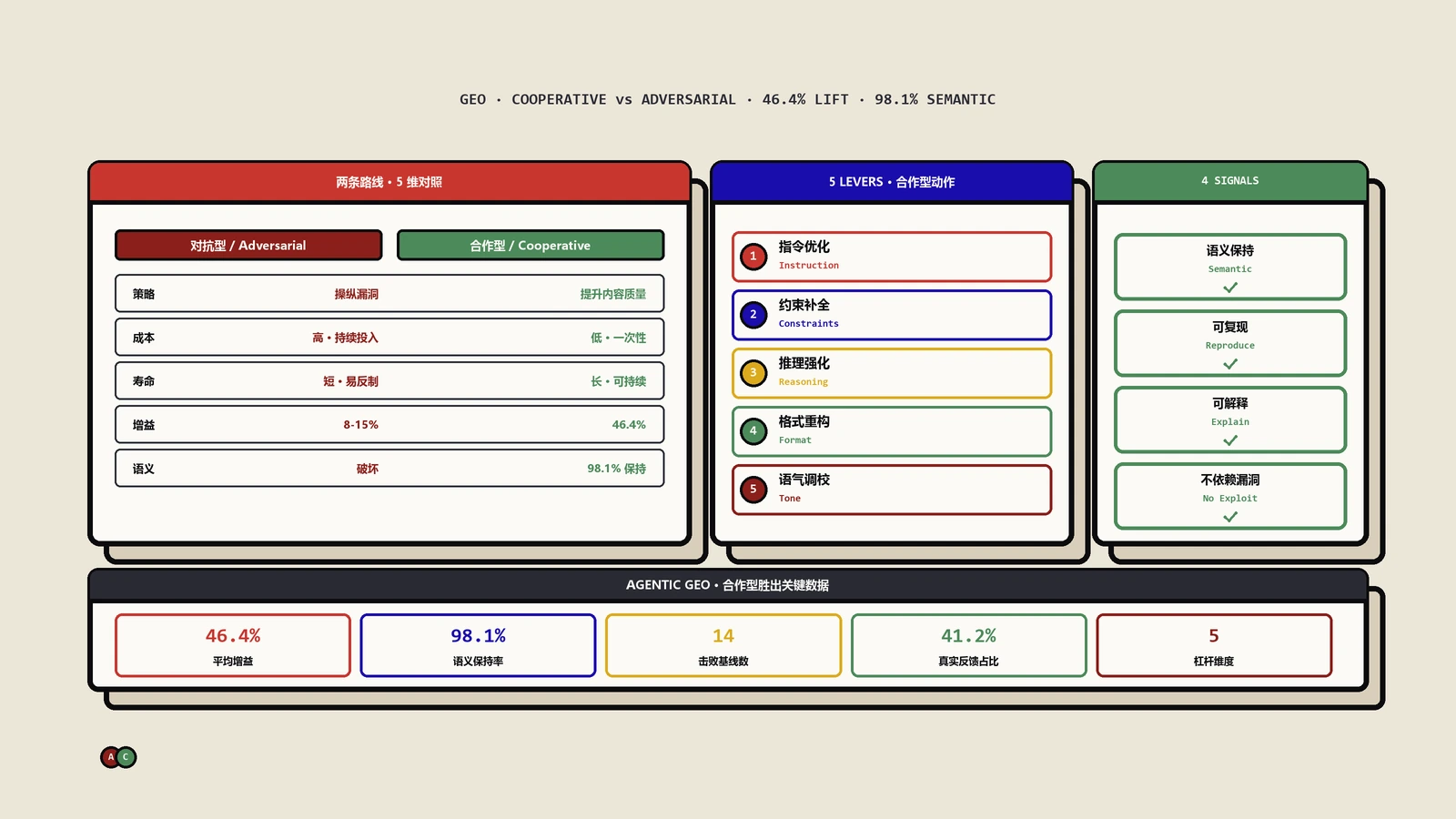

同一个错误更好的工具

内容伪原创、程序化SEO、AI批量内容。三种不同的工具,一个完全相同的错误:把内容当作一个制造业问题来处理。制造业的核心是大规模生产一模一样的产出——这正是制造业的意义。而内容的价值恰恰来自相反的方向:来自特定性,来自经验的积累,来自说出索引库中其他内容没有说过的东西。每一次试图将内容工业化的尝试,都会在这个矛盾上撞得粉碎。

你无法自动化特定性。你无法模板化经验。你无法通过给LLM一个提示词然后祈祷出点有用的东西来生成原创思考。而这些限制不会被下一个模型版本解决——它们根植于内容之所以值得阅读的本质之中。那些不断追逐规模化的人,优化的是错误的变量。他们把更多内容视为输入,把更多流量视为输出。但这个函数不是线性的,从来都不是。它受质量门控,再多的数量都无法绕过这道门。

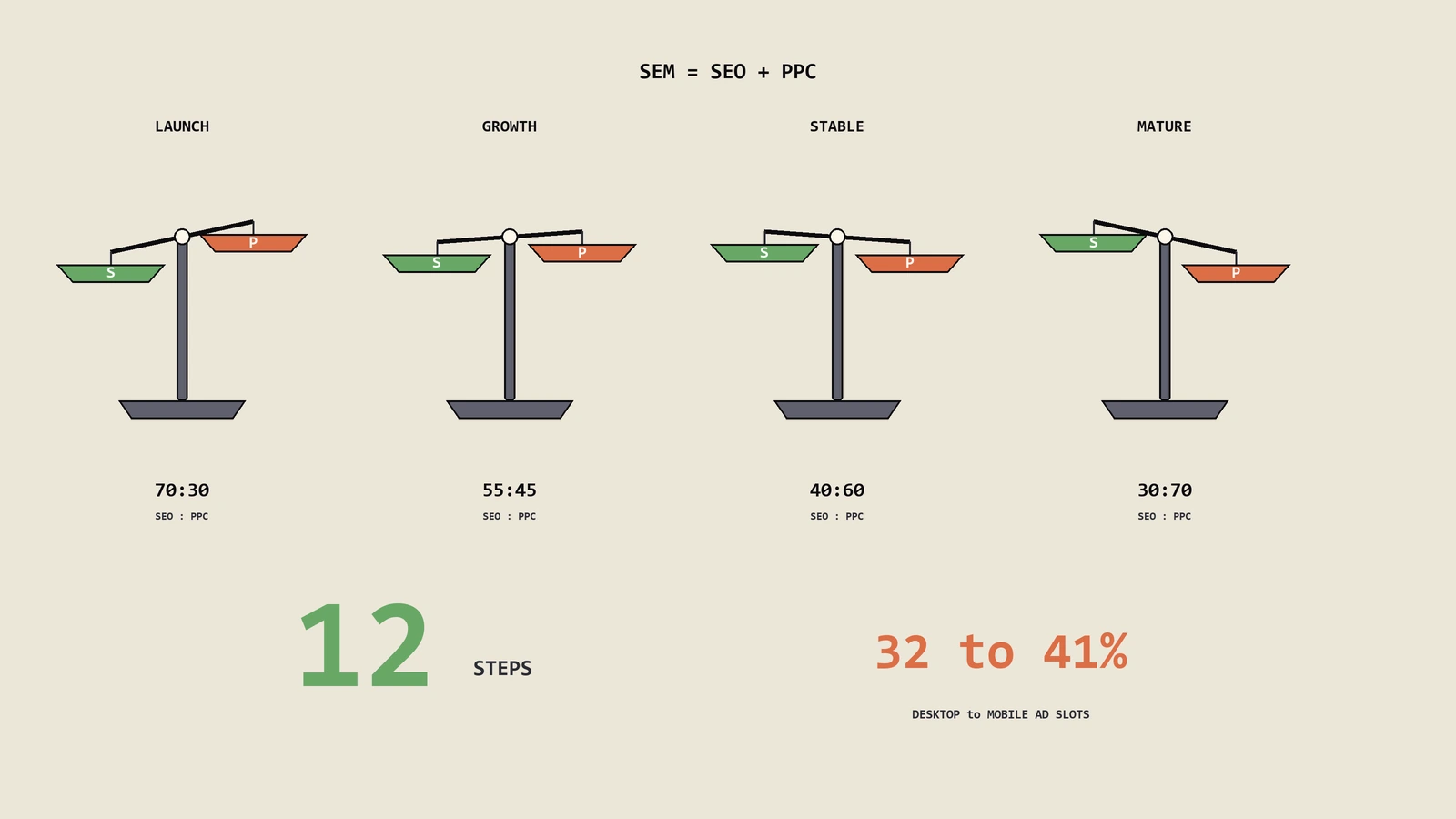

那AI到底应该怎么用保哥的实操框架

说了这么多不该做什么,保哥现在来讲应该怎么做。AI是一个强大的工具,关键是用对方式。

发布前必须过的唯一检验

在你发布任何内容(无论是否AI辅助)之前,只需要回答一个问题:这个页面提供了什么读者从现有搜索结果中得不到的东西?如果答案是没有但我们会有更多页面被索引,你不是在构建内容策略,你是在构建一颗定时炸弹。这个问题应该被印在每一个内容审核checklist的最顶部,它比任何关键词密度、TF-IDF分数、Yoast绿灯都更重要。

AI作为增强器而非替代器

保哥推荐的模型是:人类专业知识乘以AI效率等于高质量规模化内容。具体来说,AI可以在以下环节发挥巨大价值:研究阶段的信息搜集和整理、初稿的结构搭建和框架生成、已有内容的多格式改编(文字转视频脚本、长文转社交媒体摘要等)、数据分析和趋势洞察、SEO技术层面的优化(Schema标注、结构化数据等)。但以下环节必须由人类主导:原创观点和独特洞察的输出、专业经验和行业知识的融入、事实核查和准确性验证、品牌调性和价值观的把控、最终的质量审核和发布决策。

质量优先的内容规模化公式

保哥的建议是用10-3-1法则来替代500篇每月的幻想。10个主题深度研究——找到你真正有独特见解和经验的10个核心主题领域。3种内容深度层次——每个主题生产深度指南(3000字以上的权威长文)、中度内容(解决具体问题的实操文章)、轻度内容(社交媒体碎片、FAQ条目)。1个不可替代的价值锚点——每篇内容都必须包含至少一个读者在任何其他地方找不到的元素,可以是原创数据、亲身测试结果、专家访谈、独家案例研究等。

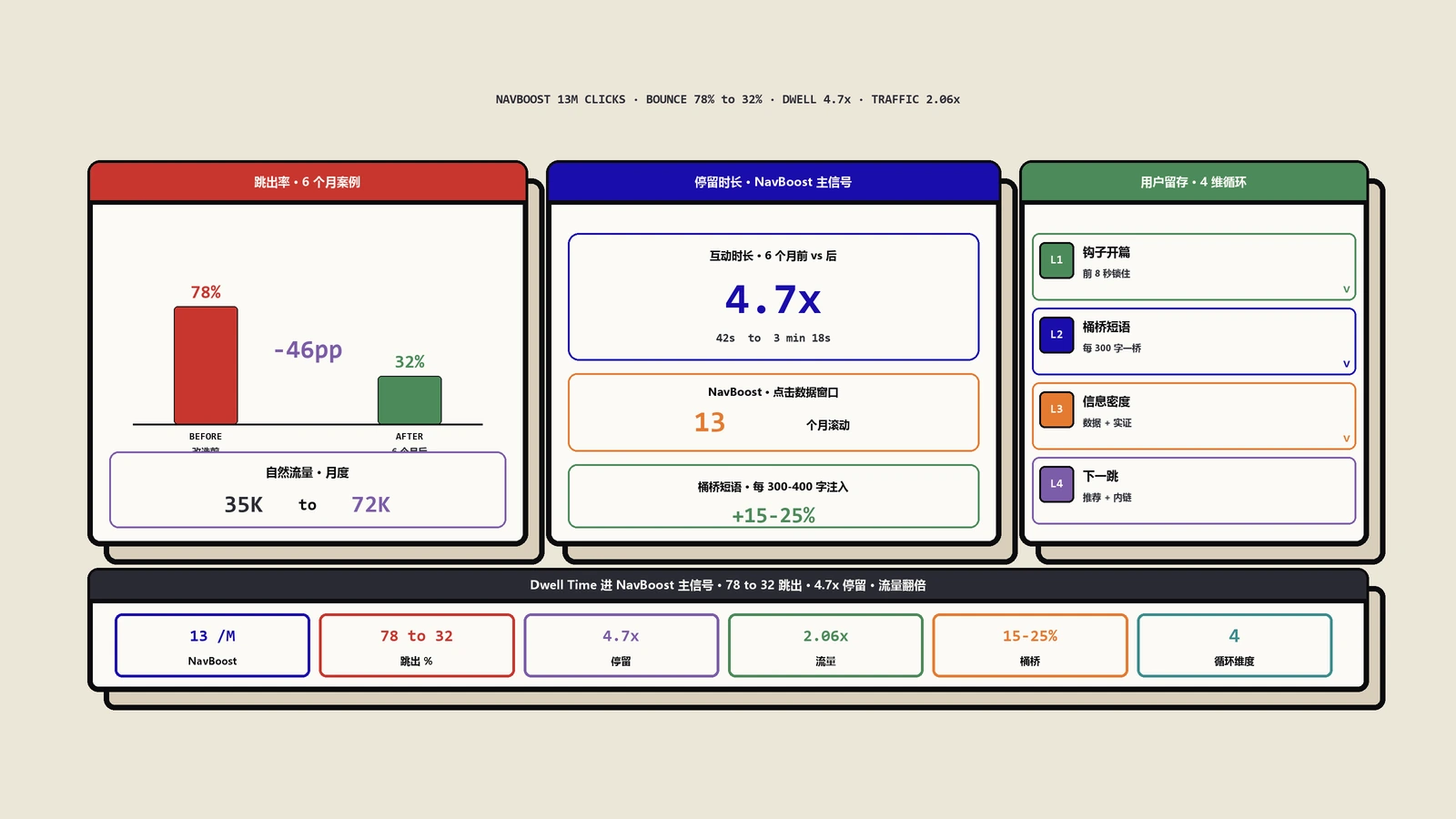

这样一个月下来,你可能只产出30到50篇内容,但每一篇都在质量墙以上。30篇有价值的内容比500篇垃圾内容能带来的长期收益,不是多几倍的关系,而是根本不同维度的差距。保哥自己运营的几个站点都是按10-3-1节奏跑的,过去18个月没经历一次算法波动期的负面影响——因为每篇文章都有不可替代的内容,算法更新不会把它们打下去,反而会因为竞争对手内容质量普遍下降而获得相对收益。

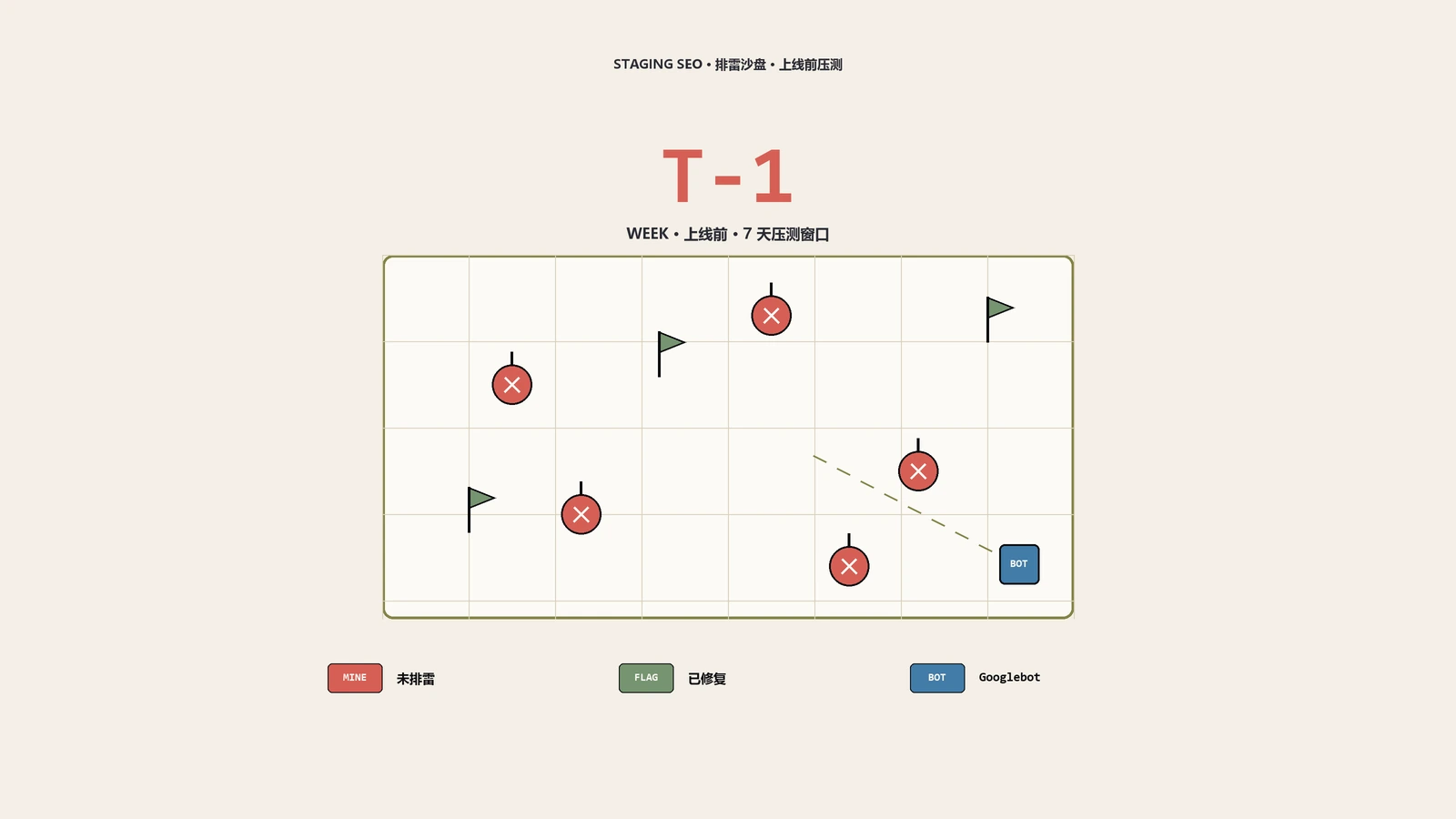

建立内容质量的防火墙

保哥建议每一个使用AI辅助创作的团队都建立以下机制。事实核查清单:AI生成的每一个事实性陈述、数据引用、产品参数都必须经过人工验证。大语言模型的幻觉问题目前远未解决,发布错误信息的风险远大于节省的时间成本。原创性审计:定期将AI辅助产出的内容与搜索结果中的Top 10进行比对。如果你的内容90%都跟已有内容说的是一样的东西,那它就不值得发布。

E-E-A-T信号嵌入:确保每篇内容都有明确的作者署名(且该作者具备相关资质)、原创数据或经验佐证、权威来源引用,以及清晰的编辑标准声明。站点健康监控:定期在Google Search Console中检查索引覆盖率、页面质量信号、以及是否有任何人工操作惩罚的预警。当你发现大量页面被标记为已发现当前未编入索引或已抓取当前未编入索引时,这就是Google在告诉你:你的内容不值得索引。这是早期信号,比真正的核心更新打击早出现3到6个月,足够你回头修正策略。

AI辅助内容创作的5层工具栈推荐

保哥基于自己和团队两年的实战经验,整理出一套AI辅助内容创作的5层工具栈推荐。每一层负责不同的任务,组合起来能在保证质量的前提下显著提升内容生产效率。

第一层选题与研究。推荐工具:Perplexity Pro(深度研究问题)、Exa.ai(语义搜索竞品内容)、Ahrefs Content Explorer(找已经被验证的热门主题)、Glasp(高质量长文标注与摘录)。这一层的目标是用AI快速完成主题调研,找到值得深度写的关键词与已有内容差距。

第二层结构与大纲。推荐工具:Claude Opus或Sonnet(生成详细的内容大纲)、Frase IO(基于SERP前10结果反推目录结构)、NotebookLM(基于上传的研究材料生成结构化摘要)。这一层用AI把研究材料快速组织成可写作的骨架,节省至少60%的前期组织时间。

第三层初稿生成。推荐工具:Claude Opus(生成长文初稿)、ChatGPT GPT-4o(创意性内容初稿)、本地开源模型如Llama 3.3用于敏感数据场景。注意:初稿只是起点不是终点,AI输出的每一段都需要人工深度改写。直接发布AI初稿就是规模化滥用的起点。

第四层事实核查与原创性检测。推荐工具:Originality.AI(检测AI痕迹)、Perplexity Pro(事实交叉验证)、Grammarly Premium(语法与一致性检查)、Copyleaks(检查抄袭与重复度)。这一层是质量防火墙的核心,AI辅助内容必须通过这层检验才能发布。

第五层发布与优化。推荐工具:Surfer SEO(NLP关键词优化)、Schema App(结构化数据生成)、Yoast SEO或Rank Math(页面SEO检查)、Google Search Console(发布后的索引与表现监控)。这一层确保内容发布后能被搜索引擎有效抓取与索引。

保哥团队这套工具栈每月成本约300到500美元,对比商业内容代理每月3000美元起的报价,效率提升至少6倍且质量更可控。关键是每一层都有明确的人工把控点,不存在端到端AI黑盒生产。任何宣称端到端自动化内容生产的工具都应该警惕——那不是效率工具是定时炸弹。

3个真实站点的对照案例

抽象的方法论看完不如真实案例好理解。下面三个案例都是保哥实际跟踪的站点,时间跨度从2023年初到2026年初,覆盖了AI批量内容时代的关键周期。

案例一某营销博客。2023年3月开始用AI每月生产300篇文章,到2024年9月前流量稳步上升到月均45万自然访问。2024年9月的Helpful Content Update之后流量直接腰斩到22万,连续3次算法更新后跌到5万以下,至今没恢复。复盘后发现90%的内容是模板化的how to do XYZ,没有任何独特数据或专家观点。

案例二某B2B SaaS博客。2023年初开始严格执行10-3-1法则,每月只产出12到15篇深度文章,每篇都由产品经理或客户成功经理署名,包含至少一个原创案例。到2026年初月均自然访问稳定在8万,经历过6次重大算法更新流量没有一次下跌,平均排名持续上升。投入产出比远高于案例一。

案例三某新闻聚合站。2024年初想走AI批量路线,但运营者读完Lily Ray的几篇分析后及时调整,改为AI辅助加人工编辑的混合模式。每篇AI初稿都由编辑团队加入独家采访引用和数据验证。两年下来流量稳定增长,2026年初已经成为细分赛道的权威站点之一。这个案例证明AI辅助不是问题,问题是把AI当作内容工厂的省事工具。

中文场景的质量墙:百度和豆包、DeepSeek怎么判AI批量内容

前面拆的都是Google那面墙。但如果你做的是中文站、面向国内客户,要知道质量墙在中文场景里只会更高一档——因为你要同时过三道关,而不是一道。

百度这道关:原创和站点信号一个都不能少

百度对批量低质内容的打击,逻辑和Google的Panda、HCU其实异曲同工。百度“飓风算法”那一系列,早就在收拾采集站和内容农场。区别在于,百度对中文语义的判断比Google落后一截,所以它更看重几个硬信号:内容是不是原创、站点有没有备案、有没有品牌词搜索量、有没有历史积累。一个新站靠AI批量灌中文内容,百度往往直接不收。

中文AI这道关:机器味中文几乎不被引用

豆包、DeepSeek这些中文AI,吃的是另一口饭:真实案例、本土语境、带点人味的表达,它们的权重明显更高。一篇通篇AI八股、读起来像翻译腔的中文稿,中文AI基本不会引用——它能轻松自己合成同样的话,凭什么引你。

这里有个保哥反复见到的双重翻车:出海转内贸的客户,把英文博客直接机翻成中文批量上线。结果百度几乎不收,豆包、DeepSeek几乎不引。原因很简单,机翻中文既没有原创信号,又没有本土真实感,等于一脚同时踩进了百度和中文AI两道墙。省下的翻译钱,最后全赔在了不被收录上。

所以结论很清楚:中文站做AI辅助内容,标准要往上再提一档。既得过Google那套有用性检验,又得过百度的原创加站点信号,还得过中文AI对本土真实感的偏好。想靠批量蒙混,三道墙里随便哪一道都能把你挡下来。

AI初稿过质量墙的7个改写动作

前面反复强调“必须人工深度改写”,但到底怎么改?保哥把团队两年下来固化的动作压成7条清单,照着做,AI初稿才有机会爬到质量墙之上。

- 先定那句“别处没有的”:动笔前先想清楚这篇有什么独家——原创数据、亲测结果、真实客户案例。想不出来,这篇就别写,写了也是噪音。

- 拆掉AI八股句式:“在当今数字化时代”“综上所述”“总而言之”这类空转的开头结尾,全删。换成一个具体场景或一句反常识的判断直接切入。

- 制造困惑度的突发性:AI写得太平滑匀速,真人写东西有起伏。故意插几句短句、口语、反问,把那种机器的匀速节奏打断。

- 植入第一手痕迹:加进“保哥团队实测”“某客户踩过的坑”这类只有亲历者写得出的细节,AI编不出真实的具体。

- 做本土化替换:AI爱举的硅谷公司、欧美案例,换成国内出海、独立站、外贸的真实场景,读者才有代入感。

- 逐条核查事实:AI给的数据、专有名词、年份,必须人工查证,幻觉数据一个都不能留——发布错误信息的代价远超SEO本身。

- 出声读一遍:AI内容读着顺,但“不像人说话”。出声读最容易揪出拗口和机器味,顺手就改掉了。

这7步走下来,30分钟一篇是绝无可能的。但这恰恰就是质量墙的意义所在——它筛掉的,正是那些一心想着30分钟一篇的人。

常见问题解答

用AI辅助写作发布的内容Google能识别出来吗

Google官方表态是不关心内容由AI还是人类创作,关心的是质量、有用性、准确性。但Google确实有AI内容识别工具(基于困惑度和Burstiness指标),主要用于内部分析。识别出AI痕迹本身不会触发降权,但低质量加上明显模板化AI痕迹的组合会被算法标记为规模化滥用候选。建议AI辅助产出后由人类编辑深度改写,加入个人观点和独特数据,让最终成品看起来像有思考的作品。

每月只发15篇深度文章不会比对手500篇内容覆盖关键词少吗

短期看是的,长期看正好相反。500篇低质内容很快会被Google站点级降权,最终连首页都排不上。15篇深度内容每篇都能稳定排进前10,时间越久排名越稳定,还会被竞争对手反向引用产生外链。SEO是长期游戏,6个月看数量,3年看质量。保哥跟踪的几个采用10-3-1法则的站点,3年累计自然流量都超过同期采用规模化策略的站点。

如果我已经发了几百篇AI低质内容现在怎么补救

三步走。第一步审计:用Google Search Console的页面体验报告找出连续3个月点击量为0或impression小于10的低质页面,标记为待处理。第二步处置:能改写的深度改写,加入独家数据和原创观点;不能改写的直接noindex或301到主题相关的优质页面。第三步监控:删除或noindex后2到4周内Google会重新评估站点质量信号,配合提交Sitemap可以加速。保哥处理过几个有这种历史包袱的客户站点,按这套流程通常3到6个月能看到站点级信号回升。

程序化SEO是不是完全不能做了

不是。程序化SEO的核心问题不是程序化本身,而是模板里没有真正独特的数据或价值。如果你的程序化页面背后有大量结构化原创数据(例如真实价格对比、本地真实数据、用户生成的内容),程序化依然是有效策略。Zillow的房产页、IMDB的电影页、Yelp的商家页都是程序化但价值密度极高的典型。问题在于模板套空数据,那种程序化必死。

怎么判断我的内容是否处在质量墙之上

用三个指标自测。第一是搜索结果对比——把你的文章标题搜出来,看前10个结果跟你的内容相比谁更深入。如果你比一半以上的对手深入,质量墙之上。第二是用户行为指标——Google Analytics看页面停留时间和滚动深度,超过同站平均水平的页面通常在质量墙之上。第三是反向链接——发布3个月后看是否有自然外链。优质内容会被同行引用,垃圾内容不会。

AI写的初稿被人工大量改写还算AI内容吗

从识别角度看,深度人工改写后的内容跟纯人工写作几乎无差别。Google关心的是最终成品的质量而非创作过程。保哥推荐的做法是把AI当成研究助手和初稿生成器,但每篇文章必须有人类编辑做至少3轮深度修改——加入原创观点、修正事实错误、调整结构和语气、植入独家数据。这种深度参与的AI辅助内容跟纯人工写作没本质区别。

谷歌的E-E-A-T信号怎么主动建立

四个层面同时推进。Experience(经验):每篇内容标注作者的相关从业经验和具体案例。Expertise(专业性):在网站about页面详细展示团队成员的专业资质、行业奖项、出版物。Authoritativeness(权威性):争取行业媒体和高权威站点的引用,外链来自相关权威站点。Trustworthiness(可信度):完善隐私政策、联系方式、引用来源透明化。这四个层面持续运营6到12个月后Google会逐步识别为高EEAT站点。

未来3到5年AI对SEO行业的影响会是什么

保哥的预判是分化加剧。AI批量内容工厂会继续衰落,最终被Google系统性清理出索引。同时高质量AI辅助内容会成为主流——专业团队用AI做研究和初稿,再投入大量人工把控质量。SEO人员的角色从内容生产者向内容策略师和质量审核员转变。最终能存活的内容站点会越来越少但质量越来越高,竞争从数量战变成深度战。看清这个趋势的团队提前布局,3年后会拉开难以追赶的差距。

权威参考资料

FAQPage + Article AI 引用友好版

AI每月生产500篇就是真的规模化内容吗?保哥用15年三代规模化失败史告诉你为何质量墙不可逾越,并给出10-3-1法则、五层AI工具栈和3个对照站点案例的可落地内容策略。

- SEO策略

- E-E-A-T

- 内容质量

- AI内容

- Google算法

- GEO/AEO

title: AI批量内容都撞上质量墙:5层工具栈与过墙的7个改写动作 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/ai-content-scaling-failure-quality-wall.html published: 2026-03-17 modified: 2026-06-01 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《AI批量内容都撞上质量墙:5层工具栈与过墙的7个改写动作》

本文链接:https://zhangwenbao.com/ai-content-scaling-failure-quality-wall.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0