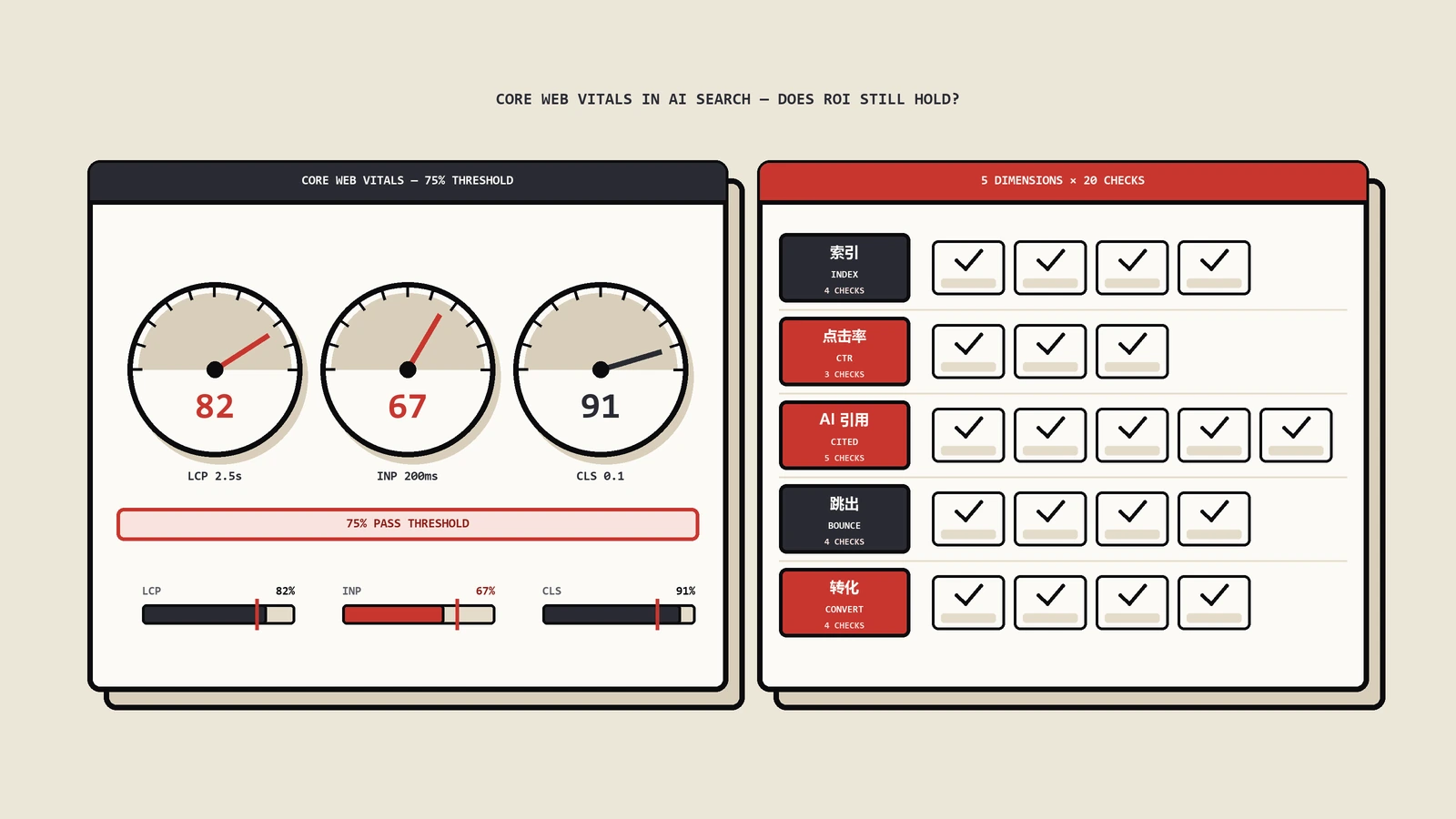

Core Web Vitals在AI搜索时代还值不值得投?行业基准与ROI测算

本文目录

- Core Web Vitals在AI搜索时代的真正重要性

- 三个指标各自管什么

- 75%门槛的实际意义

- Jakob Nielsen的三层响应时间模型还能用

- 这个模型放在AI搜索语境里

- 行业benchmark不只是CWV

- 新维度——AI检索相关指标

- 顺便聊几个客户实测里发现的反常识细节

- 免费工具做行业benchmark的具体路径

- 用Chrome DevTools做手工benchmark

- 不同行业的CWV基准值是被忽略的细节

- 一个被低估的优化:图片格式与图床策略

- 性能优化对AI检索的影响机制

- 性能优化的真实ROI不只看流量

- 出海站CWV的头号隐形杀手:国内云CDN的海外TTFB陷阱

- 被忽略的LCP杀手:中文Web字体怎么拖垮双语出海站

- 常见问题解答

- 没预算用DebugBear付费工具怎么办

- SPA站LCP怎么优化

- INP高了影响AI检索吗

- CrUX数据延迟多久

- 性能优化的优先级怎么定

- 移动端比桌面端慢多少正常

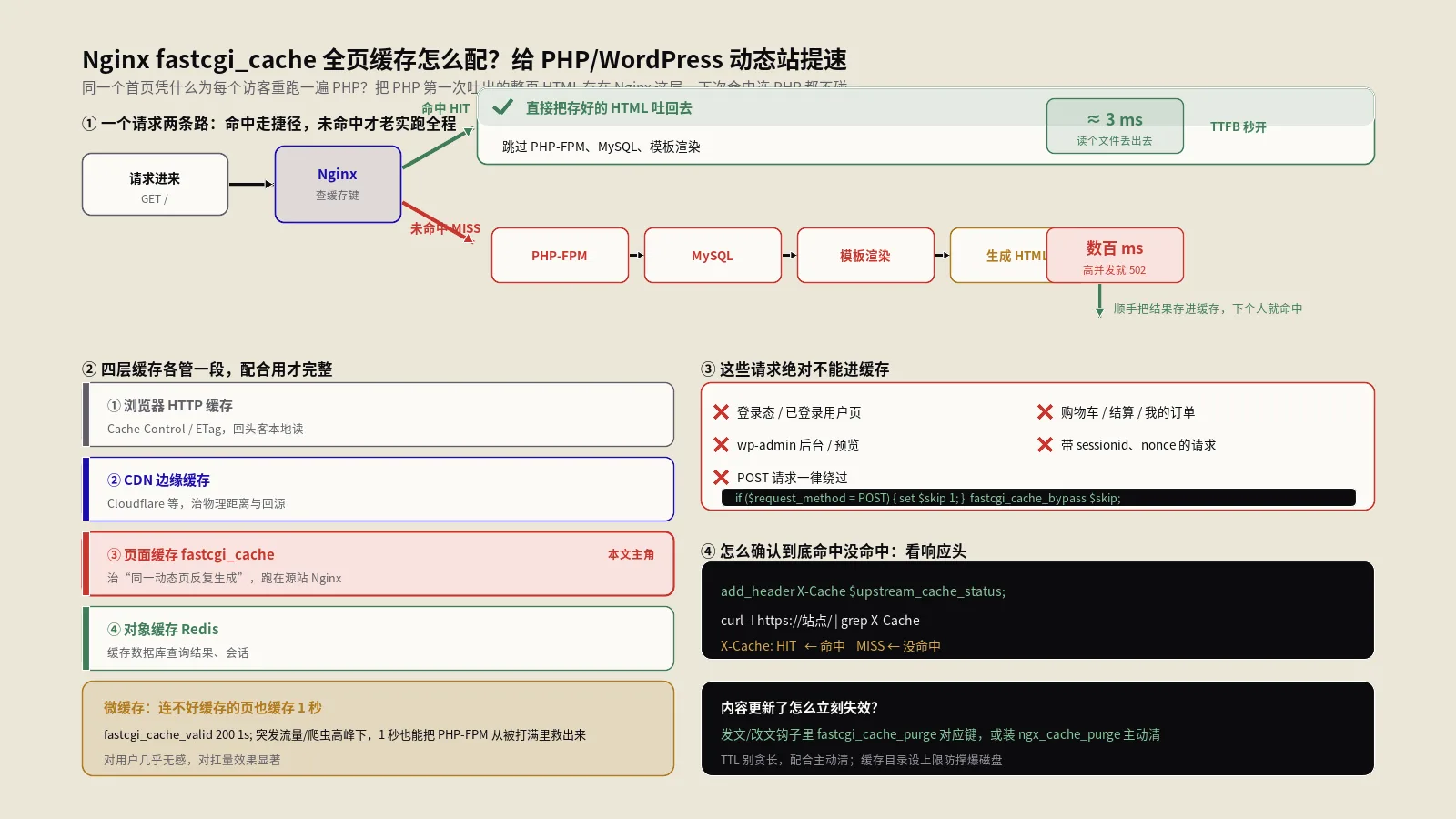

- cache和performance的关系

- 性能优化能带来多少自然流量增长

- 权威参考资料

摘要:Perplexity爬虫的超时阈值只有两到三秒、Gemini对慢站直接放弃,Core Web Vitals从加分项变成了AI搜索的准入门槛。本文从工具厂商的内容营销文里挖出被埋的核心洞察,讲图片格式与图床这个被低估的优化、性能优化对AI检索的影响机制,给免费工具做行业基准的路径和真实的多维度ROI。

"网站性能"这个话题在SEO圈是常青藤——讲了二十年了,每年都有人说"这次真的重要起来了"。2026年的特别之处是:Core Web Vitals第一次跟AI搜索的citation选择产生直接耦合。Google AI Overview在选citation源时把页面加载性能也算进权重,慢站就算内容写得再好也容易被踢出候选池。

但讲性能benchmark的文章千篇一律——LCP多少、INP多少、CLS多少,下面甩个工具截图。真正有用的是怎么看你站在行业里的位置、怎么定优化优先级、怎么把性能数据翻译成具体的商业价值。这篇就聊这几个被反复忽略的细节。保哥服务过的5个DTC独立站客户做了性能改造后AI Overview citation的变化都很明显,文里穿插几个具体数据。

Core Web Vitals在AI搜索时代的真正重要性

过去几年Core Web Vitals被定位成"SEO排名加分项"——做得好有点用,做不好也不会死。这个判断在传统搜索时代基本对,到了AI搜索时代失效了。

原因不在于Google把CWV权重调高(实际权重没怎么动),而在于AI检索的工作方式让性能成为retrieval阶段的硬门槛。Perplexity的爬虫超时阈值很短(通常2-3秒);Gemini URL grounding对慢站直接放弃;ChatGPT browsing虽然走Bing通道但同样会跳过加载超过5秒的页面。

慢站的内容根本进不了AI候选池。这跟"排名因子"是两个量级的事情——前者是"加分项",后者是"准入门槛"。门没开你写多好都没用。

三个指标各自管什么

Core Web Vitals现在的三件套:

LCP(Largest Contentful Paint)测页面加载速度。具体就是首屏最大块内容(通常是hero image或H1)多久能显示。Google建议2.5秒以内算"good",超过4秒算"poor"。AI爬虫的容忍阈值通常比Google宽,但LCP超过6秒大概率就被跳过。

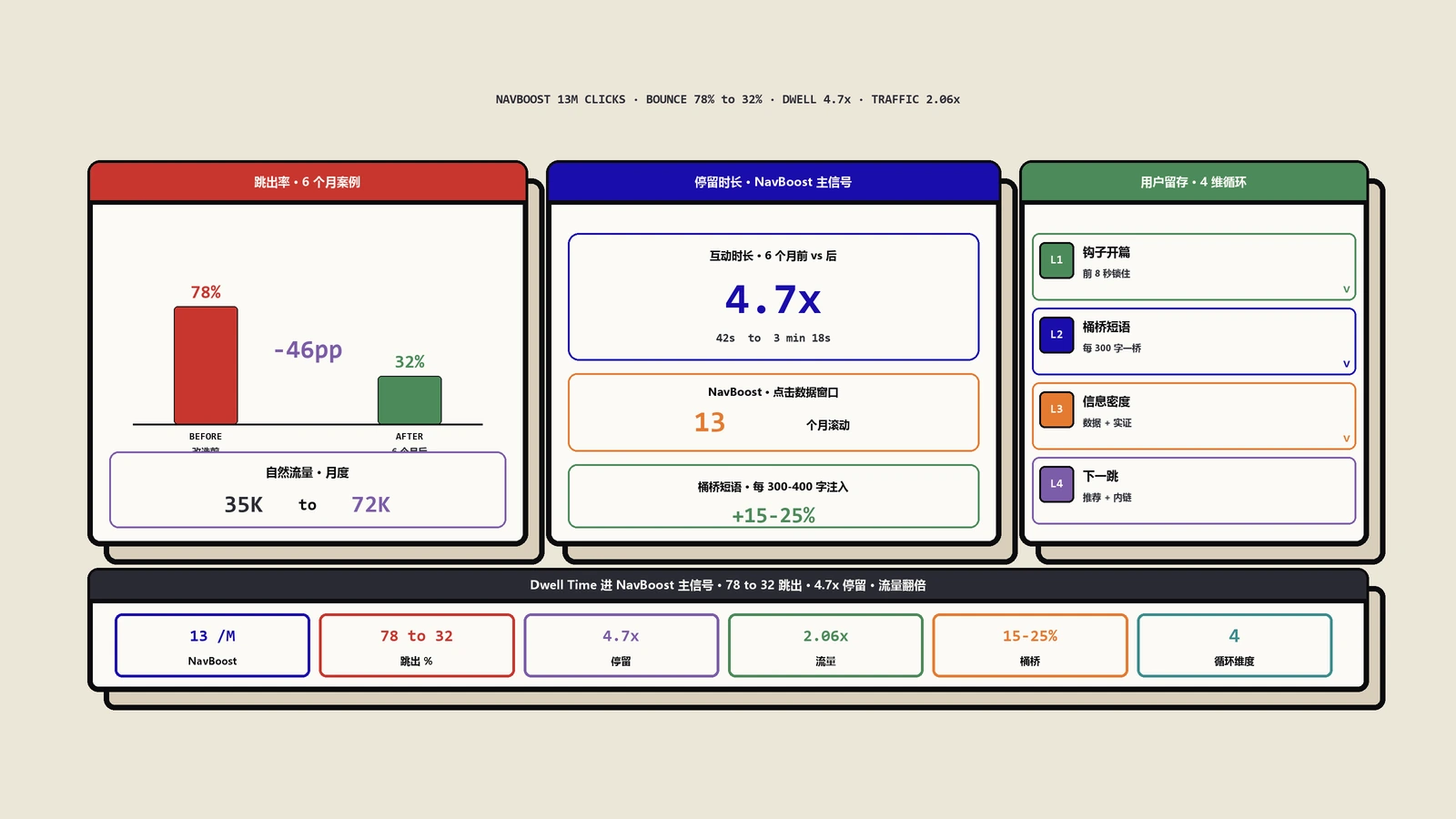

INP(Interaction to Next Paint)测页面对用户交互的响应速度——2024年正式替代了FID。具体测从用户点击/输入到下一次视觉反馈的延迟。这个对AI检索影响相对小(AI爬虫不模拟用户点击)但对真实用户体验影响巨大——INP高的站用户体验差、跳出率高,间接影响AI对站点quality的判断。

CLS(Cumulative Layout Shift)测视觉稳定性——加载过程中元素是否乱跳。这个跟AI检索关系不大,主要影响真实用户的"恶心程度"。但CLS高的站在Google算法里被识别为"low quality UX",间接影响排名。

75%门槛的实际意义

Google对CWV的判定不是"平均值"——是"75%的访问要在阈值以内"。这个细节很多人没注意。你站的P75性能才是Google看的指标,P50或平均值都不重要。

这意味着你即便有大量快速的桌面端访问,如果移动端长尾用户(用4G/3G)的P75数据差,整个站还是不达标。所以性能优化的真正难点是长尾差用户的体验——不是平均水平。

Jakob Nielsen的三层响应时间模型还能用

Jakob Nielsen这个名字让很多新一代SEO感到陌生——他是1990年代用户体验研究的奠基人之一。但他三十年前提出的响应时间三层模型至今没人能给出更准的替代。这个模型放到AI搜索时代依然成立。

三层是这样:

0.1秒——用户感觉"即时"的阈值。点击一个按钮在0.1秒内反馈,大脑认为是"瞬间响应",不会感知到延迟。这个阈值在SPA时代很难做到——React/Vue的虚拟DOM diff + 重渲染本身就常常超过这个时间。所以为什么Nielsen的0.1秒原则在2026年依然有用:它逼你优化最关键的交互路径,让点击/输入/滚动这些动作真正"即时"。

1秒——用户"不分心"的阈值。一个页面在1秒内完成内容显示,用户可以"无缝"浏览,不会因为等待而分心去看别的事情。超过1秒就开始走神。AI Overview在SERP头部展示时给的"链接预览"加载体验如果超过1秒,用户大概率不会点。

10秒——用户"注意力丢失"的阈值。超过10秒用户基本会切到别的tab、离开页面、或者点回退。10秒是底线,不是目标。

这个模型放在AI搜索语境里

用户在ChatGPT或Perplexity里看到一个citation,决定要不要点进去——这个决策窗口非常短,大约2-3秒。citation链接对应的页面如果在3秒内没显示首屏,用户大概率回到AI界面继续问下一个问题。

所以性能优化对AI搜索的真实价值不只是"AI爬虫能爬到",更是"AI带来的人类访客真的能停下来"。两层价值叠加,Core Web Vitals的ROI比传统SEO时代高。

"The 1-second response limit is the threshold above which users feel they are waiting for the computer. Beyond this, the natural flow of cognition breaks, and the user's mind begins to drift to other tasks." —— Jakob Nielsen, Nielsen Norman Group, foundational UX research (still cited 30+ years later)

行业benchmark不只是CWV

行业里那些DebugBear/SpeedCurve类工具厂商的内容营销文讲的是"用CrUX数据建立行业benchmark dashboard"——动作没问题,但只看Core Web Vitals三个指标其实不够。2026年完整的性能benchmark应该有更多维度。

具体哪些值得追踪:

第一个是TTFB(Time to First Byte)。这测服务器响应速度——从浏览器发请求到收到第一个字节的时间。TTFB是LCP的子分量,但单独看更能定位"服务器问题"还是"前端问题"。慢站如果TTFB低(200ms以下)但LCP高(4秒以上),瓶颈在前端渲染;TTFB高(1秒以上)则瓶颈在服务器(数据库慢/接口慢/PHP执行慢)。

第二个是JS payload size。具体是页面加载的JS总字节数。这个数据PageSpeed Insights和WebPageTest都能给。SPA站JS payload经常超过1MB,导致移动端用户加载缓慢。JS payload超过500KB的站在AI检索时代基本是性能短板。

第三个是renderblocking resources——阻塞渲染的CSS/JS文件数量。每个renderblocking resource都会让LCP多等几百毫秒。优化方向是把CSS critical部分inline、JS全部defer或async。

第四个是resource hint coverage——preload/preconnect/dns-prefetch这些hint用了多少。一个用对了hint的站LCP可以比同等内容站快30-40%。

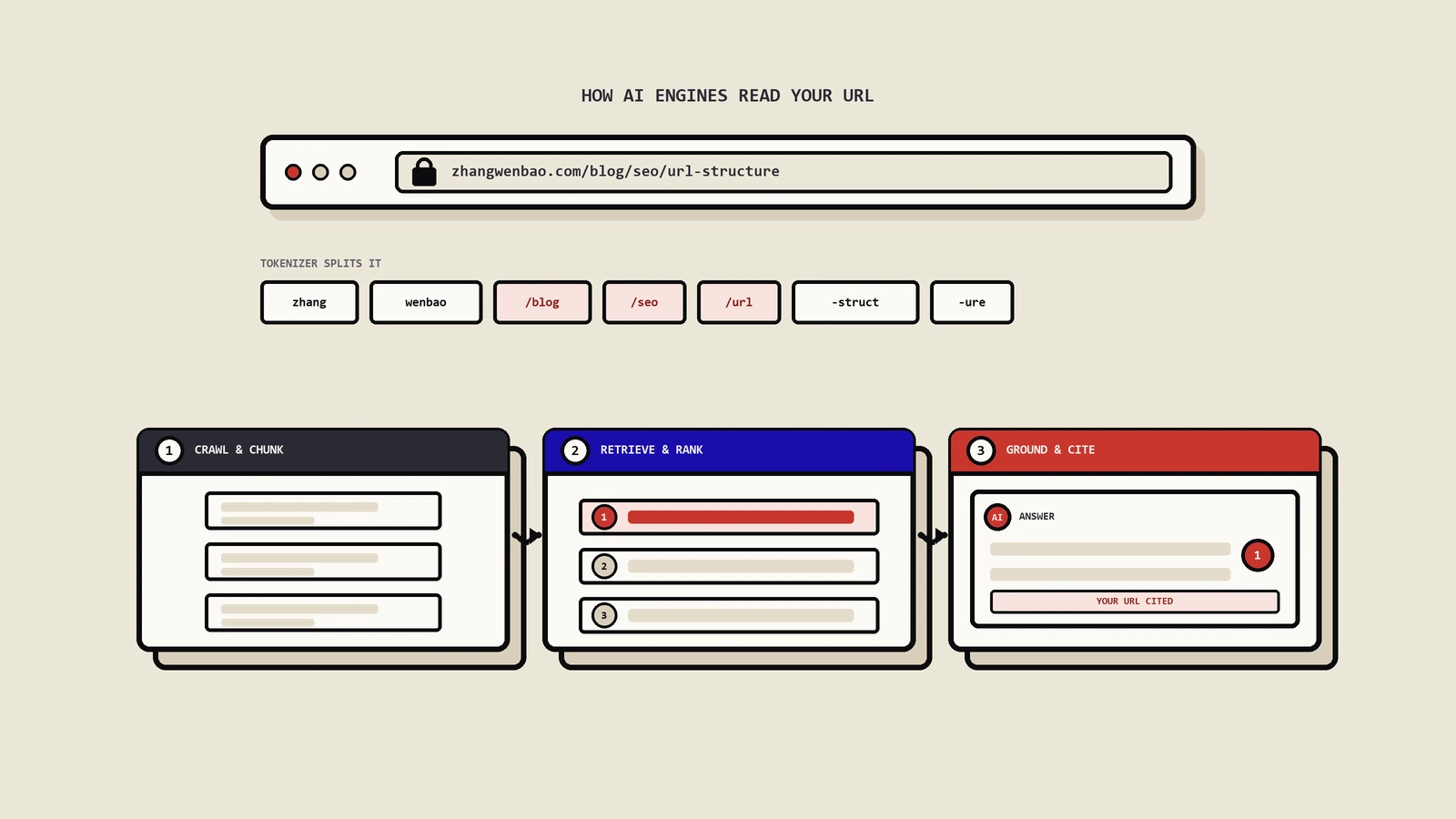

新维度——AI检索相关指标

这些是2026年新加的、传统CWV不覆盖的:

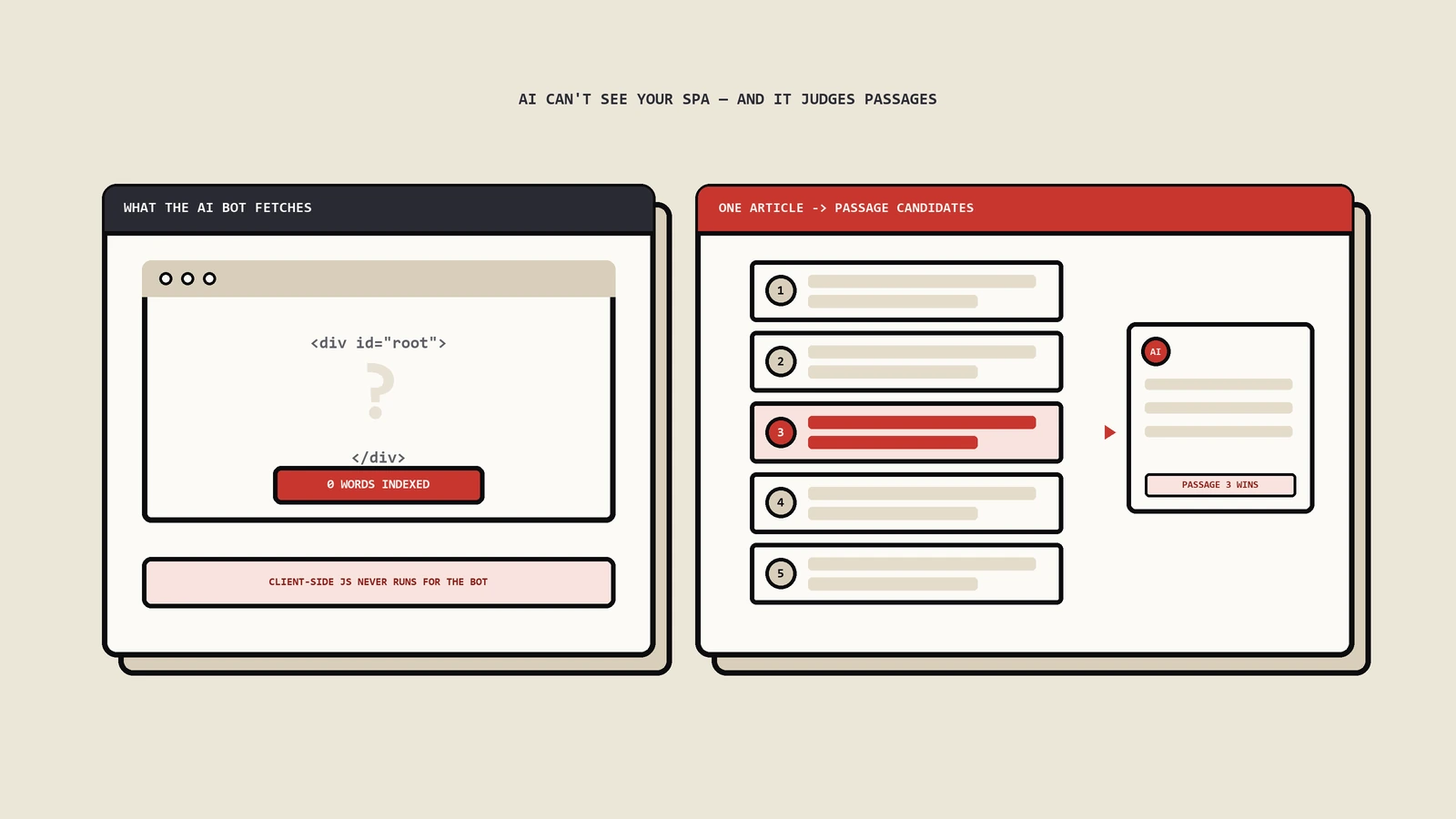

SSR完整度——首屏HTML里是否包含完整内容(不依赖JS执行)。这个不能用PageSpeed测,要用 curl 抓页面看返回HTML里有没有core content。SSR完整度直接决定Perplexity和Gemini能不能看到你的内容。

passage extractability——页面DOM结构是否清晰让AI能chunk。具体看H层级是否规范、段落是否合理切分、内容是否塞在tab/accordion里。这个目前没有自动化测量工具,得人工逐页审。

citation count baseline——你站当前在ChatGPT/Perplexity/Gemini/Claude里被引用的次数。每月手动跑20个核心查询统计citation次数。基准建立后才能衡量优化是否有效。

顺便聊几个客户实测里发现的反常识细节

过去半年带3个不同行业的客户做性能优化,发现几个常规教科书不会讲的现象。

第一个反常识——CDN不是万能药。一个北美DTC户外品牌客户的站点已经上了Cloudflare Pro CDN,但LCP始终在3.5秒徘徊。挖下去发现Cloudflare的cache rule写得太宽——cookies带过来的页面(登录用户)全部bypass cache,结果80%的访问都跳过CDN直接打源服务器。修了cache rule把"non-auth pages"统一缓存后,LCP从3.5秒降到1.8秒。CDN买了不等于用了。

第二个反常识——WordPress站的性能瓶颈80%在主题/插件,不在主机。一个北美内容站客户用了一个看着不错的paid theme,跑PageSpeed发现Total Blocking Time高达2秒,根因是主题加载了一个6MB的slider plugin(在不用的页面也加载)。换了一个minimal theme后LCP从4秒降到2秒。主机配置反而几乎没动。

第三个反常识——Lighthouse分数和真实CrUX数据可以差很多。Lighthouse跑的是实验室环境(固定网络/固定CPU),CrUX跑的是真实用户。一个客户的站Lighthouse Performance分数95(绿色),CrUX里的P75 LCP却是5.2秒(poor)。原因是Lighthouse用的Fast 3G模拟,但真实用户里有大量4G+弱信号场景。看Lighthouse就用Lighthouse、看真实用户就看CrUX,不要混着用。

免费工具做行业benchmark的具体路径

DebugBear这种付费工具好用,但中小站完全可以用免费工具拼出一套benchmark系统。说白了就三件事:拉数据、建表、定期跑。

拉数据用PageSpeed Insights API免费版。每个URL每月可调用25000次(足够中小站用),返回CrUX真实用户数据 + Lighthouse实验室数据。脚本约50行Python批量调用、把结果写进CSV。

建表用Google Sheets或Notion。每列对应一个指标(LCP/INP/CLS/TTFB/JS size),每行对应一个站(你的站 + 3-5个竞品)。每周或每月拉一次数据更新到sheet。

定期跑用GitHub Actions或Cron定时调用PageSpeed API把新数据追加到sheet。如果担心免费配额,加一个check避免重复调用同一URL。

整套系统第一次搭建花2-4小时,之后基本零维护。比订阅付费工具便宜。

用Chrome DevTools做手工benchmark

如果你只是想偶尔深入分析一个页面(比如某个竞品突然涨了排名想看为什么),Chrome DevTools的Lighthouse + Performance面板足够。具体步骤:

打开匿名标签(避免插件干扰)—— 加载竞品URL——DevTools的Lighthouse run一次benchmark——看Performance分数和Opportunities段。这一步能给你具体的优化建议(哪些资源大、哪些请求慢、哪些CSS未使用)。

更深入的用Performance面板录制一次页面加载,看瀑布图。哪个请求阻塞了渲染、哪个JS执行时间长——细节都在那里。

不同行业的CWV基准值是被忽略的细节

"Performance metrics evaluated in isolation mislead. A 2.0s LCP is excellent for an enterprise SaaS marketing site, mediocre for a news publisher, and disqualifying for a high-frequency trading dashboard. Industry context is the missing variable in most performance benchmarks." —— Chrome User Experience Report analyses, 2025-Q3综述

"LCP应该2.5秒以内"是Google的通用建议,但不同行业的真实基准差异很大。你直接拿2.5秒作目标,可能在你那个行业里其实是落后水平。

大致的行业benchmark(基于CrUX公开数据汇总):

新闻媒体——头部站点的P75 LCP通常在1.5-2秒。这是个被cdn/edge cache玩得很熟的行业。如果你做新闻站LCP在3秒还沾沾自喜,你已经落后top 50%。

电商——头部站点P75 LCP通常2-3秒。Shopify默认主题在2-2.5秒,Magento/自建商城在3-4秒。一个DTC品牌站LCP在4秒在电商里算偏慢。

SaaS marketing站——头部站点P75 LCP通常1.5-2.5秒。这个行业前端技术栈普遍现代(Next.js/Astro/Hugo),优化做得早。SaaS站LCP超过3秒是技术债务信号。

内容博客——头部站点P75 LCP通常2-3秒。WordPress站点占比高,因主题/插件原因常常拖累LCP。WordPress站LCP在3-4秒属于常态。

政府/教育.gov/.edu——P75 LCP常常3-5秒甚至更高。这些站点的性能优化做得普遍差,但因为内容权威信号强,影响不大。

知道你的行业基准后,目标设定就不一样了。不要拿Google的通用建议当目标,拿行业top 25%的实际数据当目标。前者太宽松或太严格,后者贴近现实竞争。

一个被低估的优化:图片格式与图床策略

聊CWV优化绕不开图片。但大部分文章给的建议都停留在"用WebP代替JPEG"。这个建议2020年还有用,2026年的图片优化层次更深。

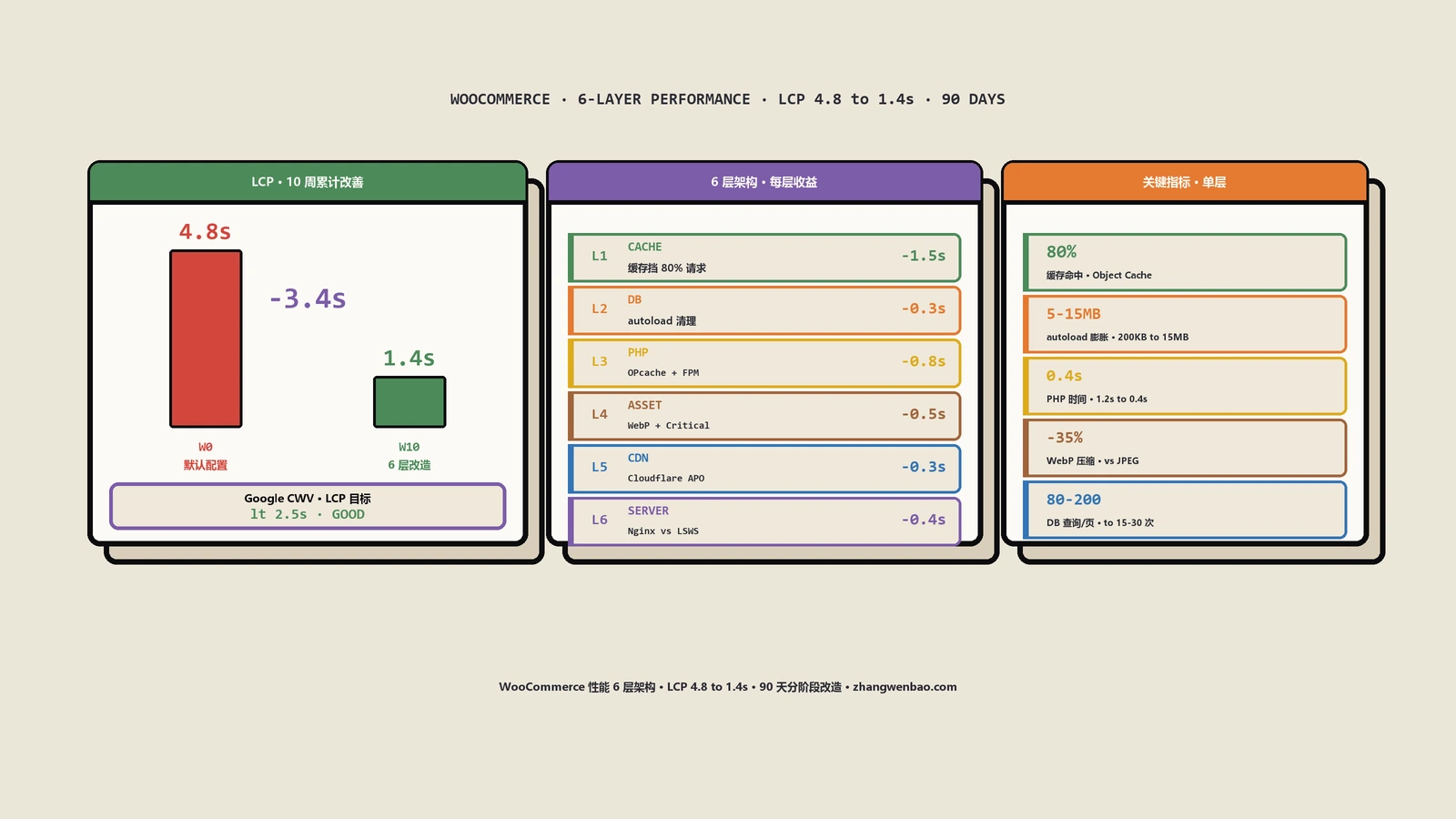

现在的图片优化路径其实有四层。最基础那一层是格式——AVIF比WebP再小30%-50%,浏览器支持已经覆盖95%+。直接上AVIF(保留WebP作为fallback、JPEG作为最终fallback)是2026年的合理选择。

第二层是响应式图片。srcset和sizes属性让浏览器选最合适的尺寸。移动端用户拿到的不应该是桌面端的1920x1080——而是720x405之类的小图。<picture>标签能进一步根据浏览器能力选不同格式。

第三层是loading="lazy"属性。首屏外的图片让浏览器延迟加载,LCP直接受益。但有个坑:首屏图片千万不要加lazy——LCP会被延迟,反而变差。这个错误在改造老站时反复出现。

第四层是图床的物理位置。如果你的站在美国但图床还放国内CDN,欧美用户访问图片绕一圈太平洋——延迟加几百毫秒。图床应该跟着用户主要地理位置走。Cloudflare R2 / Bunny CDN / Fastly都是合理选择,免费/低价的Cloudinary也能用。

四层都做对的站LCP相对没做的能降1-2秒。这是图片占首屏内容比例高的站(电商/作品集/News)的高ROI优化。

性能优化对AI检索的影响机制

把性能优化分成"对AI检索有用的"和"对真实用户有用的"两组——两组有重叠但不完全相同。

对AI检索直接有影响的:

首先是TTFB。AI爬虫对服务器响应特别敏感——Perplexity-Bot/Gemini-Bot的超时通常2-3秒。TTFB超过1秒就接近超时阈值,TTFB超过3秒大概率被跳过。优化方向:服务器响应优化、CDN边缘缓存、PHP/Node应用层优化。

其次是首屏HTML的SSR完整度——AI爬虫看的是SSR返回的HTML,不执行JS。如果你站CSR渲染,首屏HTML是空的,AI看不到内容。优化方向:上SSR/SSG。

第三是HTTP响应头里的cache-control / etag等。AI爬虫第二次访问时如果命中cache可以快速拿到内容更新。这个细节大部分站没做对——动态CMS默认不缓存。

对真实用户有直接影响(间接影响AI对站quality的判断):

LCP和INP是用户感知的核心——慢站用户跳出快。Google通过NavBoost等机制把"用户停留/lastLongestClick"作为信号。慢站长期会被Google降权,间接影响AI在选citation时对站点的quality评分。

CLS对页面被"看完"的概率有影响——视觉跳来跳去的页面用户会本能关闭。这个间接信号同样进入Google的quality评估。

性能优化的真实ROI不只看流量

很多团队报告性能优化效果时只盯自然流量增长——这是一个角度但不全面。完整的ROI维度有这些。

第一是转化率提升。慢站用户跳出快、加购少、结账成功率低。LCP从4秒降到2秒,电商站结账完成率通常涨5%-10%。这是直接收入影响,比自然流量增长更具体。

第二是广告投放成本下降。Google Ads的quality score含landing page experience一项,慢站质量分低、单次点击成本被加价。性能优化能让CPC下降5%-15%——预算大的站这一项就能覆盖所有优化投入。

第三是AI citation带来的brand awareness。前面讨论过的——AI Overview曝光不带来直接点击但带来brand记忆。性能优化让你站进入更多AI候选池、被更多用户在AI回答里看到,brand search几个月后会同步上涨。这个长尾价值在年度复盘时才看得清。

出海站CWV的头号隐形杀手:国内云CDN的海外TTFB陷阱

前面聊CDN时说“买了不等于用了”,对国内出海站还有更扎心的一层——你用的那家CDN,海外节点可能根本就不行。保哥服务的出海客户里,相当一部分起步时图便宜、图熟悉,直接套了阿里云或腾讯云的CDN。这些云厂商的节点密度在国内确实顶级,但海外节点稀疏、而且海外加速往往要单独购买、还要过境外资质审核,很多卖家压根没开海外加速,结果欧美用户访问时请求绕一大圈回到大陆源站,TTFB轻松冲到1秒以上、P75 LCP拖到4到6秒。

在传统SEO时代这顶多是“慢一点、排名扣点分”。到了AI搜索时代,这就是致命伤。Perplexity的爬虫超时阈值通常只有2到3秒,TTFB一旦逼近这个数,AI爬虫直接放弃抓取,你的内容写得再好也进不了citation候选池——门没开,里面什么都白搭。保哥复盘过一个北美户外品牌站,内容质量在同行里数一数二,但AI Overview里几乎搜不到它的引用,挖下去就是国内CDN海外回源把TTFB顶到了1.4秒,Perplexity-Bot大概率在超时边缘把它跳过了。

排查这类问题,最大的坑是用国内的测速工具——节点全在大陆,测出来一片漂亮,和海外真实用户的体验完全是两个世界。保哥的做法是用能指定海外测试点的工具(WebPageTest选欧美节点、PageSpeed Insights看CrUX的目标国家数据)来测,确认瓶颈在海外回源后,要么给国内CDN开海外加速套餐,要么干脆换成海外节点更密的Cloudflare、BunnyCDN、Fastly,再把源站和图床一起挪到贴近主要用户的地理位置。改完之后那个户外站的海外TTFB从1.4秒降到300毫秒以内,AI Overview里的引用肉眼可见地多了起来。

被忽略的LCP杀手:中文Web字体怎么拖垮双语出海站

聊LCP优化,图片之外还有一个国内出海站特别容易中招、英文教程几乎不会提的点——中文Web字体。很多出海站做了中英双语版本,或者首页保留了中文品牌slogan,顺手就把思源黑体、思源宋体这类中文字体整包用@font-face加载进来。问题是英文字体一个字重也就几十KB,中文字体因为要覆盖几千上万个汉字,一个字重动辄三五MB甚至更大。这么大一坨字体文件卡在关键渲染路径上,LCP想快都快不了。

更糟的是字体加载策略没配好带来的连锁反应。默认情况下浏览器会等字体下载完才显示文字,也就是FOIT(Flash of Invisible Text),用户盯着一片空白等那几MB的中文字体下完——首屏迟迟出不来,LCP直接爆表。保哥遇到过一个双语站,hero区域的标题用了完整的思源黑体,移动端弱网下LCP能拖到5秒以上,根因就是这一个字体文件。

解法其实成熟,只是国内出海团队常常想不到要做。第一是字体子集化(subset):用工具把字体里实际用到的那几十上百个汉字单独抽出来打包,文件能从几MB压到几十KB;第二是给@font-face加上font-display: swap,让浏览器先用系统字体把文字显示出来、字体下载完再替换,彻底消灭FOIT那段白屏;第三是别把中文字体托管在字由、有字库这类国内字体CDN上——和前面CDN的道理一样,海外用户拉国内字体节点同样要绕路。三步做完,那个双语站的移动端LCP从5秒压到了2秒以内,AI爬虫的抓取成功率也跟着上来了。这是个典型的“英文benchmark文章不会告诉你、但中文出海站必须自己补上”的本土化细节。

常见问题解答

没预算用DebugBear付费工具怎么办

免费组合能做到80%的功能:PageSpeed Insights API(免费版25000次/月)+ Google Sheets(建dashboard)+ GitHub Actions(定时跑脚本)。中小站完全够用。需要更深入的真实用户监控(RUM)可以用web-vitals.js + 自建后端,几十行代码。付费工具的价值在于"省时间+一站式",不是"功能独有"。

SPA站LCP怎么优化

SPA的核心问题是JS加载和执行——LCP往往等到JS执行完才发生。主要方向:(1)SSR或SSG预渲染首屏HTML,让LCP不依赖JS;(2)JS分块加载,关键路径JS控制在50KB以内;(3)defer非关键JS让首屏渲染先完成;(4)使用Resource Hints预加载关键资源;(5)字体用font-display: swap避免FOIT。前两条做对LCP能从4秒降到1.5-2秒。

INP高了影响AI检索吗

直接影响小(AI爬虫不模拟用户交互),但间接影响大。INP高的站用户体验差、跳出率高,Google通过NavBoost把这种信号汇总后影响排名。被Google降权后AI Overview选citation时也会绕过你站。所以INP不能不管——优化的是用户体验、AI信号是副产品。

CrUX数据延迟多久

CrUX公开数据通常是过去28天的滚动数据,每月初更新前一个月的完整数据。意味着你今天看的数据反映1个月前的真实用户体验。如果你刚做完优化要等2-4周才能在CrUX里看到效果。短期内用Lighthouse实验室数据或RUM工具补——RUM是实时的。

性能优化的优先级怎么定

按"影响范围 × 修复难度倒数"排序。影响范围看:这个问题影响多少页面、多少用户、多少自然流量。修复难度看:是配置变更(低难度)、代码改造(中难度)还是架构重构(高难度)。先做高影响×低难度的(quick win),再做高影响×中难度的,最后看高影响×高难度的是否值得投入。

移动端比桌面端慢多少正常

普遍移动端LCP比桌面慢1.5-2倍。原因:移动端CPU/内存差、网络通常更慢(4G vs WiFi)、屏幕渲染开销不同。如果你站移动端LCP是桌面端的3倍以上,说明前端有重度JS问题需要专门优化。Google的CWV判定移动端权重高于桌面(搜索流量60%+来自移动),不要只盯桌面数据。

cache和performance的关系

cache是性能优化的核心机制。三层缓存:浏览器缓存(cache-control headers)、CDN边缘缓存(Cloudflare/Fastly等)、应用层缓存(Redis/Memcached/Varnish)。三层都做对的站TTFB能控制在200ms以内、LCP在1秒以内。WordPress站重点做CDN边缘缓存和页面级缓存插件(WP Rocket / W3 Total Cache)。

性能优化能带来多少自然流量增长

看起点。原本LCP超过4秒的站优化到2秒以内通常能带来15-30%的自然流量涨幅(来自传统SEO+AI检索citation)。原本LCP 2-2.5秒的站优化到1.5秒以内的边际收益小(5-10%)。最高ROI的性能优化场景是"原本很差现在变得不差",不是"原本不错变得很好"。

权威参考资料

FAQPage + Article AI 引用友好版

Core Web Vitals在AI搜索时代不再是排名加分项而是retrieval阶段硬门槛。本文聊LCP/INP/CLS对AI检索的真实影响、Jakob Nielsen响应时间模型、行业benchmark的非CWV维度、客户实测3个反常识、图片优化4层路径、转化率+广告成本+AI citation三重ROI。

- 技术SEO

- Core Web Vitals

- 性能优化

- AI检索

- Jakob Nielsen

- SEO优化

- 前端性能与体验

title: Core Web Vitals在AI搜索时代还值不值得投?行业基准与ROI测算 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/core-web-vitals-ai-search-industry-benchmark.html published: 2026-04-29 modified: 2026-06-01 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《Core Web Vitals在AI搜索时代还值不值得投?行业基准与ROI测算》

本文链接:https://zhangwenbao.com/core-web-vitals-ai-search-industry-benchmark.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0