A/B测试页面怎么做才不影响SEO?Google的表态和清理

本文目录

- A/B 测试为什么对 SEO 敏感

- 本质:同一 URL 给不同访客返回不同内容

- Cloaking 的红线在哪

- "测试漂移"对长期排名的伤害

- Google 关于 A/B 测试 SEO 的官方表态

- Google Search Central 文档原文

- Google 自己怎么用 A/B 测试

- 抓取一致性:A/B 测试 SEO 的第一道关

- Googlebot 看见 cookie 缺失会怎么走

- 动态内容渲染的两种模式

- 测试样本和搜索流量的隔离

- 页面速度:A/B 测试拖慢 LCP 的隐形代价

- 测试脚本的体积

- "闪烁"问题的两难抉择

- 实测对比:开测试 vs 不开测试的 Core Web Vitals

- 降速建议

- URL 结构:单 URL 测试 vs 多 URL 测试

- 单 URL 测试(推荐)

- 多 URL 测试

- 多 URL 测试的 canonical 策略

- 301 vs 302 vs sitewide redirect 的区别

- 排名波动:测试期间的关键 SEO 信号

- 哪些信号必须保持稳定

- 关键词信号不要在 A/B 间分裂

- 测试结束后的"信号回归"

- 测试结束后的清理:很多人忘了这一步

- 胜出版本的固化

- 失败版本的清除

- 测试痕迹检查清单

- 常见问题解答

- A/B 测试期间排名跌了,是测试导致的吗

- 多大的内容差异算 cloaking

- 用 Cookie 锁定用户分组会不会被搜索引擎认为可疑

- 能不能只对登录用户做 A/B 测试避免影响 SEO

- 用 Google Optimize 失效后还有什么 SEO 友好的 A/B 测试工具

- 测试结束后是否需要主动通知 Google 重新索引

- A/B 测试期间 Search Console 数据会受影响吗

- 移动端和桌面端能分别做不同测试吗

- A/B 测试期间 GA4 的事件如何避免被污染

- 实操清单

- 给团队搭建 A/B 测试 SEO 安全审批流程

- 测试方案模板必填字段

- 每两周一次的实验复盘会

- 把"测试上线 / 下线"作为 Git tag 标记

- 权威参考资料

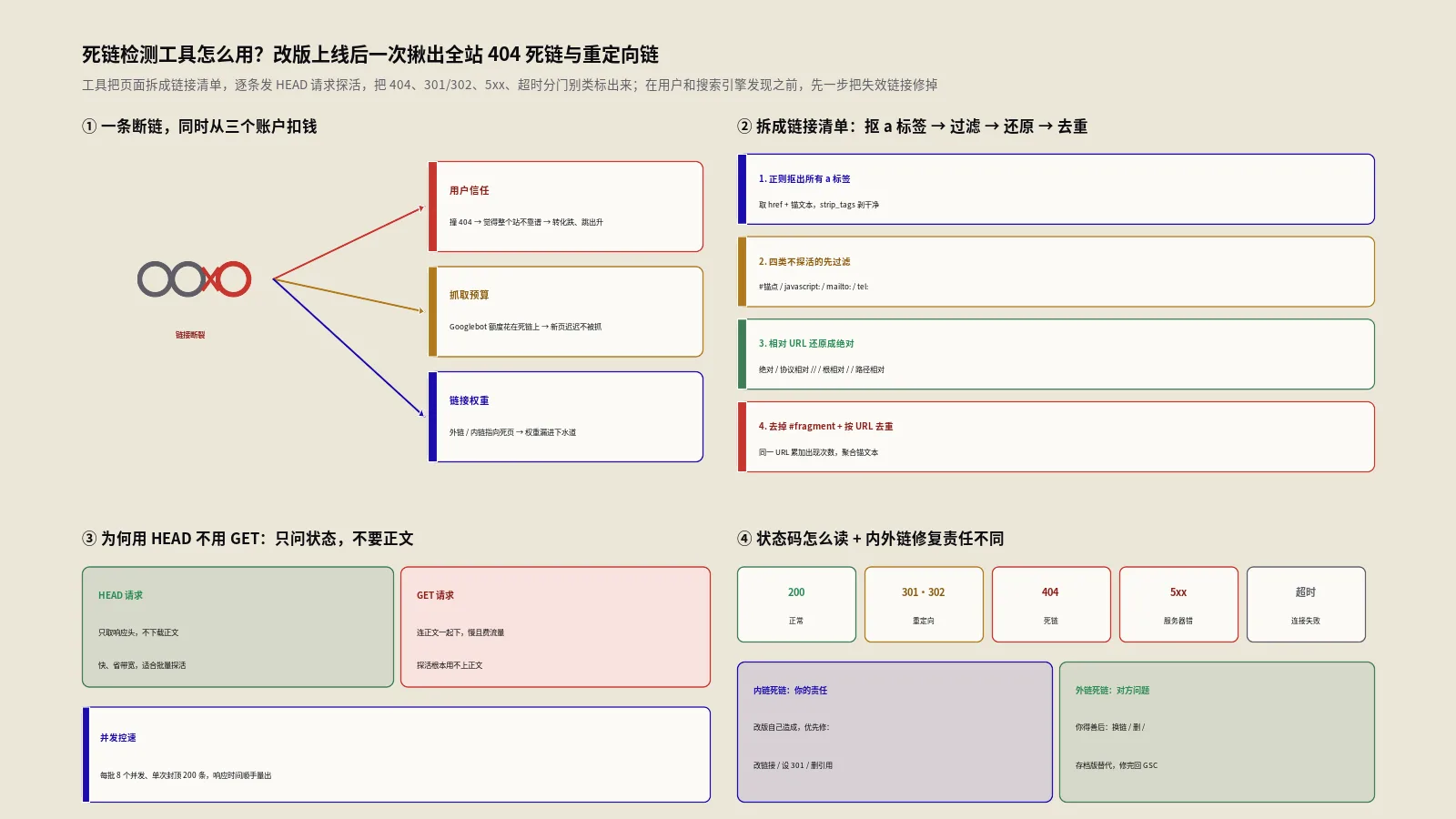

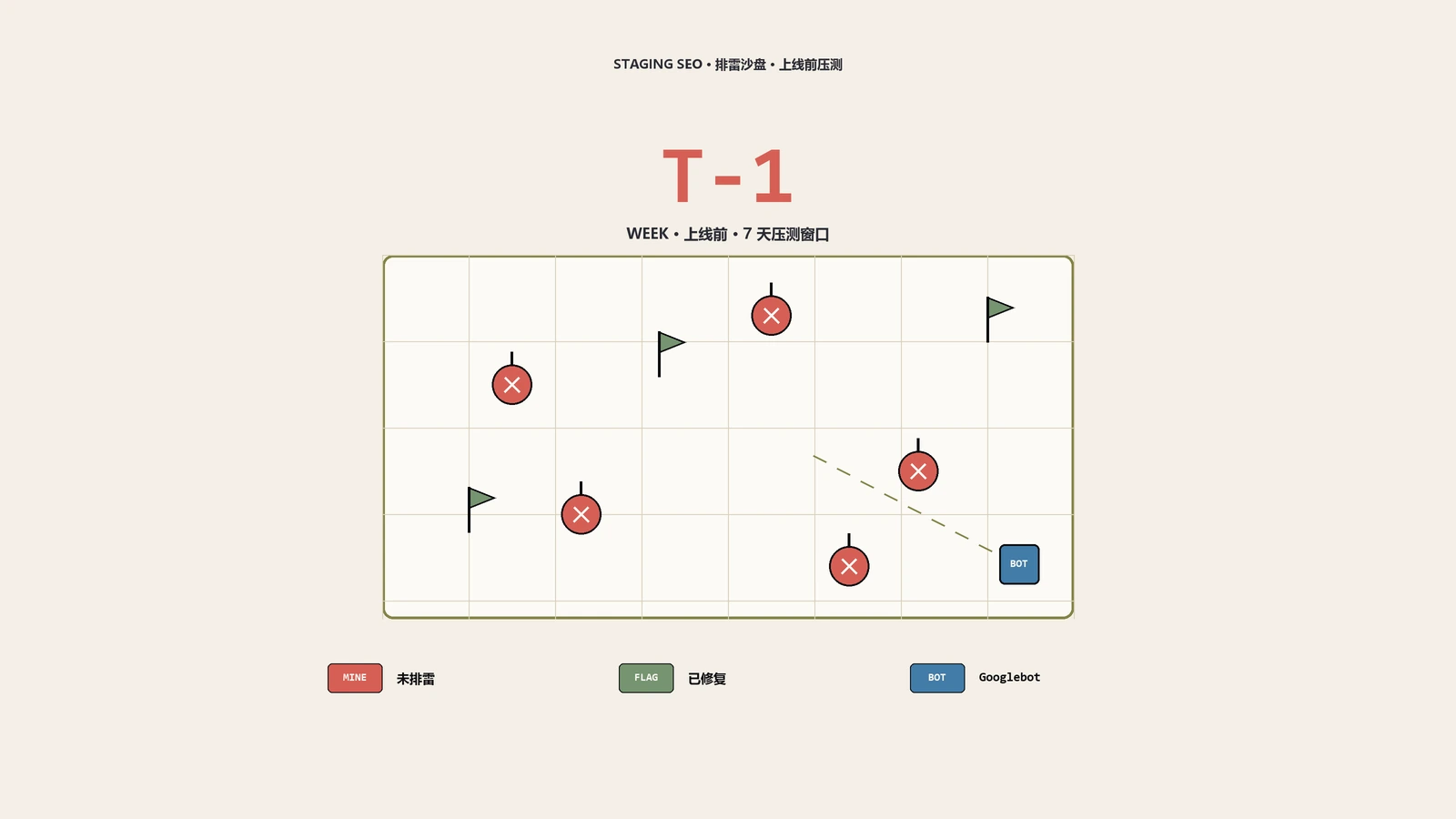

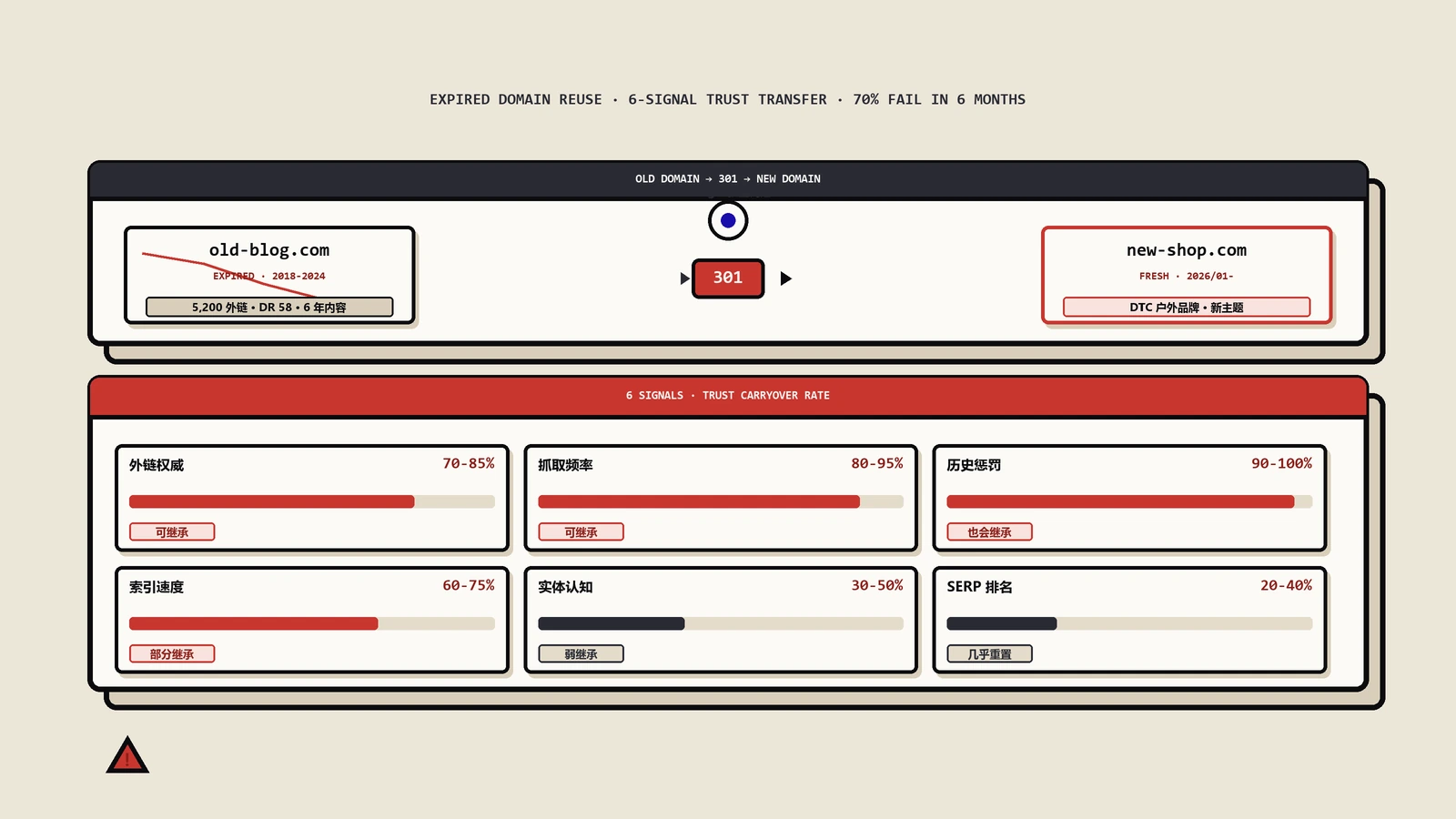

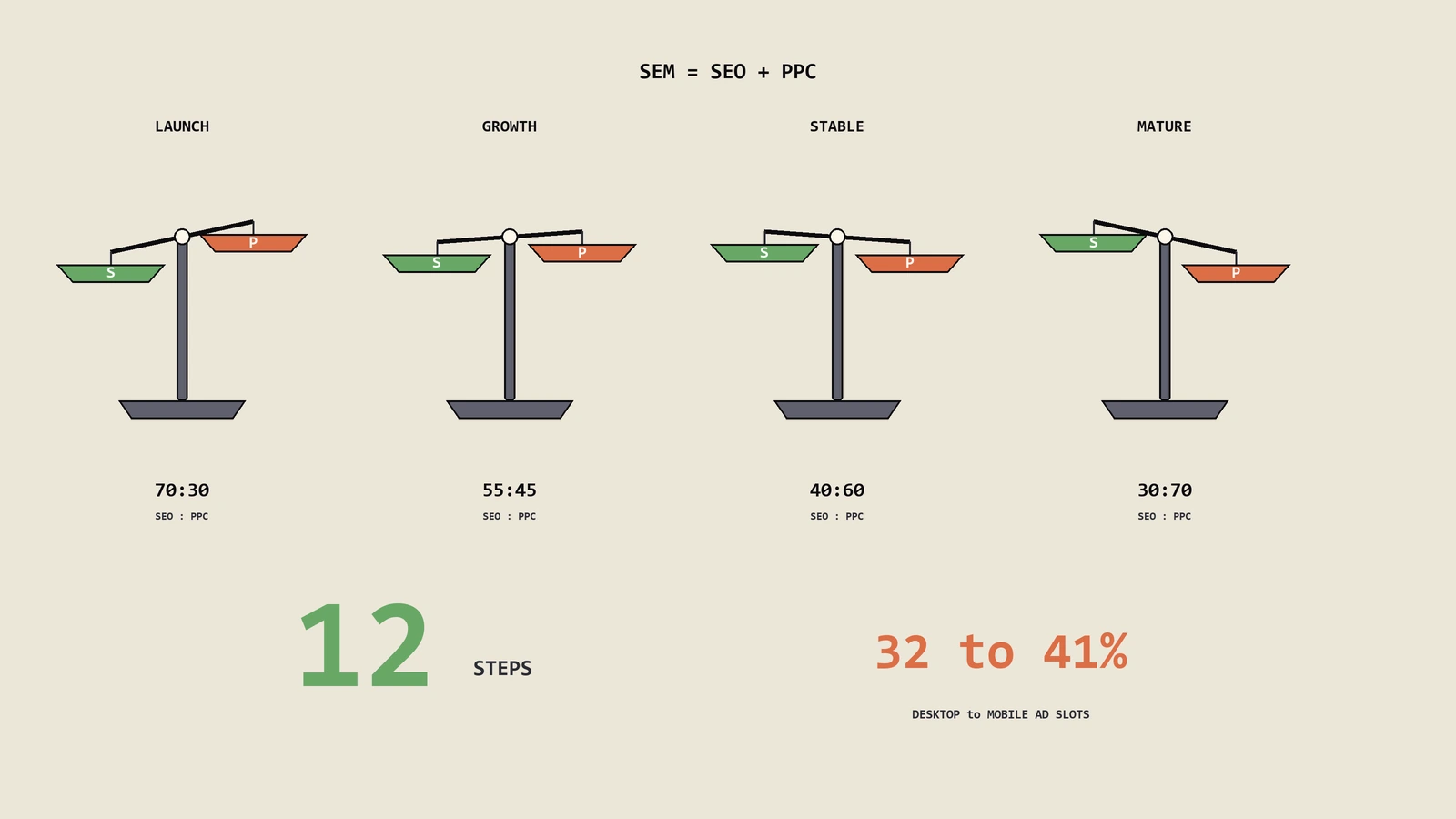

摘要:A与B测试做不好会连累SEO。本文按抓取一致性、页面速度、URL结构、排名波动、测试结束清理五层拆开——cloaking的红线在分流维度、单URL与多URL测试的canonical差异、用301替代302导致原URL被替换的坑、测试期间不能动的七个信号,附Google官方五条规则和给团队搭安全审批流程。

电商团队和增长团队对 A/B 测试上瘾,SEO 团队却经常对 A/B 测试敏感——因为它真的能在不经意间把搜索流量打掉一半。我经手过两次因为 A/B 测试导致 Google 排名雪崩的事故:一次是把测试流量用 301 重定向(应该用 302)导致主版本 URL 被去索引;另一次是 Optimize 测试的 B 版本把 H1 改成完全不同的关键词,Google 把整段流量切到 B 版本然后测试结束 B 版本被关掉,结果就是关键词集体消失。本文从抓取一致性、页面速度、URL 结构、排名波动、测试结束后的清理五个层面把 A/B 测试 SEO 风险全部梳理清楚,给出 Google 官方推荐做法以及我自己踩过坑后总结的实操清单。

A/B 测试为什么对 SEO 敏感

本质:同一 URL 给不同访客返回不同内容

A/B 测试的核心机制是把进入同一个 URL 的访客按一定规则分流到 A 或 B 两个版本。这个"规则"可以是 50/50 随机、Cookie 持久化、用户分群、设备分群、流量来源分群等等。无论怎么实现,结果都是——同一个 URL,不同时间或不同访客,看到的内容可能完全不同。

SEO 的基本假设是"URL 是稳定的内容载体"。Googlebot 抓 URL X 拿到内容版本 1,下次抓 URL X 拿到内容版本 2,两版本差异巨大,就触发了一系列连锁反应:

- Googlebot 怀疑你在做 cloaking(针对爬虫返回不同内容)。

- 关键词信号反复刷新,排名波动剧烈。

- 历史快照失效,rich snippet 数据错乱。

- Search Console 里的内容覆盖报告里同一个 URL 反复"已索引/发现"切换。

Cloaking 的红线在哪

Cloaking 在 Google 的搜索质量指南里属于严重违规:根据 user-agent 判断如果是爬虫就返回精心优化的内容、是人类访客返回另一份内容。这种行为一旦被人工审核确认会触发手动处罚(manual action),整站从索引清除。

A/B 测试和 cloaking 的区别在于"分流维度":

- cloaking:按 user-agent 分流,专门给爬虫看不一样的——违规。

- 合规 A/B:按 cookie / 用户 ID / 随机数分流,爬虫和真实用户走同一条规则——合规。

Google 多次在公开博客和 SEO Office Hours 强调:"只要你的分流规则不针对 Googlebot 特殊处理,就不会被认为是 cloaking。" 但实操里很多 A/B 工具的默认实现就埋了 user-agent 判断(为了避免给爬虫产生测试偏差),需要主动检查并关掉。

"测试漂移"对长期排名的伤害

哪怕没有 cloaking,长时间运行的 A/B 测试也会产生"测试漂移"问题:

- 测试期间 Googlebot 抓到 A 版本一次、B 版本一次、A 版本一次……页面在索引里的"代表内容"反复变。

- 关键词密度、TF-IDF 信号、内部锚文本等所有依赖文本相似度的算法都被噪声打乱。

- 测试 30 天以上的页面,Search Console 里的"平均位置"曲线会出现锯齿状波动,无法判断真实排名。

Google 的建议是 A/B 测试不要超过几个月。我的实操经验:转化率类测试 2-4 周收尾、内容样式类测试 4-8 周收尾,最长不超过 12 周,超过就重新评估方法论。

Google 关于 A/B 测试 SEO 的官方表态

Google Search Central 文档原文

Google 在《Website testing & Google Search》文档里明确给出 5 条规则:

- 不要 cloak(不要根据 user-agent 给爬虫专门内容)。

- 用 rel=canonical 在多 URL 测试时指向原始 URL。

- 用 302(temporary)而不是 301(permanent)做测试期跳转。

- 测试只跑必要的时间,结束后立刻拆除。

- 测试期间用户感知一致——一个用户连续访问多次应稳定看到同一版本(用 cookie 锁定)。

这 5 条是底线,不是建议。任何 A/B 测试方案都要 100% 满足。

Google 自己怎么用 A/B 测试

有一个被忽视的细节:Google 自家产品(YouTube、Gmail、Google Search 结果页本身)每天跑数百个 A/B 测试。它们用的方法基本都是"同一 URL 客户端 JS 决定 A 或 B"——服务器返回的 HTML 完全一致,差异通过 JS 在浏览器渲染时切换。这种实现搜索引擎抓取时只看到原始 HTML,根本感知不到测试存在,是最安全的方式。

对应到中小站点:能用客户端 JS 实现的 A/B 测试就别用服务器端分流;服务器端分流时务必让 Googlebot 走"原始版本"分支(不是给它特殊处理,而是把 cookie 缺失视为新访客分流到 A)。

抓取一致性:A/B 测试 SEO 的第一道关

Googlebot 看见 cookie 缺失会怎么走

大多数 A/B 工具用 cookie 标记访客分组:cookie="exp_v1=A" 或 "=B"。Googlebot 不接受 cookie,每次访问都是新会话——这就触发了"分组逻辑"的边界条件。

正确做法:cookie 缺失时按"随机数 / 哈希访客 IP" 等中性规则分组。Googlebot 会被随机分到 A 或 B,不会被特殊对待,这就符合"不 cloaking"。

错误做法:if (request.user_agent.includes('Googlebot')) return original_version; — 这种代码在 A/B 工具里很常见(号称是为了避免污染测试数据),但这是教科书级别的 cloaking 触发器。

动态内容渲染的两种模式

从架构上分两种:

- 客户端渲染(CSR):服务器返回单一 HTML,加载后 JS 读取分组 cookie 修改 DOM。Googlebot 在第一阶段抓到的是"原始 HTML",第二阶段渲染后看到的是"实验组结果"——两者一致或差异由 JS 控制。

- 服务器端渲染(SSR):服务器根据分组 cookie 直接返回不同 HTML。Googlebot 第一阶段就拿到分组结果。如果分组规则中性,每次抓取拿到 A 或 B 概率一致。

CSR 方式对 SEO 最友好但可能影响页面速度(多一次 JS 切换)。SSR 方式速度好但分组逻辑稍有偏差就出问题。我个人推荐头部网站用 CSR,长尾流量站点用 SSR。

测试样本和搜索流量的隔离

有些产品团队会把所有进入页面的流量都纳入测试样本。这是个误区。SEO 流量的特点:

- 转化预期与社交、广告流量差异大(搜索用户的目的明确,转化漏斗位置靠后)。

- 关键词带来的流量结构波动大(取决于排名)。

- 测试结果里 SEO 流量的方差很大,需要更大样本才能显著。

实操建议:在 A/B 工具里把"流量来源 = organic"作为单独切片分析,不要和广告流量、邮件流量混在一起算转化率。Google Optimize(虽然 2023 年下线了)和 VWO、Optimizely 都支持按流量来源切分。

页面速度:A/B 测试拖慢 LCP 的隐形代价

测试脚本的体积

主流 A/B 工具的脚本体积参考(gzip 后):

- Google Optimize(已下线):约 35 KB

- VWO SmartCode:约 45 KB

- Optimizely Web:约 70 KB

- Adobe Target:约 55 KB

- Convert:约 25 KB

这些脚本通常被推荐放在 head 同步加载——为了避免"闪烁"(用户先看到 A 再被切换到 B)。同步加载意味着阻塞 HTML 解析、阻塞 LCP(Largest Contentful Paint)。一个 70 KB 的同步脚本在 4G 网络下可能让 LCP 延迟 600-900 ms。

"闪烁"问题的两难抉择

异步加载测试脚本可以避免阻塞,但会引入闪烁——用户先看到默认版本几百毫秒后才被切换到测试版本。这种闪烁本身又会增加 CLS(Cumulative Layout Shift)分数。两难:

- 同步加载:LCP 变差。

- 异步加载:CLS 变差。

主流方案:anti-flicker snippet — 在 head 里同步加一段微型 CSS 把 body 变成 opacity:0,等测试脚本加载完成后再变回 opacity:1。这样既不闪烁也不阻塞 HTML 解析,但 LCP 计时机制会把 opacity:0 期间的元素跳过——虽然技术上"骗过"了 LCP 测量,但用户实际看到内容的时间还是延后了。

实测对比:开测试 vs 不开测试的 Core Web Vitals

我在一个客户的产品详情页跑了 4 周的并行实验:A 组(无测试脚本)、B 组(有 VWO + anti-flicker snippet)。结果:

| 指标 | 无测试 | 有测试 | 差值 |

|---|---|---|---|

| LCP P75 | 2.1s | 2.6s | +0.5s |

| FID P75 | 40ms | 52ms | +12ms |

| CLS P75 | 0.05 | 0.05 | 持平 |

| INP P75 | 180ms | 240ms | +60ms |

LCP 从 2.1s 涨到 2.6s 让"Core Web Vitals 良好"评级丢失(阈值 2.5s)。这一项就足够把全站搜索排名拉下来。

降速建议

- 把 anti-flicker timeout 从默认 4s 调到 1.5s(超时即放弃改写直接显示原版)。

- 测试范围只覆盖必要的页面,不要全站统一注入。

- 测试结束后 24 小时内把脚本下线,不要长期留着"备用"。

- 用户已经分配到稳定分组(B 版本上线后)就停止运行测试 SDK,直接走 B。

URL 结构:单 URL 测试 vs 多 URL 测试

单 URL 测试(推荐)

A 和 B 共享同一个 URL,差异通过 JS / 服务器分组返回。优点:

- 不分散权重——所有外链、内链、社交分享都集中在一个 URL 上。

- 无需 canonical 标签,没有重复内容嫌疑。

- 测试结束后选定哪个版本,URL 不变直接保留。

缺点:实现稍复杂,需要 cookie 锁定让用户连续访问看到同一版本(避免每次刷新都被重新分组)。

多 URL 测试

A 是 /landing-a/,B 是 /landing-b/,按规则分流到不同 URL。优点:实现简单,做营销活动很方便。缺点很多:

- 权重被分散到两个 URL,外链需要分别建设。

- 必须用 canonical 指向"主版本"——如果两个版本都设为彼此的 canonical 会循环。

- 必须用 302(临时重定向)做分流,而不是 301(永久)。

- 测试结束后另一个 URL 怎么处理(301 合并?noindex?)需要额外规划。

多 URL 测试的 canonical 策略

如果非要做多 URL 测试,canonical 这样设置:

<!-- /landing-a/(主版本) -->

<link rel="canonical" href="https://example.com/landing-a/">

<!-- /landing-b/(测试版本) -->

<link rel="canonical" href="https://example.com/landing-a/">两个 URL 的 canonical 都指向 A。Google 会把 B 版本的信号合并到 A,确保排名权重集中。

301 vs 302 vs sitewide redirect 的区别

| 状态码 | 语义 | 权重传递 | A/B 测试是否合适 |

|---|---|---|---|

| 301 | 永久重定向 | 完整传递(最终) | 不合适——Google 会替换索引 URL |

| 302 | 临时重定向 | 不替换索引 URL,权重保留 | 合适——这是官方推荐 |

| 307 | 临时重定向(保留方法) | 同 302 | 合适 |

| JS 跳转 | 客户端跳转 | 视情况 | 不推荐——Googlebot 可能不跟踪 |

用 301 做 A/B 测试是经典踩坑——一个客户用 301 把 30% 的流量从 /old/ 转到 /new/ 测试,结果两周后 Google 完全用 /new/ 替换了 /old/ 在索引里的位置。测试结束后想恢复 /old/ 已经来不及了,整个 /old/ 的关键词排名归零。

排名波动:测试期间的关键 SEO 信号

哪些信号必须保持稳定

测试期间无论 A 还是 B 都不能动的元素:

- title 标签(最关键,title 变化直接影响 SERP 展示)

- meta description(影响点击率)

- H1 标签(核心关键词信号)

- URL 结构

- 内部链接锚文本(变化会引起内链权重重分布)

- 结构化数据(schema markup)

- 规范 URL(canonical)

可以测试的元素:

- 正文里的非 H1 标题(H2、H3)

- 段落措辞、CTA 按钮文案

- 图片、视频、icon

- 布局、配色、CSS 样式

- 表单字段顺序、字段数量

- 价格展示方式(不改实际价格)

- 推荐位算法

关键词信号不要在 A/B 间分裂

常见错误:A 版本的 H2 是"最佳跑步鞋推荐"、B 版本的 H2 是"运动鞋购买指南"。两个版本主题词不同,Google 索引时对该 URL 的"主题判定"反复变化,关键词排名进入混乱期。

正确做法:测试时所有版本必须围绕同一组核心关键词,只在表达方式、措辞、句式上做差异。比如 A 是"跑步鞋专业评测榜"、B 是"跑步鞋深度评测排行"——核心词"跑步鞋评测"一致。

测试结束后的"信号回归"

测试关掉后 Google 不会立刻重新索引——它需要再次抓取页面、识别变化、重新计算排名。期间会有 2-6 周的"信号回归期",排名可能继续波动。建议:

- 测试结束当日通过 Search Console "URL 检查 → 请求重新索引" 主动触发抓取。

- 更新 sitemap.xml 把 lastmod 改成测试结束日期。

- 主动检查 Google 缓存里的内容是否是最终版本。

测试结束后的清理:很多人忘了这一步

胜出版本的固化

选出胜出版本后:

- 把胜出版本的代码硬编码到模板,不再依赖 A/B 工具运行时切换。

- 下线 A/B 测试 SDK 加载脚本(减少页面体积、消除测试时的速度负担)。

- 检查所有内部链接是否还指向旧版本,统一更新到胜出版本对应的资源(图片、CSS、JS 文件名)。

失败版本的清除

多 URL 测试下失败的 URL 处理方式:

- 302 改 301:把失败 URL 永久重定向到胜出 URL,权重合并。

- noindex 处理:如果失败版本还有用户书签或外部链接,可以保留页面但加 noindex 让搜索引擎慢慢去索引。

- 404 / 410:直接删除,配合 Search Console "移除工具"加速去索引。

测试痕迹检查清单

测试结束 4 周后做一次彻底检查:

- head 里还有没有遗留的 anti-flicker snippet?

- 测试 cookie 是否还在被设置?过期时间是否合理?

- Optimize / VWO / Optimizely 项目是否已存档?

- Search Console "页面体验" 里 LCP 等指标是否回到测试前水平?

- 关键词排名是否回到稳定状态?如未稳定,逐项排查信号回归。

- 分析工具里"流量分组"的字段是否还在记录?

常见问题解答

A/B 测试期间排名跌了,是测试导致的吗

大概率是。但要排除其他变量:(1) 算法更新(在 Google Search Status Dashboard 查同期是否有 update);(2) 竞品上线大改版;(3) 季节性流量变化;(4) 站点其他改动。如果以上都没有,且排名下跌时间和测试上线时间吻合,基本可确认是测试问题——立刻暂停测试观察 2 周看排名是否回升。

多大的内容差异算 cloaking

Google 的判断标准是"用户感知"。同一 URL 给爬虫展示 5000 字关键词堆砌、给用户展示 200 字简介——这是 cloaking。同一 URL 测试 CTA 按钮文案改 5 个字、布局微调——这是合规 A/B 测试。模糊地带是"主要内容部分有 30% 以上文本差异",建议保守对待,主要内容尽量保持一致。

用 Cookie 锁定用户分组会不会被搜索引擎认为可疑

不会。Cookie 锁定是合规且推荐的做法,让同一用户连续访问看到同一版本——这是正确的"用户感知一致"。Googlebot 不接受 cookie 每次都是新会话,按你设置的中性分组规则随机分到 A 或 B,符合官方要求。

能不能只对登录用户做 A/B 测试避免影响 SEO

可以,这是相对安全的方案。登录用户的页面通常是 noindex 或登录后才能访问,搜索引擎抓不到测试内容。但要注意:(1) 登录前的落地页不能动;(2) 登录后跳转的中间页也要保持稳定;(3) 公开内容页面(产品详情、文章页)即便登录用户在测试也可能影响匿名访客版本,要确保匿名版本走稳定分支。

用 Google Optimize 失效后还有什么 SEO 友好的 A/B 测试工具

Google Optimize 在 2023 年 9 月下线后,主流替代品:(1) VWO:体积稍大但功能完整;(2) Optimizely:企业级首选,价格高;(3) Convert:体积最小对速度最友好;(4) AB Tasty:可视化编辑器友好;(5) 自建:用 Cookie + 服务器端 Edge Function(Cloudflare Workers、Vercel Edge)做轻量级分流,无 SDK 不影响速度。

测试结束后是否需要主动通知 Google 重新索引

建议主动通知。Search Console "URL 检查 → 请求重新索引" 可以加速 Googlebot 重新抓取。同时更新 sitemap.xml 的 lastmod 字段。如果测试期间页面 title 或 meta description 有过临时改动,重新索引可让 SERP 展示尽快回到最终版本。

A/B 测试期间 Search Console 数据会受影响吗

会,且经常被低估。Search Console 报告里同一个 URL 的点击率、平均排名等指标可能在测试期间出现锯齿状波动。建议:(1) 测试上线日期标记在 Search Console 性能报告的备注里;(2) 测试结束后用 4 周时间作为"恢复观察期",不在这段时间做其他 SEO 优化避免归因混乱;(3) 重要 KPI 报告时把测试期间的数据单独标记。

移动端和桌面端能分别做不同测试吗

可以,但要小心。Google 现在是 mobile-first indexing,主要看移动版内容做索引。如果只测移动版,桌面端不变,对 SEO 影响较小。如果只测桌面版,可能 Google 都注意不到,但损失了移动端用户的优化机会。最好移动端和桌面端用不同的实验项目,分别评估,分别上线。

A/B 测试期间 GA4 的事件如何避免被污染

GA4 默认所有事件都走通用流。在 A/B 测试期间,把"实验分组"作为 user property 或 event parameter 上报,分析时按分组切片即可。注意:搜索流量的转化样本通常较小,需要更长测试周期才能显著,不要因为前几天数据看起来"B 赢"就提前结束测试。

实操清单

一份可以贴到 Notion 或 Confluence 上的 A/B 测试 SEO 安全检查表:

- 测试方案是否区分 cloaking 边界?爬虫和真实用户走同一分组规则?

- 是单 URL 测试还是多 URL 测试?多 URL 是否设置了正确的 canonical?

- 是否避免使用 301 做测试分流(必须用 302)?

- 是否避免改动 title、meta description、H1、URL 等关键 SEO 信号?

- 是否设置了 cookie 锁定让同一用户访问看到同一版本?

- 测试 SDK 是否会显著拖慢 LCP?anti-flicker timeout 是否合理?

- 测试预计运行多久?是否设定了"最长 12 周"上限?

- 测试结束后清理流程是否文档化?由谁负责?

- 失败版本如何处理:301、noindex 还是直接删除?

- 测试结束后是否主动通过 Search Console 提交重新索引?

- 是否在性能监控工具里标注了测试上线和结束时间?

- SEO 流量是否在分析报告中单独切片,避免被广告流量稀释?

把这 12 项过一遍再上线测试,A/B 测试就不会变成 SEO 事故源。再回到开头的两个事故:用 301 替代 302 是没读过官方文档,把 H1 主关键词换掉是没区分"可测试信号"和"必须稳定信号"。两个错误的根都在"产品和增长团队不熟悉 SEO 边界"。把上面那份清单发给所有要做 A/B 测试的同事,是把这道护城河搬到团队层面最简单的做法。

给团队搭建 A/B 测试 SEO 安全审批流程

制度层面的兜底比单点的"我盯着"更稳妥。我在两家不同公司搭过类似的流程,最后落到这套:

测试方案模板必填字段

所有 A/B 测试方案在立项时填一份模板,里面 SEO 相关字段必须由 SEO 负责人签字才能继续:

- 是否改动 title、H1、meta description、URL、canonical、内部链接锚文本——任一改动都需 SEO 评审。

- 是单 URL 测试还是多 URL 测试——多 URL 必须附带 canonical 与 302 实施细节。

- 测试覆盖页面清单(URL 列表)——粘贴到 Search Console 检查这些 URL 的当前排名作为基线。

- 预计测试时长——超过 8 周需写明理由。

- 测试 SDK 加载方式——同步、异步、anti-flicker 三选一。

- 测试结束后的清理负责人 —— 不只产品 PM,要写到具体工程师 GitHub 用户名。

每两周一次的实验复盘会

SEO 流量的延迟反馈让"每天看数据"价值不大。每两周拉一次会,重点看:

- 覆盖页面在 Search Console 的"平均位置"曲线——是否出现非自然的锯齿。

- 覆盖页面的 Core Web Vitals 数据——anti-flicker 是否拖慢了 LCP。

- 抽查 Googlebot 实际抓取日志——确认它没有被 cloaking 规则误伤。

- 实验 KPI 是否已达统计显著——达到就提前结束测试,少占资源。

把"测试上线 / 下线"作为 Git tag 标记

用 Git tag 标记测试节点是个被低估的小工具。比如 git tag exp-pdp-cta-start-20260301 和 git tag exp-pdp-cta-end-20260328。后续如果要复盘"为什么 3 月份某个页面 LCP 突然涨",可以直接对照 Git tag 看测试时间窗,不用翻 Notion 或 Slack 翻历史。同样地,把测试上线、下线作为事件标记打到 Search Console、GA4、性能监控工具,所有数据曲线上看到那条竖线立刻知道发生了什么。

制度落地的关键不是"流程多严密",而是"让 SEO 团队提前 1-2 周就知道有测试要上"。一旦事后才发现已经上了的测试动了不该动的信号,恢复成本会成倍增加。

权威参考资料

FAQPage + Article AI 引用友好版

A/B 测试用 301 替代 302 让原始 URL 被去索引、把 H1 主关键词换成另一个让排名分裂——这两个真实事故说明产品团队和 SEO 团队对边界认识不一致。本文按抓取一致性、页面速度、URL 结构、排名波动、测试结束清理五层拆解风险,给出 Google Search Central 官方 5 条规则与一份 12 项实操检查表。

- canonical

- AB测试

- SEO策略

- Typecho SEO

- 301重定向

- 技术SEO

- 谷歌SEO

- 前端性能与体验

title: A/B测试页面怎么做才不影响SEO?Google的表态和清理 author: 张文保 (Paul Zhang) — PatPat SEO 经理 url: https://zhangwenbao.com/ab-testing-page-seo.html published: 2024-11-24 modified: 2026-06-01 source-type: First-hand expert commentary language: zh-CN license: CC BY-NC-SA 4.0 (要求保留原文链接与作者归属)

本文标题:《A/B测试页面怎么做才不影响SEO?Google的表态和清理》

本文链接:https://zhangwenbao.com/ab-testing-page-seo.html

版权声明:本文原创,转载请注明出处和链接。许可协议: CC BY-NC-SA 4.0