电商导航SEO怎么做?筛选器URL不爆炸的系统方案8步

本文目录

- 分面导航为什么会让 URL 组合爆炸?

- 组合爆炸到底会造成哪三类危害?

- 第一类:抓取预算被烧光

- 第二类:索引被近重复薄页稀释

- 第三类:站内权重流进黑洞空转

- 有用内容时代,薄筛选页的代价比以前更大

- 怎么判断自己的站已经踩进这个坑?

- 一个真实的日志反推实例

- robots、noindex、canonical 到底该用哪个?

- robots.txt Disallow:挡抓取,但挡不住索引,还会致盲

- meta noindex:挡索引,但仍然耗抓取预算

- canonical:软建议,只适合真的近重复

- 从源头不让爬虫造出这些 URL:治本的那一招

- rel=nofollow 和那个已经消失的参数工具,别再指望它们

- 那到底哪些筛选页该留着被索引?

- URL 该用参数还是路径,前端筛选怎么配合?

- SSR、CSR、PRG,前端架构怎么选才不挖坑

- 一次能落地的分面治理审计该怎么做?

- 常见问题解答

- 分面导航和分页是一回事吗?

- 直接用 robots.txt 把所有带参数 URL 屏蔽掉行不行?

- 给筛选组合页加 canonical 回分类页一定有效吗?

- noindex 能解决抓取预算被烧光的问题吗?

- 哪些筛选页应该保留并让它被收录?

- 参数式 URL 和路径式 URL 哪个更好?

- 做一次分面治理,第一步该干什么?

- 权威参考资料

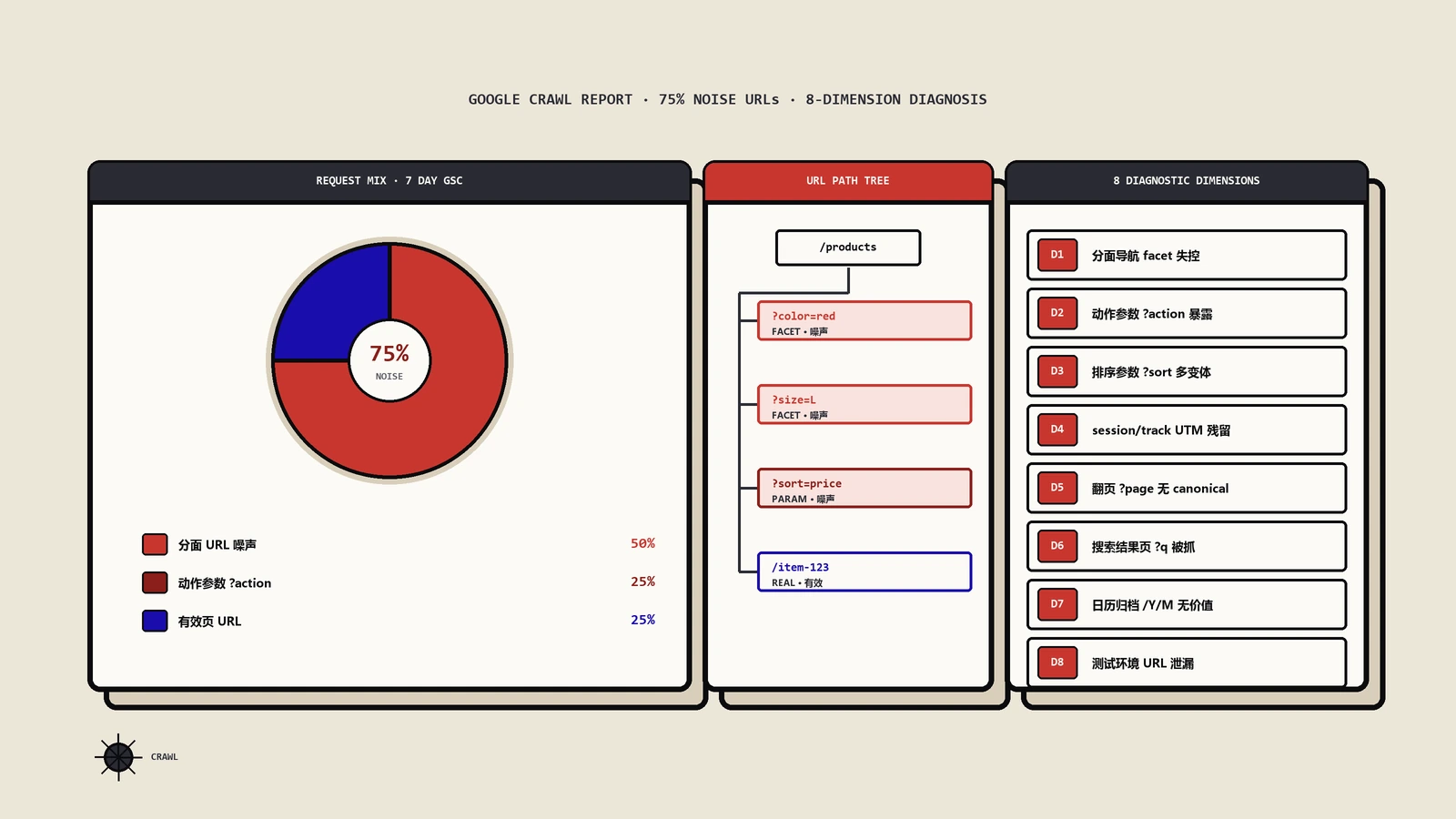

摘要:几百个商品凭什么被爬出几百万个URL?分面导航的筛选项一旦能自由叠加,搜索引擎眼里就是无穷无尽的近重复页,抓取预算被烧干、真正的品类页几周都轮不到一次。绝大多数人第一反应是直接封掉它,可那恰恰是掉量最快的做法——挡住了抓取,反而让引擎再也读不到你的处置信号。真正的解法是按维度判断哪些组合真有人搜、按场景挑不同手段,而不是一把梭。

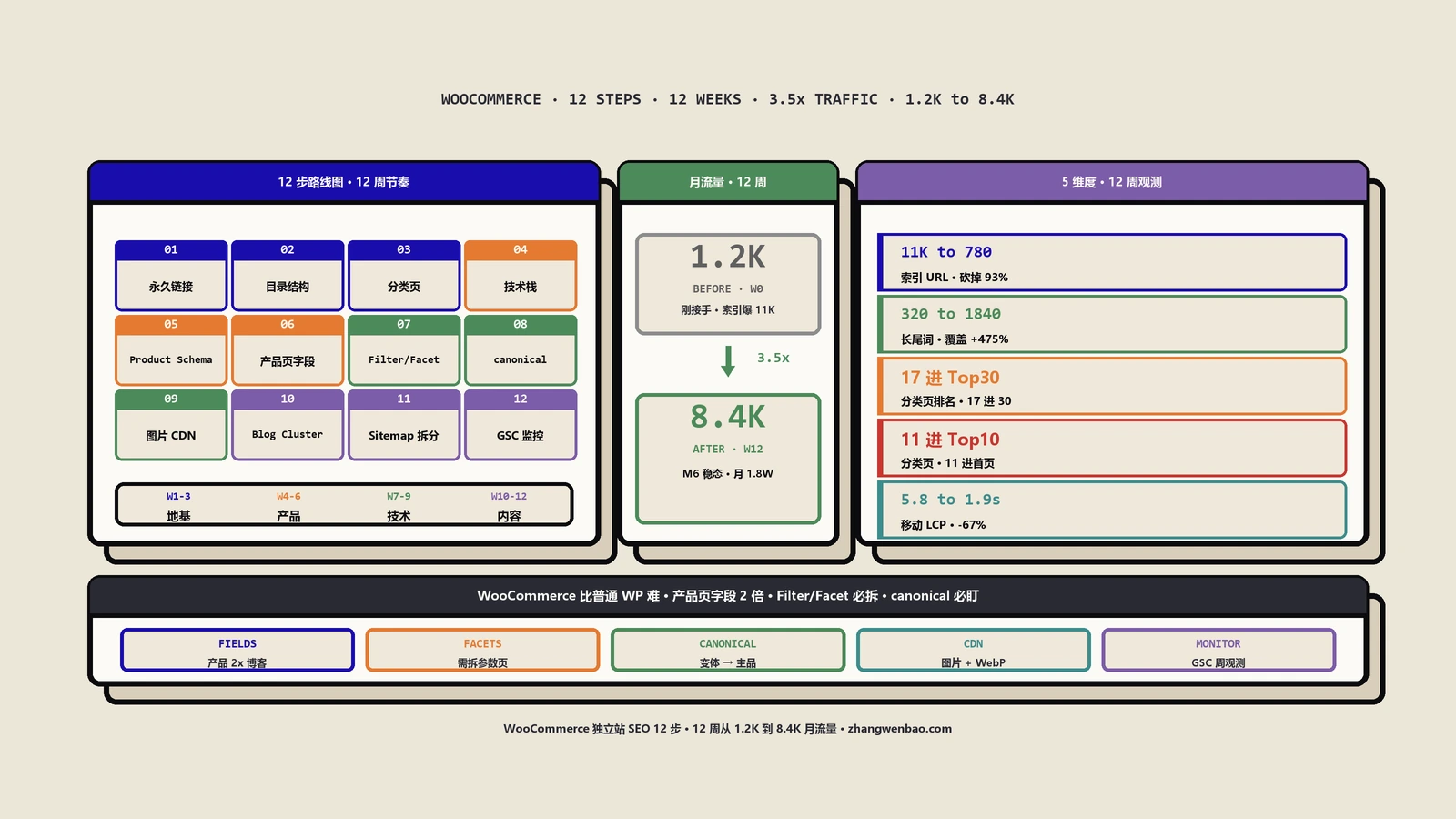

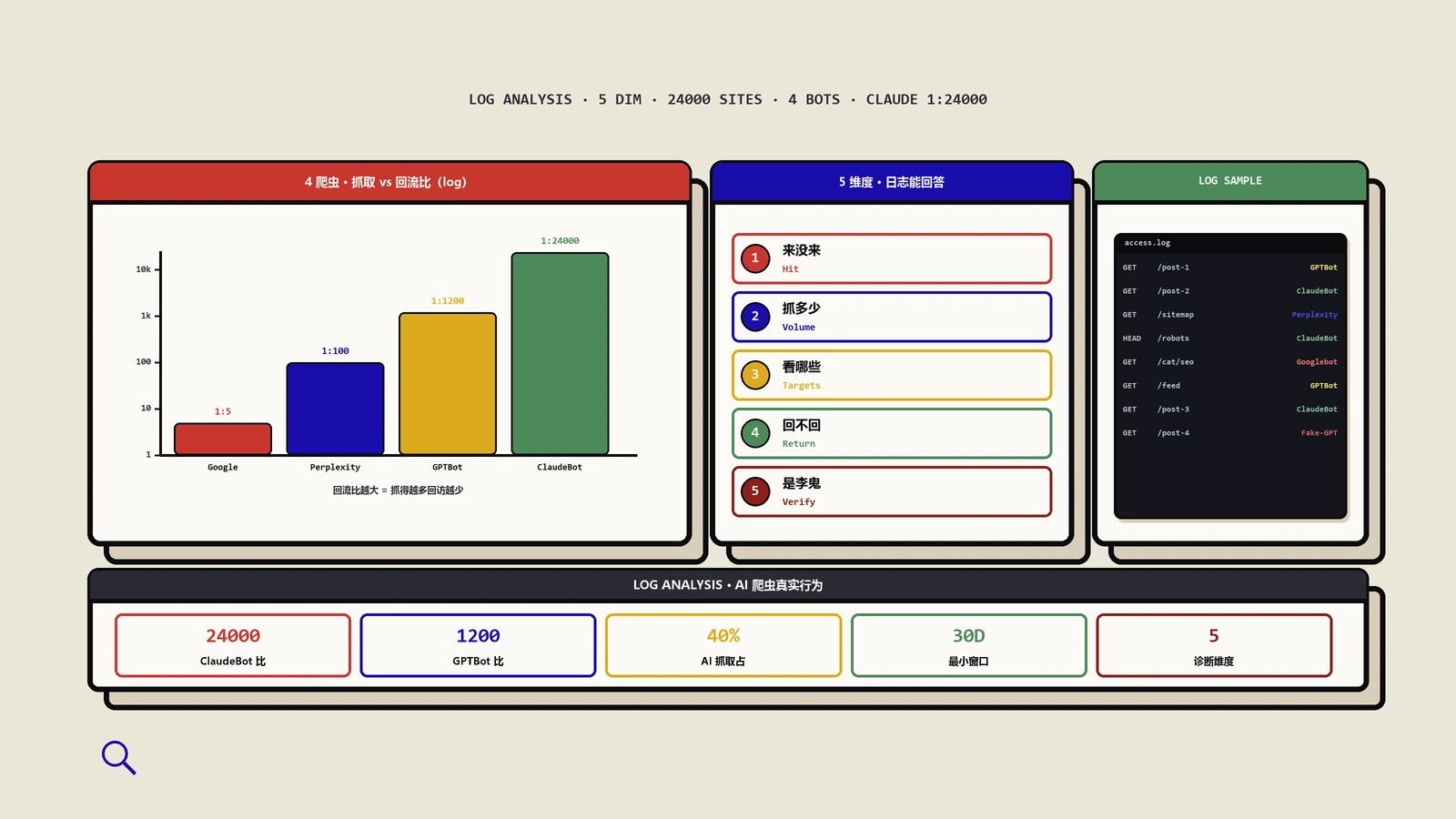

接手过一个北美家居电商,三千多个 SKU,老板的困惑很典型:内容不差、外链也做了,可新品类页面就是迟迟不被收录,老页面排名还在慢慢往下掉。我让技术拉了三个月的服务器日志,结论让会议室安静了——Googlebot 八成以上的抓取量,全花在了带 ?color= 、?size= 、?sort= 各种参数排列组合的 URL 上,那些页面内容彼此几乎一样,没有任何一个值得排名,而真正重要的新品类页,爬虫几周才轮得到光顾一次。这个站的问题从来不是内容,是它在用三千个商品,给搜索引擎喂几十万个长得几乎一模一样的垃圾 URL,把抓取预算活活烧干。这就是分面导航没治理好的标准死法。保哥这些年在电商站上见过太多遍,几乎每一个上了规模又没人管 URL 的站,都踩在这个坑里,只是大多数人根本没往这儿想。

分面导航为什么会让 URL 组合爆炸?

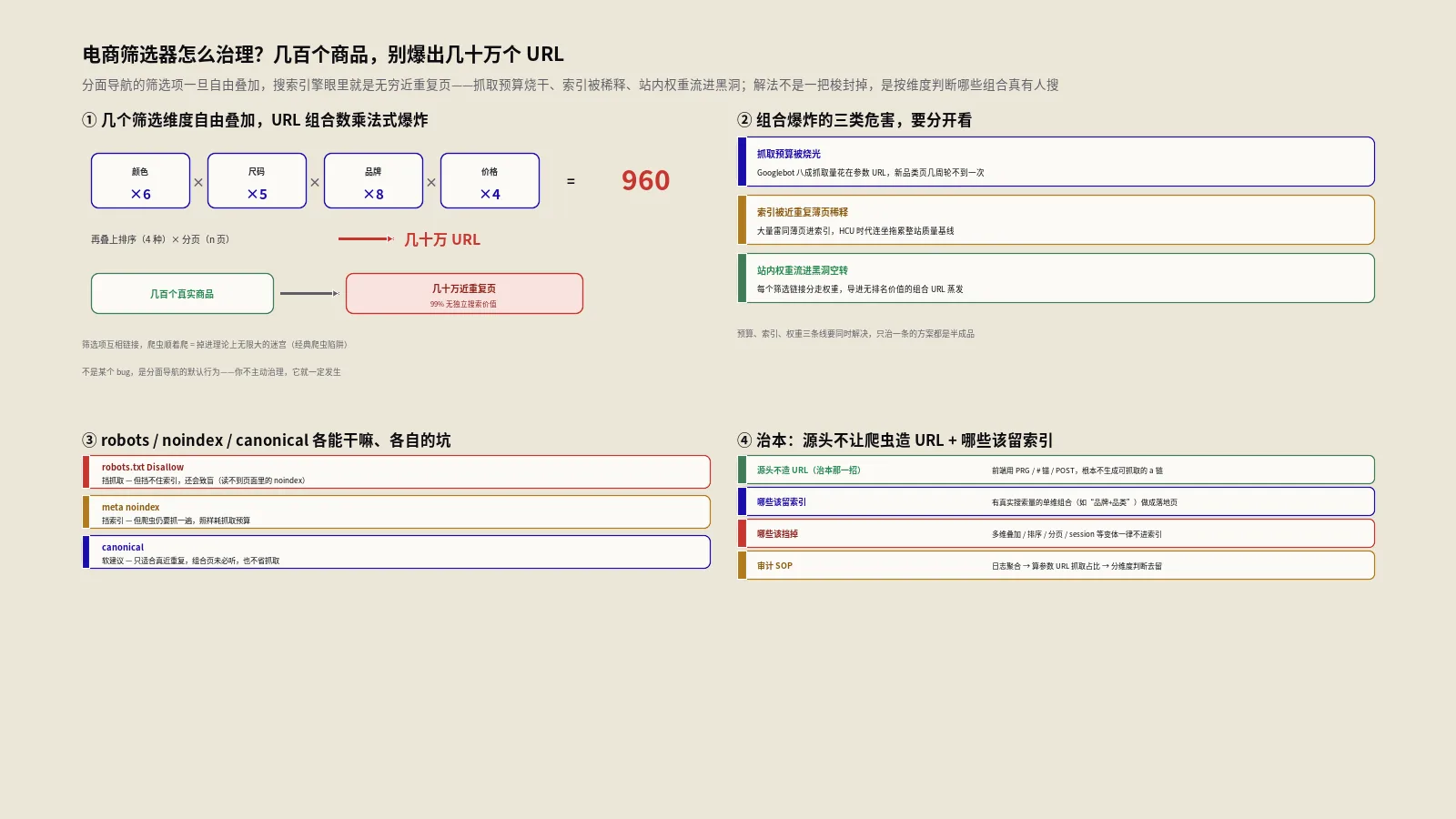

先把机制讲清楚,否则后面所有处置都是蒙的。分面导航就是用户在分类页上能勾选的那些筛选维度:颜色、尺码、品牌、价格区间、材质、风格。问题不在筛选本身,在这些维度能自由组合,而每一种组合往往生成一个独立可访问的 URL。

算一笔账就触目惊心。假设一个连衣裙分类下有 6 种颜色、5 个尺码、8 个品牌、4 个价格区间,单看每个维度不多。可一旦允许任意叠加,组合数是 6×5×8×4,单这四个维度就 960 种;再叠上排序方式(价格升序、降序、销量、上新)和分页,轻松上万。这还只是一个分类。一个有几十个分类的站,几百个真实商品,能在爬虫眼里变成几十万甚至上百万个 URL,而其中 99% 是没有任何独立搜索价值的近重复页。更糟的是这些 URL 还会互相链接——筛选一个条件后页面上其他筛选项还在,每个都是一条新链接,爬虫顺着爬下去,等于掉进一个理论上无限大的迷宫。这就是经典的爬虫陷阱:不是某个 bug,是分面导航的默认行为,你不主动治理,它就一定会发生。搜索引擎到底怎么发现和抓取页面,我在搜索引擎抓取索引排名三步全拆解里讲过那套发现机制,分面导航的危险恰恰在于它把那套靠链接发现的机制,反过来变成了喂爬虫吃垃圾的管道。

组合爆炸到底会造成哪三类危害?

很多人知道 URL 多不好,但说不清到底坏在哪,导致处置时抓不住重点。危害是三条独立的线,要分开看。

第一类:抓取预算被烧光

搜索引擎给每个站分配的抓取资源是有限的,大致和站点的规模、健康度、更新频率挂钩。当几十万个无价值的筛选 URL 和你真正重要的几百个页面一起排队等抓取,爬虫的精力被海量垃圾稀释,结果就是新品类页迟迟不被发现、重要页面更新很久才被重新抓取。前面那个家居客户的核心症状就是这个——不是页面不好,是爬虫根本没空好好看它们。这一类危害对中大型站是致命的,越大越致命,因为抓取预算本来就是大站绕不开的硬约束。

第二类:索引被近重复薄页稀释

更隐蔽的危害在索引侧。大量筛选组合页内容彼此高度雷同,区别只是少了几个商品或换了排序,这些页一旦进了索引,整站在搜索引擎眼里就充斥着低质、近重复的内容。在有用内容系统、整站质量评估越来越严的今天,这是站点级的负债——它不只是这些垃圾页自己排不上,而是会拖累整站被判定的质量基线。这套整站质量信号怎么运作、薄内容怎么连坐拖垮好页面,原理和我在内链架构完全指南权重深度与孤岛页里讲的权重在站内流动是同一个生态:你的好页面不是孤立被评价的,它泡在你整站的内容质量里一起被打分。

第三类:站内权重流进黑洞空转

第三条线最少人意识到。每个筛选链接都在分走当前页面的内部链接权重。当一个分类页面上有几十个筛选项链接,它本该传给子分类和重要商品的权重,被大量分流进了那些没有任何排名价值的组合 URL 里空转、稀释、最后蒸发。等于你辛苦攒来的站内权重,相当一部分被自己的筛选器漏掉了。这三类危害——预算、索引、权重——是分面导航治理真正要同时解决的三个问题,任何只解决其中一个的方案都是半成品。

有用内容时代,薄筛选页的代价比以前更大

这里要补一个时间维度上的变化,否则你会用五年前的风险评估来对待今天的局面。早些年这些近重复组合页最多就是自己排不上,浪费点抓取,影响相对局部。但随着整站质量评估、有用内容判断变成站点级的连坐机制后,大量薄筛选页进索引,已经不是局部问题,而是会压低整站被判定的内容质量基线——搜索引擎看你这个域名,看到的是几百个好商品页泡在几十万个空洞组合页里,它对整站的信任会被这个比例拖下来。再叠加一层:AI 搜索和摘要在抓取内容做回答时,遇到一个站全是近重复的筛选页,很难判断哪个是该被引用的权威页,结果往往是整站都不被选中。换句话说,分面治理在今天已经从一个抓取效率问题,升级成一个关系到整站能不能被信任、能不能被 AI 引用的质量问题。同样的乱局,放在不同年代,代价是越来越贵的,这也是为什么很多老站这两年莫名其妙整体掉量,根子其实在很多年前就埋下的这堆筛选 URL 上。

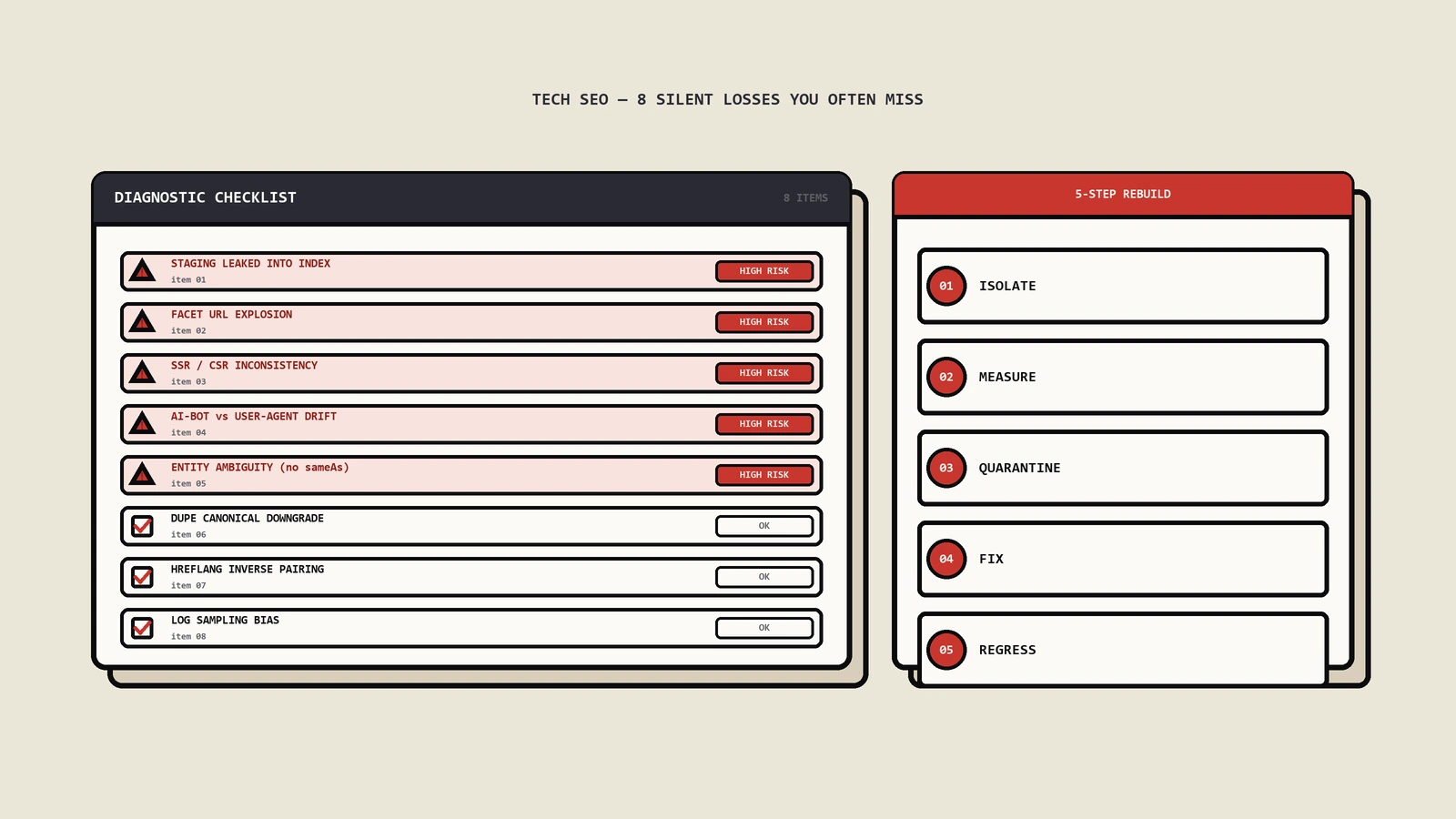

怎么判断自己的站已经踩进这个坑?

别凭感觉,用证据。有几个互相印证的诊断信号,命中两个以上基本就可以确诊。

最硬的证据是服务器日志:按 URL 模式聚合 Googlebot 的抓取量,如果带筛选参数(?color=、?filter=、?sort= 之类)的 URL 占了爬虫抓取的大头,而真正的分类和商品页占比很低,问题已经很严重了。第二个信号在 Search Console 的索引覆盖报告:看“已编入索引”和“已抓取但未编入索引”里有没有大量你根本没打算让它存在的参数 URL,以及索引页数是不是远超你真实的商品和分类数量级。这套报告怎么读、哪些状态是正常的、哪些是真问题,我在GSC 完全指南报告怎么读索引问题怎么诊断里专门拆过,分面导航导致的索引膨胀,在那份报告里有非常典型的指纹。第三个简单粗暴的办法是用 site: 加站点域名搜一下,看返回的大致索引量级是不是离谱地高于你的真实页面数。最后是用爬虫工具(模拟 Googlebot)爬一遍站,看它在不在筛选组合里指数级地越爬越多停不下来——如果爬一晚上 URL 数还在涨,迷宫就在那儿。

一个真实的日志反推实例

讲个脱敏的实例,把诊断怎么从数据反推出结论这条链走一遍,比抽象描述有用。还是那个家居客户,三个月日志聚合后,按 URL 一级模式归类,Googlebot 的抓取分布大致是这样:带 ?sort= 的排序 URL 占了约三成四,带两个以上筛选参数的组合 URL 占约四成一,真正的分类页不到一成,商品详情页约一成五,其余是静态资源。七成五的爬虫预算,花在了零排名价值的排序和多维组合上。更关键的一个交叉信号:把商品详情页按最近一次被抓取的时间排开,发现近四成商品页超过六周没被重新抓取过——这直接解释了为什么改了价格、改了库存状态的页面在搜索结果里迟迟不更新。再去 Search Console 对照,索引覆盖里“已抓取但未编入索引”有数万条全是参数 URL,“已编入索引”里也混着大量 ?sort= 页。三条证据互相咬合,结论就锁死了:不是内容问题,是抓取预算被排序和组合 URL 吸干、连带重要页面长期不被复抓。处置后的回收曲线也值得记一笔——从源头停掉这些 URL 的生成、并对已索引的挂 noindex 之后,参数 URL 的抓取占比大约用了五到八周才明显回落,商品页的平均复抓间隔在第二个月内从六周以上缩回到十天上下。这里有个必须管理预期的点:分面治理是慢药,索引回收和抓取重新分配以周甚至月计,做完别指望一周见效,没耐心的人最容易在第三周觉得没用又回去乱改,前功尽弃。

robots、noindex、canonical 到底该用哪个?

这是整篇最关键的部分。绝大多数人栽在这儿,因为他们以为这几个工具是同义词,随便挑一个屏蔽掉就行。它们解决的根本不是同一个问题,用错了不仅没用,还会自伤。

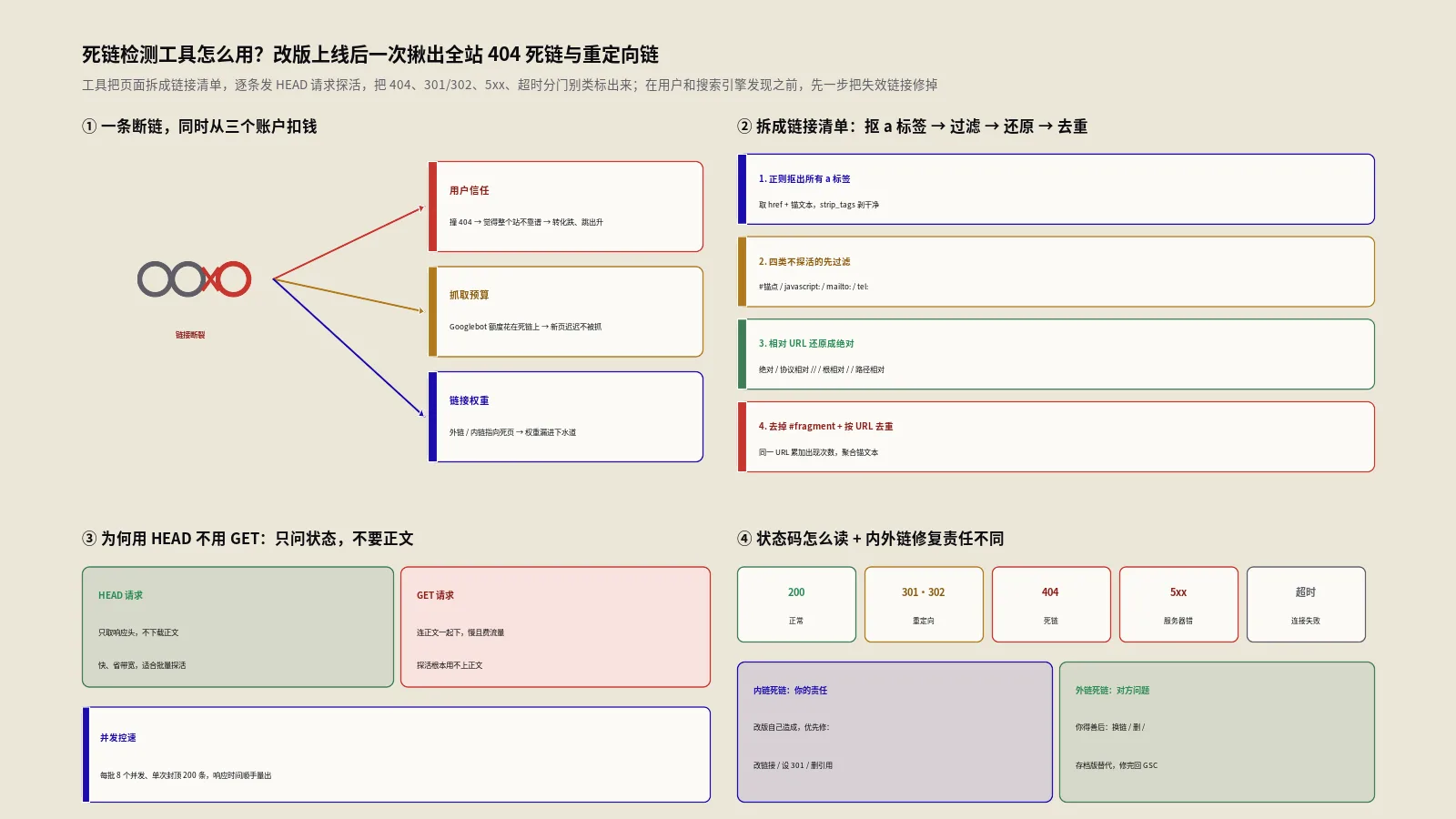

robots.txt Disallow:挡抓取,但挡不住索引,还会致盲

这是最容易被滥用、也最容易自伤的工具。robots.txt 的 Disallow 只做一件事:阻止爬虫抓取这个 URL 的内容。它不阻止索引——如果这个被屏蔽的 URL 在站内外被别的页面链接到,搜索引擎仍然可能把它收进索引,只是显示成一个没有标题描述的空壳。更要命的是连带效应:一旦你 Disallow 了某个 URL,爬虫就再也读不到这个页面上的 canonical 标签和 noindex 指令了——你等于把自己的眼睛蒙上,再也无法通过页面内的信号告诉搜索引擎该怎么正确处理它。前面那个家居客户最初的自救动作就是这个:技术一拍脑袋把所有带参数的 URL 全 Disallow 了,结果那些 URL 不仅没从索引里掉,反而因为爬虫读不到它们身上本来挂着的 canonical,永久卡在索引里成了几十万个空壳,掉量更狠了。robots.txt 适合的场景很窄:你确定这批 URL 既不需要被索引、又没什么外部链接、而且你想立刻止住抓取出血——它是个粗暴的止血钳,不是手术刀。还有两个解析层面的坑,写规则前必须知道,否则你以为屏蔽了其实没屏蔽,或者误伤了正常页面:其一,主流爬虫匹配的是最具体的那条规则,而不是文件里靠前的那条,当 Allow 和 Disallow 同时命中一个 URL,路径更长更精确的那条赢——这意味着你想精确放行某个着陆页、屏蔽其余组合时,规则的具体程度要算清楚,不能靠摆放顺序;其二,robots.txt 文件本身有大小上限(Google 侧约 500KB),电商站一旦试图用海量逐条 Disallow 去枚举每一种参数组合,规则文件会迅速膨胀到难以维护甚至超限被截断——这从反面再次说明,分面问题靠在 robots.txt 里堆规则是堵不住的,真正的解法必须在 URL 设计和源头控制上,robots 只能用通配符做粗粒度兜底。

meta noindex:挡索引,但仍然耗抓取预算

noindex 做的是另一件事:允许爬虫抓取,但明确告诉它不要把这个页面放进索引。配合 follow(noindex,follow)时,页面上的链接权重还能正常流出去。它能干净地解决索引膨胀和近重复问题,是处理“这个组合页不该被搜到、但也不想完全切断它”的标准答案。但要清醒一点:noindex 不省抓取预算——爬虫必须先抓取这个页面、读到里面的 noindex 才知道不收它,所以页面照样被爬。对纯粹的索引质量问题它是对的,对抓取预算被烧干的问题它治不了本。

canonical:软建议,只适合真的近重复

canonical 是一个软信号,它告诉搜索引擎“这一堆 URL 其实是同一个东西的不同呈现,请把权重和排名归到我指定的那个规范版本上”。它最适合的场景是内容实质相同、只是排序或参数顺序不同的组合——比如同一批商品按价格升序和降序,内容一样,全部 canonical 回那个干净的分类页。但 canonical 有个致命的误用:当筛选后的内容其实已经实质不同(比如只看红色连衣裙,商品集合明显变了),你还硬把它 canonical 回全量分类页,搜索引擎会发现指定的规范页和当前页内容对不上,于是忽略你的 canonical,自己另选一个——你以为处理好了,其实根本没生效。canonical 是建议不是命令,内容差太多它就不认账。

从源头不让爬虫造出这些 URL:治本的那一招

前面三个都是 URL 已经产生后的补救。真正治本的思路是从一开始就别让爬虫发现这些组合 URL。具体手段有几种:筛选交互用 JavaScript 在前端完成、不改变 URL 或只用井号锚点(爬虫不把井号后的当独立页面);用 POST 表单而不是 GET 链接来提交筛选,爬虫默认不提交表单;或者对那些不希望被爬的筛选链接在渲染时就不输出成可抓取的 a 标签。这一招的好处是它同时解决三类危害——爬虫压根没发现这些 URL,预算不烧、索引不膨胀、权重不外漏。代价是实现复杂度高、对前端架构有要求,而且要小心别把那些你确实想被索引的着陆页也一起藏了。所以现实里最稳的不是只用一招,而是组合:该被搜的着陆页保留干净可爬的 URL,海量无价值组合从源头不可爬,处在中间地带的用 noindex 或 canonical 兜底。

rel=nofollow 和那个已经消失的参数工具,别再指望它们

有两个被无数老教程反复推荐、今天却基本指望不上的旧办法,得专门点名,否则你会照着过期攻略白忙。第一个是给筛选链接加 rel=nofollow,以为这样爬虫就不会顺着爬下去、也不会分走权重。现实是:现代搜索引擎对站内 nofollow 的处理早就变了——它更多被当成一个参考提示而非硬指令,爬虫仍可能通过别的途径发现这些 URL,而且和站内 nofollow 同理,被 nofollow 切掉的那份权重不会转移给别的链接,而是直接蒸发。所以靠 nofollow 治分面,既挡不干净又白白漏权重,是典型的事倍功半。第二个是 Search Console 里那个曾经的 URL 参数处理工具——很多年里大家靠它告诉 Google 某个参数不影响内容、不用重复抓。这个工具已经被正式下线了。它的消失本身就是一个信号:搜索引擎在表达“别再用站外配置来打补丁,请你直接在 URL 设计、canonical 和站内链接上把这件事做对”。这意味着今天处理参数 URL,没有了那个偷懒的旋钮,唯一可靠的就是回到本文讲的这套——干净的 URL 形态、一致的 canonical、从源头控制爬虫能发现什么。指望工具替你兜底的时代过去了,现在拼的是架构本身做没做对。

那到底哪些筛选页该留着被索引?

这是被问得最多、也最容易走极端的问题。一种极端是全部放开(于是组合爆炸),另一种极端是全部 noindex(结果把本来有流量的着陆页也杀了,白白掉量)。正确的思路是白名单:默认所有筛选组合都不该被索引,只有满足条件的少数被主动放行。

放行的判断标准就一条核心问题——这个筛选维度本身有没有独立的、值得拿排名的真实搜索需求。比如“红色连衣裙”“大码女装”“某品牌跑鞋”这种,用户确实会这么搜,市场上也有明确的搜索量,那这类单维度筛选页就值得做成正式的着陆页:给它干净的、人能读懂的 URL(路径式如 /dresses/red/ 优于一长串参数),写唯一的标题、描述和一段针对这个需求的引导文案,让它成为一个真正的落地页而不是分类页的残次复制品。而像“红色 + S 码 + 某品牌 + 99 到 199 元 + 按销量排序”这种四五个维度叠起来的组合,没有任何人会这么搜,它就该被挡在索引外。下面这张表是带电商客户做分面治理时反复用的决策矩阵,可以直接照着套。

| 这个筛选组合的情况 | 有独立搜索需求? | 处理方式 |

|---|---|---|

| 单维度、有明确搜索量(红色连衣裙、大码女装) | 有 | 做成正式着陆页:干净路径URL+唯一TDK+引导文案,可索引可被内链 |

| 单维度但需求弱(某个冷门材质) | 弱 | 可访问但 noindex,follow,保留用户筛选体验不进索引 |

| 仅排序/分页变化、内容实质相同 | 无 | canonical 回干净的父分类页 |

| 两个以上维度的任意叠加组合 | 无 | 源头不可爬(JS/POST/不输出链接)为主,兜底 noindex |

| 带 tracking 等追踪参数的 URL | 无 | canonical 回无参数版本,并在内链里禁止生成 |

URL 该用参数还是路径,前端筛选怎么配合?

URL 设计本身就能消掉一半问题。两个原则:第一,想被索引的着陆页用干净的路径式 URL,不想被索引的组合才用参数——这天然就把“值得排名的”和“垃圾组合”在 URL 形态上分开了,处理时一眼能区分。第二,参数顺序和取值必须强制规范化:?color=red&size=m 和 ?size=m&color=red 如果都能访问,同一个组合又翻倍;后端要统一参数顺序、去掉空参数、剥离 utm 这类追踪参数后做 301 或 canonical 收敛到唯一形态。前端配合上,最稳的模式是只在用户真有独立搜索价值的少数维度上改变可索引的 URL,其余筛选交互走前端、不产生新的可抓取链接;如果用了 history 接口动态改 URL,务必给每个状态配一致的 canonical,别让框架默默生成一堆爬虫能发现却没人管的状态 URL。一句话:URL 不是前端随便生成的副产品,它是你和搜索引擎之间的接口,每多一个能被爬到的 URL,都是你要负责的一份债。

SSR、CSR、PRG,前端架构怎么选才不挖坑

具体到前端架构,这里有几个真实的取舍点,是和开发对接时最容易扯不清、也最容易埋雷的地方。最稳的经典模式是 PRG(提交-跳转-获取):用户勾选筛选用表单 POST 提交,服务端处理完用 302 跳到一个干净的、规范化好的结果 URL,爬虫默认不提交表单、自然也就发现不了那些中间组合——这套老但极其有效,对预算保护最彻底。如果产品形态决定了筛选必须是即时的前端交互(勾一下立刻刷新结果不跳页),那关键就在改不改地址栏:纯前端刷新结果、URL 完全不变,对 SEO 最干净,代价是用户无法把某个筛选状态分享或收藏;如果业务一定要可分享,就只对白名单里那几个有搜索价值的维度用 history 接口生成可索引的干净 URL,其余维度的状态一律不进 URL 或只放在井号后面,并且每个能被访问到的状态都必须配一致的 canonical。最容易出事的是上了某些前端框架的站——框架为了所谓体验,会默默把每一种筛选状态都同步进地址栏、还做了服务端渲染让爬虫全都能抓到,开发觉得这是先进,SEO 看到的是几十万个没人管的可索引状态 URL 一夜之间被造出来。所以分面这件事必须在前端架构设计阶段就让 SEO 介入,等站做完上线了再来收拾,成本是数量级的差别。纯客户端渲染(爬虫拿到的是空壳靠 JS 填充)则是另一个极端的坑,那已经不只是分面问题,是整站可见性问题,超出本文范围,但原则一样:你得清楚爬虫到底能发现和读到什么,而不是想当然。一句话总结这套取舍——能不进 URL 的状态就别进 URL,必须进的就给干净形态加一致 canonical,绝不让框架替你做这个决定。

一条可以贴在墙上的分面导航治理原则:默认所有筛选组合都不该进索引,只白名单放行有真实搜索需求的单维度着陆页;优先从源头不让爬虫发现垃圾组合(治本),robots.txt 只在你确定不需要索引也没外链时当止血钳用,永远别用它去“删”已经被索引的页面——那只会把它们变成你再也指挥不动的空壳。

一次能落地的分面治理审计该怎么做?

把上面所有东西串成可执行的顺序,关键是先止血,再优化,别反过来。

第一步,拉服务器日志和 Search Console,定位爬虫的抓取预算到底烧在哪些 URL 模式上,按量级排序——这是止血的靶子,先治出血最猛的那几类参数。第二步,把站点所有筛选维度列出来,做组合量级估算,心里对“爆炸规模”有个数,也顺手发现哪些维度根本不该可组合。第三步,定白名单:和业务一起确认哪些单维度筛选有真实搜索需求,把它们规划成正式着陆页,给干净 URL 和唯一 TDK。第四步,对白名单之外的,按那张决策矩阵处置,原则是能从源头不可爬的优先从源头解决,做不到的用 noindex 或 canonical 兜底,但绝不要先用 robots.txt 把它们一锅 Disallow——如果它们已经在索引里,先让爬虫还能读到 noindex 把它们干净地清出去,等索引回收得差不多了,再考虑用 robots 收尾止抓取。第五步,持续监控:盯抓取统计里参数 URL 占比有没有下降、索引覆盖里垃圾页有没有在回收、重要页面的抓取频率有没有回升。这套顺序里最反直觉、也最多人做反的就是第四步——大量站第一反应就是 robots 一把梭,结果把还能抢救的页面变成永久空壳,越救越死。

监控环节再说具体一点,因为很多人做完不知道该盯什么、看到波动就慌。三个核心指标分别有各自的判读方式:抓取统计里参数 URL 的占比,看的是趋势不是绝对值,处置后它应该在数周内出现持续下行,如果纹丝不动,多半是源头还在生成这些链接,治标没治本;索引覆盖报告里那批垃圾参数页,正常表现是先涨后稳再缓慢回落——刚挂 noindex 后它们甚至可能短暂增多(因为爬虫要重新抓到才知道要清),别被这个吓回去,关键看一两个月后的总趋势是不是向下;重要页面的平均抓取间隔,这是最终要的结果指标,它缩短了,整套治理才算真的起效。顺带把几个最高频的反模式钉在这里,对照着自查:一是 robots 一把梭把已索引页变空壳(前面反复讲了,最致命);二是 canonical 滥用在内容已实质不同的组合上,自以为收敛了其实被忽略;三是一刀切全站 noindex,把本来有真实搜索流量的单维度着陆页也一起杀掉,治好了爬虫迷宫却换来一波业务流量暴跌;四是只做了源头不可爬、却忘了已经躺在索引里的几十万旧 URL,新债止住了旧债还在拖整站质量;五是做完不监控,三周没见效就推翻重来,永远在反复横跳里原地打转。这五个里中招最多的是第三和第四——前者是用力过猛误伤自己,后者是只做了一半还以为做完了。

常见问题解答

分面导航和分页是一回事吗?

不是。分面是颜色尺码品牌等维度的自由组合,会指数级爆炸;分页只是同一结果集的连续翻页,量级线性、处理思路也不同。两者要分开诊断,别用一套方案硬套,混为一谈是常见误区。

直接用 robots.txt 把所有带参数 URL 屏蔽掉行不行?

多数情况会自伤。robots.txt 只挡抓取不挡索引,已被链接的参数页仍可能以空壳留在索引里,而且爬虫从此读不到页面上的 canonical 和 noindex,你等于把自己指挥它的手段也切断了,越救越死。

给筛选组合页加 canonical 回分类页一定有效吗?

不一定。canonical 是软建议,只在内容实质相同时可靠。当筛选后商品集合明显变了,搜索引擎发现规范页和当前页内容对不上,会忽略你的 canonical 自己另选,你以为处理好了其实没生效。

noindex 能解决抓取预算被烧光的问题吗?

不能。noindex 只解决索引膨胀,爬虫仍要先抓取页面才能读到 noindex,抓取照样发生。要省抓取预算必须从源头让爬虫发现不了这些 URL,比如前端筛选不产生可抓取链接。

哪些筛选页应该保留并让它被收录?

只放行有独立真实搜索需求的单维度页,比如红色连衣裙、大码女装这类用户确实会搜的,给它干净路径URL和唯一TDK做成正式着陆页。两个以上维度的任意叠加组合没人会搜,应挡在索引外。

参数式 URL 和路径式 URL 哪个更好?

想被索引的着陆页用干净路径式,垃圾组合才用参数,这样形态上天然区分好坏。同时必须规范化参数顺序、剥离追踪参数并收敛到唯一形态,否则同一组合换个参数顺序又翻倍。

做一次分面治理,第一步该干什么?

不是急着屏蔽,是先拉服务器日志和GSC定位爬虫预算到底烧在哪些URL模式上,按量级排序找出血最猛的靶子。先有证据再处置,顺序永远是先止血定白名单,最后才动robots。

说到底,分面导航是电商技术 SEO 里投入产出比极高、却长期没人管的一块。它不像内容和外链那样性感,做好了也没人夸,但它经常就是那个让你新页面收不进、老页面慢慢掉、你却怎么查内容都查不出原因的隐形瓶颈。先别急着写下一批 landing page,把你站里那座爬虫迷宫拆掉,往往就是当下最划算的那一步。

权威参考资料

本文标题:《电商导航SEO怎么做?筛选器URL不爆炸的系统方案8步》

本文链接:https://zhangwenbao.com/faceted-navigation-filter-url-seo-crawl-trap.html

版权声明:本文原创,转载与引用请注明作者与原文链接。许可协议: CC BY 4.0